决策树优化技巧:利用信息增益提升分类准确率的秘诀

发布时间: 2024-09-04 11:49:36 阅读量: 125 订阅数: 46

ID3-tree.rar_ID3决策树分类_ID3算法_decision tree_id3_信息增益

# 1. 决策树算法基础

决策树算法是一种常用的机器学习方法,它通过一系列的规则将数据集划分成不同的子集,并形成树状结构。决策树的核心是递归地选择最优特征并对数据集进行分割,最终实现对数据的分类或回归预测。

在分类问题中,决策树从根节点开始,递归地选择最优特征,并根据该特征的不同取值将其分成子节点,这样每棵树的每个分支代表该特征下的一个分支条件,每个叶节点代表一个类别。这个选择最优特征的过程称为特征选择,它是决策树的核心。

在决策树算法中,有两个重要的概念需要理解:熵和信息增益。熵是衡量数据集混乱程度的指标,而信息增益则是基于熵来度量特征对分类结果的贡献度。通过计算各个特征的信息增益,我们可以选择对目标变量影响最大的特征作为当前节点的分割标准。这一过程是构建决策树模型的关键步骤,它直接影响模型的性能和预测准确性。

接下来的章节将会深入探讨信息增益的计算原理,以及在实际应用中如何优化决策树模型,从而提升分类准确率。

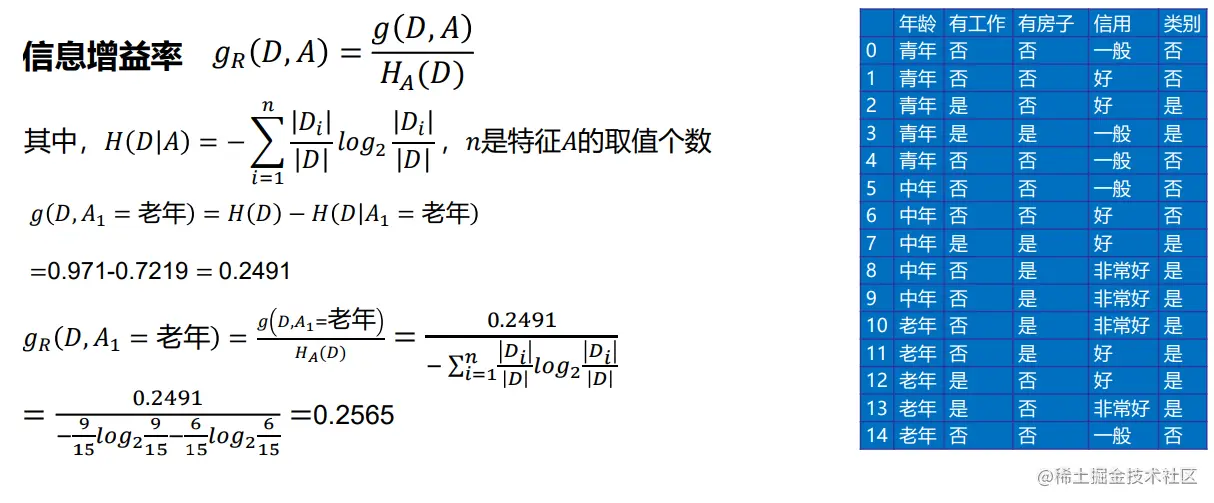

# 2. 信息增益的理论与实践

### 2.1 信息熵的计算原理

#### 2.1.1 熵的定义及其数学表述

信息熵是衡量数据集纯度的一种方式,起源于信息论,其思想是用信息的不确定性来描述系统的状态。在决策树中,熵用来量化分类结果的不确定性,可以表示为:

\[ H(S) = -\sum_{i=1}^{n} p_i \log_2 p_i \]

其中,\( H(S) \)是集合\( S \)的熵,\( p_i \)是集合\( S \)中第\( i \)个类别的概率。

从数学表述中,我们可以看出,熵的本质是一个期望值。如果一个数据集完全纯净,即所有实例都属于同一类别,那么熵值为0。相反,如果数据集中类别分布均匀,则熵值达到最大。

#### 2.1.2 熵在决策树中的作用

在决策树算法中,熵作为衡量节点分裂质量的一个重要标准。我们希望每次分裂都能最大程度地减少系统的熵,即增加数据集的纯度。因此,在决策树构建过程中,选择熵变化最大的特征作为分裂依据。

### 2.2 信息增益的计算方法

#### 2.2.1 信息增益的计算公式

信息增益(Information Gain, IG)衡量的是在得知特征\( X \)的信息之后,数据集\( S \)的熵减少量。计算公式为:

\[ IG(S, X) = H(S) - \sum_{t \in T} \frac{|S_t|}{|S|} H(S_t) \]

其中,\( T \)是分裂后\( S \)的子集,\( |S_t| \)是子集\( t \)的实例数,\( H(S_t) \)是子集\( t \)的熵。

#### 2.2.2 信息增益与特征选择的关系

信息增益帮助我们量化了在考虑特征\( X \)之后数据集纯度的增加程度。在特征选择时,我们会优先考虑那些能够带来最大信息增益的特征,因为在其它条件相同的情况下,这样的特征更有可能产生好的分裂效果。

### 2.3 实际应用:信息增益在决策树构建中的优化

#### 2.3.1 构建基于信息增益的决策树

构建基于信息增益的决策树涉及到数据集的递归分裂。每一步我们都选择信息增益最高的特征进行分裂,直到满足停止条件,比如所有实例都属于同一类别,或者没有更多特征可以分裂。

下面是一个构建决策树的Python代码示例:

```python

import numpy as np

import pandas as pd

from math import log2

def calculate_entropy(data):

# 将数据集分割成类别

labels = data.iloc[:, -1]

unique_labels = np.unique(labels)

entropy = 0

for label in unique_labels:

prob = len(labels[labels == label]) / len(labels)

entropy -= prob * log2(prob)

return entropy

def get_best_split(data, num_features):

base_entropy = calculate_entropy(data)

best_info_gain = 0

best_feature = -1

# 遍历所有特征,计算每个特征的信息增益

for i in range(num_features):

feature_values = data.iloc[:, i]

unique_vals = np.unique(feature_values)

new_entropy = 0

for value in unique_vals:

sub_data = data[feature_values == value]

prob = len(sub_data) / len(data)

new_entropy += prob * calculate_entropy(sub_data)

info_gain = base_entropy - new_entropy

if info_gain > best_info_gain:

best_info_gain = info_gain

best_feature = i

return best_feature

def decision_tree_train(data, num_features):

# 当所有实例都属于同一类别时停止

if len(np.unique(data.iloc[:, -1])) == 1:

return np.unique(data.iloc[:, -1])[0]

# 没有更多特征时停止

if num_features == 0:

return np.unique(data.iloc[:, -1])[np.argmax(np.bincount(data.iloc[:, -1].astype(int)))]

# 找到最佳特征进行分裂

best_feature = get_best_split(data, num_features)

best_feature_name = data.columns[best_feature]

tree = {best_feature_name: {}}

features = data.iloc[:, :-1].columns.values.tolist()

del features[best_feature]

for value in np.unique(data.iloc[:, best_feature]):

sub_data = data[data[best_feature_name] == value]

sub_tree = decision_tree_train(sub_data, len(features))

tree[best_feature_name][value] = sub_tree

return tree

# 示例数据集

data = pd.read_csv('data.csv')

# 假设数据最后一列是标签

num_features = len(data.columns) - 1

tree = decision_tree_train(data, num_features)

```

在这个例子中,我们首先定义了一个函数来计算数据集的熵值,然后定义了一个函数来找到最佳分裂的特征。最后,我们定义了一个递归函数来训练决策树模型。

#### 2.3.2 优化决策树的剪枝策略

构建决策树的过程中,容易出现过拟合现象。剪枝是解决这一问题的常用手段,包括预剪枝(在决策树构建过程中提前停止分裂)和后剪枝(先完整构建决策树,然后去掉一些枝条)。

我们可以通过设置最小分裂信息增益阈值来实现预剪枝。在上述代码中,通过调整 `num_features` 参数,可以控制决策树的最大深度,这是一个预剪枝的简单应用。代码逻辑说明部分已经简要提及了如何通过调整参数来优化决策树模型。

# 3. 提升分类准确率的高级技巧

## 3.1 特征选择的策略

### 3.1.1 过滤方法与包裹方法

在构建决策树之前,选择合适的特征对于提高分类准确率至关重要。特征选择的策略主要分为两大类:过滤方法(Filter Methods)和包裹方法(Wrapper Methods)。

过滤方法基于数据集中的统计属性对特征进行评估。它不依赖于任何特定的机

0

0