深度学习框架大比拼:TensorFlow vs. PyTorch vs. Keras

发布时间: 2024-12-22 11:42:04 阅读量: 5 订阅数: 5

【java毕业设计】智慧社区教育服务门户.zip

# 摘要

本文旨在提供深度学习框架的全面概览,并深入分析TensorFlow和PyTorch两大主流框架的核心概念与高级特性。通过介绍TensorFlow的计算图、张量操作、Keras集成、分布式训练和PyTorch的动态计算图、Numpy兼容性以及它们在图像识别、时间序列预测和自然语言处理等领域的实践案例,本文展示了各框架的特点和适用场景。文章还探讨了Keras的设计哲学、高级应用以及与其它框架的融合策略。最后,本文针对如何根据项目需求选择合适的深度学习框架,并预测了深度学习框架的未来发展趋势,特别是在模块化、可重用性和自动化机器学习方面的进步。

# 关键字

深度学习;TensorFlow;PyTorch;Keras;计算图;自动化机器学习

参考资源链接:[深度学习500问:详尽数学基础与核心知识点解析](https://wenku.csdn.net/doc/3ep1kb8j6u?spm=1055.2635.3001.10343)

# 1. 深度学习框架概览

在现代人工智能的版图中,深度学习框架是构建和训练神经网络不可或缺的工具。这些框架不仅为开发者提供了一种快速实现复杂算法的方式,同时也促进了研究和开发的效率。本章将为读者提供一个深度学习框架的宏观视角,涵盖了它们的发展历史、核心功能以及各自的特色和优势。

在过去的几年里,我们见证了从TensorFlow到PyTorch等框架的演变,这些变化不仅简化了模型的开发流程,还极大地推动了深度学习技术在各行各业的应用。接下来的章节将深入探讨TensorFlow和PyTorch等主流框架的内部工作机制,以及它们在实践中的具体应用。

了解深度学习框架的基本原理及其生态系统将有助于开发者做出更明智的选择,并能更好地适应不断变化的技术环境。随着深度学习技术的不断成熟,选择合适框架的能力对于任何希望在AI领域有所建树的专业人士来说,都是必不可少的技能之一。

# 2. TensorFlow深度剖析

## 2.1 TensorFlow的核心概念

### 2.1.1 计算图的构建和执行

计算图是TensorFlow的核心抽象,它定义了操作和变量之间的计算关系。构建计算图的过程中,我们定义了数据流和操作,但直到实际运行时才真正执行计算。构建好的图通常保存在一个Graph对象中,并可被多次复用。

TensorFlow允许使用`tf.Graph()`构建自定义图,但更常见的是使用默认图:

```python

import tensorflow as tf

# 创建两个常量张量

a = tf.constant(2.0, name='a')

b = tf.constant(3.0, name='b')

# 定义一个加法操作,生成计算图中的节点

adder_node = a + b

```

以上代码创建了两个节点:一个常数节点和一个加法节点。它们被添加到了默认的计算图中。只有当你运行一个会话(Session)并调用`sess.run(adder_node)`时,TensorFlow才会执行实际的计算。

计算图执行流程可以分为以下几个步骤:

1. 构建图:定义计算节点和边。

2. 配置图:设置会话配置,如设备放置策略。

3. 运行会话:使用会话执行图中的一个或多个节点。

### 2.1.2 张量操作和自动微分

张量是TensorFlow的基础数据结构,可以看作一个多维数组。所有的运算都产生或操作张量对象。操作对象包括但不限于矩阵乘法、卷积、激活函数等。TensorFlow提供了一整套操作(Operations)API,使得对张量进行复杂运算变得简单。

TensorFlow的自动微分功能可以自动计算目标函数的梯度。这对于训练神经网络尤为重要,因为需要反复计算损失函数相对于权重的梯度。

```python

x = tf.Variable(1.0)

y = tf.Variable(2.0)

with tf.GradientTape() as tape:

z = x**2 + y**3

grad_x, grad_y = tape.gradient(z, [x, y])

```

代码中,我们首先创建了两个`tf.Variable`类型的张量`x`和`y`。随后使用`GradientTape`上下文管理器来记录计算过程中的操作,以便后续自动计算梯度。`tape.gradient`方法自动计算变量`x`和`y`相对于`z`的梯度。

## 2.2 TensorFlow的高级特性

### 2.2.1 Keras集成和高阶API使用

TensorFlow 2.x版本中,Keras作为其高层API被完全集成。Keras提供了简单易用的方法来构建和训练模型,同时保持了高度的灵活性和扩展性。我们可以使用`tf.keras`模块快速搭建复杂的神经网络。

```python

from tensorflow.keras import layers, models

# 使用Sequential API快速搭建一个简单的神经网络模型

model = models.Sequential([

layers.Dense(64, activation='relu', input_shape=(10,)),

layers.Dense(10, activation='softmax')

])

```

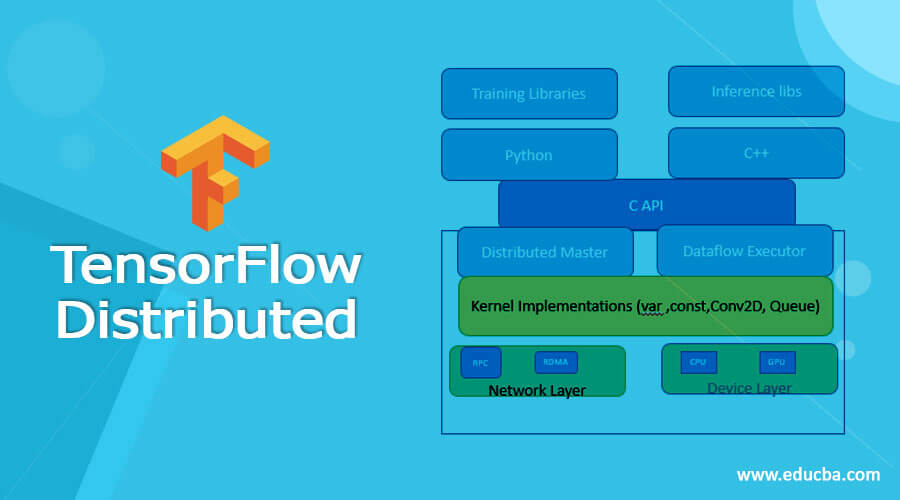

### 2.2.2 分布式训练和模型部署

为了提升训练速度和模型部署的灵活性,TensorFlow支持分布式训练和多种部署策略。在分布式训练中,可以将计算任务分布到多个GPU或TPU以及多个机器上进行。

```python

strategy = tf.distribute.MirroredStrategy()

with strategy.scope():

# 在分布式策略作用域内构建模型

model = build_model()

```

模型部署时,TensorFlow提供了转换工具如`SavedModel`导出格式,用于将训练好的模型部署到不同的环境中,如服务器、移动设备、边缘设备等。

## 2.3 TensorFlow实践案例

### 2.3.1 图像识别项目实践

在图像识别领域,TensorFlow凭借其高效的计算能力和丰富的API支持,成为研究和应用中的首选。我们可以通过构建卷积神经网络(CNN)来实现图像识别功能。

```python

from tensorflow.keras import layers, models

# 构建一个简单的CNN模型用于图像分类

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.Flatten(),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])

```

### 2.3.2 时间序列预测分析

在时间序列预测任务中,TensorFlow可以使用其RNN(循环神经网络)和LSTM(长短期记忆网络)单元来捕捉数据中的时间动态信息。

```python

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import LSTM, Dense

# 创建一个LSTM模型用于时间序列预测

model = Sequential()

model.add(LSTM(50, activation='relu', return_sequences=True, input_shape=(timesteps, features)))

model.add(LSTM(50, activation='relu'))

model.add(Dense(1))

model.compile(optimizer='adam', loss='mse')

```

以上代码展示了如何构建一个LSTM网络进行时间序列预测,其中`timesteps`和`features`需要根据实际数据集进行替换。通过精心设计的网络结构和足够的训练数据,我们可以提高预测的准确性。

以上是本章节部分的详细内容。接下来的章节将继续深入TensorFlow的高级特

0

0