YOLO算法的超参数调优:优化目标检测模型性能的实战秘诀

发布时间: 2024-08-14 21:02:27 阅读量: 70 订阅数: 45

# 1. YOLO算法概述**

YOLO(You Only Look Once)算法是一种实时目标检测算法,因其速度快、精度高而闻名。它采用单次卷积神经网络,将目标检测任务视为回归问题,直接预测目标的边界框和类别概率。YOLO算法的优势在于其高帧率和端到端训练,使其非常适合实时应用,例如对象跟踪和自动驾驶。

# 2. 超参数调优理论基础

### 2.1 超参数的概念和重要性

**超参数**是指在机器学习模型训练过程中,需要手动设置的参数,它们与模型结构无关,而是控制训练过程和模型的行为。超参数通常包括学习率、批量大小、正则化系数等。

超参数对模型性能有显著影响。一个好的超参数组合可以提高模型的准确率、泛化能力和训练效率。相反,不合适的超参数会阻碍模型的训练,导致欠拟合或过拟合。

### 2.2 超参数调优的常见方法

超参数调优的目标是找到一组最优的超参数,以最大化模型性能。常用的超参数调优方法包括:

**1. 网格搜索**

网格搜索是一种穷举法,它遍历超参数的预定义范围,并对每组超参数训练模型。这种方法简单易行,但计算成本高,尤其当超参数数量较多时。

**2. 随机搜索**

随机搜索与网格搜索类似,但它随机采样超参数,而不是遍历整个范围。这种方法计算成本更低,但可能错过最优解。

**3. 贝叶斯优化**

贝叶斯优化是一种基于概率论的优化方法。它通过构建超参数空间的概率分布,并根据先前的训练结果迭代更新分布,来寻找最优解。这种方法计算成本较高,但通常比网格搜索和随机搜索更有效。

**4. 进化算法**

进化算法是一种受进化论启发的优化方法。它通过模拟自然选择过程,迭代地生成和选择超参数组合,直到找到最优解。这种方法计算成本较高,但可以找到复杂超参数空间中的全局最优解。

**代码块:**

```python

# 网格搜索示例

import numpy as np

from sklearn.model_selection import GridSearchCV

# 定义超参数范围

param_grid = {

'learning_rate': [0.01, 0.001, 0.0001],

'batch_size': [32, 64, 128],

'regularization_coefficient': [0.1, 0.01, 0.001]

}

# 创建网格搜索对象

grid_search = GridSearchCV(model, param_grid, cv=5)

# 训练模型并寻找最优超参数

grid_search.fit(X, y)

# 打印最优超参数

print(grid_search.best_params_)

```

**逻辑分析:**

这段代码使用网格搜索方法对超参数进行调优。`param_grid`字典定义了超参数的搜索范围。`GridSearchCV`对象将遍历所有可能的超参数组合,并使用5折交叉验证来评估模型性能。最后,`best_params_`属性返回最优超参数组合。

**参数说明:**

* `model`:要调优的机器学习模型

* `param_grid`:超参数搜索范围的字典

* `cv`:交叉验证折数

# 3. YOLO算法超参数调优实践

### 3.1 数据集准备和模型训练

**数据集准备**

* **选择合适的训练数据集:**对于目标检测任务,常用的数据集包括 COCO、VOC 和 ImageNet。选择与目标检测任务相匹配的数据集至关重要。

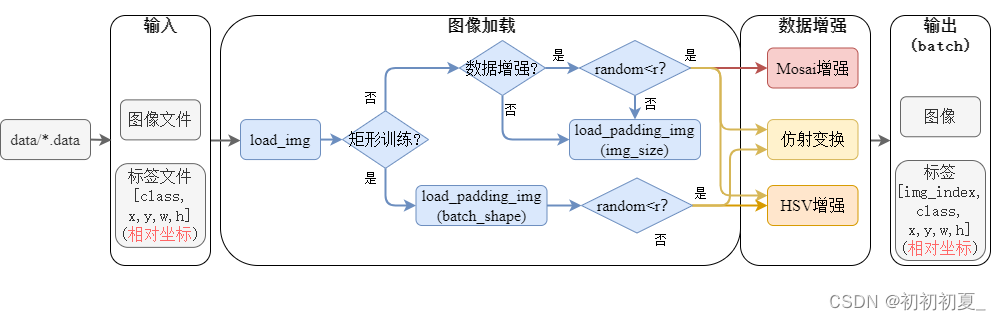

* **数据预处理:**对训练数据进行预处理,包括图像大小调整、数据增强(如翻转、裁剪、旋转)和归一化。

**模型训练**

* **选择合适的YOLO模型:**根据目标检测任务的复杂性和资源限制,选择合适的YOLO模型,如 YOLOv3、YOLOv4 或 YOLOv5。

* **设置训练参数:**设置训练参数,包括学习率、批量大小、训练轮数和优化器。

* **训练模型:**使用选定的数据集和训练参数训练YOLO模型。

### 3.2 超参数调优策略和技巧

**超参数调优策略**

* **网格搜索:**系统地遍历超参数值的组合,并评估每个组合的性能。

* **随机搜索:**在超参数空间中随机采样值,并评估每个采样值的性能。

* **贝叶斯优化:**基于先前的评估结果,使用贝叶斯优化算法迭代地选择要评估的超参数值。

**超参数调优技巧**

* *

0

0