YOLO训练超参数优化:探索模型最佳配置,提升性能

发布时间: 2024-08-17 09:23:01 阅读量: 51 订阅数: 45

# 1. YOLO模型概述与超参数概念

### 1.1 YOLO模型概述

YOLO(You Only Look Once)是一种单阶段目标检测模型,它将目标检测任务转换为一个回归问题。与两阶段检测器(如Faster R-CNN)不同,YOLO直接从输入图像预测边界框和类概率,从而实现一次性检测。

### 1.2 超参数概念

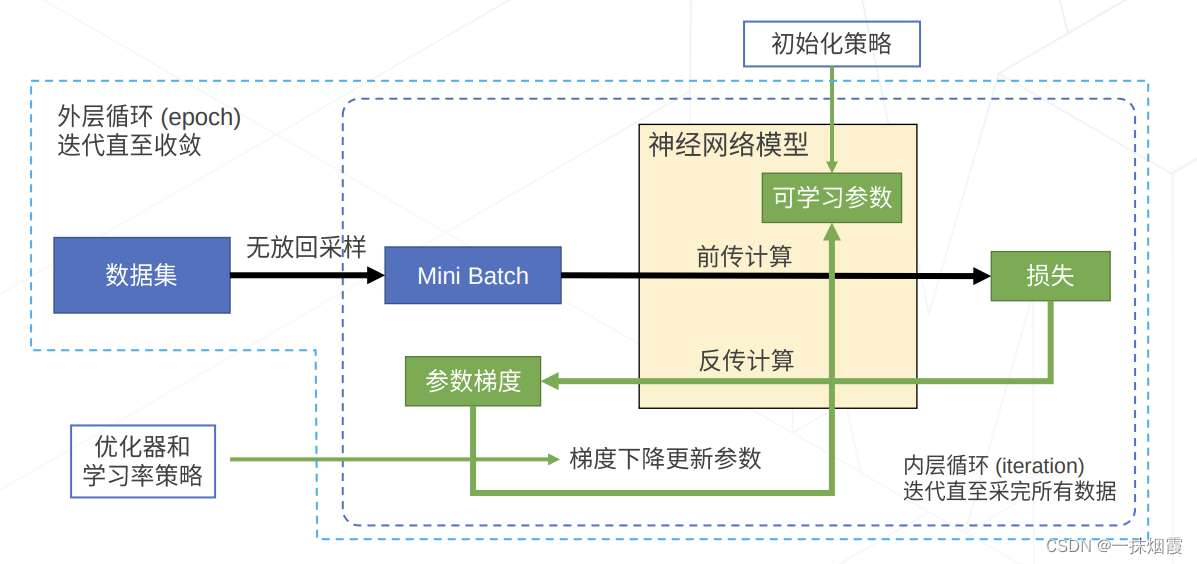

超参数是机器学习模型中控制训练过程的外部参数,它们不直接参与模型的训练,但对模型的性能有重大影响。YOLO模型中的超参数包括:

- **训练步数:**训练模型的迭代次数。

- **学习率:**更新模型权重的步长。

- **正则化系数:**防止模型过拟合的惩罚项。

# 2. YOLO超参数优化理论基础

### 2.1 超参数优化算法

超参数优化算法是用于确定最佳超参数集合的算法。这些算法通常分为三类:

#### 2.1.1 网格搜索

网格搜索是最简单、最直接的超参数优化算法。它通过遍历超参数空间中的所有可能组合来工作。虽然网格搜索可以保证找到最佳超参数,但它对于具有大量超参数的模型来说计算成本很高。

#### 2.1.2 贝叶斯优化

贝叶斯优化是一种基于贝叶斯统计的超参数优化算法。它使用概率模型来估计超参数空间中最佳超参数的分布。贝叶斯优化比网格搜索更有效,因为它可以利用先前的知识来指导搜索。

#### 2.1.3 遗传算法

遗传算法是一种基于进化论的超参数优化算法。它从一组随机超参数开始,并通过选择、交叉和突变等操作来生成新的超参数集合。遗传算法对于具有复杂超参数空间的模型非常有效。

### 2.2 超参数影响因素分析

超参数对YOLO模型的性能有显著影响。影响超参数选择的主要因素包括:

#### 2.2.1 模型结构

YOLO模型的结构决定了其特征提取和预测能力。超参数,如卷积核大小、池化层大小和网络深度,会影响模型的复杂性和准确性。

#### 2.2.2 训练数据

训练数据的大小和质量会影响模型的泛化能力。超参数,如批次大小、学习率和正则化系数,需要根据训练数据的特征进行调整。

#### 2.2.3 优化器

优化器负责更新模型的权重以最小化损失函数。超参数,如优化器类型、学习率和动量,会影响模型的训练速度和收敛性。

**代码块:**

```python

import numpy as np

import tensorflow as tf

# 定义YOLO模型

model = tf.keras.models.Sequential([

tf.keras.layers.Conv2D(32, (3, 3), activation='relu'),

tf.keras.layers.MaxPooling2D((2, 2)),

tf.keras.layers.Conv2D(64, (3, 3), activation='relu'),

tf.keras.layers.MaxPooling2D((2, 2)),

tf.keras.layers.Flatten(),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dense(10,

```

0

0