MATLAB最小二乘法机器学习应用:线性回归与分类模型,赋能数据预测

发布时间: 2024-06-15 20:57:30 阅读量: 97 订阅数: 59

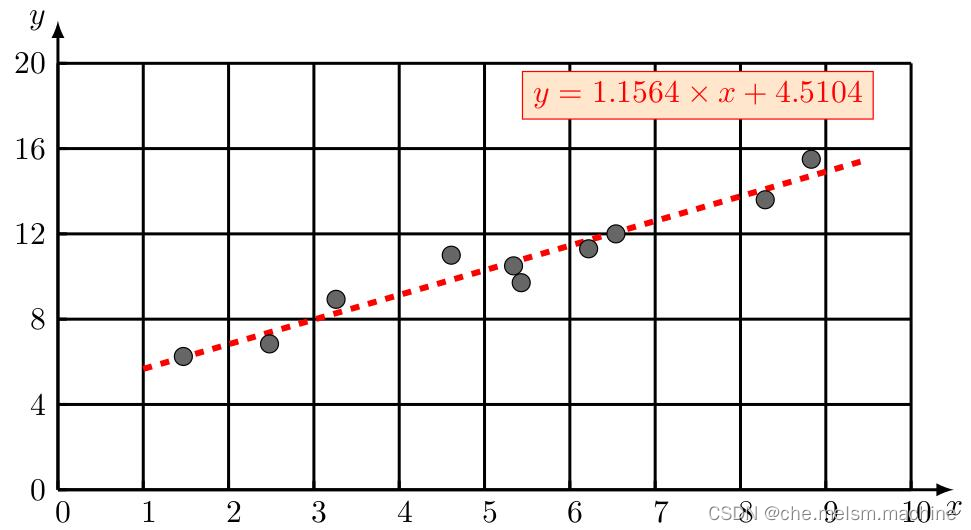

最小二乘法和线性回归

# 1. MATLAB中的最小二乘法**

**1.1 最小二乘法的基本原理**

最小二乘法是一种用于拟合曲线或曲面到一组数据点的技术。其基本原理是找到一条曲线或曲面,使得它与数据点的垂直距离的平方和最小。这种方法可以有效地近似数据中的趋势或模式。

**1.2 MATLAB中最小二乘法的实现**

MATLAB中提供了用于最小二乘法拟合的函数,如polyfit()和fitlm()。这些函数可以根据指定次数的多项式或线性模型拟合数据。例如,以下代码使用polyfit()函数拟合三次多项式到一组数据点:

```matlab

% 数据点

x = [1, 2, 3, 4, 5];

y = [2, 4, 6, 8, 10];

% 拟合三次多项式

p = polyfit(x, y, 3);

% 评估拟合结果

y_fit = polyval(p, x);

```

# 2. 线性回归模型

### 2.1 线性回归模型的数学基础

#### 2.1.1 线性方程组

线性回归模型是一种预测模型,它假设输出变量(因变量)与输入变量(自变量)之间存在线性关系。线性关系可以用线性方程组来表示:

```

y = b0 + b1x1 + b2x2 + ... + bnxn

```

其中:

* `y` 是输出变量

* `x1`, `x2`, ..., `xn` 是输入变量

* `b0`, `b1`, ..., `bn` 是模型参数

#### 2.1.2 最小二乘解

最小二乘法是一种估计线性方程组中参数的方法。它通过最小化残差平方和来找到最优参数:

```

SSE = Σ(yi - ŷi)^2

```

其中:

* `SSE` 是残差平方和

* `yi` 是实际输出

* `ŷi` 是预测输出

最小二乘解可以通过求解正规方程组来获得:

```

(X^T X)b = X^T y

```

其中:

* `X` 是设计矩阵,包含输入变量

* `y` 是输出变量向量

* `b` 是参数向量

### 2.2 MATLAB中线性回归模型的实现

#### 2.2.1 数据预处理

在使用 MATLAB 实现线性回归模型之前,需要对数据进行预处理,包括:

* **缺失值处理:**使用 `ismissing` 函数检测缺失值,并使用 `fillmissing` 函数填充缺失值。

* **数据标准化:**使用 `zscore` 函数将数据标准化,使每个特征的均值为 0,标准差为 1。这有助于提高模型的收敛速度和稳定性。

#### 2.2.2 模型训练和评估

MATLAB 中使用 `fitlm` 函数训练线性回归模型。该函数返回一个 `LinearModel` 对象,其中包含模型参数、拟合度和预测值。

```matlab

% 加载数据

data = load('data.csv');

% 数据预处理

data.x1 = zscore(data.x1);

data.x2 = zscore(data.x2);

% 训练模型

model = fitlm(data, 'y ~ x1 + x2');

% 评估模型

r2 = model.Rsquared.Ordinary;

rmse = sqrt(model.MSE);

```

`r2` 表示模型的决定系数,范围为 0 到 1。`rmse` 表示模型的均方根误差。较高的 `r2` 和较低的 `rmse` 表示模型拟合得更好。

# 3.1 分类模型的数学基础

分类模型旨在根据一组特征将数据点分配到不同的类别。在 MATLAB 中,常用的分类模型包括逻辑回归和支持向量机。

### 3.1.1 逻辑回归

逻辑回归是一种广义线性模型,用于解决二分类问题,即数据点只能属于两个类别。逻辑回归模型将输入特征与输出类别之间的关系建模为一个线性方程,然后使用逻辑函数(例如 sigmoid 函数)将线性方程

0

0