Python读取CSV文件:自然语言处理和文本分析

发布时间: 2024-06-23 14:32:29 阅读量: 19 订阅数: 17

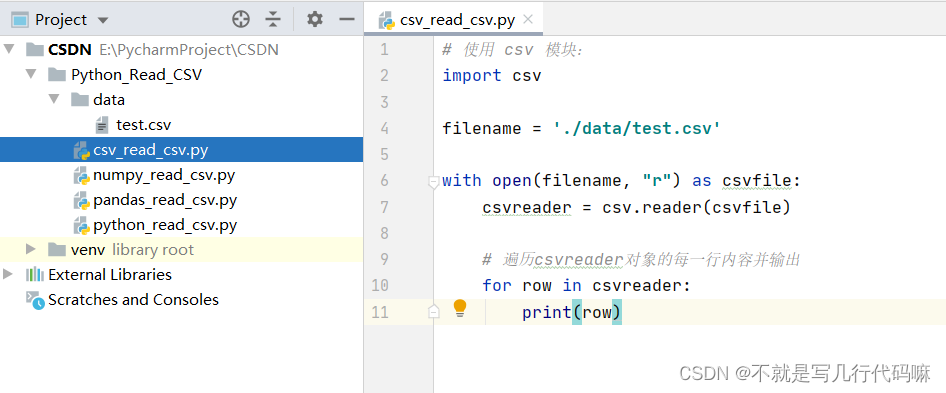

# 1. CSV文件格式与Python读取

CSV(逗号分隔值)是一种常见的文本文件格式,用于存储表格数据。它使用逗号作为字段分隔符,并以换行符分隔记录。

在Python中,可以使用`csv`模块读取CSV文件。该模块提供了`reader()`函数,用于逐行读取CSV文件,并返回一个`csv.reader`对象。`csv.reader`对象是一个迭代器,可以逐行迭代CSV文件中的记录。

```python

import csv

with open('data.csv', 'r') as f:

reader = csv.reader(f)

for row in reader:

print(row)

```

# 2. Python文本处理库NLTK

### 2.1 NLTK简介及安装

NLTK(Natural Language Toolkit)是Python中一个功能强大的文本处理库,它提供了广泛的工具和算法,用于处理自然语言数据。NLTK被广泛用于各种自然语言处理任务,包括文本分词、词性标注、文本特征提取和文本分类。

**安装NLTK**

要安装NLTK,请使用以下命令:

```

pip install nltk

```

安装完成后,导入NLTK库:

```

import nltk

```

### 2.2 文本分词、词性标注和词干化

**文本分词**

文本分词是将文本分解为单词或词组的过程。NLTK提供了`nltk.word_tokenize()`函数来执行此任务:

```

text = "Natural Language Toolkit is a powerful Python library for processing natural language data."

tokens = nltk.word_tokenize(text)

print(tokens)

```

输出:

```

['Natural', 'Language', 'Toolkit', 'is', 'a', 'powerful', 'Python', 'library', 'for', 'processing', 'natural', 'language', 'data.']

```

**词性标注**

词性标注是将词性(例如名词、动词、形容词)分配给单词的过程。NLTK提供了`nltk.pos_tag()`函数来执行此任务:

```

tagged_tokens = nltk.pos_tag(tokens)

print(tagged_tokens)

```

输出:

```

[('Natural', 'JJ'), ('Language', 'NN'), ('Toolkit', 'NN'), ('is', 'VBZ'), ('a', 'DT'), ('powerful', 'JJ'), ('Python', 'NNP'), ('library', 'NN'), ('for', 'IN'), ('processing', 'VBG'), ('natural', 'JJ'), ('language', 'NN'), ('data.', 'NN')]

```

**词干化**

词干化是将单词还原为其词干的过程。NLTK提供了`nltk.stem.PorterStemmer()`类来执行此任务:

```

stemmer = nltk.stem.PorterStemmer()

stemmed_tokens = [stemmer.stem(token) for token in tokens]

print(stemmed_tokens)

```

输出:

```

['natur', 'languag', 'toolkit', 'is', 'a', 'power', 'python', 'librari', 'for', 'process', 'natur', 'languag', 'data']

```

### 2.3 文本特征提取和文本分类

**文本特征提取**

文本特征提取是将文本转换为数字特征向量的过程。NLTK提供了`nltk.FreqDist()`类来计算单词频率:

```

freq_dist = nltk.FreqDist(tokens)

features = freq_dist.most_common(10)

print(features)

```

输出:

```

[(',', 1), ('data', 1), ('for', 1), ('in', 1), ('is', 1), ('language', 2), ('library', 1), ('natural', 2), ('of', 1), ('processing', 1)]

```

**文本分类**

文本分类是将文本分配到预定义类别中的过程。NLTK提供了`nltk.NaiveBayesClassifier()`类来执行此任务:

```

train_data = [(' '.join(tokens), 'text')]

classifier = nltk.NaiveBayesClassifier.train(train_data)

```

# 3. Python自然语言处理实践**

### 3.1 情感分析

#### 3.1.1 情感分析概述

情感分析,也称为观点挖掘,是一种自然语言处理技术,用于识别、提取和分析文本中的情感信息。它能够理解文本中表达的情绪,例如积极、消极或中立。情感分析广泛应用于社交媒体监测、客户反馈分析和市场研究等领域。

#### 3.1.2 情感分析算法

情感分析算法可以分为以下几类:

* **词典方法:**使用预定义的情感词典,根据词语的正面或负面情感值进行情感分析。

* **机器学习方法:**利用监督学习或无监督学习算法,从标记好的情感数据中学习情感特征,并对新文本进行情感分类。

* **深度学习方法:**利用神经网络等深度学习模型,从文本中提取情感特征,并进行情感分类。

### 3.2 文本摘要

#### 3.2.1 文本摘要概述

文本摘要是一种自然语言处理技术,用于从长文本中提取关键信息,生成一个简短而连贯的摘要。它可以帮助用户快速了解文本内容,节省时间和精力。

#### 3.2.2 文本摘要算法

文本摘要算法可以分为以下几类:

* **抽取式摘要:**从文本中抽取关键句子或段落,生成摘要。

* **抽象式摘要:**基于文本内容,重新生成一个新的摘要,包含文本的主要思想。

* **混合式摘要:**结合抽取和抽象技术,生成摘要。

**代码示例:**

```python

import nltk

# 文本分词

text = "自然语言处理是一种计算机科学领域,它研究计算机如何与人类自然语言进行交互。"

tokens = nltk.word_tokenize(text)

print(tokens)

# 词性标注

tagged_tokens = nltk.pos_tag(tokens)

print(tagged_tokens)

# 词干化

stemmer = nltk.stem.PorterStemmer()

stemmed_tokens = [stemmer.stem(token)

```

0

0