【Hadoop生态系统】:小文件处理的5大原因与对策,告别性能陷阱

发布时间: 2024-11-01 03:22:51 阅读量: 30 订阅数: 26

一步一步学习大数据:Hadoop生态系统与场景

# 1. Hadoop生态系统与小文件问题概述

在大数据领域,Hadoop生态系统是处理大规模数据集的工业标准。然而,随着数据量的增长,小文件问题逐渐成为影响Hadoop性能和存储效率的主要障碍。本章将初步探讨Hadoop生态系统如何处理文件数据,并概述小文件问题的复杂性及其对Hadoop性能的潜在影响。

## 1.1 Hadoop生态系统的组成和作用

Hadoop生态系统主要由Hadoop分布式文件系统(HDFS)、MapReduce计算框架以及一系列辅助组件构成。它能够有效地对大量数据进行存储、处理和分析。HDFS保证了高吞吐量的数据访问,是Hadoop高可靠性和伸缩性的关键。

## 1.2 小文件问题及其在Hadoop中的体现

小文件问题通常指的是大量小文件存放在Hadoop上时引起的一系列问题。与大文件相比,小文件会产生过多的元数据,增加NameNode内存消耗,并且因为MapReduce在处理小文件时并行度受限而降低性能。这直接影响了整个大数据平台的处理效率和存储成本。

## 1.3 小文件问题的行业影响

小文件问题不仅仅是技术挑战,它也关系到业务的各个方面,如成本控制、系统优化、数据处理速度等。理解和解决小文件问题,对IT行业的数据分析、存储和管理有着深远的意义。未妥善处理小文件问题,将导致资源浪费,甚至影响到企业的数据决策能力。

# 2. 小文件问题的理论分析

小文件问题是大数据处理中常见且棘手的问题。在本章中,我们将深入分析小文件问题的本质,探讨其产生的原因,以及它们是如何影响Hadoop生态系统性能的。通过理论分析,我们将建立起对小文件问题的全面认识,并为其解决方案奠定基础。

## 2.1 Hadoop存储机制与小文件

### 2.1.1 HDFS的基本工作原理

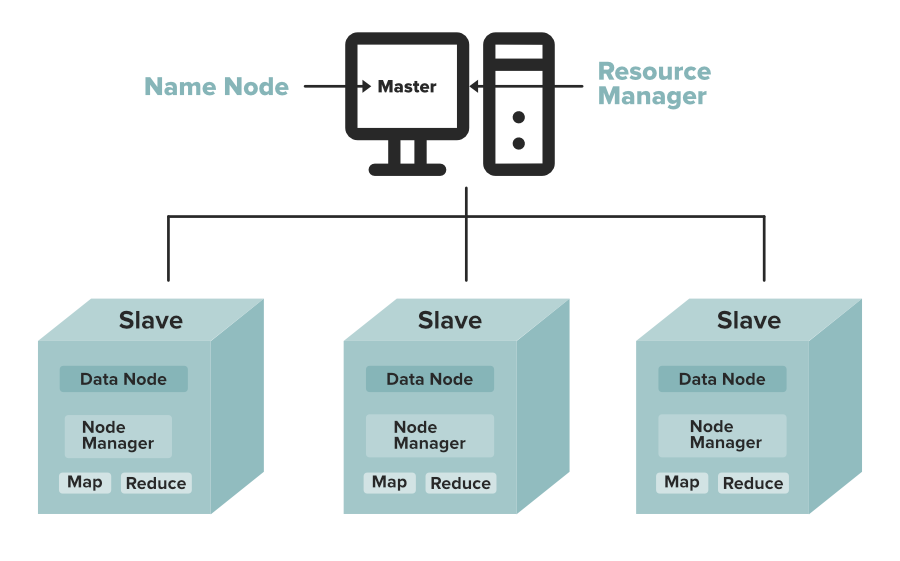

Hadoop分布式文件系统(HDFS)是Hadoop项目的核心组件之一,专为存储大规模数据集而设计。HDFS采用主从(Master/Slave)架构,其中NameNode作为主服务器负责管理文件系统的元数据,而DataNode作为从服务器则负责实际的数据存储。HDFS支持高容错性和可扩展性,并通过将数据分割成块(block)并跨多个DataNode分布式存储来实现。

为了深入了解小文件问题,我们必须先理解HDFS如何处理文件存储:

1. **NameNode的作用**:负责维护文件系统命名空间,记录每个文件中各个块所在的DataNode节点。

2. **DataNode的作用**:存储文件块的实际数据,并响应客户端的读写请求。

HDFS将文件分成固定大小的块,默认为128MB,这些块被独立存储在不同的DataNode上。这种设计允许HDFS有效地处理大型文件和大规模数据集。

### 2.1.2 小文件在HDFS中的存储开销

小文件问题主要源于HDFS的设计,每个文件至少对应于一个块和一个块的元数据。在HDFS中,即使是一个100字节的文件,也需要占用一个完整的128MB块空间。因此,小文件不仅会浪费存储资源,还会增加NameNode的负担。

- **NameNode内存消耗**:NameNode需要为文件系统的每个文件、目录和数据块维护元数据。随着小文件数量的增加,NameNode的内存消耗也会显著上升,这可能导致内存耗尽并影响整个Hadoop集群的稳定性。

- **存储开销增加**:由于每个小文件至少占用一个块的空间,这导致了大量未使用的磁盘空间,也就是存储碎片化。这种碎片化不仅降低了存储效率,还降低了数据读写的性能。

## 2.2 小文件对Hadoop性能的影响

### 2.2.1 NameNode的内存消耗

NameNode是HDFS的中心节点,负责存储文件系统的元数据信息。对于每个文件和目录,NameNode需要维护信息,包括访问权限、修改时间和数据块的列表等。随着小文件数量的增加,NameNode需要处理的元数据量也线性增长,对内存的需求也就随之增加。而NameNode的内存资源是有限的,当内存耗尽时,集群就会面临扩展性问题和潜在的崩溃风险。

### 2.2.2 MapReduce作业的性能瓶颈

MapReduce是Hadoop中处理大规模数据集的核心编程模型。在MapReduce作业执行过程中,NameNode会接收到大量的文件系统操作请求,其中大多数是读取小文件。在小文件情况下,MapReduce作业可能需要同时打开和读取成千上万个文件。这个操作在NameNode上会引起高负载,导致性能瓶颈。

此外,小文件使得MapReduce无法有效地对数据进行分割,影响了任务调度和负载平衡,进而影响了作业的执行效率和总体性能。

## 2.3 小文件产生的原因

### 2.3.1 数据源和采集方式

数据源和采集方式是小文件产生的一个主要原因。例如,从网络日志、传感器设备或客户端生成的数据往往是小文件形式。这些数据通常被实时收集并快速生成,这导致了小文件的产生。

另一个相关因素是数据的粒度。在某些情况下,数据生成过程没有适当地聚合或批处理,而是直接以较小的单位输出。这种即时生成小文件的数据处理方式,使得数据在写入HDFS时就已经是小文件形式。

### 2.3.2 应用程序设计的影响

应用程序的设计也显著影响着文件的大小。如果一个应用程序生成了大量的小文件,那么问题就很容易出现在应用程序本身的设计上。例如:

- **文件处理逻辑不当**:应用程序在处理数据时可能没有足够地聚合数据块,导致频繁创建和关闭文件,从而产生了大量的小文件。

- **不合理的存储策略**:存储策略可能没有针对大数据场景进行优化,例如不恰当地使用文本文件进行数据存储,而没有考虑数据的读写效率和压缩性。

因此,深入理解应用程序的工作机制和数据处理逻辑,是解决小文件问题的关键。

以上章节介绍了小文件问题在Hadoop生态系统中的存储机制和性能影响,并分析了小文件产生的根本原因。本章的详细内容有助于读者对小文件问题有一个全面的理论认识,为后续章节中的实践案例分析和解决方案的实施打下了坚实的基础。接下来的章节将围绕小文件处理的实践案例进行深入探讨,包括合并小文件策略、优化数据输入方式和开发自定义InputFormat等内容。

# 3. 小文件处理的实践案例分析

随着大数据技术的深入应用,小文件问题逐渐成为了阻碍数据处理效率的一大障碍。本章节将深入探讨针对小文件问题采取的实践策略,并分析其在实际案例中的应用和效果。

## 3.1 合并小文件策略

### 3.1.1 文件合并工具的使用

在Hadoop生态系统中,为了减少小文件数量,一个常见的解决方案是使用专门的文件合并工具。这些工具能够在不改变数据内容的前提下,将多个小文件合并为一个或几个较大的文件,从而降低NameNode的内存消耗,并提高MapReduce作业的处理效率。

以Apache Hadoop自带的Hadoop Archive(HAR)为例,这是一种早期的文件合并方法,能够将小文件打包为HAR文件存放到HDFS中。HAR文件在逻辑上表现为一个单独的文件,但在物理上是由多个小文件组成的压缩存档。当需要访问这些文件时,Hadoop会自动解压HAR文件以便读取。

以下是创建HA

0

0