【MapReduce与HDFS交互】:揭秘数据处理的10个高级策略

发布时间: 2024-11-01 03:11:26 阅读量: 35 订阅数: 33

# 1. MapReduce与HDFS的基本概念

## 1.1 分布式计算框架 MapReduce

MapReduce 是一种编程模型,用于处理大规模数据集。它将复杂的处理任务拆分为两个阶段:Map(映射)和Reduce(归约)。在Map阶段,系统会对输入数据进行处理,产生一系列中间键值对(Key-Value pairs)。然后在Reduce阶段,对这些键值对进行汇总处理,输出最终结果。MapReduce的特点在于其容错性、扩展性和对大规模数据集的处理能力。

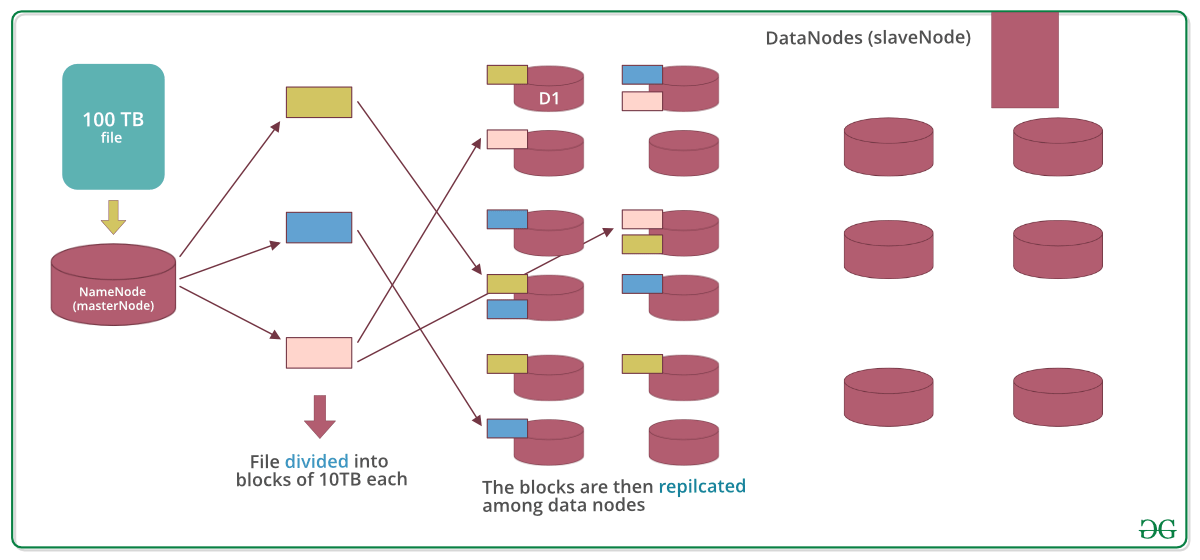

## 1.2 分布式文件系统 HDFS

Hadoop Distributed File System(HDFS)是Hadoop的一个核心组件,专为分布式存储设计。它能够跨多个物理机器存储大量数据,同时保证高吞吐量,使得数据处理更高效。HDFS的设计理念是处理大数据,采用高容错性的方式存储数据。HDFS通过将数据分割成块(block),然后分布存储到集群中的不同节点上,来实现数据的高可靠性。此外,HDFS还支持数据的快速读写,以及数据的自动恢复。

# 2. MapReduce与HDFS的核心交互机制

## 2.1 MapReduce的基本工作原理

### 2.1.1 Map阶段的数据处理流程

MapReduce的Map阶段是一个数据预处理阶段,任务是将输入数据集分割成独立的块,并为每个块创建一个Map任务。Map任务处理输入数据块,并生成一系列键值对(key-value pairs)作为输出。输出的键值对并不是直接写入磁盘,而是存储在内存中的环形缓冲区。

#### Map任务执行逻辑

```java

public class WordCount {

public static class TokenizerMapper

extends Mapper<Object, Text, Text, IntWritable>{

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

...

}

```

在这段代码中,我们定义了`TokenizerMapper`类,它继承自`Mapper`。Map函数接受原始文本行作为输入,使用`StringTokenizer`分割每个行中的单词,并输出每个单词与数值`1`的键值对。这些键值对会被shuffle和排序,准备传递到Reduce阶段。

### 2.1.2 Reduce阶段的数据汇总过程

Reduce阶段接收Map阶段输出的键值对集合,并通过分组(grouping)操作将所有具有相同键的值聚集在一起。然后对这些值执行归约(reduction)操作,如求和、计数或平均等,最终输出汇总后的结果。

#### Reduce任务执行逻辑

```java

public class IntSumReducer

extends Reducer<Text,IntWritable,Text,IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values,

Context context

) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

在此代码段中,`IntSumReducer`类实现了`Reducer`接口。对于每个键,它累加所有的值,然后输出键和最终的累加结果。Reduce任务是MapReduce的核心,负责将数据集汇总为最终的聚合结果。

## 2.2 HDFS的数据存储模型

### 2.2.1 HDFS的基本架构和文件系统特性

Hadoop分布式文件系统(HDFS)是为大规模数据存储而设计的。它由一个主节点(NameNode)和多个数据节点(DataNode)组成。NameNode负责元数据的管理和客户端请求的处理,而DataNode则负责存储实际的数据块。

#### HDFS架构概览

- **NameNode**:它是HDFS的主节点,存储了文件系统的元数据,包括文件目录结构、文件属性以及每个文件的块列表和块的位置信息。

- **DataNode**:在集群中每个节点上运行,负责管理节点上的存储。文件被分割成块(默认128MB),然后存储在多个DataNode上。

- **Secondary NameNode**:它不是NameNode的热备份,而是负责定期合并文件系统的命名空间镜像与编辑日志,以减少NameNode重启时的恢复时间。

### 2.2.2 数据块的分布和副本策略

HDFS中的数据块默认是64MB,是为了在数据丢失时更容易恢复和冗余存储。Hadoop通过复制数据来提高数据的可靠性。默认情况下,每个数据块会有三个副本,一个在NameNode所在节点,两个在其他DataNode节点上。

#### 副本放置策略

副本放置策略尽量满足以下条件:

1. 分散放置:避免把多个副本放在同一个机架上,防止机架失效。

2. 热备份:副本放在运行状况良好的节点。

3. 副本平衡:尽量保持副本均匀分布在所有DataNode上。

## 2.3 MapReduce与HDFS的数据流

### 2.3.1 数据读取和写入的过程

MapReduce与HDFS协同工作,将数据处理流程分为Map和Reduce两个阶段。数据读取和写入的过程涉及到从HDFS读取输入数据,Map阶段处理,然后Reduce阶段汇总结果并写回HDFS。

#### 数据读取流程

1. 客户端初始化MapReduce作业,配置作业的输入输出路径。

2. NameNode提供输入数据块的地址信息。

3. Map任务从DataNode读取数据块,并处理数据生成键值对。

#### 数据写入流程

1. Reduce任务汇总键值对并生成最终结果。

2. Reduce任务写入数据回HDFS。

3. NameNode接收写入请求,安排副本策略。

4. DataNode存储数据块副本。

### 2.3.2 网络传输和数据瓶颈分析

MapReduce与HDFS的交互涉及大量数据在网络中传输,网络带宽和节点间的数据传输效率是性能瓶颈的关键因素。因此,网络传输优化、节点资源调度和数据本地化策略在大数据处理中至关重要。

#### 数据瓶颈分析

- **数据倾斜**:数据分布不均匀导致某些Map或Reduce任务负载过大。

- **网络带宽**:网络带宽限制导致数据传输速度受限。

- **CPU与磁盘I/O**:CPU处理能力和磁盘读写速度可能成为处理瓶颈。

针对这些瓶颈,需要在集群规模、硬件配置、作业调度和数据本地化等多个方面进行优化,以确保数据流的高效运行。

以上内容为第二章的核心,详细介绍了MapReduce的基本工作原理和HDFS的数据存储模型,并对两者之间的数据流进行深入探讨。通过下一章节,将深入了解MapReduce与HDFS的优化策略,以及如何提高大数据处理的效率和性能。

# 3. ```

# 第三章:MapReduce与HDFS的优化策略

## 3.1 MapReduce性能调优

### 3.1.1 任务调度和资源分配优化

MapReduce的性能在很大程度上依赖于任务调度和资源分配的效率。当集群资源充足时,合理地调整MapReduce的任务调度可以显著提高整体性能。在Hadoop中,JobTracker负责资源管理和任务调度。通过优化JobTracker的配置参数,可以实现资源的更合理分配,例如:

- **调整map和reduce任务的并行度**:通过增加`mapreduce.job.maps`和`mapreduce.job.reduces`的值,可以增加任务并行度,但这需要根据集群的实际负载和资源来调整,以避免资源竞争和调度延迟。

- **优化内存设置**:对Map和Reduce任务分配适当的内存,可以防止任务因为内存溢出而失败。使用`mapreduce.map.memory.mb`和`mapreduce.reduce.memory.mb`来分别控制map和reduce任务的内存大小。

### 3.1.2 编程模型的调整和优化

MapReduce编程模型的效率直接影响了数据处理的性能。优化策略包括:

- **减少数据序列化开销**:序列化和反序列化是MapReduce处理过程中的常见操作,选择高效的数据序列化框架,如Avro或Kryo,可以减少序列化的开销。

- **使用Combiner减少数据传输**:Combiner是MapReduce中的可选组件,它可以在Map端对数据进行局部合并,从而减少传输到Reduce端的数据量。

- **优化Map和Reduce任务的逻辑**:减少不必要的数据处理和转换,确保Map函数和Reduce函数的效率。

## 3.2 HDFS存储优化

### 3.2.1 HDFS块大小的选择和调整

HDFS将文件划分为多个块进行存储,并且每个块默认是64MB大小。选择合适的数据块大小对于优化存储效率非常关键。太小的块会导致过多的元数据操作和管理开销,而太大的块可能会导致数据不平衡问题。调整块大小时,需要考虑数据的特点和集群的规模:

- **小文件问题**:对于小文件,可以考虑使用`Hadoop Archive`功能将小文件打包存储,以减少NameNode的内存使用。

- **大数据块**:对于大文件,增大块大小可以提高读写效率,但需要注意不要超过物理存储的块大小限制。

### 3.2.2 读写性能的优化技巧

优化HDFS的读写性能可以通过以下几种方式:

- **使用合适的副本策略**:副本数的设置直接影响数据的可靠性和读写性能。通过`dfs.replication`配置项可以设置副本数。在数据可靠性要求不高的情况下,可以适当减少副本数以节省存储空间和提高写性能。

- **调整缓冲区大小**:通过`dfs.block.size`可以调整HDFS的缓冲区大小,增加缓冲区大小可以提高连续读写性能。

- **合理使用机架感知**:开启HDFS的机架感知功能(`dfs.hosts ihtiya`),可以让HDFS在存储数据时考虑到数据节点的物理位置,从而提高网络读写的效率。

## 3.3 综合优化案例分析

### 3.3.1 大数据处理场景下的优化实例

在处理大数据场景时,优化策略需要综合考虑数据处理流程中的各个环节。一个典型的优化实例是:

- **数据预处理优化**:在Map阶段,进行数据清洗和预处理,以减少Reduce阶段的数据量,从而降低计算压力。

- **使用Map-Side Join优化关联操作**:当需要进行大数据表和小数据表的关联操作时,可以将小表完全加载到每个Map任务的内存中,然后在Map端完成关联,避免了在Reduce阶段进行大规模数据的Shuffle操作。

### 3.3.2 实际应用中的性能监控与故障排除

在实际应用中,性能监控和故障排除是优化过程的重要环节。通过监控工具(如Nagios、Ganglia等)实时监控集群的状态,对作业执行的时间和资源消耗进行跟踪。在出现性能瓶颈或故障时,可以使用以下方法进行排查:

- **日志分析**:分析Hadoop和MapReduce的日志文件,寻找错误信息或警告,以定位问题。

- **资源使用情况分析**:使用`YARN ResourceManager`界面,查看资源的使用情况和任务的执行状态。

- **网络和硬件检查**:检查网络连接和硬件性能,确保数据传输和处理没有因硬件问题受到限制。

优化是一个持续的过程,需要根据实际的业务需求和数据处理情况,不断地调整和改进策略。通过以上策略的应用,可以在不同的层面提高MapReduce与HDFS的工作效率和性能。

```

# 4. MapReduce与HDFS的高级应用

## 4.1 多数据源整合处理

在大数据环境下,整合来自不同数据源的数据以进行分析是一项常见的挑战。这不仅涉及到数据格式和结构的统一,还包括处理速度和数据质量的保证。MapReduce与HDFS在这方面提供了强大的支持。

### 4.1.1 海量数据源的高效读取技术

为了高效地从HDFS读取海量数据源,首先需要关注数据的存储格式。在Hadoop生态系统中,Avro、Parquet和ORC等列式存储格式因其高压缩比和高效读写性能而受到青睐。

```java

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path inputPath = new Path("hdfs://path/to/large/dataset");

SequenceFile.Reader reader = new SequenceFile.Reader(fs, inputPath, conf);

Text key = new Text();

AvroKey avroKey = new AvroKey();

AvroValue avroValue = new AvroValue();

while (reader.next(key, avroValue.getRecord())) {

// 处理读取到的数据

}

reader.close();

```

代码块展示了如何使用SequenceFile.Reader从HDFS读取数据。这里使用了Avro序列化框架,它允许高效地序列化和反序列化数据。

### 4.1.2 数据清洗和预处理的策略

数据清洗和预处理是数据整合过程中不可或缺的环节。MapReduce提供了数据去重、格式化和异常值处理的能力。

```java

public static class DataCleanMapper extends Mapper<LongWritable, Text, Text, NullWritable> {

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 解析输入数据,执行数据清洗和预处理逻辑

String cleanedData = preprocess(value.toString());

context.write(new Text(cleanedData), NullWritable.get());

}

}

public static String preprocess(String input) {

// 格式化和数据清洗逻辑

return input;

}

```

在上述代码中,一个自定义的Mapper类用于对数据进行预处理,诸如去除空白字符、校验格式等。之后,这些清洗过的数据可以被进一步用于MapReduce的下一步处理。

## 4.2 实时数据处理与分析

随着数据处理需求的演进,实时性变得越来越重要。MapReduce和HDFS在实时处理方面虽然不如某些特定的流式处理框架(如Apache Storm、Apache Flink等),但通过合理设计可以实现准实时数据处理。

### 4.2.1 流式处理框架的集成与对比

虽然MapReduce是批处理模型,但可以与Apache Kafka或Apache Flume集成,实现数据的实时摄入和处理。通过使用Apache Samza或Apache Apex这样的框架,可以在Hadoop生态系统内构建准实时处理的管道。

### 4.2.2 实时数据分析的架构设计

架构设计时需要考虑到数据的实时性和准确性。以下是一个典型的数据分析架构设计示例,结合了Kafka、Zookeeper、HDFS和MapReduce:

```mermaid

graph LR

A[数据源] -->|实时数据| B(Kafka)

B -->|数据流| C(MapReduce)

C -->|批处理结果| D(HDFS)

D -->|分析结果| E(展示层)

```

在上述架构中,Kafka用作消息队列系统,接收实时数据流;MapReduce结合Kafka进行批处理,生成结果存储于HDFS;最后,分析结果提供给用户界面展示。

## 4.3 大规模图数据处理

图计算是处理社交网络、推荐系统等大规模数据集的有力工具。MapReduce与HDFS能够结合图处理框架,比如Apache Giraph或GraphX,进行复杂的图算法计算。

### 4.3.1 图处理框架与MapReduce的结合

Apache Giraph利用MapReduce模型实现图的分布式处理。它将图分割成多个子图,每个子图由一个Map任务处理,然后通过Reduce操作聚合结果。

### 4.3.2 大型社交网络数据处理实例

以社交网络中的好友推荐为例,可以使用PageRank算法来评估用户的重要性,并据此推荐潜在的好友。

```java

public static class RankComputerVertexProgram extends VertexProgram<LongWritable, DoubleWritable, DoubleWritable, DoubleWritable, DoubleWritable> {

// PageRank核心算法实现

}

```

在上述代码片段中,`RankComputerVertexProgram`类负责执行PageRank算法。每个VertexProgram实例处理图中的一个顶点,并通过迭代计算顶点的重要性。

以上,我们逐步深入地探讨了MapReduce与HDFS在多数据源整合处理、实时数据处理分析,以及大规模图数据处理等高级应用。每一部分都涉及了实际应用中的技术细节和实施策略,以帮助读者更好地理解和运用这些技术。

# 5. MapReduce与HDFS的未来趋势

## 5.1 新一代大数据处理技术

### 5.1.1 分布式计算框架的演进

随着数据量的指数级增长,分布式计算框架也在不断地演进以满足日益增长的处理需求。Apache Hadoop仍然是大数据生态系统的核心,但围绕Hadoop的其他分布式计算框架也在不断发展,比如Apache Spark、Apache Flink和Dask等。这些框架在处理速度、易用性和处理能力上各有优势。

Apache Spark以其内存计算的优势,大幅度提升了数据处理速度,特别适合于需要快速迭代和实时数据处理的应用。而Apache Flink则专注于流处理,并提供了一套非常灵活的窗口操作,适合于复杂的事件驱动型应用。Dask则侧重于扩展Python的数据科学工作流。

### 5.1.2 新技术对比分析

对于选择哪种技术,需要根据具体的应用场景和需求来进行权衡。以下为三种技术的一些对比点:

- **处理速度**: Spark在内存计算方面通常比Hadoop MapReduce快,但与Flink相比,在实时处理方面可能稍逊一筹。Dask在单机多核处理能力上表现优异,但在分布式处理速度上不如Spark和Flink。

- **容错机制**: Spark采用RDD(弹性分布式数据集)来实现容错,而Flink则使用精确一次的处理语义。Dask基于Python的懒加载特性,可以实现部分容错。

- **易用性**: Spark和Flink都提供了一系列高层次的API,其中Spark的MLlib和GraphX,以及Flink的SQL和机器学习库,都极大地简化了算法的实现。Dask则通过其与Pandas和Scikit-learn的兼容性,使得Python用户可以轻松上手。

- **生态支持**: Hadoop生态系统中的工具(如Hive、HBase等)与Spark和HDFS的集成更为紧密。Flink和Dask也在逐步增加对其他大数据工具的支持。

## 5.2 实践中的挑战与机遇

### 5.2.1 大数据人才技能需求分析

随着大数据技术的不断进步,企业对于大数据人才的需求也日益增长。企业不仅需要具有扎实的编程基础和大数据处理技能的开发人员,还需要了解数据管理和分析、熟悉数据建模和机器学习算法的数据科学家。具体技能需求如下:

- **编程语言**: Java、Python、Scala等

- **大数据处理框架**: Hadoop, Spark, Flink等

- **数据存储解决方案**: NoSQL数据库、数据仓库

- **数据分析和可视化**: SQL、R、Tableau等

- **机器学习和人工智能**: MLlib、TensorFlow等

此外,大数据人才还需要具备一定的业务理解和跨团队协作的能力。

### 5.2.2 企业级应用案例和经验分享

在企业级应用中,大数据技术被用于各种场景,例如:

- **客户行为分析**: 分析用户行为数据,为个性化营销提供支持。

- **供应链优化**: 通过实时数据分析优化库存管理和物流流程。

- **风险管理**: 对金融数据进行实时监控和分析,识别潜在的风险点。

- **健康医疗**: 结合医疗数据和机器学习算法,用于疾病预测和治疗方案优化。

每个案例都需要根据实际需求进行技术选择和架构设计。例如,对于实时性要求较高的场景,可能会选择Flink或Spark Streaming等流处理框架。

## 5.3 探索下一代HDFS

### 5.3.1 HDFS的未来发展方向

HDFS作为Hadoop生态系统的核心组件,其未来发展将更加注重与云原生技术的融合。HDFS将提供更为灵活的存储选项,如支持多租户、数据压缩和数据加密等功能,以满足企业对于数据安全和合规性的需求。同时,HDFS也会加强对数据动态分配和卸载的支持,优化资源利用效率。

### 5.3.2 基于HDFS的新技术生态

HDFS的新技术生态包括但不限于以下几个方面:

- **数据湖**: 将HDFS作为数据湖的底层存储,通过Lake Formation和Amazon Athena等工具,实现对结构化和非结构化数据的高效管理和查询。

- **大数据工作流管理**: 利用如Apache Airflow、Apache NiFi等工具来管理HDFS上的数据处理流程,实现自动化和可视化。

- **数据集成**: 采用如Apache Kafka、Flume等系统进行实时数据集成,结合HDFS强大的批处理能力,提供全面的数据处理方案。

通过不断演进和扩展,HDFS正在成为企业构建和管理大数据解决方案的基石。

0

0