大数据框架中的MapReduce排序:对比分析与应用策略

发布时间: 2024-11-01 11:15:33 阅读量: 19 订阅数: 16

# 1. MapReduce排序的理论基础

MapReduce是处理大数据的关键技术之一,其排序功能在数据处理过程中占据着核心地位。排序不仅是数据组织的基础,也是很多大数据分析的先决条件。理解MapReduce排序的理论基础是掌握其实际应用的关键。本章将深入浅出地探讨排序的理论,涵盖排序的定义、重要性以及在MapReduce框架中的位置。

## 1.1 排序的定义和重要性

排序(Sorting)是将一组数据按照特定的顺序进行排列的过程。在计算机科学中,排序是基础算法之一,对于数据处理和分析有着不可或缺的作用。良好的排序可以提高数据检索效率、优化存储空间并为其他算法(如搜索算法)提供基础支持。

## 1.2 MapReduce框架中的排序角色

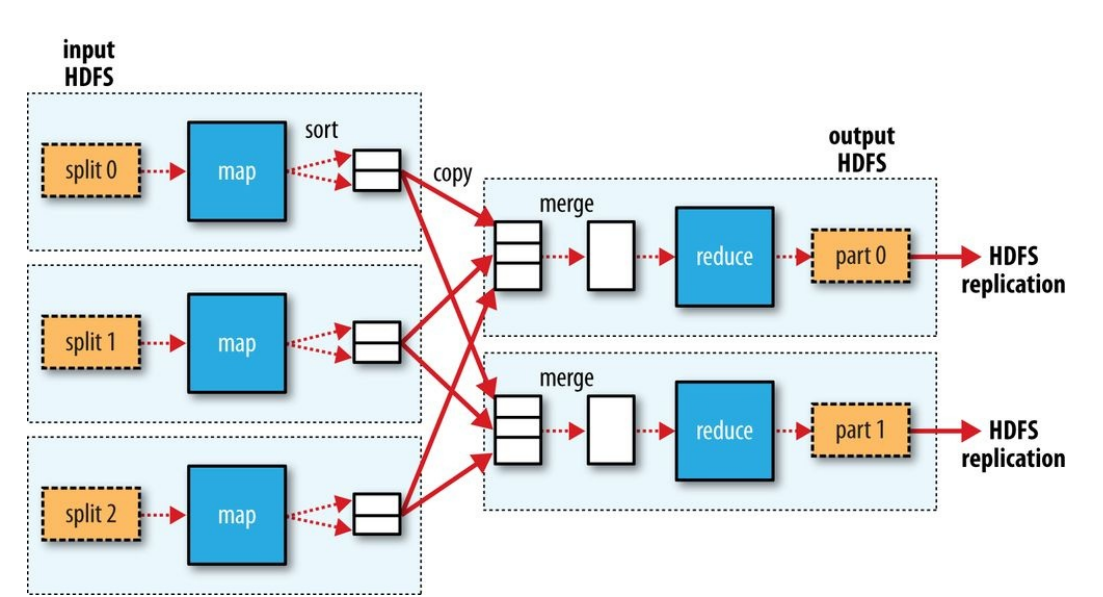

在MapReduce框架中,排序是一个关键步骤,主要在Map阶段和Reduce阶段之间执行,保证了数据的有效组织。Map阶段输出的中间数据会通过排序进行预处理,以便于Reduce阶段能够高效地进行数据聚合和处理。

## 1.3 排序与MapReduce工作流程的关系

MapReduce工作流程中的排序与传统排序算法有所不同。在MapReduce中,排序不仅关注数据的有序性,还需考虑数据分布、处理效率和可扩展性。排序机制的设计须充分利用并行处理和分布式存储的优势,以实现高效的大规模数据排序。下一章我们将深入探讨MapReduce排序技术的实现机制。

# 2. MapReduce排序技术的实现机制

## 2.1 MapReduce排序的内部工作原理

MapReduce是一个广泛使用的并行处理框架,排序是其处理过程中的一项基础且核心的功能。深入了解其排序机制,有助于开发者更好地优化MapReduce作业的性能。

### 2.1.1 Map阶段的排序过程

Map阶段的排序过程是数据在被传输到Reduce阶段之前的初步整理。每个Map任务负责处理输入数据的一块切片,并在输出键值对时进行局部排序。具体来说,Map任务在输出时会根据键对数据进行排序。这一过程通常是通过维护一个内存中的排序树来实现的。

```java

// Java伪代码展示Map阶段的排序过程

for (KeyValue pair : input) {

emitIntermediate(pair.getKey(), pair.getValue());

}

```

在执行过程中,Map任务会在内存中建立一个优先队列(或者红黑树结构),将输出的键值对暂时存储在其中,并在达到一定数量后进行排序,然后批量写入磁盘。这个过程确保了Map阶段的输出数据已经是局部有序的,有助于后续的排序合并操作。

### 2.1.2 Reduce阶段的排序过程

Reduce阶段负责接收来自所有Map任务的数据并进行全局排序。这一阶段,Map输出的中间数据需要经过Shuffle过程,然后到达Reduce任务。Shuffle过程包含数据的排序和分区操作,确保具有相同键的数据传输到同一个Reduce任务。

```python

# Python伪代码展示Reduce阶段的排序过程

for key, values in shuffled_data:

reduce_function(key, values)

```

当Reduce任务接收到数据后,它首先会进行归并排序(merge sort)操作,将来自不同Map任务的数据合并在一起,并根据键的顺序进行排序。之后,Reduce函数会对这些有序的键值对进行处理,并输出最终结果。

## 2.2 MapReduce的关键排序算法

### 2.2.1 排序算法概述

MapReduce框架使用的排序算法通常基于外部排序,因为处理的数据量通常超出单个节点的内存容量。外部排序涉及到将数据分割成小块并分别排序,最后合并这些已排序的小块。

### 2.2.2 常用排序算法的比较和选择

在MapReduce框架中,常见的排序算法包括快速排序、归并排序和堆排序。这些算法在不同场景下的性能有所不同,因此选择合适的排序算法至关重要。

```mermaid

graph TD

A[开始] --> B[快速排序]

A --> C[归并排序]

A --> D[堆排序]

B --> E[单机内存排序]

C --> F[跨多个Map任务排序]

D --> G[优先队列排序]

```

快速排序是最快的排序算法之一,但其在最坏情况下的性能是O(n^2)。归并排序在稳定性方面表现良好,并且易于并行处理。堆排序适合处理实时数据流,且在最大堆构建之后,插入操作的时间复杂度为O(log n)。

## 2.3 MapReduce排序过程中的性能优化

### 2.3.1 影响排序性能的因素分析

影响MapReduce排序性能的因素很多,包括数据的分布、Map和Reduce任务的数量、网络带宽以及磁盘I/O。为了优化排序性能,开发者需要对这些因素进行综合考虑。

### 2.3.2 排序性能优化策略

优化策略包括但不限于调整Map和Reduce任务的数量、合理规划数据分区、使用高效的序列化方式以及优化Shuffle过程。此外,合理使用Combiner可以在Map端减少数据传输量,提高排序效率。

```mermaid

graph LR

A[优化策略] --> B[调整任务数量]

A --> C[规划数据分区]

A --> D[优化序列化]

A --> E[优化Shuffle过程]

```

开发者可以在Map任务中实现Combiner组件,它会在输出键值对时对数据进行局部合并,从而减少写入磁盘的数据量和网络传输的数据量。通过这种方式,Combiner可以显著提高MapReduce作业的整体性能。

# 3. MapReduce排序的实践应用

在讨论了MapReduce排序的理论基础和实现机制之后,本章节将深入探讨MapReduce排序在实际应用中的案例分析、扩展应用以及在数据处理中的关键作用。通过具体案例来展现排序技术如何解决现实世界中的问题,以及如何通过实践优化排序过程,使其更加高效。

## 3.1 实际案例分析

### 3.1.1 大数据集上的排序实践

在处理大规模数据集时,MapReduce排序技术显得尤为关键。例如,在日志分析、文本挖掘等领域,经常需要对海量数据进行排序,以便于后续的处理与分析。

假设我们有一个网页日志数据集,需要对用户访问的页面进行排序,以便分析访问最频繁的页面。通过MapReduce可以轻松实现这一点。首先,Mapper会读取日志文件并提取出每个页面访问的URL,然后将其作为key输出。Reducer随后将相同的URL合并,计算出每个URL的访问次数。

**示例代码:**

```java

public static class URLCountMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text url = new Text();

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 从日志中提取URL

url.set(getURLFromLog(value.toString()));

context.write(url, one);

}

}

public static class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

// 对相同URL的访问次数求和

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

在这个案例中,Mapper处理输入的文本数据,从中提取URL,并输出(网页URL, 1)的键值对。Reducer将相同键值的计数合并,最终输出每个URL及其访问次数。

### 3.1.2 业务场景下的排序应用

除了数据分析,MapReduce排序技术在业务场景中也非常有用。例如,在电子商务平台上,可能需要根据用户的购买记录对产品进行排序,或者根据产品的评分和销量对产品列表进行排序。

具体到实现,可以设计MapReduce作业来处理用户购买历史和产品评价数据。Mapper读取购买记录和评价,提取出产品的ID和评分信息,并输出(产品ID, 评分)的键值对。Reducer收集所有同一产品的评分,并计算平均评分,最后输出排序后的结果。

**示例代码:**

```java

public static class ProductRatingMapper extends Mapper<LongWritable, Text, Text, FloatWritable> {

private Text productId = new Text();

private FloatWritable rating = new FloatWritable();

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 解析购买记录或产品评分信息

String[] fields = value.toString().split(",");

String id = fields[0];

float r = Float.parseFloat(fields[1]);

productId.set(

```

0

0