【R语言数据库交互】:data.table包与数据库的无缝对接技术

发布时间: 2024-11-03 03:57:07 阅读量: 23 订阅数: 34

LabVIEW与数据库的链接可用.pdf

# 1. R语言与数据库交互概述

在当今的信息化时代,数据分析与处理能力已经成为企业和研究机构的核心竞争力之一。R语言作为一种强大的统计分析工具,被广泛应用于数据科学领域。它不仅能够提供高级的数据分析功能,还能够与数据库进行交互,为数据分析和挖掘提供了极大的便利。通过R语言与数据库的交互,我们可以轻松实现数据的导入、查询、操作和导出等操作,极大提高了工作效率。

R语言与数据库交互的基本原理是使用特定的接口或者驱动,将R语言环境与数据库环境连接起来,从而利用SQL等数据库查询语言或者R语言自带的数据处理函数来操作数据库中的数据。这种交互方式使得R语言不仅仅局限于单机的数据处理,而是扩展到了更加复杂和大规模的数据应用场景中。接下来的章节将详细探讨如何使用R语言中的data.table包来实现与数据库的高效交互。

# 2. ```

# 第二章:data.table包基础知识

data.table是R语言中一个强大的数据处理包,它以高度优化的方式提供了数据表的读取、处理和写入功能。这个章节将详细探讨data.table包的基础知识,包括如何安装与加载包、理解data.table的数据结构、以及data.table的高级特性。

## 2.1 data.table包的安装与加载

在R语言中,data.table包能够大大提升数据处理的效率,特别是在处理大规模数据集时。接下来,我们将逐一介绍安装与加载data.table包的方法。

### 2.1.1 安装data.table包的方法

安装data.table包需要首先确保你拥有一个更新的R版本,然后通过以下R命令进行安装:

```R

install.packages("data.table")

```

这个命令将会从CRAN镜像中下载并安装data.table包及其依赖。CRAN是一个由R项目维护的包库,它保证了用户能获取到最新稳定版本的软件包。

### 2.1.2 加载data.table包的步骤

安装完毕后,我们需要在R会话中加载data.table包才能开始使用它:

```R

library(data.table)

```

上述命令使得data.table包在当前的R会话中可用。一旦data.table包被加载,你就可以使用它的函数来处理数据了。

## 2.2 data.table的数据结构

data.table包中的核心概念是data.table对象,它是一种用于存储和操作数据的高效表格结构。

### 2.2.1 data.table对象的特点

data.table对象是data.frame的扩展,它包含一系列列(变量)和行(观察值)。与data.frame相比,data.table的主要特点包括:

- **内存效率**:data.table通常比data.frame内存占用少,因为它使用了特殊的内存管理和数据存储机制。

- **快速的数据操作**:data.table优化了数据操作,如子集选择、合并和聚合等操作的效率,特别适合处理大型数据集。

- **语法简洁**:data.table的语法更加简洁,减少了重复和错误。

### 2.2.2 data.table对象的操作和转换

data.table对象的操作和data.frame类似,但也有它特有的操作方法。例如,创建一个data.table对象和读取数据的基本方式:

```R

# 创建data.table对象

dt <- data.table(A = 1:3, B = letters[1:3])

# 读取CSV文件到data.table

dt <- fread("path_to_your_file.csv")

```

`fread`函数是data.table包中的快速读取函数,它能快速读取大型数据文件。在上例中,我们通过路径`path_to_your_file.csv`读取了一个CSV文件,并将其存储到了一个data.table对象`dt`中。

## 2.3 data.table的高级特性

data.table包还提供了一些高级特性,以支持复杂的数据操作和分析任务。

### 2.3.1 高速键值对操作

data.table可以利用“键”(key)来进行高速的数据操作。当一个列被指定为键时,data.table会建立一个索引,这使得在数据的分组和排序操作中速度显著提升。

```R

# 设置键值

setkey(dt, A)

# 使用键值进行操作

result <- dt[J(2)]

```

### 2.3.2 data.table的分组与聚合

data.table的分组和聚合功能允许用户轻松地对数据进行统计分析。使用`by`参数可以执行分组操作,而聚合则可以通过`sum`, `mean`, `length`等函数实现。

```R

# 分组并计算每组的平均值

result <- dt[, .(mean_A = mean(A)), by = B]

```

以上代码按照B列的值对data.table对象`dt`进行了分组,并计算了每个组中A列的平均值。通过这种方式,用户可以快速进行复杂的数据分析任务。

通过以上内容,我们已经对data.table包的基础知识有了初步的了解。在接下来的章节中,我们将深入探讨data.table包如何与数据库进行交互,以及在实际应用中的高级技巧和实践案例。

```

# 3. data.table包与数据库的基础交互

随着数据量的增长,将data.table包与数据库结合使用成为了数据分析的一个重要方面。这一章我们聚焦于基础交互,探索如何使用data.table包连接数据库,执行查询,以及高效地进行数据导入导出。

## 3.1 使用data.table连接数据库

在许多应用场景中,需要从数据库中提取数据进行分析。data.table包通过ODBC驱动程序提供与数据库连接的能力,从而支持多种数据库系统。

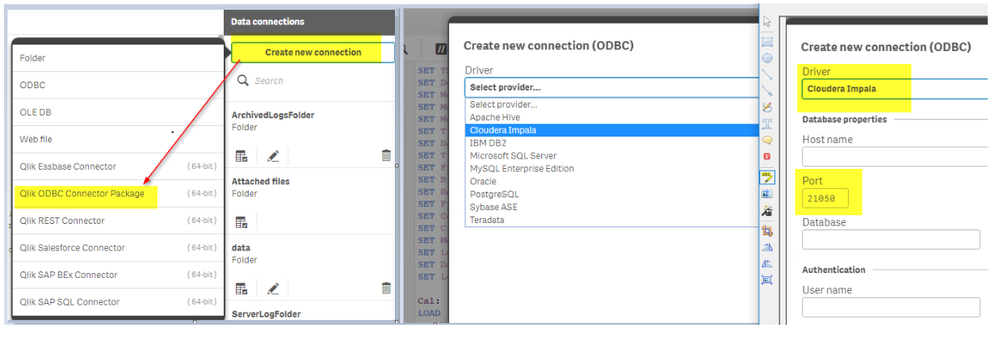

### 3.1.1 ODBC与data.table的配置

**通用步骤:**

1. 安装并配置ODBC驱动程序。

2. 确认数据源名称(DSN)的设置。

3. 使用`dbConnect`函数连接到数据库。

**具体操作:**

```R

# 安装ODBC包

install.packages("odbc")

# 加载odbc包

library(odbc)

# 连接到数据库

con <- dbConnect(odbc::odbc(), . . .)

```

在以上代码块中,使用了R语言的odbc包来创建连接。参数`. . .`需要根据实际使用的数据库类型填写相应的连接细节,如DSN、用户名、密码等。

### 3.1.2 数据库驱动的选择与安装

**选择合适的ODBC驱动:**

- 首先,需要根据所使用的数据库类型选择对应的ODBC驱动。

- 例如,对于MySQL数据库,可以使用MySQL ODBC驱动程序。

- 对于PostgreSQL数据库,则需使用PostgreSQL ODBC驱动。

**安装驱动:**

- 通常,驱动程序可以从相应的数据库官方网站或第三方提供者处获取。

- 安装驱动程序后,还需在操作系统中配置ODBC数据源,以便`dbConnect`能够识别和连接到数据库。

## 3.2 data.table包的数据库查询

一旦建立了数据库连接,就可以使用data.table包执行查询,并且在R语言环境中分析数据。

### 3.2.1 SQL语句与data.table的转换

**SQL到data.table的转换规则:**

- SELECT -> data.tab

0

0