【HDFS NameNode高可用性扩展性分析】:如何应对大规模数据挑战

发布时间: 2024-10-28 16:52:38 阅读量: 27 订阅数: 30

# 1. HDFS NameNode概述与挑战

Hadoop分布式文件系统(HDFS)是大数据生态系统中的核心组件之一,而NameNode则是HDFS的心脏。在本章中,我们将深入探讨NameNode的基本概念,以及它在处理大规模数据时所面临的挑战。

## NameNode的核心角色

HDFS是一个高度容错的系统,设计用于在商业硬件上运行。NameNode负责管理文件系统命名空间和客户端对文件的访问。它维护着文件系统的元数据,包括目录结构、文件属性以及每个文件的块列表。DataNode则负责存储实际的数据块,并执行数据的创建、删除和复制等操作。

## 面临的主要挑战

随着数据量的增长,NameNode的内存成为了系统扩展的瓶颈。所有的文件系统元数据都存储在NameNode的内存中,这意味着随着存储数据量的增加,NameNode可能会耗尽内存资源。此外,NameNode单点故障(Single Point of Failure, SPOF)也是另一个重大挑战,任何NameNode的故障都可能导致整个集群不可用。因此,设计高可用性和扩展性解决方案来应对这些挑战是至关重要的。

# 2. NameNode的故障转移机制

### 故障检测与自动切换过程

在Hadoop分布式文件系统(HDFS)中,NameNode扮演着至关重要的角色,它负责管理文件系统的命名空间以及客户端对文件的访问。由于其单点特性,HDFS的稳定性和可靠性很大程度上取决于NameNode的健康状态。因此,故障转移机制的引入至关重要。

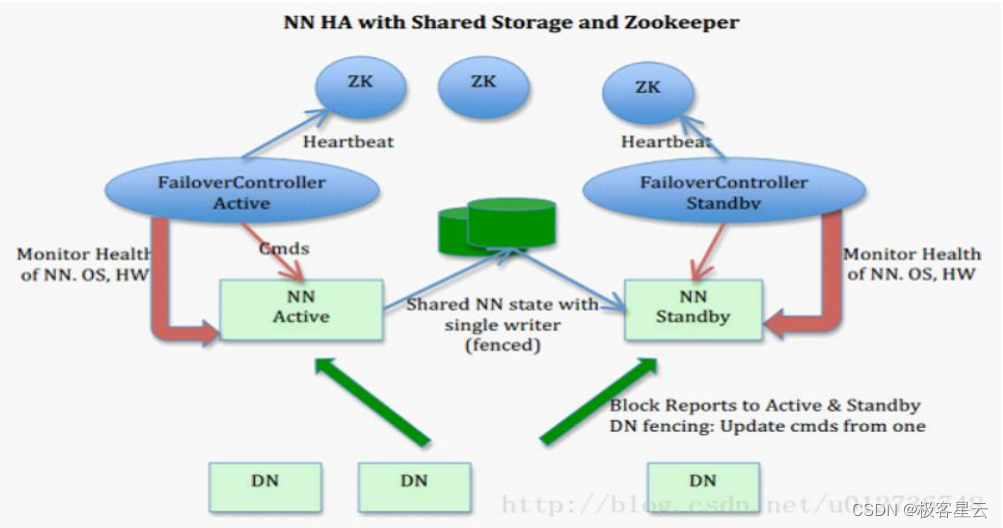

故障检测是自动切换过程中的首要步骤。Hadoop采用双NameNode的高可用性(HA)配置来确保系统的可靠性。每个NameNode都运行在独立的主机上,它们通过一组共享存储设备(如NFS或Zookeeper)来共享编辑日志。这样,即使一台NameNode宕机,另一台也能够接管其工作,保证了系统的连续性。

具体故障转移过程如下:

1. **主备切换**: 当主NameNode故障时,系统会自动将备NameNode提升为新的主NameNode。

2. **Zookeeper的使用**: Zookeeper提供一个高效协调服务,用于在NameNode宕机时进行故障切换决策。

3. **状态同步**: 在新的主NameNode被选举出来后,它会与共享存储设备同步状态,以恢复到故障前的最新状态。

4. **客户端重定向**: 系统还需要将所有客户端请求重定向到新的主NameNode,以继续正常的服务。

```mermaid

graph LR

A[NameNode 故障] -->|自动检测| B[启动故障转移]

B --> C[Zookeeper触发主备切换]

C --> D[新主NameNode同步状态]

D --> E[客户端重定向]

```

故障转移过程中的关键在于确保零数据丢失和最小的服务中断。因此,故障转移的自动化程度和速度对于系统的可靠性至关重要。

### 高可用性模式下的数据一致性保证

高可用性(HA)模式下,确保数据的一致性是极其重要的。为了在切换过程中保持数据的一致性,Hadoop采取了以下策略:

1. **数据共享**: 使用共享存储系统,如Quorum Journal Manager(QJM),来确保所有对文件系统的修改都被记录并可以在多个NameNode间共享。

2. **状态备份**: 主NameNode上所有修改操作都被实时复制到备NameNode,保证数据不会因为主NameNode的故障而丢失。

3. **写操作同步**: 所有的写操作必须在主NameNode和备NameNode上同步完成,这通常通过两阶段提交(2PC)协议来实现。

4. **检查点机制**: 定期创建文件系统的检查点,以确保在故障转移发生后,备NameNode能够快速接管并恢复到稳定状态。

尽管采取了这些措施,但在极端情况下,如主备NameNode同时崩溃,仍存在数据丢失的风险。因此,需要综合考虑备份、恢复策略以及运维管理,以最大限度减少这种风险。

```mermaid

flowchart LR

A[客户端写请求] -->|2PC协议| B[主NameNode处理]

B -->|实时复制| C[备NameNode处理]

C -->|检查点创建| D[状态备份]

D -->|故障转移| E[备NameNode提升为主NameNode]

E --> F[恢复到稳定状态]

```

通过上述机制,HDFS能够在主NameNode故障时,迅速完成故障转移,并尽可能地保持数据一致性。这为Hadoop集群提供了强大的高可用性保证,大大降低了因NameNode故障而导致服务中断的风险。

# 3. HDFS NameNode扩展性策略

## 3.1 Hadoop联邦集群技术

### 3.1.1 联邦集群的基本原理

Hadoop联邦集群技术是HDFS NameNode扩展性的关键技术之一,它允许在同一个Hadoop集群中部署多个NameNode,每个NameNode管理一组独立的命名空间。这种技术的出现,打破了传统Hadoop集群对单点NameNode的依赖,大幅提高了系统的扩展性和容灾能力。

在联邦集群模型中,各个NameNode之间是平等的,它们共享同一个物理集群的资源,但管理不同的文件系统的命名空间。每个NameNode都能够处理客户端的请求,实现负载均衡。而且,当一个NameNode出现故障时,其他NameNode不受影响,依然能够维持集群的正常运行,从而提高了整个系统的可用性。

为了实现联邦集群,Hadoop引入了元数据目录服务(ZooKeeper)来协调各个NameNode的活动,确保文件系统的命名空间一致性。ZooKeeper作为一个分布式协调服务,能够提供配置管理、命名服务、同步服务等功能,是联邦集群架构中不可或缺的组件。

### 3.1.2 联邦集群的配置与实施

配置联邦集群涉及到Hadoop配置文件的修改、ZooKeeper的安装与配置以及NameNode的初始化。具体步骤如下:

1. 首先,安装并配置ZooKeeper集群,确保集群的高可用性和一致性。

2. 接着,修改Hadoop配置文件`hdfs-site.xml`,添加相关的联邦集群配置参数,如启用联邦集群的开关、指定元数据目录服务的地址等。

3. 然后,对每个NameNode实例进行初始化,创建对应的命名空间。

4. 最后,启动Hadoop集群,检查联邦集群是否能够正常工作。

```xml

<configuration>

<property>

<name>dfs.ha.federation.enabled</name>

<value>true</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>***${hadoop.tmp.dir}/dfs/name</value>

</property>

<!-- 添加ZooKeeper相关配置 -->

<property>

<name>ha.zookeeper.quorum</name>

<value>zk-node1:2181,zk-node2:2181,zk-node3:2181</value>

</property>

</configuration>

```

在部署联邦集群时,务必确保各个组件之间的网络通信畅通无阻,同时注意监控集群的状态,及时处理可能出现的异常情况。

## 3.2 NameNode水平扩展方案

### 3.2.1 水平扩展的理论基础

水平扩展(Scale-out)是指通过增加系统资源(如服务器数量)来提高系统处理能力的方法。在HDFS NameNode的场景中,水平扩展旨在解决单点故障和扩展限制的问题。理论上,通过增加NameNode的数量,可以将原本由单个节点处理的元数据分散到多个节点上处理,从而提升整个集群的处理能力和容错能力。

NameNode水平扩展的关键在于如何

0

0