【Hadoop NameNode高可用性监控与告警设置】:确保系统稳定运行的关键手段

发布时间: 2024-10-28 16:28:05 阅读量: 5 订阅数: 14

# 1. Hadoop NameNode简介及其重要性

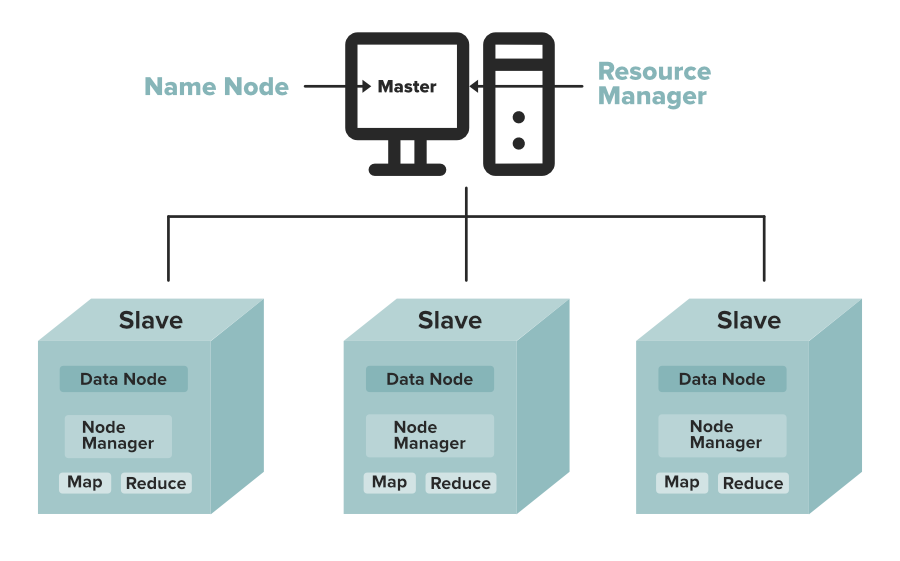

## 1.1 Hadoop NameNode的作用与核心职责

Hadoop NameNode是Hadoop分布式文件系统(HDFS)中负责管理文件系统命名空间的主要组件。它记录着文件系统树及整个HDFS中所有的文件和目录。这些信息以两种形式存储:在内存中保存文件系统的元数据结构,以及在磁盘上存储元数据映像和操作日志。

## 1.2 NameNode在大数据处理中的地位

随着大数据时代的到来,Hadoop作为一个优秀的存储与分析框架,其NameNode模块显得尤为重要。它不仅是数据存储管理的核心,而且对于保证数据的可靠性和高可用性也起着至关重要的作用。

## 1.3 NameNode的故障对集群的影响

由于NameNode掌握着整个HDFS的元数据信息,一旦NameNode出现故障,整个Hadoop集群将无法正常工作。因此,确保NameNode的稳定运行和高可用性是维护Hadoop集群的关键。在接下来的章节中,我们将深入探讨NameNode高可用性架构,以及如何在实践中优化监控与告警设置。

# 2. Hadoop NameNode高可用性架构理论

### 2.1 Hadoop NameNode的工作原理

#### NameNode的角色和功能

在Hadoop分布式文件系统(HDFS)中,NameNode承担着至关重要的角色。它是中心服务器,主要负责管理文件系统的命名空间和客户端对文件的访问。具体来说,NameNode执行以下主要功能:

- **元数据管理**:NameNode存储了整个HDFS的文件系统的元数据,包括文件和目录的信息、每个文件的数据块信息和位置信息。

- **命名空间操作**:客户端通过与NameNode交互来创建、删除和重命名文件和目录。

- **访问控制**:NameNode负责处理HDFS的访问权限控制,确保只有授权的用户才能进行读写操作。

NameNode在运行时维护着内存中的文件系统命名空间和磁盘上的持久化信息,这些信息记录了文件数据块到DataNode的映射关系。这样,当客户端请求读取或写入数据时,NameNode可以迅速定位到相应的数据块所在的DataNode。

#### 元数据管理与数据块映射

Hadoop采用数据块(block)的概念来优化存储和管理大数据集。默认情况下,HDFS将文件分割成一系列64MB的块,并将这些数据块分布存储在多个DataNode上。NameNode维护了一个映射表,记录着每个文件对应的每个数据块在哪个DataNode上以及数据块的校验和信息。

这种映射机制是HDFS的高效数据访问的关键。当客户端需要读取或写入数据时,NameNode会提供必要的数据块位置信息,这样数据可以直接在DataNode之间传输,绕过NameNode,减少了中心节点的压力。

### 2.2 高可用性架构的设计原理

#### 传统NameNode架构的问题

传统的Hadoop NameNode架构存在单点故障的问题。当NameNode发生故障时,整个HDFS就变得不可用,因为没有任何组件能够接管NameNode的职责。为了解决这一问题,Hadoop社区提出了高可用性架构的设计。

#### 高可用性架构的设计目标和优势

高可用性(HA)架构的设计目标是确保NameNode的故障不会导致整个Hadoop集群服务的中断。为此,需要一个或多个备用NameNode(Standby NameNodes)能够在主NameNode发生故障时迅速接管其职责。高可用性架构的优势包括:

- **服务的持续可用性**:在高可用性配置下,当主NameNode发生故障时,备用NameNode可以立即接管,极大地减少了服务中断的时间。

- **数据的可靠性**:通过配置多个DataNode副本,可以进一步提高数据的可靠性,确保即使部分节点失败,数据也不会丢失。

- **负载均衡**:在某些高可用性方案中,可以实现NameNode的负载均衡,分散客户端的请求到不同的NameNode,从而提高整体集群的处理能力。

### 2.3 常见的高可用性解决方案

#### Quorum Journal Manager (QJM)

Quorum Journal Manager (QJM) 是Hadoop 2.0中引入的一种高可用性解决方案。它通过一组独立的节点(称为JournalNodes)来实现元数据的共享存储。QJM在主NameNode和备用NameNode之间共享编辑日志(edit logs),使得在主节点发生故障时备用节点能够接管。

- **工作原理**:在QJM中,编辑日志会同时写入所有的JournalNodes,任何一个NameNode要想成为活跃状态,必须拥有大多数JournalNodes上的最新编辑日志。这样,在故障转移时,备用节点可以读取最新的编辑日志并应用,从而保证命名空间的一致性。

- **优势**:QJM方法简单有效,它为高可用性架构提供了一种可靠的元数据共享机制。

#### 自动故障转移机制

自动故障转移机制是实现NameNode高可用性的关键组成部分,它确保在主NameNode故障时,备用NameNode能够无缝接管服务。

- **工作原理**:此机制监视主NameNode的状态。如果检测到主NameNode失效,系统会自动触发故障转移过程,备用节点将变为新的主节点,而之前的主节点(如果重新恢复可用)则转变为备用节点。

- **实施细节**:该过程涉及到配置ZooKeeper集群来协调故障转移过程,确保故障转移过程中的操作一致性。ZooKeeper集群为故障转移提供了分布式锁和状态同步机制,以防止脑裂现象的发生。

整个高可用性架构的搭建涉及许多复杂的配置和步骤,接下来我们将详细探讨搭建高可用NameNode集群的具体步骤。

# 3. 搭建高可用NameNode集群的步骤

在构建一个高可用的Hadoop NameNode集群之前,理解其背后的架构和理论是至关重要的。一旦理论基础牢固,我们就可以开始搭建高可用NameNode集群的实践步骤。本章节将详细指导您完成搭建过程,包括环境准备、配置要点、集群部署以及启动与验证步骤。

#

0

0