迁移学习在语音识别中的应用:现状、挑战与2大创新技术

发布时间: 2024-09-06 06:25:12 阅读量: 156 订阅数: 66

基于深度学习的语音识别技术现状与展望_戴礼荣.pdf

# 1. 迁移学习与语音识别基础

## 1.1 语音识别技术简介

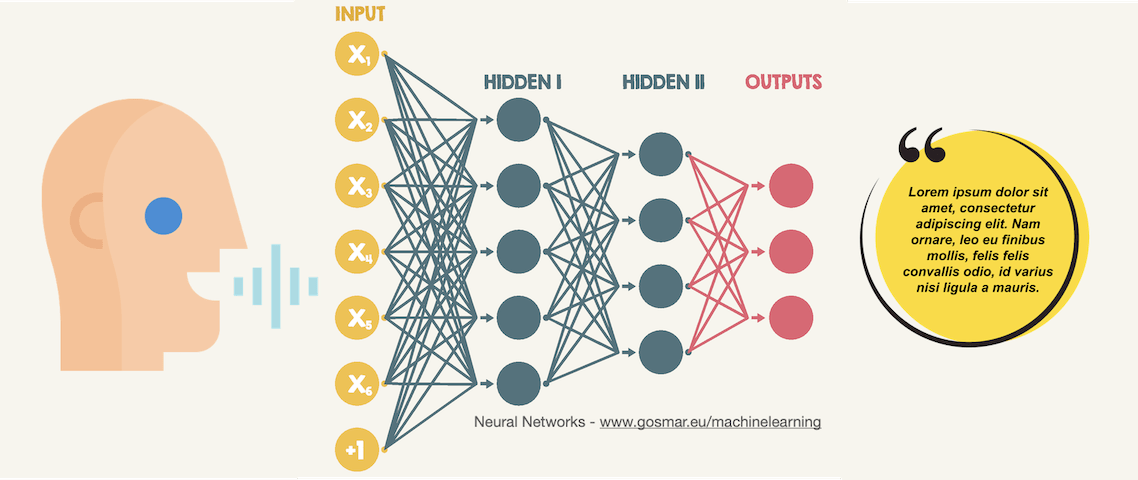

语音识别是让计算机理解人类语言,并将口头语言转化为文本的过程。近年来,随着AI技术的迅猛发展,语音识别技术已经应用于众多场景,如智能家居、自动驾驶、语音助手等,深刻改变了我们的生活和工作方式。

## 1.2 迁移学习与语音识别的关联

迁移学习是一种机器学习方法,它利用一个问题的数据来帮助解决另一个相关问题。在语音识别领域,迁移学习可以减少数据需求量,提升模型的准确性和泛化能力。通过迁移学习,语音识别系统可以更好地适应不同的语言环境和用户需求。

## 1.3 本章总结

本章介绍了语音识别的基本概念,以及迁移学习与语音识别结合的基本原理和优势,为后续章节中深入探讨迁移学习在语音识别中的理论基础和实践应用奠定基础。

# 2. ```

# 第二章:迁移学习在语音识别中的理论基础

## 2.1 迁移学习概述

### 2.1.1 迁移学习定义与核心思想

迁移学习是一种机器学习方法,它利用一个领域(源领域)中学习到的知识来解决另一个不同但相关领域(目标任务)中的问题。核心思想在于解决新问题时,我们可以重用之前已经解决类似问题所获得的经验和知识,而不是从零开始训练模型。

在语音识别领域,迁移学习可以帮助我们利用一个语言或者环境的数据来改进另一个语言或环境下的模型性能。这在数据稀缺的语言或任务中尤为重要。

### 2.1.2 迁移学习的主要类型

迁移学习主要分为三种类型:

- **实例迁移.Instance-based Transfer**:通过选择和重用源领域中的数据样本到目标任务中。

- **特征迁移.Feature-based Transfer**:通过识别和使用源领域和目标任务间的共享特征表示。

- **模型迁移.Model-based Transfer**:通过迁移预训练模型的参数到目标任务。

对于语音识别而言,模型迁移是目前最为常见的方法,如使用预训练的深度神经网络模型来提取特征或者作为微调的起点。

## 2.2 语音识别技术概览

### 2.2.1 语音识别的基本原理

语音识别是将人的语音信号转换成相应的文本或命令的过程。基本原理包括声学模型(负责声学信号的处理)和语言模型(负责语言的语法、语义分析)。

声学模型关注如何将语音波形转换为音素或其他声学单元的概率模型。典型的声学模型包括隐马尔可夫模型(HMM)和深度神经网络(DNN)。

语言模型则着重于语言规则的统计分析,例如n-gram模型或者基于循环神经网络(RNN)的模型。这两部分的结合使得语音识别系统能够更准确地理解和识别人类的语音。

### 2.2.2 语音识别系统的构成要素

一个完整的语音识别系统通常包括以下要素:

- **声音输入**:使用麦克风或其他录音设备捕捉语音信号。

- **预处理**:通过滤波、回声消除等手段处理语音信号。

- **特征提取**:将声音信号转换为可供机器学习算法处理的特征,如MFCC、FBank等。

- **声学模型**:预测输入信号中的音素序列。

- **语言模型**:评估音素序列的语言概率,以确定最符合语言习惯的输出。

- **解码器**:综合声学模型和语言模型的输出,进行最终的识别决策。

- **后处理**:如语义理解、命令执行等。

## 2.3 迁移学习与语音识别的结合

### 2.3.1 迁移学习在语音识别中的作用

在语音识别中,迁移学习可以用于以下场景:

- **数据增强**:通过将预训练模型作为特征提取器,来增强小规模数据集。

- **参数初始化**:使用预训练模型的参数初始化目标任务的新模型,加速收敛并防止过拟合。

- **微调和适应**:在目标任务上对预训练模型进行微调,提升特定任务的识别性能。

### 2.3.2 应用迁移学习的先决条件和优势

使用迁移学习时,需要考虑以下先决条件:

- **相关性**:源任务和目标任务需要有足够相关性,以确保迁移的有效性。

- **域适应**:应对源域和目标任务的差异进行域适应,以减少域偏差问题。

- **数据量和质量**:源域需拥有大量、高质量的数据以进行有效的预训练。

迁移学习的优势包括:

- **减少了对大量标注数据的依赖**:特别是在目标域数据稀缺的情况下。

- **加快模型收敛速度,提升性能**:尤其对于复杂模型,有效利用预训练的参数可以节省训练时间,同时提升识别准确度。

- **提高了模型的泛化能力**:预训练模型往往能够在不同任务间迁移有用的知识,增强模型对新场景的适应性。

通过上述方法,迁移学习显著提升了语音识别技术的效率和准确性,并且推动了该领域向更广泛的应用发展。

```

# 3. 迁移学习在语音识别中的实践案例

## 3.1 传统迁移学习方法的应用

### 3.1.1 特征提取与共享网络结构

在语音识别领域,传统的迁移学习方法主要集中在特征提取和共享网络结构的设计上。这些方法通过先在大规模数据集上预训练深度神经网络模型来提取通用特征,然后将这些特征应用到特定任务中。例如,一个预训练的卷积神经网络(CNN)可以用于提取音频信号的频谱特征,这些特征随后可以用于下游任务,如语音命令识别或说话人识别。

传统迁移学习的一个典型架构是利用一个称为自动编码器的网络结构,它可以学习数据的有效表示,同时保持数据的重要特征。在语音识别中,自动编码器可以被训练来学习语音信号的内在表示,然后这些特征可以被用于训练一个分类器来识别不同的语音命令。

### 3.1.2 预训练模型在语音识别中的应用

预训练模型在语音识别中的应用是迁移学习的一个重要方面。预训练模型,如VGG或ResNet,最初是为了图像识别任务设计的,但它们也被证明在提取音频信号的特征方面非常有效。通过在大型数据集上预训练这些模型,然后在特定的语音识别任务上进行微调,可以显著提高模型的性能。

例如,一个用于图像识别的预训练模型可以通过保留卷积层并替换顶层分类器为语音识别任务量身定做的分类器来适应。这样,预训练模型的卷积层可以作为特征提取器使用,保留了模型在处理复杂模式识别任务时的强大学习能力。

```python

import torch

import torch.nn as nn

import torchvision.models as models

# 加载预训练的ResNet模型

resnet_model = models.resnet50(pretrained=True)

# 冻结模型的前几层参数,保持其不变,仅微调顶层

for param in resnet_model.parameters():

param.requires_grad = False

# 修改顶层为适合语音识别任务的分类器

resnet_model.fc = nn.Linear(resnet_model.fc.in_features, num_classes)

```

在上述代码块中,我们使用PyTorch加载了一个预训练的ResNet-50模型,并将除了最后的分类层之外的所有层参数设置为不可训练。然后我们替换了最后一层,使其适应特定数量的输出类别,这可能对应于语音识别任务中的不同命令或词汇。

## 3.2 深度迁移学习方法的突破

### 3.2.1 端到端的迁移学习方法

随着深度学习的发展,端到端的迁移学习方法已经成为语音识别领域的一个突破点。这些方法涉及利用深度神经网络直接从输入音频到输出识别结果的映射。这些模型通常包括一个编码器,用于将音频信号转换为中间表示,以及一个解码

0

0