【MapReduce编程优化】:Map端和Reduce端的极致性能调整

发布时间: 2024-10-30 12:56:13 阅读量: 38 订阅数: 50

# 1. MapReduce编程模型概述

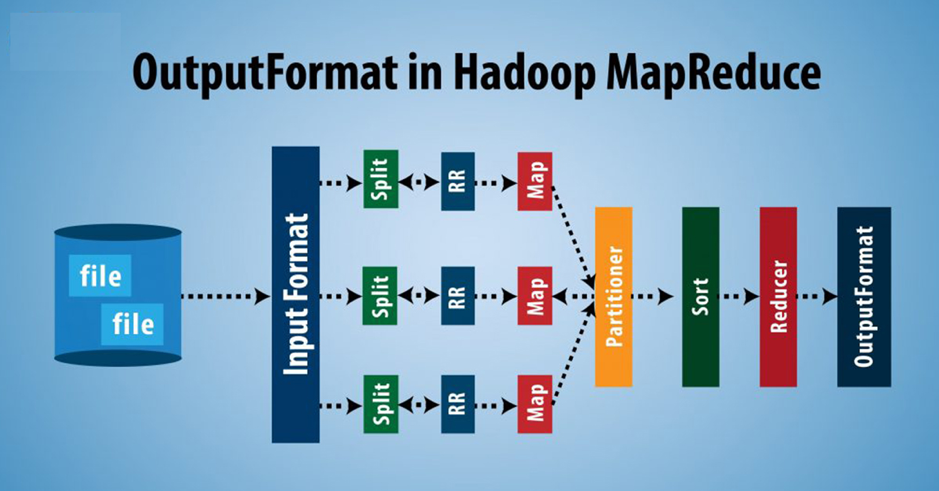

MapReduce是一种分布式计算模型,旨在简化大规模数据集的并行运算。该模型最早由Google提出,后被Apache Hadoop框架采用并普及。它主要包含两个阶段:Map(映射)和Reduce(归约)。在Map阶段,输入数据被切分成独立的块并并行处理。Map函数处理这些块,生成键值对形式的中间结果。在Reduce阶段,这些中间结果经过排序和合并,然后由Reduce函数进行汇总处理,最终得到结果。

MapReduce的优点在于其可扩展性和容错性。可扩展性意味着它能够处理近乎无限量的数据,只需增加更多计算节点。容错性则是通过数据的复制和任务重执行机制来实现的,即使个别节点失败,也不会影响整个作业的完成。对于IT行业的从业者而言,理解MapReduce模型是处理大数据的关键能力之一。

# 2. Map端性能优化策略

## 2.1 输入数据优化

### 2.1.1 数据输入格式的选择与调整

在MapReduce作业中,输入数据格式的选择对任务的执行效率有着重要影响。通常情况下,MapReduce任务会处理大量的数据集,因此,选择一种高效的数据输入格式至关重要。

选择数据输入格式时需要考虑的因素包括:

- 数据的序列化与反序列化效率。

- 是否支持随机访问。

- 是否支持数据压缩,压缩方式是否高效。

Hadoop自带了几种常见的数据输入格式,例如:

- **TextFile**:是默认的输入格式,适用于一般文本数据。它以行为单位存储文本数据,并可进行简单的压缩。

- **SequenceFile**:适用于二进制格式的数据,支持数据压缩,并能够实现记录级别的随机访问。它特别适合需要频繁读取数据的MapReduce作业。

- **RCFile(Record Columnar File)**:一种列式存储格式,数据以列的形式存储,可以显著提高某些类型的查询操作性能。

除了使用Hadoop自带的输入格式外,还可以自定义输入格式来满足特定需求。例如,如果输入数据具有特定的分隔符,可以创建一个继承自`FileInputFormat`的子类,并重写`getRecordReader()`方法以使用自定义的`RecordReader`。

### 2.1.2 输入数据的压缩技术

数据压缩可以减少磁盘I/O操作,降低网络传输的数据量,从而提高MapReduce作业的执行效率。

在Hadoop中,可以对输入数据进行压缩,然后在Map任务中自动解压。常用的压缩格式有:

- **Gzip**:广泛使用的压缩方法,压缩率较高,但压缩和解压速度较慢。

- **Bzip2**:压缩率比Gzip更高,但压缩和解压速度更慢。

- **LZO**:压缩速度非常快,解压速度也非常快,适用于对性能要求较高的场景。

使用数据压缩时需要注意,虽然它能提高性能,但也带来了CPU的额外开销。因此,应根据具体情况选择合适的压缩算法,综合考虑数据的大小、I/O性能和CPU计算能力。可以通过测试来决定最适合的压缩算法。

## 2.2 Map任务并行度调整

### 2.2.1 自动与手动调整Map任务数

Map任务的并行度直接影响到整个作业的执行效率。Hadoop提供了一个参数`mapreduce.job.maps`来手动设置Map任务数,但这需要用户有较好的预估能力。

为了简化操作,Hadoop 1.0引入了`mapreduce.input.fileinputformat.split.maxsize`参数,Hadoop 2.0及之后的版本中引入了基于输入数据集大小和`mapreduce.job.maps`参数的自动任务并行度调整机制。通过这种方式,系统能够根据输入数据集的大小自动决定Map任务的数量。

但是,自动任务并行度调整也有其局限性。某些情况下,自动调整得到的Map任务数量可能不是最优的。这时,需要手动干预,例如,通过`mapreduce.job.maps`手动指定Map任务的数量来优化性能。

### 2.2.2 Map任务内存管理优化

Map任务的内存管理对于性能至关重要。在Hadoop中,Map任务的内存管理主要涉及到以下几个参数:

- `mapreduce.map.java.opts`:设置Map任务JVM堆的最大内存限制。

- `mapreduce.map.memory.mb`:设置Map任务的物理内存大小。

合理配置这些参数可以有效减少内存溢出的几率,提高Map任务的执行效率。通常情况下,Map任务的内存设置要比Reduce任务少,因为Map任务处理的数据量可能非常大。

优化Map任务内存配置的基本策略是:

1. 分析Map任务的内存使用情况,确保JVM有足够的内存空间来处理输入数据。

2. 根据Map任务的执行历史和资源使用情况,调整`mapreduce.map.java.opts`的值,尽量避免内存溢出。

3. 如果Map任务经常出现内存溢出,考虑增加Map任务的内存限制,但同时要注意整个集群的资源利用率。

## 2.3 Map阶段的缓存策略

### 2.3.1 缓存数据的使用场景

Map阶段的缓存策略可以使得某些需要频繁访问的数据集常驻内存,提高数据访问效率。

缓存数据的使用场景主要包括:

- 数据集较小但被频繁访问,例如查找表或小规模数据集。

- 短时间内访问频率极高的数据集,如临时热点数据。

- 需要预加载到内存中进行快速查找的辅助数据集。

### 2.3.2 缓存数据的实现方法

在Hadoop MapReduce中,可以通过配置文件来指定哪些文件需要缓存到每个任务节点上。具体操作如下:

首先,在MapReduce的驱动程序中添加配置项,如下所示:

```java

Job job = Job.getInstance(conf, "My MapReduce Job");

FileCacheTokenConfigurer.setCacheFiles(job.getConfiguration(), new Path[] {

new Path("/path/to/cache/file1"),

new Path("/path/to/cache/file2")

});

```

这里`/path/to/cache/file1`和`/path/to/cache/file2`是需要缓存到各个任务节点上的文件路径。MapReduce作业运行时,这些文件会被自动复制到各个任务执行节点的本地文件系统中,并在任务执行前加载到内存中。

使用缓存策略时需要注意,它会占用任务节点的存储空间和内存资源,因此要根据实际的集群资源情况和作业需求来合理选择缓存文件。此外,缓存的文件会随着作业的结束而自动删除,

0

0