【MapReduce负载均衡】:掌握数据分片策略,平衡任务负载

发布时间: 2024-10-30 12:22:30 阅读量: 27 订阅数: 36

基于MapReduce的分布式云计算数据挖掘方法.pdf

# 1. MapReduce负载均衡概述

MapReduce作为大数据处理领域的一个核心框架,它允许开发者在分布式的环境中处理和生成大数据集。一个有效的负载均衡机制对于提高MapReduce作业的执行效率至关重要。它确保了集群资源得到高效利用,防止资源浪费和过载。在本章中,我们将首先介绍MapReduce负载均衡的基本概念,解释其在数据处理流程中的作用,并讨论其重要性。通过本章的学习,读者将对MapReduce负载均衡有一个全面的认识,为深入探讨其实现和优化策略打下坚实基础。

# 2. MapReduce负载均衡的理论基础

## 2.1 MapReduce框架的工作原理

### 2.1.1 MapReduce的处理流程

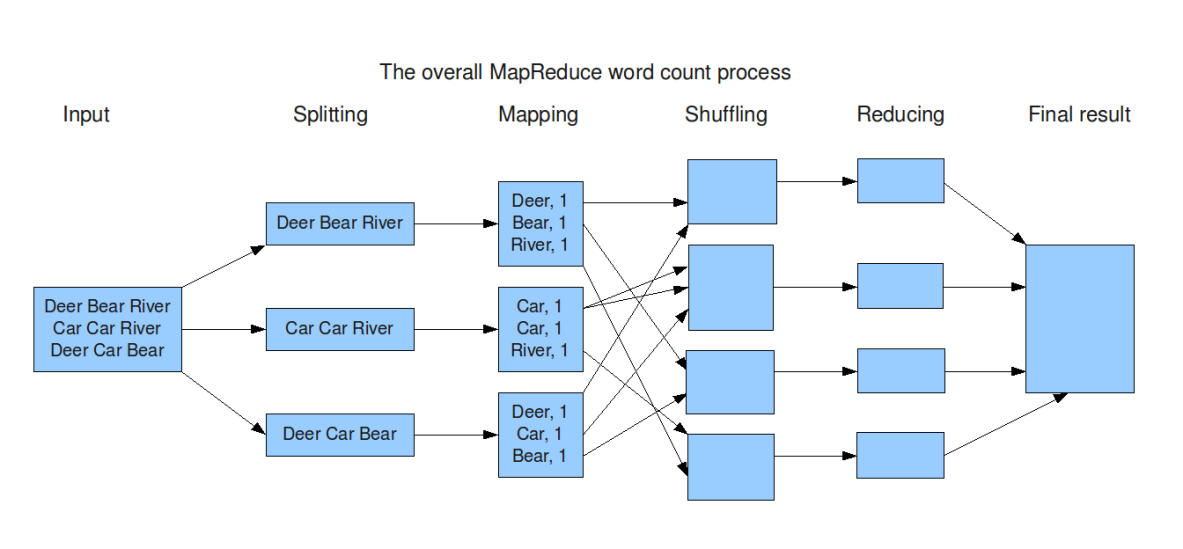

MapReduce是一种分布式计算模型,它利用大量廉价的商用机器组成集群,通过简单而强大的编程模型,处理和生成大数据集。MapReduce处理流程包含两个关键阶段:Map阶段和Reduce阶段。

Map阶段是将输入数据分解成一系列独立的小块,然后以键值对的形式进行处理。Map任务并行地在不同的数据块上执行,每个Map任务处理数据块中的数据,并生成中间键值对。

Reduce阶段则是将所有的中间键值对分组,使得相同键的所有值聚集在一起,供Reduce函数处理。Reduce任务遍历所有中间数据,执行合并操作,并输出最终结果。

```mermaid

graph LR

A[开始] --> B[数据分片]

B --> C[Map任务并行处理]

C --> D[中间数据排序]

D --> E[Reduce任务合并]

E --> F[输出结果]

F --> G[结束]

```

### 2.1.2 数据分片和映射机制

MapReduce的数据分片和映射机制确保了数据可以在多个Map任务中均匀分配,这一机制是实现负载均衡的基础。数据分片根据输入数据的大小和集群中可用的Map任务数来确定,保证了数据在各个节点上均匀分布。数据分片后,每个Map任务处理数据的一块,生成的中间数据会被分组后发送到对应的Reduce任务。

```markdown

数据分片通常根据输入文件大小决定,例如,Hadoop中默认的分片大小是64MB。分片后的数据块可以并行处理,这一过程极大地提高了处理速度。

```

## 2.2 负载均衡的定义和重要性

### 2.2.1 负载均衡的概念

负载均衡是一种技术,旨在将任务或工作负载在多个计算资源之间均匀分配,以达到最优的资源利用率、高吞吐量、低响应时间和避免资源过载的目的。在MapReduce中,负载均衡尤其重要,因为它涉及大量的数据和计算任务,需要在集群中的多个节点间进行合理的任务分配。

```markdown

负载均衡在MapReduce中的实现可以通过多种机制来完成,包括静态分配和动态调度。静态分配主要是在任务开始之前根据一些预估和历史数据来分配任务,而动态调度则在运行过程中根据当前的集群状态和任务进度来动态地调整任务分配。

```

### 2.2.2 负载均衡对性能的影响

负载均衡对集群的性能有着直接的影响。理想情况下,负载均衡可以保证每个节点都以最大的处理能力工作,没有空闲或过载的节点。这样可以缩短整个作业的完成时间,提高资源利用率,减少因节点故障导致的作业失败概率。

不恰当的负载均衡会导致节点之间的负载不均衡,造成部分节点处理能力过剩而其他节点过载,从而影响整体的计算效率和作业的稳定性。

```mermaid

graph LR

A[开始负载均衡] --> B[任务分配]

B --> C[节点资源监控]

C --> D[实时调度]

D --> E[性能优化]

E --> F[任务完成]

F --> G[结束]

```

在本章节中,我们详细介绍了MapReduce框架的工作原理,包括其处理流程以及数据分片和映射机制。同时,我们解释了负载均衡的定义、重要性以及它对性能的深远影响,为下一章节对MapReduce负载均衡实践策略的探讨奠定了基础。

# 3. MapReduce负载均衡的实践策略

在本章中,我们将深入探讨MapReduce负载均衡的具体实践策略。实践中,我们不仅需要理解负载均衡的理论基础,更需要掌握实际操作过程中可能出现的问题及其解决方案。通过执行有效的数据分片策略和高效的任务调度,我们能极大程度上优化MapReduce的性能表现。此外,实时监控和动态调整也是确保负载均衡得以实现的关键步骤。

## 3.1 数据分片策略

### 3.1.1 输入数据分片的方法

在MapReduce框架中,数据分片是确保负载均衡的第一步。数据分片策略的优劣直接影响到整个任务的执行效率。一般来说,数据被切分成若干个分片,每一个分片将被一个Map任务处理。理想情况下,所有的Map任务应当在相同的时间完成,以便尽快进入Reduce阶段。

数据分片的方法有多种,常见的有以下几种:

1. **基于文件块的分片**:Hadoop默认基于HDFS块的大小进行分片。HDFS块默认大小为128MB,因此每个分片的大小不会超过128MB。这种方式的优点是简单快捷,但是可能会导致数据倾斜,如果某些文件块的数据量特别大,那么对应的Map任务处理时间就会延长。

2. **基于记录数量的分片**:可以设定每个分片包含的记录数量,从而控制分片的大小。这种方式可以较好地平衡不同Map任务的处理时间,但需要预先知道数据集的结构和分布。

3. **自定义分片器**:对于更复杂的数据分布,Hadoop允许我们通过实现自定义的`InputFormat`和`RecordReader`来精确控制数据分片。这种方式提供了最大的灵活性,可以根据数据的实际情况来设计分片逻辑。

### 3.1.2 数据倾斜问题及解决

数据倾斜是MapReduce中常见的问题,指某些Map任务处理的数据量远大于其他任务,导致负

0

0