MapReduce分区机制:大数据处理的效率引擎

发布时间: 2024-11-01 05:04:25 阅读量: 17 订阅数: 38

# 1. MapReduce分区机制概述

## MapReduce分区机制的作用

MapReduce模型是大数据处理中不可或缺的技术之一,而分区机制作为其核心组件,主要作用是确保数据在Map和Reduce阶段能够高效、均衡地处理。分区算法根据特定规则将Map阶段的输出结果分配给不同的Reduce任务,以此来实现高效的数据处理和良好的负载均衡。

## 分区的重要性

正确理解分区的重要性,对优化MapReduce作业的性能至关重要。数据局部性原理保证了处理的数据尽可能地与处理节点相邻,而负载均衡则是避免部分节点处理数据过多或过少,从而导致处理时间不一,影响整体效率。分区的恰当设置可以极大地提升数据处理的并行度,降低作业的执行时间。

## 分区策略的选择

选择合适的分区策略对于MapReduce作业的优化至关重要。常见的分区策略包括Hash分区、随机分区和范围分区等。这些策略各有优劣,而根据应用场景的不同,开发者可能需要自定义分区算法以达到最优效果。接下来的章节将深入探讨这些策略的设计和实际应用。

在第一章中,我们为读者提供了对MapReduce分区机制的概览,并强调了分区对于整体大数据处理性能的影响。后续章节将深入到理论基础、实现方法、优化策略以及高级应用等具体领域,提供给读者更全面、深入的理解与应用。

# 2. MapReduce分区机制的理论基础

## 2.1 MapReduce编程模型

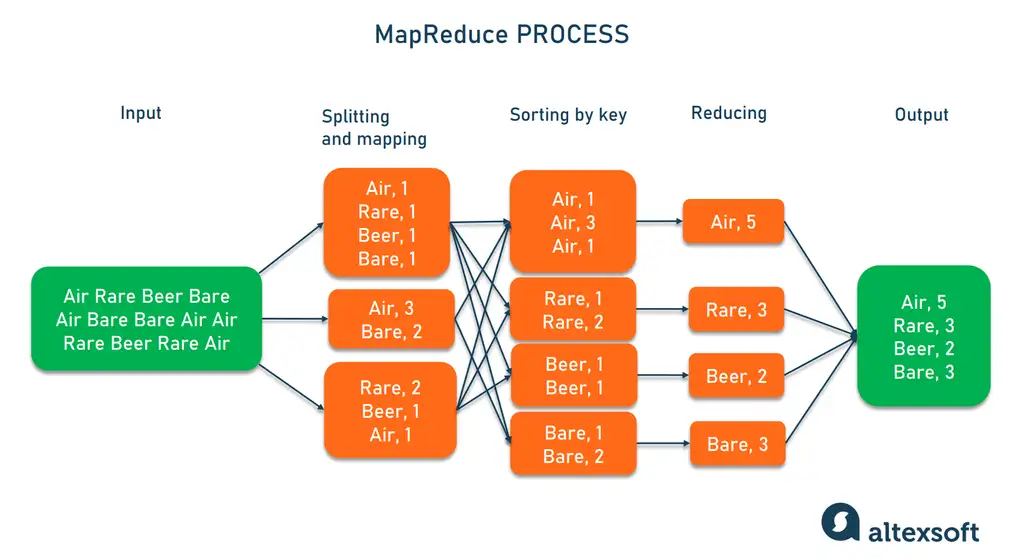

### 2.1.1 Map阶段的工作原理

MapReduce编程模型中的Map阶段是整个处理过程的第一步,它主要负责处理输入数据并生成中间键值对。在Hadoop框架中,Map任务由用户自定义的Mapper类来实现。每个Map任务处理输入数据的一部分,执行自定义的map函数,该函数作用于每条记录,并为每条记录生成一系列中间键值对。

举个例子,在文本处理中,Map阶段的map函数会读取输入文件的每行文本,并为每行生成一个或多个键值对,例如,一个键值对可以表示为<单词, 1>,这表示了单词在当前记录中的出现次数。这些键值对会被传递到下一步的Reduce阶段。

Map阶段的任务包括数据的解析、处理、以及产生中间数据。这一过程通常涉及以下几个关键步骤:

1. 数据读取:根据数据存储的格式读取输入文件,常见的格式包括文本文件、SequenceFile(一种二进制文件格式,支持二进制序列化数据)等。

2. 数据处理:对于每一行或每一个输入分片,调用用户定义的map函数进行处理。

3. 键值对生成:在map函数中,用户需要定义如何将输入数据转换成键值对。

4. 分区和排序:Map任务完成之后,会根据键值对的键对它们进行分区,以便传输到合适的Reduce任务。通常在这个阶段,相同键的键值对会被排序。

Map阶段的输出会被存储在内存中,直到其达到一定大小后被溢写到磁盘。Hadoop提供了一种环形缓冲区来临时存储这些中间数据,以提高性能。

### 2.1.2 Reduce阶段的工作原理

Reduce阶段是MapReduce编程模型的第二步,它处理来自Map阶段的中间键值对,并对这些数据进行归约操作,最终生成最终输出结果。这个阶段由用户自定义的Reducer类来实现。每个Reduce任务通常处理所有Map任务输出的一部分,且具有相同的键。

在Reduce阶段,首先需要对输入的中间键值对进行分组,即根据键值对中的键进行排序和合并。然后,对每个键的所有值进行归约操作。归约操作由用户定义的reduce函数来完成,该函数指定了如何将值集合合并成一个单一的结果。例如,在单词计数的例子中,reduce函数的作用是合并每个单词的所有计数值。

具体来说,Reduce阶段包括以下步骤:

1. 数据接收:Reduce任务从所有Map任务中接收具有相同键的键值对集合。

2. 分组排序:对来自Map任务的键值对进行排序和合并,确保所有具有相同键的值都在一起。

3. 归约操作:对分组后的键值对集合,调用用户定义的reduce函数进行归约操作,生成最终结果。

4. 输出写入:将归约操作的结果写入到输出文件或数据存储系统中。

Reduce阶段是聚合操作的关键时刻,它将分散的数据片段组合成一个有意义的结果。在这个阶段,可以进行数据的汇总、去重、聚合等操作。此外,为了优化性能,还可以在Reduce阶段执行一些数据清洗和预处理工作。

## 2.2 分区机制的重要性

### 2.2.1 数据局部性原理

数据局部性原理是分区机制的重要基础之一,它指的是程序访问数据时的一种趋势,即倾向于访问那些近期内已经访问过的数据。在分布式计算环境中,数据局部性原理可以被用来提高数据处理的效率。

在MapReduce的上下文中,数据局部性原理表现为:

- 时间局部性(Temporal Locality):Map任务处理数据后,相邻的Reduce任务可能会处理相同的或相关数据。

- 空间局部性(Spatial Locality):Map任务处理的数据在物理上可能与接下来要处理的数据相邻。

分区机制可以保证具有相同键的数据尽可能被分配到同一个Reducer上处理。这样,当Reduce任务需要这些数据时,就可以减少数据在网络中的传输,降低对分布式文件系统的读写,从而提高性能。

### 2.2.2 负载均衡与分区

分区机制的另一个关键作用是实现负载均衡,即确保各个任务分配的数据量大致相等,避免出现某些任务处理的数据量过大而其他任务提前完成的现象。负载均衡是分布式计算性能优化的重要方面。

在MapReduce中,如果分区做得不好,一些Reducer可能会处理远超过其他Reducer的数据量,导致整个作业处理的时间依赖于这些负载重的任务。因此,一个好的分区策略应该尽量保证每个Reducer处理的数据量均匀,以加快整体的作业处理速度。

负载均衡依赖于分区算法对数据进行有效分配,需要考虑以下几点:

- 分区的数量:分区的数量要与集群中的Reduce任务数量相匹配。

- 数据的分布:确保数据在不同分区之间均匀分布。

- 分区策略的适应性:分区策略需要能够适应数据的多样性,针对不同类型的数据集选择不同的分区策略。

## 2.3 分区策略与算法

### 2.3.1 常见分区策略解析

分区策略决定了数据如何在各个Reducer之间进行分配。常见的分区策略包括:

1. **Hash分区**:通过哈希函数将键转换成数值,然后将数值与Reducer数量取模,结果就是该键值对应该分配到哪个Reducer。这种方法简单且高效,但有时候会因为哈希碰撞导致数据分布不均。

2. **范围分区**:根据键的范围来分配键值对。这种方法需要预先定义键的范围和Reducer之间的映射关系,适用于键有序的情况。

3. **随机分区**:为了减少数据倾斜,可以使用随机分区策略,将键值对随机分配到不同的Reducer。虽然这种方法简单,但是很难保证负载均衡。

4. **自定义分区**:在特定场景下,可以设计特殊的分区算法以适应特定的数据分布或处理需求。

每种策略都有其适用的场景和优缺点,选择合适的分区策略对于优化MapReduce作业的执行效率至关重要。

### 2.3.2 自定义分区算法的设计

在某些情况下,使用默认的分区策略并不能满足特定的需求,因此设计一个自定义的分区算法是必要的。自定义分区算法允许开发者根据自己的业务逻辑来决定键值对如何分配到不同的Reducer。

设计自定义分区算法通常涉及以下几个步骤:

1. **需求分析**:分析业务需求,确定什么样的分区策略是合适的。例如,需要考虑数据的特征、业务逻辑以及负载均衡的要求。

2. **算法设计**:基于需求分析的结果,设计具体的分区算法。这可能涉及到复杂的逻辑判断和计算过程。

3. **算法实现**:将设计好的算法用代码实现。这通常包括编写一个继承自Hadoop的Partitioner类,并重写其getPartition方法。

4. **测试验证**:在不同的数据集上测试自定义分区器的性能和正确性,确保它满足了业务需求并且不会引入新的问题。

举个例子,在一个日志分析的场景中,如果日志中的用户ID可以用来决定数据应该在哪个Reducer上处理,那么可以设计一个根据用户ID计算Reducer索引的算法。

以下是自定义分区器的一个简单示例代码:

```java

public class Custo

```

0

0