MapReduce:从默认分区到自定义分区的飞跃

发布时间: 2024-11-01 04:57:05 阅读量: 10 订阅数: 23

# 1. MapReduce分布式计算框架概述

## MapReduce概念起源

MapReduce是一种编程模型,最初由Google在2004年提出,用于处理和生成大数据集。该模型将复杂的大数据处理工作分解为两个阶段:Map(映射)和Reduce(归约)。Map阶段处理输入数据并生成中间键值对集合,Reduce阶段则对所有具有相同键的值进行合并操作。

## MapReduce框架的作用

MapReduce框架的主要作用是简化大规模数据集的并行运算。它自动处理许多系统级别的任务,如任务分配、容错、负载均衡和数据的分布式存储。它使得开发者能够专注于编写Map和Reduce逻辑,而无需处理底层的并行化和容错机制。

## MapReduce在现代计算中的地位

在当今的IT行业,MapReduce已经成为大数据处理不可或缺的一部分。它被广泛应用于搜索引擎、数据分析、数据挖掘和机器学习等领域。随着Hadoop等开源分布式计算平台的流行,MapReduce的影响和应用范围进一步扩大,为处理PB级别数据提供了可能。

# 2. MapReduce的基本原理与实践

## 2.1 MapReduce工作流程解析

### 2.1.1 Map阶段的工作机制

Map阶段是MapReduce处理过程的起始点,负责对输入的数据集进行处理,并输出中间的Key-Value对。Map任务的主要步骤包括读取输入数据、处理数据以及输出Key-Value对。

在Map任务执行前,输入数据首先被切分成大小相等的块(blocks)。Hadoop MapReduce框架会自动把这些数据块分配到不同的Map任务中去处理。每个Map任务读取其负责的数据块,并将其转换为行或记录的形式。然后,Map函数对这些记录进行处理,例如提取信息、计算或其他转换操作,最终生成Key-Value对。

这些Key-Value对并不直接输出,而是先进行排序。排序是根据Key来进行的,相同Key的Value会被排序到一起,这为之后的Reduce阶段提供了便利,因为Reduce函数可以一次性接收到所有相同Key的Value进行合并操作。

**代码块示例:**

```java

public static class TokenizerMapper

extends Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

```

**代码逻辑解读:**

- `TokenizerMapper`类扩展了`Mapper`类,并指定了输入的类型为`Object`和`Text`,输出的类型为`Text`和`IntWritable`。

- 在`map`方法中,使用`StringTokenizer`对文本行进行分割,并对每个单词生成一个Key-Value对,其中Key为单词,Value为数字1。

- 输出的Key-Value对会直接送往框架进行后续处理。

### 2.1.2 Reduce阶段的数据处理

Reduce阶段负责处理Map阶段输出的中间数据,它对具有相同Key的Value集合进行合并,最终输出最终结果。Reduce任务可以分为三个主要步骤:Shuffle、Sort和Reduce。

Shuffle阶段涉及到从不同的Map任务中拉取与当前Reduce任务Key相同的中间数据。这一步骤是自动完成的,MapReduce框架会保证只有相同Key的数据才会发送到同一个Reduce任务。

接下来是Sort阶段,它对Shuffle阶段拉取回来的数据进行排序。排序是按照Key进行的,确保了相同Key的Value集合在一起。这一步对于Reduce操作至关重要,因为许多聚合操作都依赖于有序的数据集合。

最后是Reduce阶段,Reduce函数对排序后的数据集合进行处理,进行最终的数据聚合。Reduce函数的输出会被写入到最终的输出文件中。

**代码块示例:**

```java

public static class IntSumReducer

extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values,

Context context

) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

**代码逻辑解读:**

- `IntSumReducer`类扩展了`Reducer`类,并指定了输入的类型为`Text`和`IntWritable`,输出类型也是`Text`和`IntWritable`。

- 在`reduce`方法中,遍历了传入的Value集合,累加所有Value的值。

- 然后,使用`result`变量设置累加的结果,并将其与Key一起输出。

## 2.2 MapReduce编程模型核心概念

### 2.2.1 Key-Value对的概念

在MapReduce编程模型中,Key-Value对是核心数据结构,用于在Map和Reduce两个阶段之间传递中间数据。每一个Map任务输出的是一系列的Key-Value对,这些数据在Shuffle过程中被分配到不同的Reduce任务,每个Reduce任务只处理其中一部分Key-Value对。

Key-Value对的模型非常直观,使开发者能够专注于数据处理的逻辑,而不必关心数据的具体流转和分布式处理的细节。在Map任务中,开发者定义了如何从输入数据生成中间Key-Value对;在Reduce任务中,开发者定义了如何对这些中间数据进行合并处理。

Key和Value的类型由开发者指定,可以是任何实现了Hadoop序列化接口的类型。在编写MapReduce程序时,正确选择Key-Value的类型对于优化性能和方便后续处理至关重要。

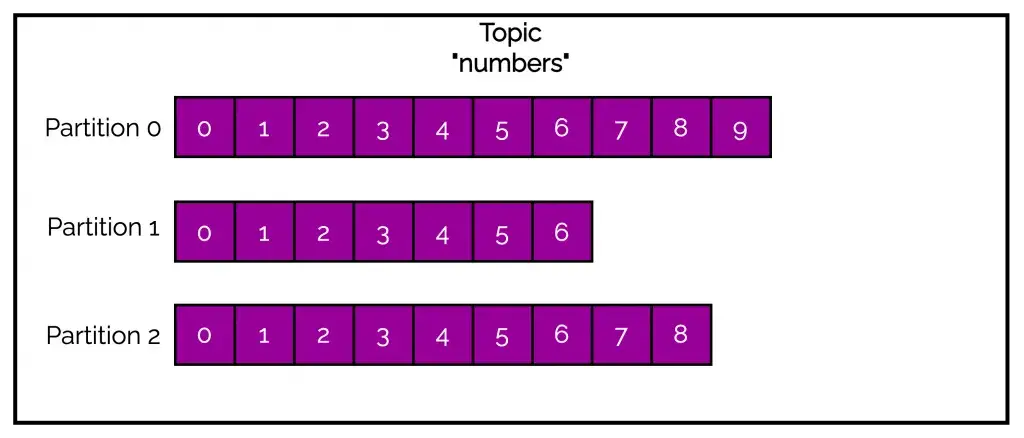

### 2.2.2 分区、排序和合并过程

分区(Partitioning)、排序(Sorting)和合并(Merging)是MapReduce编程模型中三个关键的处理步骤,它们确保了数据的正确流转和处理。

分区发生在Map任务之后和Reduce任务之前。在Map输出的Key-Value对进行Shuffle时,根据Key的值,相同Key的数据会被发送到同一个Reduce任务。这个过程中,Partitioner函数决定了某个Key属于哪个Reducer,通常情况下,这是基于哈希值来计算分区索引的。

排序发生在Shuffle之后,每个Reducer收到其分区的数据后,会先对这些数据进行排序。排序依据的是Key值,这保证了每个Reducer接收到的Key-Value对都是按照Key有序的。排序的结果是每个Key的所有Value都在一起,这对于后续的合并操作非常有用。

合并则是在排序之后进行的,用于对具有相同Key的Value进行合并处理。在合并过程中,开发者可以自定义合并逻辑,实现更复杂的聚合操作。默认的合并操作通常涉及对Value进行累加或求和等操作。通过合并操作,Reduce任务能够有效地对数据进行汇总,最终输出结果。

## 2.3 实践:编写第一个MapReduce程序

### 2.3.1 开发环境的搭建

在编写MapReduce程序之前,需要搭建一个合适的开发环境。一般推荐使用Java语言进行MapReduce程序的开发,因为它是Hadoop的原生语言,而且Hadoop的核心组件大多使用Java编写。搭建开发环境通常需要以下步骤:

1. 安装JDK(Java Development Kit)并设置环境变量。

2. 下载并安装Hadoop,可以使用稳定版本的Hadoop,并将其配置在本地机器上进行开发和测试。

3. 配置Hadoop的环境变量,确保Hadoop命令行工具可以在任何目录下使用。

4. 获取必要的开发工具,例如Eclipse或IntelliJ IDEA,并安装Hadoop开发插件,以便于MapReduce代码的编写和调试。

5. 创建MapReduce项目,并添加Hadoop库文件作为项目依

0

0