MapReduce分区算法原理与实现:构建高效数据处理架构

发布时间: 2024-11-01 04:47:52 阅读量: 30 订阅数: 23

# 1. MapReduce分区算法概述

在大数据处理领域,MapReduce模型由于其强大的分布式处理能力而广受欢迎。MapReduce的核心在于将复杂问题分解为多个可并行处理的子问题,而分区算法在其中扮演着至关重要的角色。它负责将Map阶段的输出结果合理地分配到不同的Reducer上,从而实现高效的并行计算。理解分区算法的原理和实现机制,对于优化大数据处理性能和提升系统吞吐量至关重要。本章将对MapReduce分区算法进行概述,为后续深入分析奠定基础。

# 2. 理论基础与数据流分析

## 2.1 MapReduce核心概念回顾

### 2.1.1 MapReduce模型简介

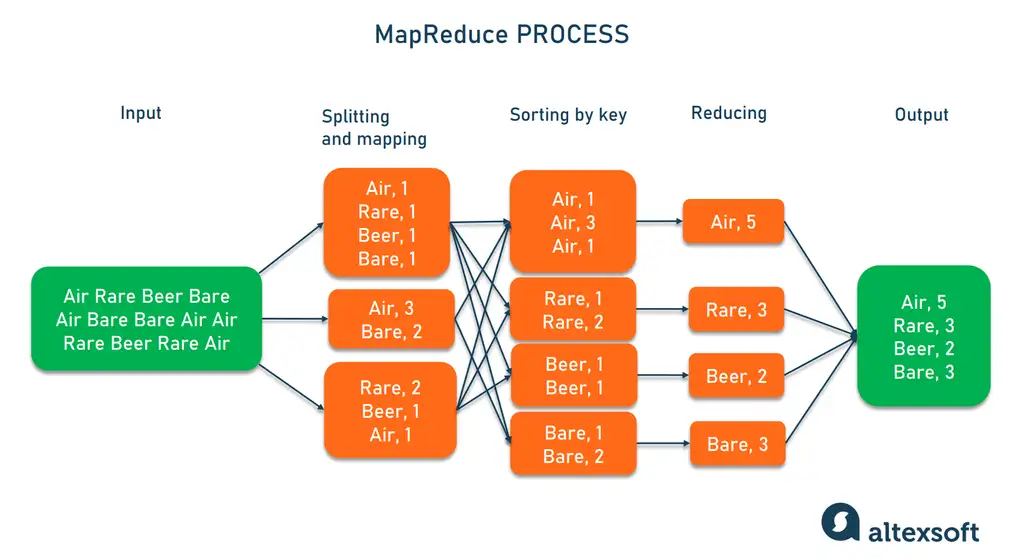

MapReduce是一种编程模型,用于处理和生成大规模数据集。用户通过编写Map()和Reduce()两个函数,实现对数据的处理。在MapReduce模型中,原始输入数据被分解为多个小块,Map函数对这些数据块进行处理,产生中间键值对,再由Reduce函数对这些中间键值对进行合并处理,最终输出结果。

MapReduce模型的工作流程大致可以分为三个阶段:Map阶段、Shuffle阶段和Reduce阶段。Map阶段主要负责读取输入数据,并应用Map函数处理数据,然后输出中间键值对。Shuffle阶段则负责对Map阶段输出的中间数据进行排序和分组,为Reduce阶段准备数据。Reduce阶段则对Shuffle阶段的输出结果应用Reduce函数,进行合并处理,最终得到用户需要的结果。

### 2.1.2 关键组件解析:Mapper与Reducer

MapReduce模型中有两个核心组件:Mapper和Reducer。Mapper主要负责处理输入数据,将数据转化为中间键值对,是Map阶段的主要执行者。每个Mapper处理输入数据的一个片段,通过自定义的Map函数进行数据处理,然后输出中间键值对。

Reducer则负责处理Mapper输出的中间键值对,通过自定义的Reduce函数对这些键值对进行合并处理,是Reduce阶段的主要执行者。每个Reducer处理一个或多个键对应的中间键值对,并输出最终结果。

## 2.2 数据分区的理论基础

### 2.2.1 数据分区的必要性

数据分区是MapReduce模型中的一个重要环节。在Map阶段结束后,产生的中间键值对需要被传输到Reduce阶段进行处理。在传输的过程中,为了提高效率,需要对这些键值对进行分区处理,将具有相同键的键值对分配到同一个Reducer上。

数据分区的主要目的是实现负载均衡,避免某些Reducer处理过多的数据,而其他Reducer处理较少的数据,导致计算资源的浪费。同时,数据分区也有助于提高数据处理的并行度,提高处理效率。

### 2.2.2 分区算法的数学原理

数据分区算法的数学原理主要是基于哈希函数。哈希函数能够将任意长度的输入数据转换为固定长度的输出数据,这个过程称为哈希处理。在MapReduce模型中,通过哈希函数对键值对的键进行处理,得到一个整数,然后将这个整数对Reducer的数量取模,得到的结果即为该键值对需要被发送到的Reducer的编号。

通过哈希函数进行分区,可以保证具有相同键的键值对在哈希后得到的编号相同,从而保证这些键值对能够被发送到同一个Reducer上进行处理。同时,哈希函数的选择也会影响分区的效果,一个好的哈希函数应该能够尽可能均匀地分布键值对,避免数据倾斜的问题。

## 2.3 数据流在MapReduce中的流动

### 2.3.1 Map阶段的数据处理流程

在Map阶段,输入数据被分解为多个小块,每个小块由一个Mapper进行处理。每个Mapper读取输入数据块,并应用自定义的Map函数进行处理,产生中间键值对。这个过程中,Mapper需要对输入数据进行解析,将数据转化为可以处理的格式,然后应用Map函数进行处理。

Map阶段的输出结果为中间键值对,这些键值对包含了原始数据的处理结果。这些键值对需要被传输到Reduce阶段进行处理,因此,Map阶段的输出结果会经过一个排序的过程,将具有相同键的键值对排序在一起,为Shuffle阶段的处理做准备。

### 2.3.2 Reduce阶段的数据处理流程

在Reduce阶段,Shuffle阶段的输出结果被传输到各个Reducer上进行处理。每个Reducer处理一个或多个键对应的中间键值对,应用自定义的Reduce函数进行处理,产生最终的结果。

Reduce阶段的处理过程可以分为两个步骤:Shuffle过程和Reduce过程。Shuffle过程是将Map阶段输出的中间键值对排序和分组,然后传输到Reducer上。Reduce过程则是对这些键值对进行合并处理,应用Reduce函数进行处理,产生最终的结果。

### 2.3.3 分区在数据流中的作用与影响

分区在数据流中起着重要的作用。首先,分区保证了具有相同键的键值对被发送到同一个Reducer上进行处理,这是实现数据聚合的前提。其次,分区也可以影响数据处理的效率和并行度。如果分区策略设计得当,可以实现负载均衡,避免某些Reducer处理过多的数据,而其他Reducer处理较少的数据,浪费计算资源。同时,合理的分区策略也可以提高数据处理的并行度,提高处理效率。

在数据流中,分区的位置位于Map阶段和Reduce阶段之间,是数据流的关键环节。通过分区,Map阶段的输出结果被传输到Reduce阶段进行处理,完成了数据流从Map阶段到Reduce阶段的转换。

以上内容从理论基础和数据流角度对MapReduce分区算法进行了深入解析,下一章节将继续深入探讨MapReduce分区算法的实现机制。

# 3. 分区算法的实现机制

## 3.1 标准分区算法的实现原理

### 3.1.1 默认分区机制解析

MapReduce框架提供了一个默认的分区器,也就是哈希分区器。它基于一个简单但有效的原则:使用一个哈希函数将键(key)映射到一个数值,然后这个数值会经过取模运算被分配到具体的Reducer中。默认的哈希函数通常是Java的hashCode方法,而取模运算则是对Reducer的总数取模。

为了更深入理解这一过程,考虑以下Java代码片段,它模拟了默认哈希分区器的工作方式:

```java

import java.util.Arrays;

import java.util.List;

public class HashPartitioningExample {

public static void main(String[] args) {

List<String> keys = Arrays.asList("apple", "orange", "banana", "grape");

int numberOfReducers = 3;

for (String key : keys) {

int hashValue = key.hashCode();

int partition = hashValue % numberOfReducers;

System.out.println("Key: " + key + " - Partition: " + partition);

}

}

}

```

这段代码将对一个简单的键列表进行分区。首先,每个键通过hashCode()方法生成一个哈希值,然后使用取模运算将这个值映射到一个介于0到numberOfReducers-1之间的分区号。由于hashCode()方法可能生成负数,通常会使用`(hashValue & 0x7FFFFFFF) % numberOfReducers`来确保得到一个非负数结果。

### 3.1.2 自定义分区的实现方法

尽管默认的哈希分区器在许多情况下已经足够有效,但它并不总是最佳选择。某些情况下,比如数据倾斜问题,可能需要开发者实现自定义的分区器。自定义分区器允许开发者根据特定的业务逻辑来确定键应该发送到哪个Reducer。

在实现自定义分区器时,需要继承`org.apache.hadoop.mapreduce.Partitioner`类,并重写`getPartition`方法。这个方法接收键、值、映射任务数和Reduce任务数作为参数,返回一个整数值来指示该键值对应该去的Re

0

0