从零开始理解MapReduce:分区机制的全攻略与作业执行流程

1. MapReduce核心概念与架构

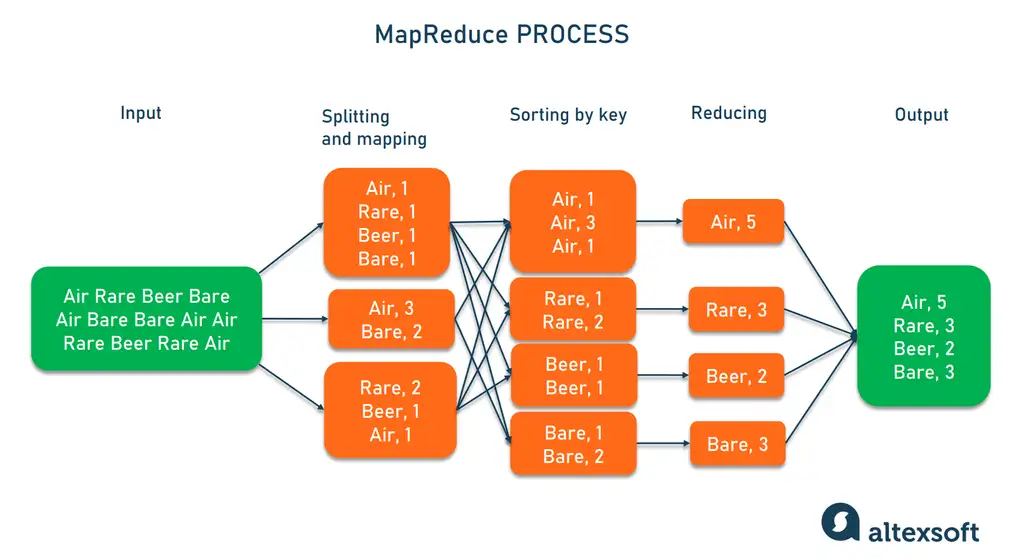

MapReduce是一种编程模型,用于大规模数据集(大数据)的并行运算。它将计算任务分解为两个阶段:Map(映射)阶段和Reduce(归约)阶段。Map阶段负责处理输入数据,将数据转换成一系列中间键值对。随后,Reduce阶段将具有相同键的所有中间值合并在一起,输出最终结果。

1.1 MapReduce的工作原理

MapReduce工作原理可以概括为以下步骤:

- 输入数据被分割成独立的块,然后分配给Map任务;

- Map任务读取这些块的数据,并应用用户定义的Map函数来生成中间键值对;

- 系统对中间输出进行排序,使得相同键的所有值都聚集在一块;

- Reducer任务接收这些排序后的键值对,并应用Reduce函数,输出最终结果。

MapReduce框架能够处理任何类型的数据,只要数据可以被分割成块,就可以使用MapReduce进行处理。MapReduce的核心优势在于它的可扩展性和容错能力,能够高效地处理PB级别的数据。

1.2 MapReduce的关键组件

- JobTracker:负责整个作业的调度和监控;

- TaskTracker:在工作节点上执行任务;

- NameNode:负责文件系统的命名空间;

- DataNode:存储实际的数据。

在后续章节中,我们将深入探讨分区机制、作业执行流程以及如何优化MapReduce作业以提升性能。通过本章对MapReduce核心概念与架构的介绍,读者将建立起一个坚实的基础,为进一步的学习和应用奠定基石。

2. MapReduce分区机制的理论基础

2.1 分区机制的作用与重要性

2.1.1 什么是分区机制

分区机制是MapReduce框架中重要的组成部分,它负责将Map任务的输出数据均匀地分配给Reduce任务。通过合理的分区,可以确保数据在各个Reduce任务中的分布是均衡的,从而提高整体的处理效率和处理速度。分区机制通常基于特定的键值(key),使得相同键值的数据被分配到同一个Reduce任务中,进而实现对数据的归并和处理。

分区机制在数据处理流程中的作用主要体现在以下几个方面:

- 数据分布均匀:确保数据在各个Reduce任务中均匀分布,避免出现数据倾斜问题,从而提高并行处理的效率。

- 键值相关处理:使得具有相同键值的数据能够被同一个Reduce任务处理,这对于需要聚合或合并操作的场景尤为关键。

- 可扩展性提升:合理的分区可以使得系统更容易地扩展到更多的Reduce任务,从而适应更大规模的数据处理需求。

2.1.2 分区机制在数据处理中的作用

分区机制在数据处理中的作用可以进一步细化为以下几个方面:

-

负载均衡:数据的均匀分配是实现负载均衡的前提。如果数据倾斜严重,那么某些Reduce任务可能需要处理比其他任务多得多的数据,导致处理时间不一致,从而影响整体作业的完成时间。

-

数据聚合:在MapReduce模式中,很多算法依赖于对具有相同键值的数据进行聚合处理。分区机制确保了所有具有相同键值的数据都流向同一个Reduce任务,便于进行全局的数据聚合操作。

-

优化性能:在一些特殊场景下,比如全局排序,分区机制可以按照特定的键值有序地分配数据,这样可以进一步优化后续的处理步骤,提升算法的性能。

2.2 分区函数的类型与选择

2.2.1 常见的分区函数介绍

在MapReduce框架中,分区函数定义了数据如何从Map阶段流向Reduce阶段。下面列举几种常见的分区函数类型:

-

默认分区函数:如果没有指定其他分区函数,MapReduce框架将采用默认的分区函数。通常情况下,这是基于哈希函数实现的分区,将键值哈希后按照Reduce任务数量取模,然后分配到对应的Reduce任务。

-

基于范围的分区函数:在这种分区方式中,数据根据键值的范围被分配到不同的Reduce任务。这种方式适合于有序数据的场景。

-

自定义分区函数:开发者可以编写自定义的分区函数以满足特定的业务需求。这种方式非常灵活,可以根据实际场景定制数据的分配逻辑。

2.2.2 如何选择适合的分区函数

选择适合的分区函数通常要考虑以下因素:

-

数据特点:考虑数据的分布和特点。如果数据分布不均匀,可能需要特别设计分区逻辑来避免负载不均。

-

业务需求:根据具体业务逻辑来决定分区策略。例如,如果处理的是时间序列数据,则可能需要基于时间范围进行分区。

-

性能考虑:评估不同分区策略对性能的影响。例如,如果使用自定义分区函数能够显著减少数据倾斜,提升处理速度,则此策略可能是最佳选择。

2.3 自定义分区策略的实现

2.3.1 自定义分区的基本步骤

实现自定义分区策略的基本步骤通常包括:

-

理解业务需求:明确数据处理的业务逻辑,了解哪些键值需要被分配到同一个Reduce任务。

-

编写分区函数:基于业务逻辑,编写一个分区函数,该函数接受键值作为输入并返回一个整数,表示该键值应该被分配到哪个Reduce任务。

-

配置MapReduce作业:在MapReduce作业配置中指定自定义的分区函数,并提交作业进行执行。

2.3.2 实现自定义分区策略的示例代码

下面是一个简单的自定义分区函数的示例代码,该函数将数据基于键值的哈希值均匀分配到三个Reducer:

- public class CustomPartitioner extends Partitioner<Text, IntWritable> {

- @Override

- public int getPartition(Text key, IntWritable value, int numPartitions) {

- // 对键值进行哈希计算

- int partition = (key.hashCode() & Integer.MAX_VALUE) % numPartitions;

- // 根据哈希结果分配到相应的分区

- return partition;

- }

- }

- // 在MapReduce作业配置中使用自定义分区器

- job.setPartitionerClass(CustomPartitioner.class);

- job.setNumReduceTasks(3);

在这段代码中,首先我们继承了Partitioner类并重写了getPartition方法,该方法通过计算键值的哈希值并取模操作得到分区索引。然后在MapReduce作业的配置中,我们指定了自定义的分区器,并设置了三个Reduce任务。

通过上述步骤,我们定义了数据如何根据键值被分配到不同的Reducer中。在实际开发中,可以根据具体需求进行更加复杂的自定义分区逻辑设计。

3. MapReduce作业执行流程详解

MapReduce框架作为一种分布式计算模型,用于处理大规模数据集的并行运算。它通过将计算分为两个阶段:Map阶段和Reduce阶段,来简化了复杂的并行运算流程。在本章中,我们将深入探讨MapReduce作业的执行流程,以及在各个阶段数据是如何被处理的。

3.1 MapReduce作业的生命周期

MapReduce作业从提交到完成,经历了一个复杂的生命周期,涉及多个阶段的处理和转换。理解作业的生命周期有助于更好地掌握作业执行过程中的每一个关键步骤。

3.1.1 作业提交与初始化

在作业开始执行之前,首先需要将作业提交到Hadoop集群中。提交作业是一个涉及多个步骤的过程:

- 用户编写MapReduce程序,包括Map和Reduce函数。

- 程序被打包成一个jar文件或其他可执行格式。

- 使用Hadoop命令行工具或API将作业提交到集群。

- Hadoop集群的作业调度器接收作业,并为其分配一个Job ID。

- 集群中的JobTracker负责监控作业的生命周期和资源分配。

作业初始化阶段涉及以下操作:

- 作业配置信息的加载。

- 计算作业的输入分割(Input Splits)。

- 设置任务尝试的最大次数。

- 初始化任务运行的环境,包括心跳机制、任务状态更新等。

- // 示例代码:MapReduce作业初始化步骤的伪代码

- Configuration conf = getConfiguration();

- Job job = Job.getInstance(conf);

- job.setJobName("ExampleMapReduceJob");

- job.setJarByClass(ExampleDriver.class);

- job.setMapperClass(ExampleMapper.class);

- job.setReducerClass(ExampleReducer.class);

- job.setOutputKeyClass(Text.class);

- job.setOutputValueClass(IntWritable.class);

- FileInputFormat.addInputPath(job, new Path(inputPath));

- FileOutputFormat.setOutputPath(job, new Path(outputPath));

- // 提交作业

- job.waitForCompletion(true);

以上代码演示了如何配置MapReduce作业,并启动作业的提交与初始化过程。

3.1.2 任务调度与执行

一旦作业被初始化,它将被发送到可用的TaskTracker节点上执行。任务调度涉及以下关键步骤:

- 任务分配:TaskTracker节点会根据可用资源,向JobTracker请求任务。

- 任务启动:JobTracker将任务分配给TaskTracker,由TaskTracker负责启动任务。

- 心跳机制:TaskTracker定期向JobTracker发送心跳信息,报告任务状态。

- 容错处理:JobTracker会监控任务的执行情况,如果检测到失败,会重新调度任务到其他节点执行。

任务执行可以分为Map任务和Reduce任务两种类型,它们将在不同的节点上并行执行。Map任务主要负责数据的读取、处理和中间输出。Reduce任务则负责接收来自Map任务的中间输出结果,进行排序和合并,最后输出到文件系统。

3.2 Map阶段的工作原理

Map阶段是MapReduce作业的第一阶段,主要负责处理输入数据,并生成中间输出。理解Map阶段的工作原理对于优化整个作业性能至关重要。

3.2.1 Map任务的输入和处理

Map任务的输入是来自文件系统的数据分割(Input Splits)。每个Map任务处理它被分配到的特定数据分割。

- 数据读取:Map任务从数据分割中读取数据。

- 键值对生成:Map函数处理数据,生成键值对(key-value pairs)。

- 数据排序:Map任务输出的数据需要按键排序,以便相同键的数据被发送到同一个Reduce任务。

下面是一个Map函数的伪代码,展示了如何生成键值对:

- // 伪代码:Map函数生成键值对的过程

- public void map(LongWritable key, Text value, Context context)

- throws IOException, InterruptedException {

- // 处理每一行文本数据

-