MapReduce实战演练:自定义分区器的高级技巧

发布时间: 2024-11-01 05:34:04 阅读量: 28 订阅数: 32

MapReduce基础实战:编程模型与应用详解

# 1. MapReduce编程模型概述

MapReduce是一种编程模型,用于处理和生成大规模数据集。它是基于Google的MapReduce论文而实现的分布式计算框架,广泛应用于大数据处理领域。本章将介绍MapReduce的核心概念、工作流程以及其在处理大规模数据时的优越性。

## 1.1 MapReduce的核心概念

MapReduce将复杂的数据处理过程分解为两个阶段:Map(映射)和Reduce(归约)。Map阶段将输入数据处理成一系列中间键值对,Reduce阶段则对这些键值对进行合并处理。

```java

// 示例:MapReduce伪代码

map(String key, String value):

// 对key-value进行处理

emit(key, value)

reduce(String key, Iterator values):

// 对中间结果进行汇总处理

emit(key, result)

```

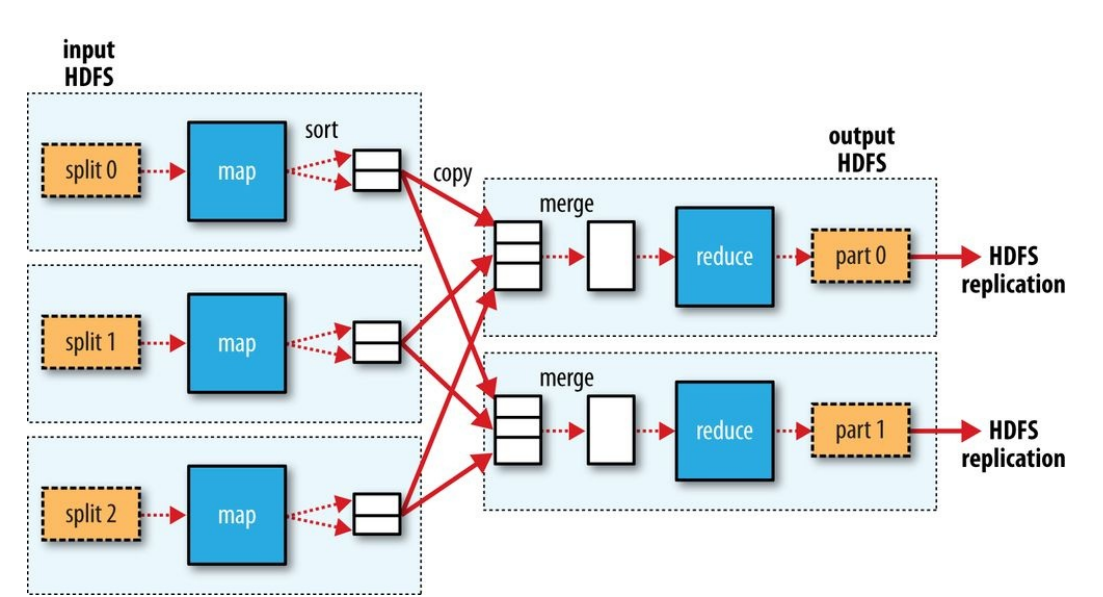

## 1.2 MapReduce的工作流程

在MapReduce框架中,数据被切分成独立的块,由Map函数处理后生成中间键值对。然后,这些键值对被分组、排序,传递给Reduce函数进行合并。最后输出最终结果。

- **输入阶段**:原始数据被分割成独立的输入块,每个块由一个Map任务处理。

- **Map阶段**:对输入数据执行Map函数,生成中间键值对。

- **Shuffle阶段**:框架负责把所有具有相同键(key)的中间数据合并在一起,并传递给Reduce任务。

- **Reduce阶段**:对中间数据执行Reduce函数,汇总处理后输出最终结果。

MapReduce通过这种分而治之的方式,使得大规模数据处理变得可行且高效。下一章将深入探讨自定义分区器的重要性,以及如何根据应用需求设计和实现高效的分区策略。

# 2. 自定义分区器的理论基础

## 2.1 分区器的作用与重要性

### 2.1.1 默认分区器的工作原理

MapReduce框架内置了默认的分区器,其核心作用是在Map任务和Reduce任务之间建立起数据流动的桥梁。默认分区器通常根据数据的键(Key)通过哈希函数计算来决定数据被传递到哪一个Reducer进行处理。这种基于哈希值的分区策略简单高效,但缺乏灵活性。

默认分区器的一个重要特性是它将哈希值等分到每个Reducer,这虽然保证了数据的均匀分布,但也可能引入了数据倾斜问题,即某些Reducer处理的数据量远大于其他Reducer。数据倾斜是MapReduce优化中的一个常见问题,会导致性能瓶颈。

```java

// Java中默认分区器的一个简化示例

public class DefaultPartitioner<K, V> extends Partitioner<K, V> {

public int getPartition(K key, V value, int numPartitions) {

return (key.hashCode() & Integer.MAX_VALUE) % numPartitions;

}

}

```

在上述Java代码示例中,`getPartition`方法通过哈希函数计算键的哈希值,并取模操作确定数据应该发送到哪一个Reducer。默认情况下,MapReduce框架提供了这种分区器,开发者无须额外配置即可使用。

### 2.1.2 自定义分区器的需求分析

自定义分区器的引入是为了解决默认分区器带来的局限性,它使得开发者可以更加精细地控制数据在MapReduce处理过程中的流动。在某些特定场景下,如数据量不均衡或数据分布有特定规律时,自定义分区器能够显著提高处理效率和性能。

举个例子,如果一个业务场景要求将某个特定范围的键值对应的数据分配给特定的Reducer进行处理,或者需要进行更为复杂的分区策略以优化网络传输、减少数据倾斜等问题时,就需要开发自定义分区器。自定义分区器给予开发者更大的控制权,可以根据业务逻辑定制化数据的分区规则。

## 2.2 分区器设计的理论依据

### 2.2.1 数据分布对分区策略的影响

数据分布是决定分区策略设计的关键因素之一。良好的分区策略应当能够保证数据在各个Reducer间均匀分布,这样可以充分利用计算资源,避免某些Reducer成为处理瓶颈。

例如,如果数据分布呈长尾分布,即大部分数据集中在少数几个键上,使用默认分区器会导致这些键对应的Reducer处理的数据量远大于其他Reducer。在这种情况下,采用自定义分区器,如按键范围划分,可以更有效地分配负载。

### 2.2.2 负载均衡与性能优化原则

分区策略设计的核心目标之一是实现负载均衡,使得每个Reducer的工作量大致相等。良好的负载均衡可以减少单点过载的可能性,提升整体的性能和吞吐量。

负载均衡的实现依赖于对数据特性的深入了解,包括数据量大小、数据分布规律等。在实际应用中,开发者往往需要通过反复试验来确定最优的分区策略。性能优化的实践表明,合理的分区策略可以显著缩短任务完成时间,降低资源消耗。

## 2.3 自定义分区器的实现策略

### 2.3.1 编程语言选择与开发环境搭建

自定义分区器的实现需要依据特定的编程语言环境。在Hadoop生态中,Java是最常用的选择,因为它与Hadoop框架的兼容性最好,且拥有成熟的生态系统和大量的开发工具支持。除了Java之外,还可以选择Python、Scala等语言,它们提供了更简便的语法和强大的库支持。

开发自定义分区器的第一步是搭建开发环境,这通常包括安装Java开发工具包(JDK)、集成开发环境(IDE)、Hadoop客户端以及相关的构建工具(如Maven或Gradle)。

### 2.3.2 分区器接口实现的技术要点

实现自定义分区器,开发者需要继承并扩展Hadoop的Partitioner类。核心的方法是`getPartition()`,这个方法根据传入的键(Key)、值(Value)以及Reducer的数量(numPartitions)来返回一个整数,表示数据应该被分配到哪一个Reducer。

在编码实现过程中,开发者需要考虑如何高效地处理键值对,如何确保分区策略可以灵活适应不同的数据分布,以及如何优化分区算法以减少数据倾斜现象。此外,还需要考虑如何处理异常和边界情况,确保分区器的鲁棒性。

```java

// Java中自定义分区器的一个示例

public class CustomPartitioner extends Partitioner<Text, IntWritable> {

@Override

public int getPartition(Text key, IntWritable value, int numPartitions) {

// 假设根据键的前缀决定分区,这里简化为前缀是字符'a'到'c'的数据发往第一个Reducer

if (key.toString().startsWith("a") || key.toString().startsWith("b") || key.toString().startsWith("c")) {

return 0;

}

return 1; // 其他数据发往第二个Reducer

}

}

```

在上述代码示例中,`getPartition`方法通过判断键的前缀来确定数据应发往哪一个Reducer,这提供了一个自定义分区逻辑的简单示例。在实际应用中,开发者可能会根据实际业务需求设计更为复杂的策略。

# 3. 自定义分区器实践指南

## 3.1 分区器的编码与测试

在MapReduce编程模型中,分区器的作用是将中间结果的键值对分配给不同的reduce任务。默认的分区器通常按照键的哈希值均匀地分配数据,但在一些特定的场景下,我们可能需要自定义分区策略来满足特定的需求。接下来,我们将深入探讨自定义分区器的编码和测试过程。

### 3.1.1 编码实践:实现一个简单的自定义分区器

```java

public class CustomPartitioner extends Partitioner<Text, IntWritable> {

@Override

public int getPartition(Text key, IntWritable value, int numPartitions) {

// 对键进行哈希,然后取模运算,得到分区索引

return (key.hashCode() & Integer.MAX_VALUE) % numPartitions;

}

}

```

在上面的代码中,我们通过继承`Partitioner`类并重写`getPartition`方法来创建了一个自定义分区器。在这个例子中,我们使用了键的哈希值来决定数据应该被分配到哪个分区。需要注意的是,我们使用了`Integer.MAX_VALUE`来确保结果为正数,然后对`numPartitions`(即reduce任务的数量)取模,以确定分区索引。

### 3.1.2 测试与验证:确保分区器的正确性和性能

测试自定义分区器是确保其正确性的关键步骤。以下是一些基本的测试步骤:

1. **单元测试:** 为自定义分区器编写单元测试,确保其逻辑按预期工作。

2. **集成测试:** 在MapReduce作业中集成自定义分区器,测试整个作业流程。

3. **性能测试:** 分析分区器的性能,包括是否达到了负载均衡,以及是否对作业的总体性能产生了积极的影响。

测试代码示例:

```java

public class CustomPartitionerTest {

@Test

public void testCustomPartitioner() {

CustomPartitioner partitioner = new CustomPartitioner(

```

0

0