MapReduce Combine:大数据处理的终极优化方案

发布时间: 2024-10-30 18:53:28 阅读量: 28 订阅数: 17

# 1. MapReduce Combine的核心概念与原理

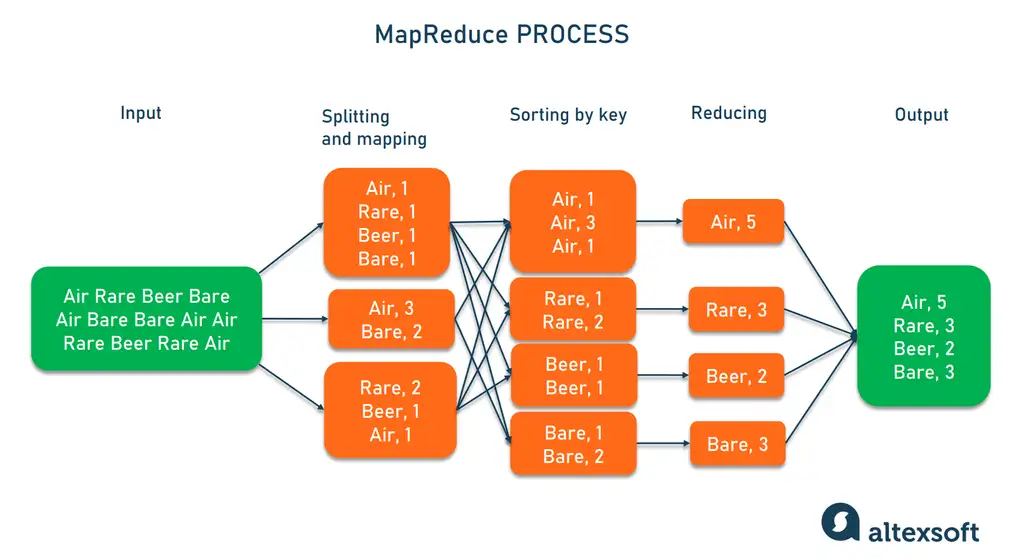

MapReduce作为大数据处理领域的关键技术之一,其核心是将复杂的问题分解成多个简单的任务,然后并行处理,最后再将结果合并。在这一过程中,Map阶段负责处理输入数据并生成中间键值对,Shuffle阶段负责将数据重新分配给Reduce任务,而Reduce阶段则处理这些键值对并输出最终结果。在这三个阶段中,Combine机制起着至关重要的作用,它是Shuffle和Reduce阶段的优化器。本章将详细介绍MapReduce Combine的核心概念和工作原理,以及它是如何提高大数据处理效率的。

在MapReduce模型中,Combiner作为可选组件,通常被设置在Map和Shuffle之间,它的主要作用是对Map阶段输出的中间结果进行局部合并,减少需要传输到Reduce阶段的数据量,从而减轻网络负载,并加快数据处理速度。Combiner的原理是利用局部性原理,即在Map任务的执行节点上先进行数据合并,减少Shuffle过程的I/O操作,达到优化性能的目的。

为了更清晰地理解Combine的工作机制,让我们举一个简单的例子:假设有一个文本文件需要统计词频,Map任务会读取文件中的每一行,并生成一系列的键值对,键是单词,值是计数1。如果不使用Combiner,那么每一个Map任务输出的键值对都会直接传输到Reduce任务,如果数据量很大,网络传输就会成为瓶颈。相反,如果在每个Map任务后使用Combiner,就可以将同一单词的计数合并起来,这样传输到Reduce任务的数据就会大大减少,加快整体的数据处理速度。这种优化是在确保不影响最终结果的前提下进行的,因为词频的统计并不依赖于数据的顺序,只要保证单词的出现次数正确即可。

# 2. MapReduce编程模型详解

## 2.1 MapReduce的工作流程

### 2.1.1 Map阶段处理

MapReduce的工作流程通常从Map阶段开始,其核心是将输入数据集分割成独立的数据块,然后并行处理这些数据块。每个Map任务处理数据块中的记录,并将其转换成一系列的键值对(key-value pairs)。Map阶段输出的键值对中,键用于标识数据类型,而值是具体的数据信息。

在Map阶段,开发者需要实现Map函数,该函数接收输入数据,并按照预定义的逻辑处理数据,产生键值对输出。以下是一个简单的Map函数示例,用于处理文本文件中的单词计数任务:

```java

map(String key, String value):

// key: document name

// value: document contents

for each word w in value:

EmitIntermediate(w, "1");

```

逻辑分析:这段代码展示了一个Map函数的基本框架,函数接收输入文件的名称(key)和内容(value)。对于文件中的每一个单词(w),它输出一个键值对,键为单词本身(w),值为计数("1"),表示该单词出现了一次。MapReduce框架会处理所有的键值对,把相同的键(单词)分组,然后发送到Reduce阶段处理。

### 2.1.2 Shuffle阶段

Shuffle阶段是MapReduce中的核心阶段之一,它的作用是将Map阶段产生的中间键值对传输到相应的Reduce任务中去。Shuffle过程是优化性能的关键,其主要目标是确保数据在网络传输时尽可能高效,并且在Reduce任务开始之前,所有相关的数据都已经被正确地传输和排序。

在这个阶段,Map任务输出的键值对会经过几个步骤:

1. **分区(Partitioning)**: 每个键值对根据其键的值被分配到不同的分区(或桶bucket)。默认情况下,Hadoop会使用哈希分区,也就是通过哈希函数对键进行哈希运算,将键值对分配到相应Reduce任务。

2. **排序(Sorting)**: 同一个分区内的键值对会根据键进行排序,这使得相同键的值被聚集在一起。

3. **合并(Combining)**: 在排序的同时,系统可能会执行一些合并操作,以减少数据传输量。这可以通过Combiner实现,它在Map输出到Shuffle之前,局部地执行Reduce操作。

4. **传输(Spilling)**: 当内存中积累的中间数据达到一定数量后,这些数据会被写入到磁盘。这个过程称为Spilling,它是为了避免内存溢出。

### 2.1.3 Reduce阶段

在Shuffle阶段完成后,所有的键值对都根据键被送达了相应的Reduce任务。Reduce阶段就是对这些有序的键值对集合进行处理,并输出最终的结果。

Reduce函数的基本处理流程为:

1. 对每个唯一的键,它的相关值集合被收集在一起。

2. Reduce函数被调用处理这个键以及它的值的列表。

下面是一个简单的Reduce函数示例,继续上面单词计数的例子:

```java

reduce(String key, Iterator values):

// key: a word

// values: a list of counts

int result = 0;

for each v in values:

result += ParseInt(v);

Emit(key, Int.toString(result));

```

逻辑分析:这段代码展示了一个Reduce函数的基本框架,它接收一个键(单词)和一系列相关联的值(出现次数)。函数遍历所有出现次数,将它们加起来,然后输出该单词的总计数。

## 2.2 MapReduce的高级特性

### 2.2.1 Combiner的作用与原理

Combiner是MapReduce的一个可选组件,它可以在Map任务结束后,但Shuffle阶段开始之前对中间数据进行预聚合,以减少网络传输量和提高整体性能。Combiner的功能类似于一个“本地的Reduce”操作。

Combiner的原理是,它接受来自同一个Map任务的中间输出,然后按照相同的键聚合这些值。当Combiner被指定为某个作业的一部分时,Map任务的输出会先经过Combiner处理,再传递给Shuffle过程。Combiner的输出直接作为Shuffle的输入,最终达到Reduce任务。

以单词计数为例,使用Combiner,Map任务产生的中间键值对(word, "1")可以由Combiner合并,结果可能是(word, number of "1"s)。这样,Combiner减少了传输给Reduce任务的数据量,提高了作业的效率。

### 2.2.2 Partitioner的角色与自定义

Partitioner在MapReduce中负责将Map输出的键值对分发到不同的Reducer。默认的Partitioner通常基于哈希函数对键进行分区。但是,根据不同的需求,开发者也可以自定义Partitioner来控制数据如何被分割。

自定义Partitioner的动机通常是为了优化数据分布,以获得更好的负载均衡。例如,在分布式环境中,如果数据的分布非常不均匀,某些Reducer可能会处理异常多的数据,导致性能瓶颈。通过自定义Partitioner,可以确保每个Reducer处理的数据量尽量相同。

下面是一个简单的Partitioner实现的伪代码:

```java

class CustomPartitioner extends Partitioner<Text, IntWritable> {

public int getPartition(Text key, IntWritable value, int numPartitions) {

// 使用哈希函数获得key的哈希值,并对numPartitions取模

int hash = key.hashCode() % numPartitions;

return hash;

}

}

```

逻辑分析:这段代码展示了一个自定义Partitioner的基本框架,它继承自MapReduce框架中的Partitioner类。在`getPartition`方法中,通过计算键的哈希值并取模来确定该键值对应该属于哪个分区。

### 2.2.3 Sort的优化策略

在MapReduce中,排序发生在Shuffle阶段,即在数据被发送到Reduce任务之前。排序的目的不仅是为了保证数据的有序性,还为了确保每个Reducer接收到的数据都是根据键有序的,这使得它可以执行高效的聚合操作。

优化排序的一个常用策略是使用Combiner。如前面所提,Combiner在每个Map节点上执行局部聚合,减少了需要排序的数据量。此外,对于某些特定类型的数据或任务,还可以通过编写更高效的比较器(Comparator)来优化排序过程。

以下是一个自定义Comparator的示例:

```java

class CustomComparator extends WritableComparator {

protected CustomComparator() {

super(MyWritableClass.class, true);

}

@Override

public int compare(byte[] b1, byte[] b2) {

// 自定义比较逻辑,例如对特定字段进行优先排序

// 此处省略具体实现

}

}

```

逻辑分析:这段代码展示了一个自定义Comparator的基本框架,它继承自MapReduce框架中的WritableComparator类。在`compare`方法中,通过实现自定义的比较逻辑来控制排序行为。例如,可以根据键中的特定字段来决定排序的优先级,从而更有效地管理排序性能和优化整体处理过程。

## 2.3 实践中的性能优化

### 2.3.1 Map和Reduce任务的调优

Map和Reduce任务的性能优化是MapReduce编程中的关键。为了最大化作业的性能,开发者需要关注资源分配、任务并行度以及内存管理等方面。

在Map阶段,任务的性能优化通常涉及到:

- **合理的Map数量**:确保Map任务数量既不太少也不太多,太少无法充分利用集群资源,太多则可能导致任务调度和管理开销增大。

- **内存管理**:合理配置Map任务的JVM堆大小,避免发生频繁的垃圾回收或内存溢出。

在Reduce阶段,性能优化则包括:

- **分区策略**:合理设置Reduce任务数量和分区策略,避免出现数据倾斜问题。

- **数据大小**:尽量保证Reduce任务处理的数据量大致均衡,避免某些任务过早结束而空闲。

### 2.3.2 索引与缓存的利用

在MapReduce作业中,索引和缓存的利用可以显著提升数据处理效率,尤其是在处理大量数据时。

索引机制可以加速数据的查找过程。在MapReduce中,可以利用HBase等NoSQL数据库的索引功能,或在Map任务中使用Bloom Filter等轻量级数据结构过滤不必要的数据。

缓存机制主要用于加快数据访问速度。在MapReduce作业中,可以将频繁访问的热点数据预加载到每个任务节点的内存中,通过配置文件设置内存映射(Memory-mapped files)等手段,减少磁盘I/O的消耗。

例如,若要处理日志文件中的特定字段信息,可以预先在内存中加载一个该字

0

0