MapReduce Combine深度解读:数据合并过程与调优策略

发布时间: 2024-10-30 18:37:14 阅读量: 35 订阅数: 17

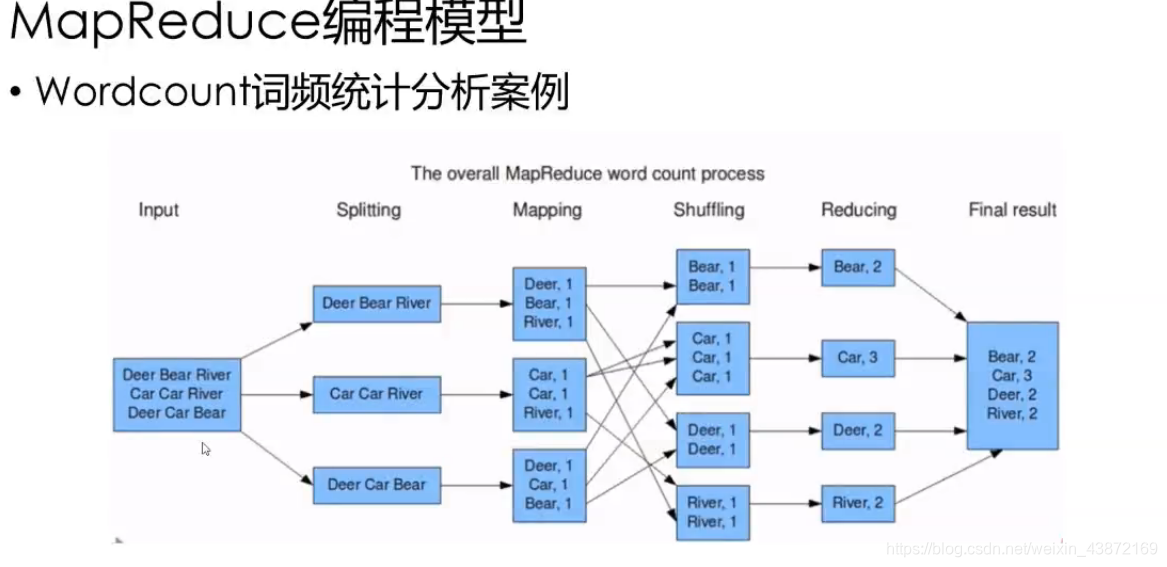

# 1. MapReduce Combine概念解析

MapReduce是一种分布式计算模型,广泛应用于大规模数据集的处理和分析。在MapReduce计算框架中,Combine函数扮演着至关重要的角色,它是优化MapReduce作业性能和提升数据处理效率的关键技术之一。

## 1.1 MapReduce Combine的作用

在MapReduce作业中,数据处理分为Map阶段和Reduce阶段。Map阶段负责读取数据并执行预处理,而Reduce阶段则执行汇总和合并操作。在Map阶段和Reduce阶段之间,存在一个Shuffle过程,它负责将Map的输出按键排序后传递给Reduce。在这过程中,Combine函数应运而生。它的主要作用是减少Map阶段输出的数据量,通过合并相同键值的数据项,减轻网络传输的压力,进而提升整体作业的执行效率。

## 1.2 Combine与Shuffle的协同作用

Combine函数与Shuffle阶段协同工作,Shuffle阶段是MapReduce计算中最耗时的部分之一,因为它涉及到大量的数据在网络中传输。如果不对数据进行预处理,网络带宽和I/O操作将成为瓶颈。通过执行Combine操作,可以在节点本地将相同键的数据合并,减少Shuffle阶段需要传输的数据量。这样不仅减少了网络I/O,还提升了整体的计算效率。

下面将详细介绍Combine的核心理论框架,探讨其在数据流模型中的作用,以及它如何影响MapReduce作业的性能。

# 2. Combine的核心理论框架

## 2.1 MapReduce数据流模型

MapReduce编程模型允许开发者编写可以并行处理大数据集的代码。理解MapReduce的数据流模型是使用Combine技术的前提。

### 2.1.1 Map阶段的数据处理流程

Map阶段是MapReduce程序的初始阶段,在这个阶段,输入数据被分割成多个小的数据块,并由多个Map任务并行处理。Map任务对每个数据块执行用户定义的Map函数,该函数处理输入数据并产生一系列的键值对。

#### Map阶段的数据处理流程图

```mermaid

graph TD

A[输入数据] --> B[分割成数据块]

B --> C[Map任务]

C --> D[Map函数处理]

D --> E[产生键值对]

```

```python

def map_function(key, value):

# 这里是用户定义的Map函数逻辑

emit(key, value)

```

Map阶段的关键步骤是数据的分区和排序。Map任务完成之后,键值对需要按照键进行分区,以确保具有相同键的键值对被发送到同一个Reduce任务。接着,数据会被排序,以便相同键的数据块聚集在一起。

### 2.1.2 Reduce阶段的角色和任务

Reduce阶段紧随Map阶段之后,它的主要任务是合并中间键值对数据,产生最终输出。

```python

def reduce_function(key, values):

# 这里是用户定义的Reduce函数逻辑

emit(key, aggregate(values))

```

Reduce阶段会遍历所有的中间数据,对于每一个键值对,调用Reduce函数,并将结果输出到存储系统中。在实际的MapReduce框架中,如Hadoop,Reduce阶段包括Shuffle和排序,以便为Reduce任务的处理准备有序的数据。

## 2.2 Combine函数的作用机制

### 2.2.1 Combine与MapReduce作业性能的关系

Combine函数在MapReduce框架中扮演着优化性能的重要角色。它在Map和Reduce阶段中都可能被调用,以减少数据传输量、节省I/O资源并减少网络负载。

在Map阶段,Combine函数的使用可以减少写入磁盘的数据量。通过在内存中合并具有相同键的输出数据,可以将多个键值对合并为一个,从而减少Shuffle阶段需要传输的数据量。

在Reduce阶段,Combine函数可以在数据到达Reduce任务之前进行预合并。这可以进一步减少网络传输量,因为更少的数据需要从Map任务传输到Reduce任务。

### 2.2.2 Combine与Shuffle阶段的协同工作

Shuffle阶段是MapReduce中的一个关键步骤,它负责在Map和Reduce任务之间移动数据。Combine函数与Shuffle阶段的协同工作是提高作业效率的关键。

在Shuffle阶段,Map任务输出的数据会被传输到指定的Reduce任务。使用Combine函数可以在这个阶段中对数据进行部分合并,减少需要传输的数据量,这样可以减轻网络压力,并降低存储需求。

```python

# 示例:在MapReduce框架中实现Combine函数

def combine_function(key, values):

# 用户定义的Combine逻辑

intermediate_value = intermediate_aggregation(values)

return key, intermediate_value

```

在Map阶段,中间结果在发送到Shuffle之前,会首先经过Combine函数处理。这有利于减少数据的存储大小并提升Shuffle的效率。在Reduce阶段,Combine函数的使用可以对数据进行局部合并,以便更快地进行最终的聚合操作。

## 2.3 Combine的优化原理

### 2.3.1 内存管理和I/O优化

内存管理和I/O优化是通过合理利用内存资源来减少对磁盘I/O操作的依赖,从而提升程序的运行效率。

在MapReduce中,通过内存中的临时存储,Combine函数可以将多个数据点聚合在一起,减少磁盘I/O操作。这是通过减少写入磁盘的中间数据量来实现的,从而避免了频繁的磁盘读写,降低了I/O负载。

```python

# 示例:内存中合并键值对

def in_memory_combination(values):

combined_value = []

for value in values:

# 对数据进行合并处理

combined_value.append(aggregate(value))

return combined_value

```

在上述代码中,`aggregate` 函数表示了对中间数据进行合并的逻辑。通过这种方式,可以显著减少中间数据量,优化内存使用,并提升总体的MapReduce作业性能。

### 2.3.2 网络带宽的有效利用

网络带宽的有效利用是通过减少网络传输的数据量,减少网络拥塞和数据传输延迟,最终提升整体作业的运行效率。

在MapReduce的Shuffle阶段,网络带宽是可能成为瓶颈的一个资源。Combine函数可以在Shuffle阶段之前进行数据合并,从而减少了需要通过网络传输的数据量。这一优化不仅可以节省网络带宽,还可以减少因网络传输导致的延迟,提高作业的执行速度。

```python

# 示例:网络传输前的数据预处理

def network_optimized_combination(data_stream):

combined_data = []

for key, value in data_stream:

# 合并相同键的数据项

combined_data.append((key, combine_values(value)))

return combined_data

```

在上述代码中,`combine_values` 函数是对具有相同键的数据项进行合并的逻辑。通过这种方式,可以有效减少网络传输的数据量,充分利用网络带宽,加速MapReduce作业的执行速度。

### 2.3.3 系统资源的均衡利用

系统资源的均衡利用是确保MapReduce作业中内存、CPU、磁盘和网络资源得到合理分配和使用的过程。

在MapReduce作业中,Combine函数的使用应该结合系统的资源状态来进行调整。例如,在内存充足的系统中,可以在Map任务中使用更多的内存来执行Combine操作,从而减少磁盘I/O的使用。在内存紧张的情况下,则可以考虑在Reduce任务中进行Combine操作,以优化网络传输。

```mermaid

graph LR

A[Map阶段] --> |内存资源充足| B[增加Combine操作]

A --> |内存资源紧张| C[减少Combine操作]

D[Reduce阶段] --> |网络带宽紧张| E[增加Combine操作]

D --> |网络带宽充足| F[减少Combine操作]

```

系统资源的均衡利用需要根据实际的硬件资源和作业需求灵活调整。适当的Combine策略可以帮助优化资源使用,使得MapReduce作业在不同环境下都能保持良好的性能表现。

通过以上分析,我们可以看到Combine函数在MapReduce作业中的核心作用以及优化原理。在实际应用中,合理地利用Combine函数可以显著提升数据处理的效率,并优化系统资源的使用。在接下来的章节中,我们将进一步探讨Combine函数的具体实现方式和在实际项目中的应用案例。

# 3. Combine实践操作指南

在深入理解了MapReduce Combine的核心理论框架后,我们可以将注意力转向实践操作。本章将介绍一些常见的Combine实现方式,并且详细描述它们在实际项目中的应用,以及如何进行性能测试与分析。

## 3.1 常见的Combine实现方式

### 3.1

0

0