MapReduce Combine:掌握最佳配置,释放数据处理潜能

发布时间: 2024-10-30 18:57:15 阅读量: 20 订阅数: 17

# 1. MapReduce Combine核心概念

在MapReduce的生态系统中,Combine操作起着至关重要的作用。MapReduce是一种编程模型,广泛用于处理大规模数据集的并行运算。其工作流程分为两个主要阶段:Map阶段和Reduce阶段。Combine操作作为这两个阶段之间的一个优化步骤,旨在减少在Map阶段产生的中间数据,通过合并这些数据来减少后续Shuffle阶段的网络传输量。

## 1.1 MapReduce流程简介

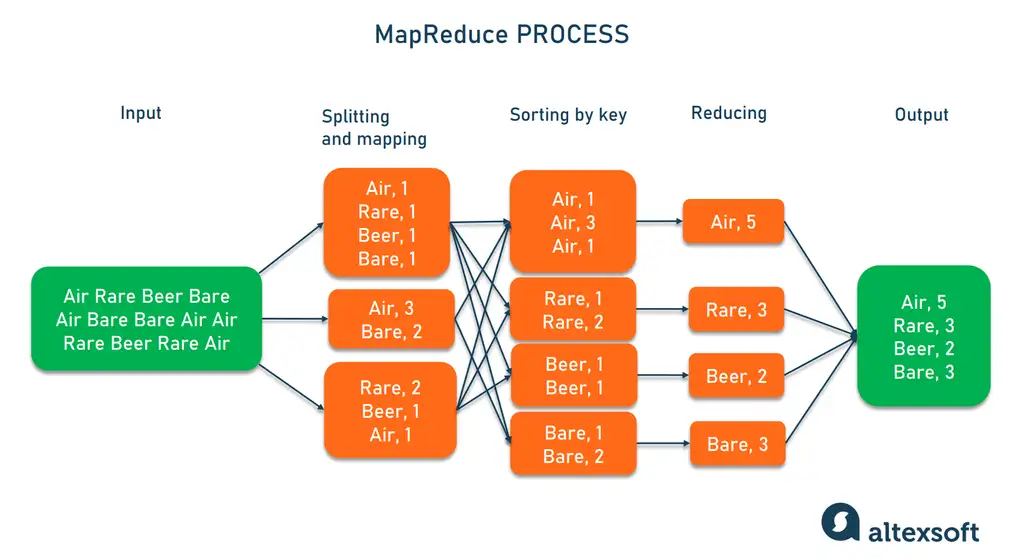

在详细介绍Combine之前,我们需要快速回顾MapReduce的工作流程。在Map阶段,Map任务处理输入数据,产生键值对(key-value pairs)。在Reduce阶段,Reduce任务对这些键值对进行归约操作,通常是对具有相同key的数据进行合并处理,以生成最终结果。

## 1.2 Combine与Shuffle的关系

Shuffle阶段位于Map和Reduce之间,负责将Map输出的键值对按照key进行排序,并将它们传输到对应Reduce任务所在的节点。在Shuffle过程中,若数据量庞大,会消耗大量网络资源和时间。Combine操作便是在Shuffle之前的一次本地优化,它通过合并Map输出的数据,尽可能减少跨节点传输的数据量。这样不仅能提升数据处理速度,还能降低对网络带宽的需求。

# 2. Combine的内部机制与优化理论

## 2.1 Combine的运作原理

### 2.1.1 MapReduce流程简介

MapReduce是一种编程模型,用于处理大规模数据集的分布式运算。MapReduce模型包括两个主要阶段:Map阶段和Reduce阶段。在Map阶段,输入数据被分成小块并分配给不同的Map任务进行处理,每个Map任务处理一部分数据,并产生中间输出。在Reduce阶段,中间输出被收集并根据键值排序后分配给不同的Reduce任务,这些任务对这些中间数据进行汇总处理,最终生成输出结果。

**MapReduce模型的关键特点:**

- **可扩展性:** 通过将任务分散到多个节点上,MapReduce可以高效地处理PB级别的数据。

- **容错性:** 当节点失败时,MapReduce框架能自动重新安排任务到其他节点上执行。

- **抽象层次高:** Map和Reduce操作屏蔽了底层的分布式计算细节,使开发者能专注于具体的数据处理逻辑。

### 2.1.2 Combine与Shuffle的关系

Shuffle是MapReduce中一个至关重要的过程,它包括从Map阶段输出的中间数据到Reduce阶段输入的重新分布过程。Combine是Shuffle过程中的一部分,主要作用是减少网络传输数据量和降低Reduce阶段的处理负载。在Shuffle过程中,Map任务输出的中间键值对经过排序后被传输到相应的Reduce任务。在这个阶段,Combine函数可以被应用于相同键值的中间数据,以实现数据的局部合并,减少传输和存储的数据量。

**Combine与Shuffle结合的优势:**

- **减少数据传输量:** 通过合并相同键值的数据,网络传输的中间数据减少了,减轻了网络负载。

- **加快处理速度:** 合并后的数据减少了Reduce任务的处理工作量,加速了整个MapReduce作业的完成。

- **优化存储:** 合并后的数据往往更加紧凑,减少了对存储空间的需求。

## 2.2 Combine的性能优化理论

### 2.2.1 减少数据倾斜的影响

数据倾斜是分布式计算中常见的问题,它发生在某些节点上的数据处理量远大于其他节点,导致整体作业效率降低。在MapReduce中,数据倾斜可导致某些Reduce任务负载过重。Combine的引入可以减轻数据倾斜的影响,因为它可以在Shuffle之前对数据进行预聚合,将相邻的键值对合并,从而平衡不同Reduce任务的工作负载。

**优化数据倾斜的策略:**

- **自定义Combiner逻辑:** 根据具体数据分布情况编写合适的Combiner函数,确保数据被合理地预聚合。

- **合理配置Map和Reduce任务数:** 调整任务数以匹配数据的实际分布,避免某些任务成为瓶颈。

- **数据预处理:** 在MapReduce作业开始之前对数据进行预处理,比如抽样和分桶,以减少数据倾斜。

### 2.2.2 提高数据处理速度的关键因素

为了提高MapReduce作业的数据处理速度,关键是优化网络传输、磁盘I/O、CPU使用等方面的性能。Combine在这一过程中扮演着关键角色,通过减少Shuffle阶段的数据传输,可以显著提升数据处理的速度。

**提高数据处理速度的关键因素:**

- **减少网络带宽消耗:** 结合自定义的Combiner逻辑来减少在网络中传输的数据量。

- **提升磁盘I/O效率:** 由于Combine可以减少中间输出的数据量,磁盘I/O操作也相应减少,提升了效率。

- **优化CPU使用:** 尽管Combiner操作本身会占用CPU资源,但其节省的数据处理量可以抵消这部分消耗,总体上提高CPU的处理效率。

### 2.2.3 Combine函数的选择与实现

在MapReduce中,选择合适的Combine函数对于优化性能至关重要。理想情况下,Combine函数应该是能够有效合并相同键值的数据,并且实现起来既高效又简洁。

**Combine函数选择与实现的考虑因素:**

- **操作的幂等性:** Combine操作应该是幂等的,即多次应用相同的Combiner函数应该得到相同的结果。

- **避免数据溢出:** 实现时需考虑内存使用,避免因内存限制而引发的数据溢出问题。

- **避免数据丢失:** Combiner不应该过滤掉任何数据,以保证最终结果的正确性。

```java

// Java示例代码:自定义Combiner函数实现

public class CustomCombiner extends Reducer<Text, IntWritable, Text, IntWritable> {

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context)

throws IOException, InterruptedException {

int sum = 0;

for (IntWritable value : values) {

sum += value.get();

}

context.write(key, new IntWritable(sum));

}

}

```

**代码逻辑分析:**

上述代码段展示了如何使用Java编写一个简单的Combiner实现。在这个例子中,Combiner函数接收具有相同键(key)的所有值(values),进行累加操作,并输出累加后的结果。参数`IntWritable`指定了数据类型,确保了操作的高效性和类型安全。

## 2.3 最佳实践:参数配置技巧

### 2.3.1 针对不同场景的参数设置

MapReduce作业的参数配置可以针对不同的场景进行调整,以实现更优的性能表现。关键参数包括Map任务数、Reduce任务数、Combiner的使用以及Shuffle的配置等。

**参数配置的策略:**

- **Map任务数:** 根据数据大小和集群性能,设置合理的Map任务数,通常需要进行实验以找到最佳配置。

- **Reduce任务数:** 通过预先估计数据分布来决定Reduce任务数,避免数据倾斜。

- **Combiner启用与禁用:** 根据数据是否可以安全地使用Combiner来进行预聚合,来决定是否启用Combiner。

- **Shuffle参数调整:** 调整Shuffle缓冲区大小和Map输出大小等参数,可以进一步优化性能。

### 2.3.2 结合实际案例的参数优化

在实际应用中,根据数据特性和作业需求进行参数优化是提高MapReduce作业性能的关键。以下是一个参数优化的实际案例分析。

**案例分析:**

- **问题描述:** 在处理大规模日志数据时,发现作业处理速度缓慢,分析发现数据倾斜严重。

- **优化措施:**

1. 启用Combiner函数预聚合键值对。

2. 根据数据量合理分配Map和Reduce任务数。

3. 调整Shuffle缓冲区参数,减少不必要的磁盘I/O。

- **结果:** 作业运行时间缩短了约30%,效率显著提升。

通过以上分析,我们可以看出在实际应用中通过合理的参数配置和优化措施,可以显著提高MapReduce作业的性能。

# 3. MapReduce Combine实践技巧

MapReduce框架中的Combine操作是优化大数据处理性能的关键步骤。在这一章节中,我们将深入了解如何通过实践技巧来配置、诊断以及评估Combine操作。

## 3.1 Combine的配置方法

### 3.1.1 Hadoop参数配置详解

Hadoop MapReduce的Combine操作可以通过配置参数来优化。下面是几个关键的配置参数:

- `mapreduce.job.maps`: 设置Map任务的数量。

- `mapreduce.job.reduces`: 设置Reduce任务的数量。

- `***bine.class`: 指定自定义Combine类。

- `mapreduce.task.io.sort.factor`:

0

0