卷积神经网络(CNN):图像识别的强大引擎,解锁图像奥秘

发布时间: 2024-08-18 01:47:29 阅读量: 30 订阅数: 23

# 1. 卷积神经网络(CNN)概述

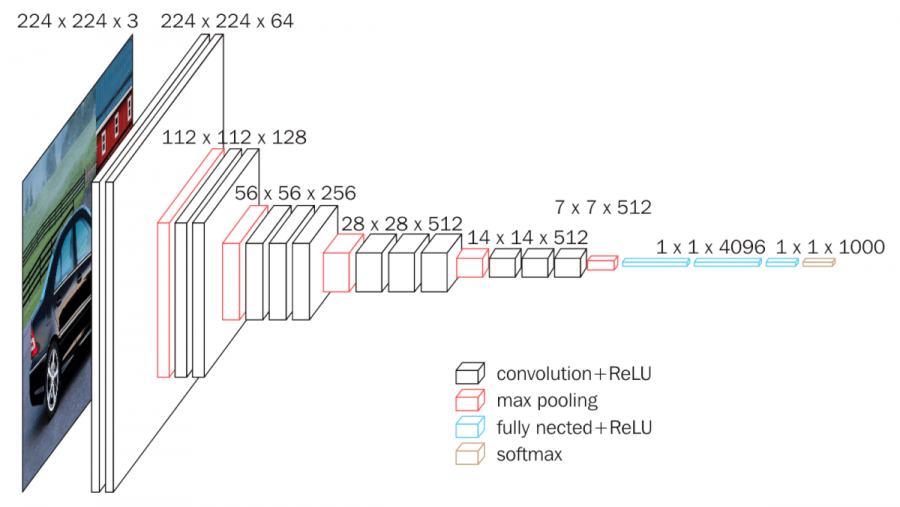

卷积神经网络(CNN)是一种深度学习模型,专门用于处理网格状数据,如图像和视频。CNN的独特之处在于其卷积层,它可以提取数据的局部特征并识别模式。

CNN的基本原理是利用卷积操作和池化操作。卷积操作通过一个称为卷积核的滤波器在输入数据上滑动,计算每个位置的加权和。池化操作则通过将相邻单元合并成一个值来减少特征图的大小。

CNN通常由多个卷积层、池化层和全连接层组成。卷积层负责提取特征,而池化层负责减少计算量和特征图大小。全连接层用于将提取的特征映射到输出类别。

# 2.1 卷积操作和池化操作

### 2.1.1 卷积操作原理

卷积操作是 CNN 的核心操作,它通过将一个称为卷积核(或滤波器)的权重矩阵与输入数据进行逐元素乘积和求和,来提取输入数据中的特征。卷积核的大小和形状决定了提取的特征的范围和类型。

**卷积操作的数学表示:**

```

Output[i, j] = ∑∑ Input[i + k, j + l] * Kernel[k, l]

```

其中:

* `Output[i, j]` 是输出特征图中位置 `(i, j)` 的值

* `Input` 是输入数据

* `Kernel` 是卷积核

* `k` 和 `l` 是卷积核的索引

**卷积操作的逻辑分析:**

卷积操作通过在输入数据上滑动卷积核,逐个位置地提取特征。卷积核的权重值决定了提取的特征的类型。例如,如果卷积核的权重值是边缘检测滤波器,则卷积操作将提取输入数据中的边缘特征。

### 2.1.2 池化操作类型

池化操作是卷积层之后常用的操作,它通过对特征图中的相邻元素进行聚合,来减小特征图的大小并提高计算效率。常见的池化操作类型包括:

* **最大池化:**取特征图中相邻元素的最大值。

* **平均池化:**取特征图中相邻元素的平均值。

**池化操作的数学表示:**

```

Output[i, j] = max/avg(Input[i * s:i * s + s, j * s:j * s + s])

```

其中:

* `Output[i, j]` 是输出特征图中位置 `(i, j)` 的值

* `Input` 是输入特征图

* `s` 是池化窗口的大小

**池化操作的逻辑分析:**

最大池化操作通过提取特征图中相邻元素的最大值,来保留最重要的特征。平均池化操作通过提取特征图中相邻元素的平均值,来平滑特征图并减少噪声。

# 3. CNN的实践应用

### 3.1 图像分类

#### 3.1.1 图像分类任务介绍

图像分类是计算机视觉中的一项基本任务,其目标是将图像分配到预定义的类别中。图像分类在许多实际应用中至关重要,例如:

- **物体识别:**识别图像中存在的物体,例如人、动物或物体。

- **场景理解:**理解图像中描绘的场景,例如室内、室外或自然。

- **医学诊断:**通过分析医学图像(如 X 射线和 MRI)来诊断疾病。

#### 3.1.2 CNN在图像分类中的应用

CNN 已成为图像分类任务的强大工具。其卷积和池化操作使它们能够从图像中提取特征并识别模式。以下是 CNN 在图像分类中的一些常见应用:

- **AlexNet:**2012 年提出的第一个成功的 CNN 架构,它在 ImageNet 图像分类竞赛中取得了突破性成果。

- **VGGNet:**一种更深的 CNN 架构,具有多个卷积层和池化层,在 ImageNet 上实现了更高的准确性。

- **ResNet:**一种引入残差连接的 CNN 架构,可以训练更深的网络而不会出现梯度消失问题。

- **DenseNet:**一种连接所有层的所有层输出的 CNN 架构,可以改善特征重用和梯度传播。

### 3.2 目标检测

#### 3.2.1 目标检测任务介绍

目标检测是计算机视觉中另一项重要的任务,其目标是定位和识别图像中存在的对象。目标检测在许多实际应用中至关重要,例如:

- **自动驾驶:**检测道路上的行人、车辆和其他物体,以实现安全导航。

- **视频监控:**检测可疑活动或人员,以提高安全性。

- **医学影像分析:**检测医学图像(如 X 射线和 MRI)中的病变或异常。

#### 3.2.2 CNN在目标检测中的应用

CNN 也已成功应用于目标检测任务。其卷积和池化操作使它们能够从图像中提取特征并定位对象。以下是 CNN 在目标检测中的一些常见应用:

- **R-CNN:**一种两阶段的目标检测算法,使用 CNN 从图像中提取候选区域,然后对其进行分类和边界框回归。

- **Fast R-CNN:**一种更快的目标检测算法,通过使用区域提议网络(RPN)来生成候选区域。

- **Faster R-CNN:**一种更快的目标检测算法,通过使用区域提议网络(RPN)和共享卷积特征来生成候选区域。

- **YOLO:**一种单阶段的目标检测算法,一次性预测边界框和类概率。

### 3.3 图像分割

#### 3.3.1 图像分割任务介绍

图像分割是计算机视觉中的一项任务,其目标是将图像分割成不同的区域或对象。图像分割在许多实际应用中至关重要,例如:

- **医学影像分析:**分割医学图像(如 MRI 和 CT)中的器官和组织,以进行诊断和治疗规划。

- **自动驾驶:**分割道路上的行人、车辆和其他物体,以实现安全导航。

- **遥感影像分析:**分割卫星图像中的土地覆盖类型,以进行环境监测和规划。

#### 3.3.2 CNN在图像分割中的应用

CNN 也已成功应用于图像分割任务。其卷积和池化操作使它们能够从图像中提取特征并定位对象。以下是 CNN 在图像分割中的一些常见应用:

- **FCN:**一种全卷积网络,可以对图像中的每个像素进行分类,从而实现端到端的图像分割。

- **U-Net:**一种用于生物医学图像分割的 CNN 架构,具有编码器-解码器结构,可以捕获图像的上下文信息。

- **SegNet:**一种用于图像分割的 CNN 架构,使用编码器-解码器结构和池化索引来恢复空间信息。

- **DeepLab:**一种用于图像分割的 CNN 架构,使用空洞卷积来扩大感受野,从而提高分割精度。

# 4.1 深度学习框架和优化算法

### 4.1.1 TensorFlow和PyTorch简介

**TensorFlow**

TensorFlow是一个开源的深度学习框架,由谷歌开发。它提供了一系列高级别API,用于构建和训练机器学习模型。TensorFlow的核心概念是数据流图,它定义了模型的计算流程。

**PyTorch**

PyTorch是一个开源的深度学习框架,由Facebook开发。它采用动态计算图,允许用户在训练过程中动态修改模型结构。PyTorch以其灵活性、易用性和调试友好性而著称。

### 4.1.2 优化算法:梯度下降和反向传播

**梯度下降**

梯度下降是一种优化算法,用于最小化损失函数。它通过迭代地沿着损失函数的负梯度方向更新模型参数来实现。

**反向传播**

反向传播是一种算法,用于计算损失函数相对于模型参数的梯度。它通过从输出层向输入层反向传播误差来实现。

**代码块:使用TensorFlow实现梯度下降**

```python

import tensorflow as tf

# 定义损失函数

loss_fn = tf.keras.losses.MeanSquaredError()

# 定义优化器

optimizer = tf.keras.optimizers.SGD(learning_rate=0.01)

# 训练循环

for epoch in range(100):

# 前向传播

predictions = model(x_train)

loss = loss_fn(y_train, predictions)

# 反向传播

grads = tf.gradients(loss, model.trainable_weights)

# 更新权重

optimizer.apply_gradients(zip(grads, model.trainable_weights))

```

**逻辑分析:**

这段代码使用TensorFlow实现了梯度下降算法。它首先定义了损失函数和优化器。然后,它进入训练循环,其中前向传播计算模型的预测,而反向传播计算损失函数相对于模型参数的梯度。最后,优化器使用梯度更新模型权重。

**参数说明:**

* `x_train`:训练数据输入

* `y_train`:训练数据标签

* `loss_fn`:损失函数

* `optimizer`:优化器

* `learning_rate`:学习率

# 5.1 CNN在计算机视觉领域的最新进展

### 5.1.1 生成对抗网络(GAN)

生成对抗网络(GAN)是一种深度生成模型,它由两个神经网络组成:生成器和判别器。生成器负责生成新的数据样本,而判别器负责区分生成样本和真实样本。通过对抗训练,GAN可以学习生成高度逼真的数据,这在计算机视觉领域具有广泛的应用。

### 5.1.2 Transformer架构

Transformer架构是一种神经网络架构,它最初用于自然语言处理任务。它使用自注意力机制,允许模型在处理序列数据时关注特定部分。Transformer架构已成功应用于计算机视觉领域,例如图像分类和目标检测。

### 代码示例:

```python

import tensorflow as tf

# 定义生成器网络

generator = tf.keras.Sequential([

tf.keras.layers.Dense(128),

tf.keras.layers.ReLU(),

tf.keras.layers.Dense(256),

tf.keras.layers.ReLU(),

tf.keras.layers.Dense(784, activation='sigmoid')

])

# 定义判别器网络

discriminator = tf.keras.Sequential([

tf.keras.layers.Dense(128),

tf.keras.layers.LeakyReLU(),

tf.keras.layers.Dense(256),

tf.keras.layers.LeakyReLU(),

tf.keras.layers.Dense(1, activation='sigmoid')

])

# 训练GAN

for epoch in range(100):

# 训练生成器

with tf.GradientTape() as tape:

noise = tf.random.normal([128, 100])

generated_images = generator(noise)

fake_labels = tf.zeros([128, 1])

loss = tf.keras.losses.binary_crossentropy(fake_labels, discriminator(generated_images))

gradients = tape.gradient(loss, generator.trainable_variables)

optimizer.apply_gradients(zip(gradients, generator.trainable_variables))

# 训练判别器

with tf.GradientTape() as tape:

real_images = ... # 加载真实图像

real_labels = tf.ones([128, 1])

loss = tf.keras.losses.binary_crossentropy(real_labels, discriminator(real_images))

loss += tf.keras.losses.binary_crossentropy(fake_labels, discriminator(generated_images))

gradients = tape.gradient(loss, discriminator.trainable_variables)

optimizer.apply_gradients(zip(gradients, discriminator.trainable_variables))

```

0

0