神经网络训练过程分析:从数据预处理到模型评估,全面掌握训练流程

发布时间: 2024-08-18 02:02:35 阅读量: 23 订阅数: 19

# 1. 神经网络训练概述**

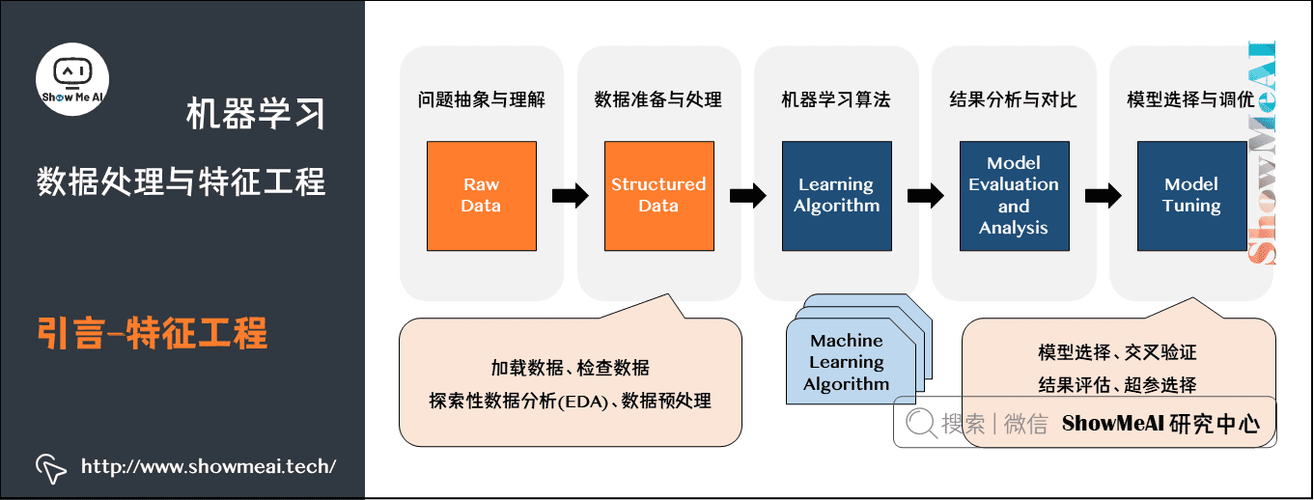

神经网络训练是机器学习领域中一个至关重要的过程,它使神经网络模型能够从数据中学习并执行预测或分类任务。神经网络训练涉及多个步骤,包括数据预处理、模型选择、模型训练和模型评估。

数据预处理是神经网络训练的第一步,它包括收集和清洗数据,以及对数据进行特征工程。特征工程涉及选择、缩放和降维特征,以提高模型的性能。

模型选择是神经网络训练的另一个重要步骤。有各种类型的神经网络模型,每种模型都适用于不同的任务。选择合适的模型对于训练出准确且高效的神经网络至关重要。

# 2. 数据预处理**

**2.1 数据收集和清洗**

数据预处理是神经网络训练的关键步骤,它涉及收集、清理和准备数据,使其适合模型训练。数据收集可以从各种来源进行,例如数据库、传感器或网络爬虫。在收集数据后,需要进行清洗,以处理缺失值、异常值和噪声。数据清洗技术包括:

- **缺失值处理:**使用均值、中位数或众数等方法填充缺失值。

- **异常值处理:**识别并删除明显偏离数据分布的异常值。

- **噪声处理:**使用平滑或滤波技术去除随机噪声。

**2.2 特征工程**

特征工程是将原始数据转换为适合模型训练的特征的过程。特征选择、特征缩放和特征降维是特征工程的关键技术。

**2.2.1 特征选择**

特征选择涉及选择与目标变量最相关的特征。常用的特征选择方法包括:

- **过滤法:**根据统计度量(如相关性或信息增益)对特征进行排序。

- **包装法:**使用机器学习算法评估特征子集的性能。

- **嵌入法:**在模型训练过程中自动选择特征。

**2.2.2 特征缩放**

特征缩放将特征值归一化到特定范围,以提高模型的训练效率。常用的特征缩放方法包括:

- **最小-最大缩放:**将特征值映射到[0, 1]区间。

- **标准化:**将特征值减去均值并除以标准差。

**2.2.3 特征降维**

特征降维将高维数据投影到低维空间,以减少计算成本和提高模型性能。常用的特征降维技术包括:

- **主成分分析(PCA):**将数据投影到方差最大的方向。

- **奇异值分解(SVD):**将数据分解为奇异值、左奇异向量和右奇异向量的乘积。

- **t分布邻域嵌入(t-SNE):**一种非线性降维技术,用于可视化高维数据。

**代码示例:**

```python

# 数据清洗:处理缺失值

import pandas as pd

df = pd.DataFrame({'age': [20, 30, None, 40], 'salary': [2000, 3000, 4000, None]})

df['age'].fillna(df['age'].mean(), inplace=True)

df['salary'].fillna(df['salary'].median(), inplace=True)

# 特征选择:使用过滤法

from sklearn.feature_selection import SelectKBest, chi2

X = df[['age', 'salary']]

y = df['target']

selector = SelectKBest(chi2, k=1)

selector.fit(X, y)

selected_features = X.columns[selector.get_support()]

# 特征缩放:使用标准化

from sklearn.preprocessing import StandardScaler

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 特征降维:使用PCA

from sklearn.decomposition import PCA

pca = PCA(n_components=2)

X_reduced = pca.fit_transform(X)

```

**逻辑分析:**

- 数据清洗:通过填充缺失值和删除异常值,确保数据干净且适合训练。

- 特征选择:选择与目标变量最相关的特征,减少模型复杂度和提高性能。

- 特征缩放:将特征值归一化,确保模型中的所有特征具有相似的尺度。

- 特征降维:将高维数据投影到低维空间,减少计算成本和提高模型可解释性。

# 3.1 神经网络模型类型

神经网络模型有多种类型,每种类型都适用于不同的任务。最常见的类型包括:

- **前馈神经网络 (FFNN)**:最简单的神经网络类型,其中神经元按层排列,信息从输入层向前传播到输出层。

- **卷积神经网络 (CNN)**:专为处理网格状数据(如图像)而设计的,利用卷积操作提取特征。

- **循环神经网络 (RNN)**:处理顺序数据(如文本或时间序列)的网络,具有反馈连接,允许信息在时间步长之间流动。

- **Transformer**:一种基于注意力机制的新型神经网络,在自然语言处理任务中表现出色。

### 3.2 模型超参数优化

超参数是控制神经网络训练过程的参数,例如学习率、批次大小和正则化参数。优化超参数对于获得最佳模型性能至关重要。

#### 3.2.1 学习率

学习率控制权重更新的步长。较高的学习率可能导致不稳定训练,而较低的学习率可能导致收敛缓慢。

#### 3.2.2 批次大小

批次大小是训练中同时处理的数据样本数。较大的批次大小可以提高训练效率,但可能导致梯度估计不准确。

#### 3.2.3 正则化参数

正则化参数用于防止过拟合,即模型在训练数据上表现良好但在新数据上表现不佳的情况。常见正则化参数包括:

- **L1正则化**:惩罚权重的绝对值,导致稀疏解。

- **L2正则化**:惩罚权

0

0