【大数据存储秘籍】:HDFS块大小设置的实践指南

发布时间: 2024-10-29 01:39:46 阅读量: 4 订阅数: 8

# 1. HDFS块大小设置的基础理解

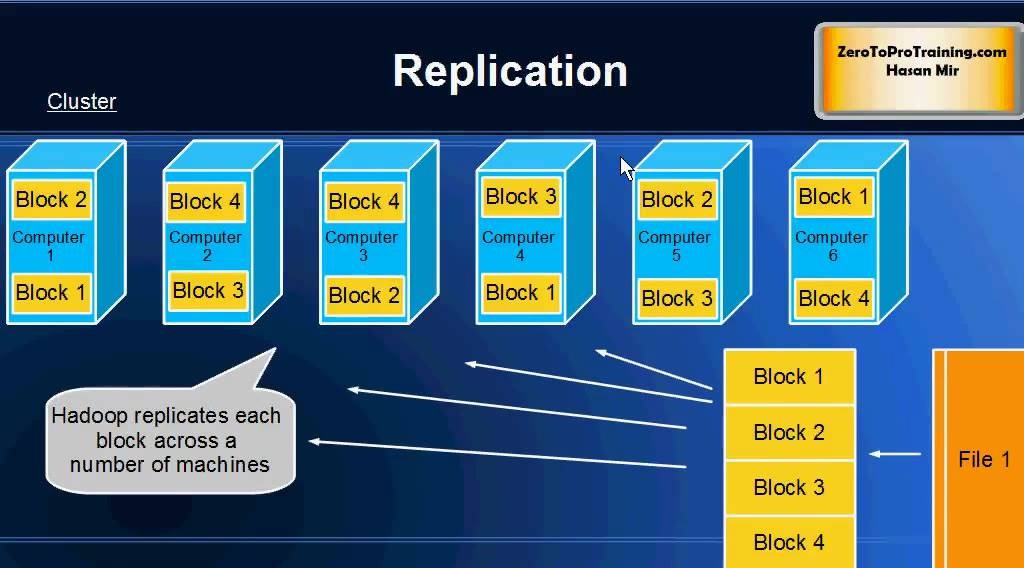

在使用Hadoop分布式文件系统(HDFS)进行大数据存储和处理时,块(block)是一个核心概念。HDFS将大文件分割成固定大小的块,这些块分散存储在集群中的不同节点上。理解HDFS块大小设置的基础对于优化存储和计算性能至关重要。本章将介绍块大小设置的基本知识,为深入理解后续章节中的性能影响、调整策略和高级应用打下坚实的基础。

## 什么是HDFS块大小?

在HDFS中,文件被切分成固定大小的数据块,默认情况下,这些数据块的大小是128MB(在Hadoop 2.x版本之前是64MB),这个大小是可以配置的。这个大小设置对文件系统的性能、存储效率和资源分配有着直接的影响。

## 块大小对性能的基本影响

块大小对HDFS性能的影响主要体现在以下几个方面:

- **读写性能**:较大的数据块意味着单次I/O操作可以读取或写入更多的数据,这在大数据量处理时可以减少I/O操作次数,从而提高性能。

- **网络传输**:网络传输的数据量与块大小成正比,较大的块在传输时可以减少网络交互次数,但同时也增加了单次传输失败的风险。

- **存储开销**:块的大小会直接影响到文件的存储效率,块大小设置不当可能会导致空间利用率降低。

理解块大小的基础设置及其对性能的基本影响是进行HDFS配置和优化的第一步。在接下来的章节中,我们将深入探讨块大小与系统性能的关系,以及如何根据不同的应用场景选择和调整块大小,以达到最优的性能表现。

# 2. HDFS块大小与系统性能的关系

## 2.1 理论分析:块大小对性能的影响

### 2.1.1 数据读取效率分析

在Hadoop分布式文件系统(HDFS)中,块大小对数据读取效率有着显著的影响。数据块是HDFS存储数据的基本单位,客户端在读取文件时,需要与多个DataNode进行通信以获取数据块。块大小的选择直接影响着数据读取的并行度和网络传输的负载。

**读取并行度:** 较小的块大小会增加并行读取的机会,因为单个文件会被分割成更多的块。这有助于提高集群的利用率和响应速度,尤其是在处理许多小文件或随机读取场景中。然而,如果块太小,数据读取的开销(如网络延迟和通信开销)可能超过并行读取带来的好处。

**网络传输:** 较大的块大小减少了管理开销,并减少了需要通信的DataNode数量。在进行顺序读取大数据文件时,更大的块可以有效降低网络通信量,从而提高吞吐量。但是,这也意味着单次读取操作的延迟增加,因为每次读取需要处理更大的数据量。

### 2.1.2 数据写入效率分析

对于数据写入效率,块大小的影响与数据读取类似,但也有其特殊性。在写入过程中,HDFS需要将数据复制到多个DataNode上以保证数据的可靠性和高可用性。这个过程涉及网络带宽和磁盘I/O,块大小在这里起到关键作用。

**写入并行度:** 较小的块大小允许更多的写入并行操作,因为一个文件可以被分割成更多的数据块,并分散到不同的DataNode上。这有助于快速写入大量小文件。但是,它可能增加管理数据块和恢复数据时的复杂性。

**磁盘I/O:** 较大的块大小减少了每个文件的块数量,从而减少了文件元数据的管理开销,并且能够更有效地利用磁盘的顺序读写特性。但是,对于小文件而言,过大的块会浪费磁盘空间,并且可能影响写入性能。

### 2.1.3 块复制与数据恢复效率

块复制是HDFS保证数据可靠性的核心机制之一。在数据复制过程中,块大小决定了网络传输的数据量以及DataNode上磁盘I/O的负载。

**网络传输:** 在块复制过程中,较小的块大小意味着更少的数据需要在网络中传输,从而减少网络带宽的消耗。如果块大小过大,数据复制可能会受到网络带宽的限制,导致整体数据恢复效率降低。

**磁盘I/O与数据恢复:** 较大的块大小会减少复制次数,因为文件被分割成更少的块。这有助于快速完成数据恢复,尤其是在磁盘I/O速度足够快的环境中。然而,如果块大小过大,单个数据块的恢复时间会变得较长,影响整体的系统恢复性能。

## 2.2 实践案例:不同块大小设置的效果对比

### 2.2.1 大数据集处理性能对比

为了更直观地理解块大小对性能的影响,我们可以通过实验来比较不同块大小设置下的大数据集处理性能。

**实验设计:** 在一个具有固定硬件配置的Hadoop集群上,选择一个大数据集作为测试样本,并设置不同的块大小(例如,64MB、128MB、256MB等),分别执行相同的MapReduce作业进行处理。

**性能评估指标:** 评估指标包括总处理时间、CPU使用率、网络传输量以及磁盘I/O活动。

**结果分析:** 实验结果表明,在处理大数据集时,较大的块大小往往能够提供更高的吞吐量和更低的处理时间。这是因为大块可以减少作业中的Map任务数量,从而减少了任务启动和调度的开销。

### 2.2.2 小数据集处理性能对比

与处理大数据集不同,小数据集通常更能体现出较小块大小的优势。

**实验设计:** 在与上节相同或相似的集群环境中,对一个小数据集进行测试,块大小同样设置为多个不同的值。

**性能评估指标:** 除了总处理时间外,还应关注数据读写延迟和系统资源利用率。

**结果分析:** 对于小数据集的处理,实验结果显示较小的块大小可以更好地提高并行度,减少单个任务处理时间,从而缩短整体的处理周期。特别是在多用户并发访问小文件时,小块大小可以显著提高系统的响应速度和吞吐量。

### 2.2.3 块大小调整的实际案例分析

在实际的生产环境中,块大小的调整需要综合考虑实际业务需求和系统性能指标。以下是一个真实的案例分析。

**背景:** 一家在线视频处理公司,需要处理大量的视频数据。最初,该公司将HDFS块大小设置为128MB,但随着业务发展和数据量的增加,系统性能开始出现瓶颈。

**问题诊断:** 经过分析发现,由于视频数据通常是大文件,128MB的块大小导致了太多的Map任务和频繁的网络传输,增加了集群的压力。

**解决方案:** 通过调整块大小为256MB,公司有效地减少了Map任务数量和网络负载。这一调整显著提高了数据处理速度,并减少了CPU和网络资源的使用。

**效果对比:** 调整后,公司观察到处理单个视频文件的时间缩短了约20%,并且系统的总体吞吐量得到了提升。不过,这一改变也带来了更长的数据恢复时间,因为恢复过程需要移动更大的数据块。为此,公司对关键业务数据实施了更高的副本因子,以保证数据安全。

通过这个案例,我们可以看到块大小调整必须与实际应用场景相结合,权衡性能和可靠性的关系,找到最适合的配置。

# 3. HDFS块大小调整的策略与技巧

在前一章节中,我们对HDFS块大小与系统性能的关系进行了深入的分析。在这一章中,我们将从实践的角度探讨如何调整HDFS块大小以优化系统性能,并分享一些具体的策略与技巧。

## 3.1 如何选择合适的块大小

选择正确的块大小对于最大化HDFS的性能至关重要。这一决策应基于数据类型和硬件性能两个主要因素。

### 3.1.1 根据数据类型选择块大小

数据类型的不同会对块大小的选择产生重要影响。例如,对于文本数据,较小的块大小有助于提高MapReduce作业的并行度,而大量连续的读写操作则可能更适合于较大的块大小。

```mermaid

flowchart LR

A[数据类型] --> B[文本数据]

A --> C[

```

0

0