【大数据调优关键】:掌握HDFS块大小的正确调整方法

发布时间: 2024-10-29 02:15:39 阅读量: 4 订阅数: 8

# 1. HDFS块大小的基本概念和重要性

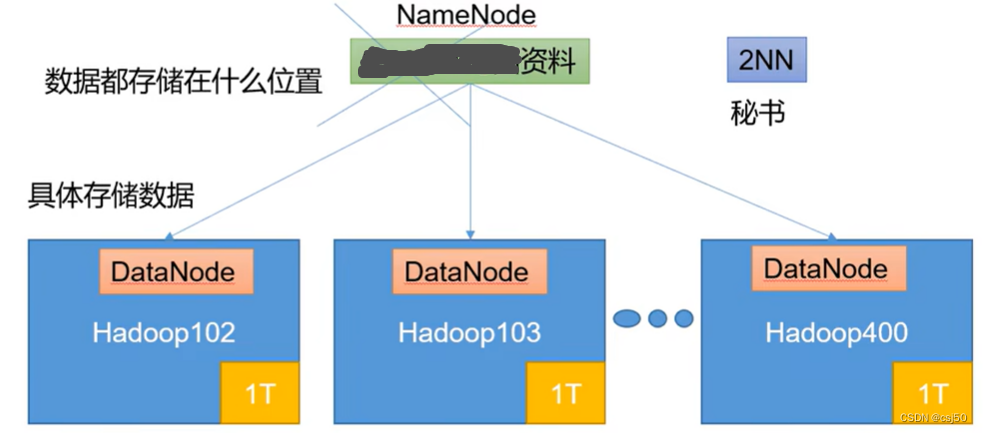

在大数据存储与计算的生态系统中,Hadoop分布式文件系统(HDFS)起着至关重要的角色。HDFS将大文件分割成若干块(block),这些块存储在集群的不同节点上。理解HDFS块大小的基本概念及其重要性是进行性能优化和存储管理的关键。

块大小是HDFS中一个核心的配置参数,它决定了HDFS的数据分布和存储效率。选择合适的块大小对系统的读写性能、存储空间利用率和容错能力都有很大影响。例如,较小的块大小可以提高文件系统的容错能力,因为数据被分散在更多的块中,一个节点的故障影响的数据量会减少;然而,较小的块大小也会增加NameNode的内存压力,并且在处理大量小文件时,会增加系统的元数据开销。

因此,在本章中,我们将探讨HDFS块大小的基础知识,以及为什么选择合适的块大小对Hadoop集群的整体性能至关重要。接下来的章节将深入分析块大小的理论基础和调整原则,并提供调整实践和优化建议,以帮助IT专业人士更好地理解和利用这一关键参数。

# 2. HDFS块大小的理论知识

## 2.1 HDFS块大小的定义和作用

### 2.1.1 块大小的定义

Hadoop分布式文件系统(HDFS)将大文件分割成固定大小的块(block),每个块以独立的文件存储在数据节点(DataNode)上。块大小是HDFS中一个非常基础的参数,它定义了HDFS中文件分块存储的最小单位。默认情况下,HDFS的块大小是128MB,但这个值可以通过配置文件来调整。

块大小的设置对系统的性能有着直接的影响。较大的块大小可以减少NameNode的内存使用,因为它需要跟踪的文件块数量减少了。然而,它也意味着数据的读写操作会更加耗时,因为每次操作都是以块为单位进行的。同时,如果块大小设置过大,可能会导致数据的利用率下降,因为块中可能会有很多未使用的空间。

### 2.1.2 块大小的作用

块大小在HDFS中扮演着几个关键的角色:

1. **并行处理**:在分布式系统中,数据块的大小直接影响到可以并行处理的数据量。较小的块意味着更多的并行机会,而较大的块可能在特定情况下减少并行处理的能力。

2. **网络带宽使用**:块大小也决定了数据传输过程中网络带宽的使用效率。较小的块会导致更多的网络请求,可能会导致网络带宽成为瓶颈;而较大的块则意味着更少但更大的数据传输,可能会改善网络使用效率。

3. **存储空间的优化**:块大小对存储效率也有影响。如果块设置得太大,可能会导致存储空间利用率低;而设置得过小,则可能会导致NameNode元数据的大小急剧增加,因为元数据需要记录更多的块信息。

## 2.2 HDFS块大小的影响因素

### 2.2.1 硬件环境的影响

硬件配置是确定HDFS块大小的重要考虑因素之一。硬件包括存储设备的性能、网络带宽和延迟,以及节点的处理能力等。

1. **存储设备**:如果存储设备速度较快,如使用固态硬盘(SSD),可以考虑使用较大的块大小,以充分利用存储性能。

2. **网络带宽**:在带宽较高的网络环境中,使用较大的块大小可以减少网络传输次数,可能提高性能。但在带宽有限的环境中,较大的块可能会导致网络延迟增加,影响整体性能。

3. **CPU能力**:块处理涉及数据的读写操作,这需要CPU资源。在CPU资源有限的情况下,选择较大的块大小可能会增加单个操作的处理时间。

### 2.2.2 数据特征的影响

不同的数据类型和应用场景对块大小的需求也是不同的。

1. **数据大小**:对于非常大的文件,一个较大的块大小可以减少NameNode的压力,因为它需要管理的块数会减少。然而,对于小文件,使用较大的块可能导致存储空间的浪费。

2. **访问模式**:数据的访问模式也会影响块大小的选择。比如,随机访问模式下,较小的块大小可以提高访问效率;而在顺序访问模式下,较大的块大小可能更适合。

### 2.2.3 系统负载的影响

系统负载水平是决定块大小的另一项重要因素。

1. **负载程度**:在负载较高的系统中,适当增加块大小可以减少NameNode的负载,因为它需要处理的元数据更少。但这可能会对负载较低的系统造成不必要的性能损失。

2. **峰值负载**:在系统处理峰值负载时,使用较大的块可以减少并发操作的数量,可能有助于减少I/O争用。

## 2.3 HDFS块大小的调整原则

### 2.3.1 调整原则的基本理论

调整块大小时需要考虑的原则包括:

1. **平衡NameNode内存使用和存储利用率**:块大小的选择应该能够最小化NameNode的内存使用,同时保证数据块的存储效率。

2. **考虑应用场景**:需要根据应用场景的特点来调整块大小。例如,对于需要快速访问的实时查询系统,可能会倾向于使用较小的块大小。

3. **避免极端值**:既不要选择过大的块大小以至于造成资源浪费,也不要选择过小的块大小导致元数据的压力。

### 2.3.2 调整原则的具体应用

在调整块大小时,可以遵循以下步骤:

1. **数据监控和分析**:定期分析数据访问模式和系统负载,以便对块大小做出合理调整。

2. **模拟和测试**:在调整前,先在测试环境中模拟调整后的效果,确保调整不会引起性能下降。

3. **小步快跑**:每次调整块大小时,变化不宜太大,可以小步快跑,逐步寻找最佳值。

4. **结合实际案例**:考虑从实际业务案例中获取数据,并基于业务特点进行调整。

# 3. HDFS块大小的调整实践

## 3.1 HDFS块大小的调整步骤

### 3.1.1 查看当前块大小

在开始调整块大小之前,首先需要了解当前HDFS集群中数据块的大小设置。可以通过以下命令查看集群中所有目录的默认块大小设置:

```sh

hdfs dfs -ls / | grep ^d

```

这个命令会列出HDFS根目录下的所有目录,并通过管道(`grep`)筛选出那些以字母d(代表目录)开头的行。每一行都包含了目录的名称和块大小信息。

### 3.1.2 调整块大小的方法和步骤

调整HDFS块大小通常涉及集群中所有新写入的数据。要更改默认块大小,需要配置`hdfs-site.xml`文件中的`dfs.block.size`参数。更改此参数后,需要重启HDFS相关服务。

```xml

<configuration>

<property>

<name>dfs.block.size</name>

<value>***</value> <!-- 设置块大小为128MB -->

</property>

</configuration>

```

根据Hadoop版本的不同,块大小的默认值也可能不同。调整后,所有的新文件都将使用新的块大小进行存储。对于已存在的文件,块大小保持不变,除非执行重新写入或者使用特定的工具进行优化。

## 3.2 HDFS块大小的调整实例

### 3.2.1 典型场景的块大小调整实例

假设我们有一个大数据分析场景,数据集非常大,读写负载很高,当前块大小为64MB。通过分析,我们发现性能瓶颈在于过多的小文件导致NameNode内存压力大,因此决定将块大小调整到128MB。

```sh

hdfs dfsadmin -setSpaceS朐Quota -1 /user/hadoop

```

上述命令将用户目录`/user/hadoop`的磁盘配额设置为无限。

随后,修改`hdfs-site.xml`文件并重启HDFS服务。之后,通过`hdfs dfs -ls /`命令查看设置是否生效。

### 3.2.2 调整后的效果观察和分析

调整块大小后,应持续观察集群的性能指标,如NameNode内存使用情况、磁盘I/O、读写延迟等,确保调整带来预期的性能提升。

```sh

hdfs dfsadmin -report

```

此命令能够报告HDFS的整体健康状态和性能指标。

根据监控数据,如果读写性能得到改善,并且小文件问题得到缓解,说明块大小的调整是成功的。如果性能没有提升,可能需要进一步调整其他系统参数或考虑使用更高级的调优方法。

## 3.3 HDFS块大小调整的优化建议

### 3.3.1 常见问题及解决方式

调整块大小时,可能会遇到一些问题,比如调整后未生效或出现性能下降。常见原因是集群中存在未重新格式化的目录,或者部分应用未考虑到块大小的变化。

- **问题**: 如果调整后块大小未生效,首先要检查`hdfs-site.xml`的配置是否正确,然后确保HDFS服务已正确重启。

- **问题**: 如果读写性能下降,可能是由于新块大小不适应当前的工作负载。此时可以考虑结合其他配置参数,比如`dfs.replication`,一同调整,并对现有数据执行数据重组(rebalance)操作。

### 3.3.2 性能优化方法

为了进一步提升性能,可以结合以下优化方法:

- **合理配置副本因子**: 根据数据的重要性和集群的可靠性来合理配置副本因子`dfs.replication`,这样可以减少读写延迟并平衡存储负载。

- **数据本地化**: 优化数据在集群中的物理位置,使得任务尽量在数据所在节点上运行,减少网络传输。

- **HDFS联邦**: 对于非常大的集群,可以使用

0

0