【跨模态创新应用】:结合文本与图像的GAN模型案例

发布时间: 2024-09-05 19:57:43 阅读量: 146 订阅数: 37

# 1. 跨模态GAN模型概述

在人工智能的众多分支中,生成对抗网络(GAN)自2014年由Ian Goodfellow提出以来,便成为了深度学习领域的一个热点话题。特别是跨模态GAN模型,它通过结合不同模态的数据(例如文本和图像),拓展了GAN的应用边界,实现了更为复杂的生成任务。跨模态GAN不仅仅提升了数据生成的质量和多样性,而且推动了人工智能在艺术创作、内容生成等多领域的发展。

跨模态GAN模型通过结合不同模态的数据(例如文本和图像),拓展了GAN的应用边界,实现了更为复杂的生成任务。模型的核心是通过相互竞争的过程来训练生成器和判别器,生成器负责创造逼真的数据,而判别器则要区分生成数据与真实数据。跨模态GAN则在此基础上引入了模态转换机制,通过编码器将一种模态的数据转换为另一种模态,并借助GAN的对抗机制生成高质量的输出。

在接下来的章节中,我们将深入探索跨模态GAN模型的理论基础、技术细节以及实践案例。同时,还会讨论这些模型面临的优化挑战,以及它们如何应用于创意设计、产业创新和对社会伦理、法律的影响。通过系统的分析,我们旨在为相关领域的专业人士提供一个全面而深入的理解。

# 2. 理论基础与数学原理

### 2.1 GAN模型的起源和发展

#### 2.1.1 GAN的基本概念

生成对抗网络(GAN)是由Ian Goodfellow等人在2014年提出的一种新型的深度学习框架,其核心思想是通过对抗过程来实现高精度的生成模型。在GAN中,包含两个网络结构:生成器(Generator)和判别器(Discriminator)。生成器的任务是生成尽可能接近真实样本的假样本,而判别器的任务是对真实样本和生成的假样本进行鉴别。

为了达到最佳效果,生成器和判别器在训练过程中相互竞争:生成器不断尝试制造更难以判别器区分的假样本,判别器则不断提高其鉴别能力。这一过程类似于进化算法中的“适者生存”,因此GAN通常能够生成逼真的数据样本。

```python

# 简单的生成器和判别器的代码示例,以下是一个使用PyTorch框架定义的GAN模型结构。

import torch

import torch.nn as nn

# 定义一个简单的生成器网络

class Generator(nn.Module):

def __init__(self):

super(Generator, self).__init__()

self.main = nn.Sequential(

# 输入层

nn.Linear(in_features, hidden_size),

nn.ReLU(),

# 隐藏层

nn.Linear(hidden_size, hidden_size),

nn.ReLU(),

# 输出层,生成假样本

nn.Linear(hidden_size, out_features)

)

def forward(self, x):

return self.main(x)

# 定义一个简单的判别器网络

class Discriminator(nn.Module):

def __init__(self):

super(Discriminator, self).__init__()

self.main = nn.Sequential(

# 输入层

nn.Linear(in_features, hidden_size),

nn.LeakyReLU(0.2),

# 隐藏层

nn.Linear(hidden_size, hidden_size),

nn.LeakyReLU(0.2),

# 输出层,生成一个0-1之间的分数

nn.Linear(hidden_size, 1),

nn.Sigmoid()

)

def forward(self, x):

return self.main(x)

```

上述代码展示了GAN中生成器和判别器的基础结构,通常在训练过程中,生成器会不断优化其权重以生成更真的假样本,而判别器则会通过反向传播算法逐渐提高其区分真假样本的准确性。

#### 2.1.2 GAN的发展里程碑

GAN自提出之后,迅速成为深度学习领域的重要研究方向。在随后的几年里,GAN经历了多方面的发展,推动了多种变体的出现,比如DCGAN(深度卷积生成对抗网络)、LSGAN(最小二乘生成对抗网络)、WGAN(Wasserstein生成对抗网络)等,这些变体改进了GAN的训练稳定性和生成质量。

其中DCGAN引入了卷积神经网络(CNN)的架构改进了GAN的稳定性和性能,LSGAN通过最小二乘损失函数改进了GAN的训练过程,而WGAN则引入了Wasserstein距离作为损失函数,极大的提升了GAN训练过程的稳定性和生成样本的质量。

### 2.2 GAN模型的数学框架

#### 2.2.1 生成器与判别器的原理

生成器和判别器都是由多层神经网络构成的,它们的训练过程可以看作一个最小-最大博弈过程(Minimax Game),生成器的目标是使判别器错误地将假样本判定为真实样本的概率最大化,而判别器的目标是最大化判定样本真假的概率差。

用数学公式表示,假设真实数据分布为`P_data(x)`,由生成器生成的样本分布为`P_g(x)`,那么在理想状态下,我们希望`P_g(x)`可以无限接近`P_data(x)`。因此,在训练过程中,我们定义优化目标如下:

生成器的目标函数(Jensen-Shannon散度):

\[ \min_G \max_D V(D, G) = \mathbb{E}_{x \sim P_{data}(x)}[\log D(x)] + \mathbb{E}_{z \sim P_z(z)}[\log(1 - D(G(z)))] \]

判别器的目标函数:

\[ \max_D \mathbb{E}_{x \sim P_{data}(x)}[\log D(x)] + \mathbb{E}_{z \sim P_z(z)}[\log(1 - D(G(z)))] \]

生成器的目标是减少真实数据和生成数据在判别器眼中可区分的程度,而判别器则希望尽可能区分二者。

#### 2.2.2 损失函数与优化策略

GAN的损失函数是训练中的关键,最初的GAN使用交叉熵损失函数,但由于存在梯度消失和模式崩塌的问题,后续的研究提出了许多改进的损失函数。例如,WGAN使用Wasserstein距离代替了交叉熵损失函数,它考虑的是两个分布之间的整体差距,而不是分类概率。

此外,WGAN还引入了梯度惩罚技术来保证训练过程的稳定性。这些改进在实践中证明可以有效改善GAN的训练过程,减少训练中的困难,例如训练不稳定、模式崩塌等问题。

```python

# WGAN的损失函数示例

def wasserstein_loss(real_output, fake_output):

return - torch.mean(real_output) + torch.mean(fake_output)

```

### 2.3 跨模态学习的理论支持

#### 2.3.1 模态间差异与桥接技术

跨模态学习指的是学习并理解两种或两种以上不同模态(如文本、图像、语音等)之间的关系,并使这些模态互相转换。在跨模态GAN模型中,桥接技术用于理解不同模态间的关联并进行有效的转换。例如,将文本信息转换为图像,或者将图像信息转换为文本描述。

桥接技术的关键在于建立一个共享的潜在空间,使得不同模态的特征可以在这个空间中进行映射与转换。常用的桥接方法包括了自编码器、变换器(Transformers)、以及多模态融合网络等。

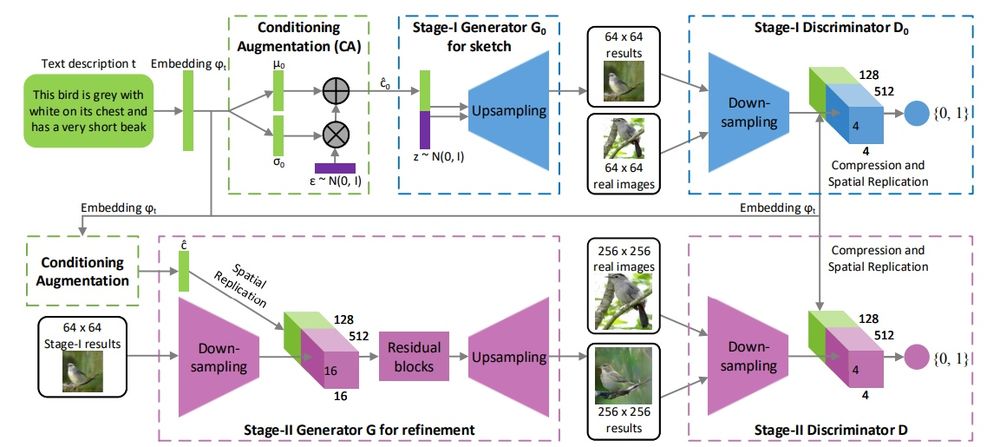

#### 2.3.2 跨模态GAN模型的创新点

跨模态GAN模型结合了GAN的强大生成能力与跨模态学习的优势,使得不同模态之间的转换变得更加自然和高效。该模型的创新点在于不仅仅局限于某一特定的模态转换,例如图像到图像,文本到图像,而是试图学习更广泛、更抽象的模态间关系。

例如,跨模态GAN可以通过学习到的共享表示将自然语言描述转换为相应的视觉图像,或者把图像内容转换为描述性文本。这种转换在某些情况下可以实现惊人的效果,如艺术风格转换、数据增强、以及辅助视觉障碍者等实际应用。

```mermaid

graph LR

A[模态A(例如文本)] -->|编码| B[共享表示]

B -->|解码| C[模态B(例如图像)]

```

在上述mermaid流程图中,我们可以看到从模态A到模态B的转换过程,这个过程涉及编码和解码两个步骤,二者共享一个中间的表示空间,通过这种方式,跨模态GAN模型能够实现模态间的转换和学习。

# 3. 跨模态GAN模型的技术细节

跨模态生成对抗网络(GAN)模型是利用生成对抗机制结合两种或多种不同模态数据(如文本、图像、音频等)的深度学习模型。为了深入理解跨模态GAN模型,本章节将详细探讨其在技术层面上的核心细节,从文本处理与图像编码技术的结合,到模态融合与转换机制的创新,再到模型训练与评估指标的运用。

## 3.1 文本处理与图像编码技术

### 3.1.1 自然语言处理技术概述

在跨模态GAN模型中,文本处理涉及自然语言处理(NLP)技术的运用。NLP是人工智能和语言学领域中用于研究和构建计算机和人类(自然)语言之间交互的子领域。通过NLP技术,计算机能够理解和解释人类语言的含义,即从文本中抽取关键信息,并将这些信息转换为适用于模型处理的形式。

为实现这一目标,文本通常通过一系列的预处理步骤,包括分词、去除停用词、词性标注、依存关系解析等。文本向量化是另一关键步骤,其

0

0