【无监督学习突破】:构建不需要标签的GAN模型

发布时间: 2024-09-05 19:27:15 阅读量: 39 订阅数: 37

深度学习/人工智能/机器学习资料汇总

# 1. 无监督学习与生成对抗网络(GAN)基础

## 1.1 无监督学习简介

在信息技术和人工智能快速发展的今天,无监督学习已经成为研究热点之一,它能够在没有标注数据的情况下自动发现数据中的结构和模式。无监督学习的出现,解决了数据标注成本高昂和标注错误率高的问题,因此在许多领域如图像识别、自然语言处理等有了广泛的应用。

## 1.2 生成对抗网络(GAN)概述

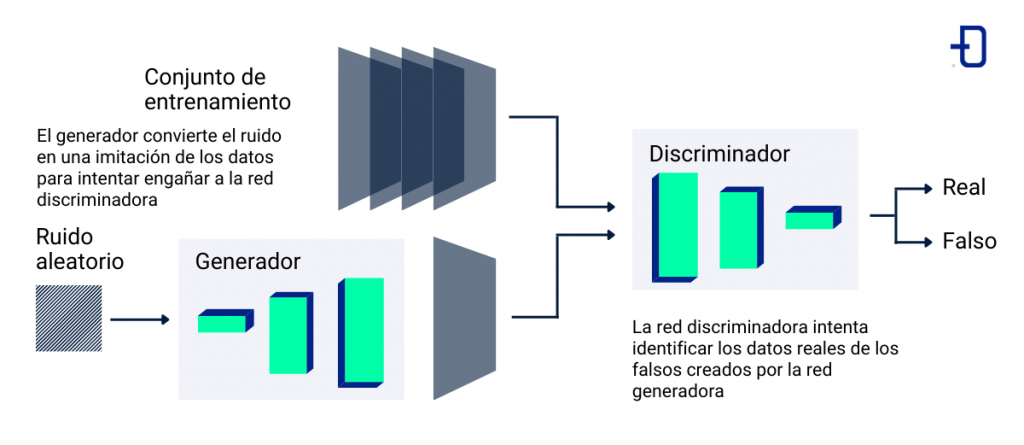

生成对抗网络(GAN)是无监督学习领域的一项重大突破,由Ian Goodfellow在2014年首次提出。GAN包含两个部分:生成器(Generator)和判别器(Discriminator)。生成器负责创建新的数据实例,而判别器评估它们的真实性;随着训练的进行,生成器逐渐学会创建越来越真实的实例。

```python

# GAN基本结构的代码示例

# 假设的简单生成器模型

def generator(z):

return some_tensorflow_or_pytorch_model(z)

# 假设的简单判别器模型

def discriminator(x):

return some_tensorflow_or_pytorch_model(x)

```

## 1.3 GAN的运作机制

GAN的训练过程类似二人博弈,生成器和判别器不断对抗:生成器试图生成足够真实的数据以欺骗判别器,而判别器的目标是准确分辨出真实数据和生成数据。通过这种对抗过程,GAN能够学习数据的潜在分布,从而生成高质量的样本。

GAN的损失函数和训练策略是确保模型能够稳定和高效学习的关键。在实际应用中,研究者们提出多种改进的GAN变体,例如DCGAN、WGAN、StyleGAN等,以解决梯度消失、模式崩溃等问题,并优化生成样本的质量和多样性。

以上的章节内容介绍了无监督学习的基本概念,并概述了生成对抗网络(GAN)的工作原理。通过接下来的章节,我们将深入探讨无监督学习的理论框架,并逐步实践构建和优化无监督GAN模型。

# 2. 无监督学习理论框架

### 2.1 无监督学习概述

无监督学习是机器学习的一个分支,它处理没有标签的数据,目的是找出数据中隐藏的结构和模式。在无监督学习中,算法尝试识别数据之间的内在关系,并不依赖于预定义的输出变量。

#### 2.1.1 无监督学习定义

无监督学习可以理解为从原始数据中提取有用信息的一种方式。这种学习方式不依赖于训练数据中的标签信息,而是寻找数据中的模式和结构。这使得无监督学习在处理大量未标记数据时尤其有用。与监督学习不同,无监督学习不能直接评估学习模型的准确性,因为它没有已知的输出进行比较。

#### 2.1.2 无监督学习的应用场景

无监督学习的应用场景非常广泛,包括但不限于:

- 聚类:根据相似性将数据分组,例如市场细分、社交网络分析等。

- 异常检测:在数据中发现异常值或异常模式,例如欺诈检测、系统监控等。

- 降维:简化数据的表示,例如特征提取、可视化等。

### 2.2 生成对抗网络(GAN)原理

生成对抗网络(GAN)是近年来无监督学习领域的一项突破性技术,它包括两个神经网络:生成器(Generator)和判别器(Discriminator),通过对抗学习的方式共同进步。

#### 2.2.1 GAN的基本概念

GAN是一种深度学习模型,它由两部分组成:

- 生成器(Generator):学习生成看似真实的输出数据。

- 判别器(Discriminator):评估输入数据是真实的还是由生成器制造的。

这两个网络相互竞争,生成器不断提高生成数据的质量,而判别器不断提高识别真实数据与生成数据的能力。理论上,这个过程一直进行下去,直到双方达到一个纳什均衡点。

#### 2.2.2 GAN的工作机制

GAN的工作原理是通过一个最小最大博弈来训练两个网络。生成器生成数据,并试图让判别器相信这些数据是真实的。判别器则评估数据的真实性,并给出一个概率。如果判别器判断数据为真实的概率越来越高,那么生成器就必须改进自己以提高生成数据的质量。

#### 2.2.3 GAN的损失函数和训练策略

GAN的训练目标是最大化判别器正确分类数据的能力,同时最小化生成器被发现是生成数据的概率。这通过一个特定的损失函数来实现,通常包括两部分:一部分是判别器的损失,另一部分是生成器的损失。

### 2.3 无监督学习中的GAN模型

在无监督学习中,GAN模型的应用特别有用,因为它能够处理大量未标记的数据。

#### 2.3.1 无标签数据的挑战

无标签数据是现实世界中的常见情况,因为它通常更易于获取。然而,缺乏标签使得传统的监督学习方法难以应用。在这种情况下,GAN能够通过学习数据的分布来解决这一问题。

#### 2.3.2 GAN如何在无监督学习中应用

GAN能够从无标签数据中学习,然后生成新的数据样本,这在很多应用中非常有用,例如数据增强、异常检测等。GAN的无监督学习能力使其成为处理复杂数据的有效工具。通过适当的设计,GAN能够揭示数据的底层结构,而无需任何标签信息。

至此,我们对无监督学习与生成对抗网络(GAN)的基础知识有了初步了解。在下一章中,我们将深入探讨如何构建无监督GAN模型的实践细节。

# 3. 构建无监督GAN模型实践

## 3.1 GAN模型的构建过程

### 3.1.1 选择合适的网络架构

构建一个无监督的生成对抗网络(GAN)模型需要精心选择合适的网络架构,因为这将直接影响模型的生成质量和稳定性。通常,GAN由两个主要部分组成:生成器(Generator)和判别器(Discriminator)。生成器负责生成尽可能接近真实数据的假数据,而判别器的任务是区分真实数据和生成器产生的假数据。

在选择架构时,需要考虑以下因素:

- **生成器的复杂性**:生成器需要能够捕捉到数据的真实分布,并能够生成高质量的样本。复杂的生成器架构(例如使用深层的卷积神经网络)可以更好地捕捉复杂的模式和分布,但同时也会导致训练更加困难和计算成本更高。

- **判别器的设计**:判别器需要能够精确地识别出生成的数据和真实数据。一个好的判别器应该有足够的能力来区分真实与假象,但又不能太过强大以致于压制生成器的学习过程。

- **网络的对称性**:在传统GAN中,生成器和判别器的网络结构通常是对称的,例如两者都使用相同层数的多层感知机或卷积神经网络。对称性有助于保持训练过程中生成器和判别器之间的竞争平衡。

对于无监督学习环境,一个重要的考虑是数据的类型和特征。例如,图像数据常常使用卷积神经网络架构(如DCGAN),文本数据则可能使用循环神经网络或Transformer网络。对于非标准数据类型或结构,可能需要进行创新的网络设计。

### 3.1.2 模型的初始化和参数选择

在确定了合适的网络架构之后,模型的初始化和参数选择变得至关重要。参数初始化不当可能导致训练过程中的梯度消失或梯度爆炸问题,因此通常需要谨慎选择初始化方法。以下是几个关键步骤:

- **权重初始化**:对于神经网络的权重,可以使用诸如He初始化或Xavier初始化等方法,这些方法都是根据网络层的输入和输出数量来缩放权重值的。

- **偏置初始化**:偏置项通常初始化为0或者一个小的正值,这样可以帮助模型在训练初期避免过大的输出值。

- **学习率选择**:选择合适的学习率对于模型训练至关重要。一般可以从0.001或0.0001这样中等大小的学习率开始尝试,并使用学习率衰减策略或动态调整策略,例如Adam优化器结合的学习率自适应机制。

- **批量大小(Batch Size)**:批量大小的选择取决于数据集的大小和硬件资源。较小的批量可以提供更准确的梯度估计,但会增加计算时间;较大的批量可以提高计算效率,但可能导致梯度估计的方差增大。

以下是一个简单的代码示例,演示如何在PyTorch中初始化一个简单的GAN模型:

```python

import torch

import torch.nn as nn

import torch.optim as optim

# 简单的生成器和判别器网络结构定义

class Generator(nn.Module):

# ...(生成器结构定义)

pass

class Discriminator(nn.Module

```

0

0