Go数学库的并发优化:5个技巧提升大规模数值计算性能

发布时间: 2024-10-21 17:27:44 阅读量: 1 订阅数: 6

# 1. Go语言并发机制概述

Go语言自诞生以来,就以其简洁高效的并发模型而著称。在这一章节,我们将首先介绍Go并发机制的入门知识,为读者打下坚实的基础。

## 1.1 Go并发机制简介

Go语言的并发特性是其区别于其他编程语言的核心优势之一。它通过`goroutine`实现了轻量级的并发执行单元,允许开发者以更简单的方式编写并发程序。Go的并发模型基于`CSP(Communicating Sequential Processes)`模型,这是一种不同于传统线程模型的并发模式,其优势在于提高了并发执行的效率和资源利用率。

## 1.2 并发与并行的区别

在深入讨论Go语言的并发模型之前,我们先明确并发和并行的概念。并发(Concurrency)是指两个或多个事件在宏观上同时发生,但实际上可能是在不同时间间隔交替进行。而并行(Parallelism)则是真正地同时执行多个计算任务。Go语言通过多线程实现并行,而`goroutine`允许我们以较低的开销实现并发。

## 1.3 Go并发的关键特性

Go的并发模型提供了几个关键特性,如易于创建的`goroutine`,以及作为线程安全的通信方式`channel`。`Goroutines`能够高效地在操作系统线程上复用,而`channels`则提供了在并发环境中进行安全通信的机制。这些特性使得Go非常适合处理高并发场景,如网络服务和大规模数据处理。

# 2. ```

# 第二章:Go并发控制的理论基础

## 2.1 Go语言的并发模型

### 2.1.1 goroutine与线程的对比

在Go语言中,`goroutine`是实现并发的核心机制。与传统的线程模型相比,`goroutine`是一种轻量级的线程,由Go运行时调度器管理。在现代操作系统上,创建一个`goroutine`的开销要比创建一个系统线程小得多。一个线程能够支持成千上万个`goroutine`,这使得并发编程变得简单而高效。

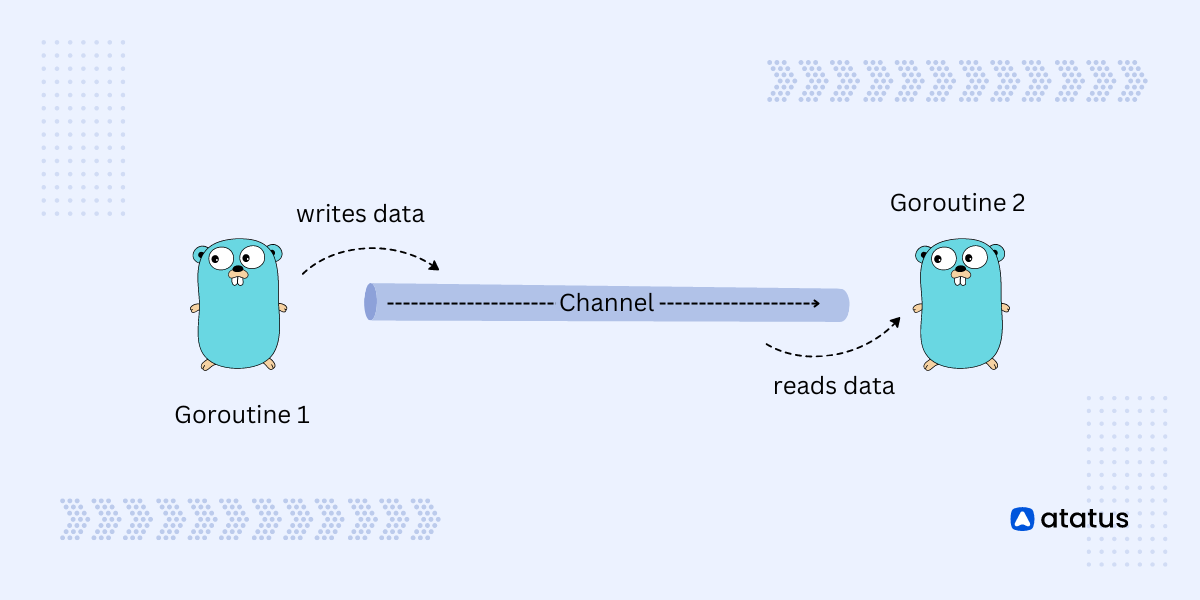

`goroutine`之间通过`channel`进行通信,而传统的线程则通常通过共享内存进行数据交换。`goroutine`的这种通信模型被称为CSP(Communicating Sequential Processes,通信顺序进程),它避免了复杂的锁机制和竞态条件。

### 2.1.2 channel的通信原理

`channel`是Go并发模型中用于不同`goroutine`之间通信的管道。它的设计简化了并发程序的同步问题,因为`channel`遵循了“生产者-消费者”模式。`channel`保证了数据的发送和接收操作是原子性的,这有效地防止了数据竞争。

`channel`可以是有缓冲的也可以是无缓冲的。无缓冲的`channel`在发送和接收数据时需要保证发送方和接收方同时准备好,这可以作为一种同步机制。有缓冲的`channel`则允许数据在缓冲区内暂时存储,直到被消费者读取。这意味着发送操作在缓冲区满之前不会阻塞。

接下来,我们将进一步深入理解并发控制的同步原语。

## 2.2 并发控制的同步原语

### 2.2.1 mutex与rwmutex的使用

`mutex`(互斥锁)是一种常用的同步原语,用于保证多个`goroutine`在访问同一资源时的互斥访问。在Go中,`sync.Mutex`提供了基本的锁定和解锁机制。使用`mutex`时,`goroutine`必须在访问共享资源前锁定`mutex`,并在访问完毕后释放`mutex`。

`rwmutex`(读写互斥锁)是`mutex`的一个变种,它允许多个`goroutine`同时读取数据,但在写入数据时提供互斥保护。这对于读多写少的场景特别有用,因为它能够显著提高并发性能。

```go

import "sync"

var mu sync.Mutex

var sharedResource int

func readResource() {

mu.Lock()

defer mu.Unlock()

// 读取sharedResource

}

func writeResource(value int) {

mu.Lock()

defer mu.Unlock()

// 写入value到sharedResource

}

```

### 2.2.2 WaitGroup和Once的实践技巧

`WaitGroup`是Go并发编程中用于等待一组`goroutine`完成的同步原语。它通过阻塞直到计数器减至零来工作。每个`goroutine`在开始执行时调用`WaitGroup.Add(1)`,在完成执行后调用`WaitGroup.Done()`。主`goroutine`通过`WaitGroup.Wait()`等待所有`goroutine`完成。

`Once`用于确保某个函数只被执行一次,无论`goroutine`数量多少。这对于初始化操作尤其有用,如单例模式下的实例化。

```go

import "sync"

var once sync.Once

var instance *Singleton

func getInstance() *Singleton {

once.Do(func() {

instance = &Singleton{}

})

return instance

}

```

## 2.3 并发性能的度量与分析

### 2.3.1 性能评估的基准测试

Go语言自带的基准测试框架允许开发者编写基准测试函数,并使用`go test`命令来运行这些测试。基准测试函数通常以`Benchmark`为前缀,并接受一个类型为`*testing.B`的参数。通过调用`b.N`,基准测试框架会运行指定的测试函数多次,以评估其性能。

基准测试的一个重要方面是确定测试的精度和稳定性,这通常涉及到对同一测试的多次迭代。Go运行时的性能监控和分析工具,如`pprof`,可以用来进一步分析性能瓶颈。

### 2.3.2 并发程序的性能瓶颈识别

并发程序的性能瓶颈可能包括资源竞争、锁争用、内存分配和垃圾回收等。为了识别这些问题,可以使用Go提供的性能分析工具,例如`pprof`和`trace`。这些工具能够帮助开发者可视化程序的执行路径,从而发现潜在的瓶颈。

`pprof`可以输出程序的CPU和内存使用概况,而`trace`则提供了运行时的完整追踪信息。通过对这些信息的分析,开发者可以找出性能问题的根源,并进行优化。

通过本章节的介绍,我们对Go并发控制的理论基础有了更深入的了解,接下来将探讨数学库并发优化的实践案例。

```

# 3. 数学库并发优化的实践案例

## 3.1 基于并发的数值计算框架

在计算密集型任务中,利用并发能够显著提高任务的执行效率。这一部分将介绍如何设计一个基于并发的数值计算框架,以及如何通过并发实现负载均衡。

### 3.1.1 设计可扩展的并发计算流程

设计一个可扩展的并发计算流程需要对问题进行合理的分解。在Go语言中,可以通过创建多个goroutine来并行执行独立的计算任务。以下是一个简单的并发计算流程设计:

```go

package main

import (

"fmt"

"sync"

)

func compute(id int, data []float64, resultChan chan<- float64, wg *sync.WaitGroup) {

defer wg.Done() // 确保goroutine完成后释放资源

// 执行一些计算任务

result := data[id] * data[id]

resultChan <- result // 将计算结果发送到通道

}

func main() {

const numGoroutines = 5 // 定义goroutine的数量

var wg sync.WaitGroup

// 创建通道用于存储结果

resultChan := make(chan float64, numGoroutines)

// 数据切片

data := []float64{1.1, 2.2, 3.3, 4.4, 5.5}

// 分配任务

for i := 0; i < numGoroutines; i++ {

wg.Add(1) // 为每个goroutine添加计数器

go compute(i, data, resultChan, &wg)

}

// 等待所有goroutine完成

go func() {

wg.Wait()

close(resultChan) // 关闭通道表示所有结果已经发送完毕

}()

// 输出结果

for result := range resultChan {

fmt.Println(result)

}

}

```

在上述代码中,我们创建了`numGoroutines`数量的goroutine,每个goroutine执行独立的计算任务。结果通过`resultChan`通道异步发送回主goroutine,避免了主goroutine的阻塞。使用`sync.WaitGroup`来确保所有的goroutine在主goroutine退出前都已经完成执行。

### 3.1.2 并发任务的负载均衡策略

在并发框架中,为了有效利用资源,需要对任务进行合理分配,避免出现某些goroutine过载,而其他goroutine空闲的情况。一个简单的负载均衡策略可以是静态分配,即预先定义每个goroutine处理的任务范围。然而,当任务处理时间不一致时,更好的策略是动态任务调度。

动态任务调度可以在运行时根据各个goroutine的工作状态来分配新任务,以达到负载均衡。这通常通过一个工作队列来实现,goroutine会从队列中获取任务,直到队列为空。

```go

// 工作队列

type TaskQueue struct {

tasks []task

mu sync.RWMutex

}

func (q *TaskQueue) Enqueue(t task) {

q.mu.Lock()

q.tasks = append(q.tasks, t)

q.mu.Unlock()

}

func (q *TaskQueue) Dequeue() task {

q.mu.RLock()

if len(q.tasks) == 0 {

q.mu.RUnlock()

return nil

}

task := q.tasks[0]

q.tasks = q.tasks[1:]

q.mu.RUnlock()

return task

}

type task struct {

id int

data float64

}

```

在这段代码中,`TaskQueue`是一个简单的任务队列实现,提供了入队和出队操作。通过锁来确保并发环境下任务队列的安全访问。在实际应用中,根据具体场景可以优化任务的排队和分发策略。

## 3.2 优化技巧一:任务划分

合理地划分任务是并发优化的一个重要方面,直接影响到并发的效率。

### 3.2.1 针对不同数学问题的任务粒度调整

根据不同的数学问题特点,调整任务的粒度是提高并发效率的关键。例如,在求解一个大规模线性方程组时,可以将方程组分为几个子集,每个子集由不同的goroutine处理。然而,如果子集划分得太细,会增加goroutine创建和管理的开销;如果太粗,则不能充分利用并发优势。

对于这个问题,可以采用动态任务划分的策略:在计算开始前,先对问题进行预估,动态地调整任务粒度,使得每个goroutine可以处理相似量级的工作。

### 3.2.2 动态任务调度以减少同步开销

动态任务调度需要一种机制来监控每个goroutine的负载状态,并据此决定任务的分配。这通常涉及以下几种策略:

- **工作窃取(Work Stealing)**:允许空闲的goroutine从忙碌的goroutine的任务队列中“窃取”任务。

- **任务合并(Work Combining)**:在任务到达时,优先将小任务合并成大任务分配给空闲的goroutine,以减少任务创建的开销。

- **任务预取(Work Prefetching)**:允许goroutine提前获取一部分任务到本地队列中,以减少等待获取任务的开销。

以上策略可以根据具体问题的特点和并发需求来选择和组合使用。

## 3.3 优化技巧二:内存管理

在并发计算中,内存管理也是一项重要的优化内容,特别是避免内存泄漏和利用对象池。

### 3.3.1 避免并发环境下的内存泄漏

并发程序中的内存泄漏通常是由于goroutine泄露导致的,即有goroutine没有被正确地终止。Go语言在goroutine完成工作后通常会自动清理资源,但当goroutine被无限期阻塞时,它使用的内存将不会被释放。

一种常见的goroutine泄漏情况是无限循环的通道发送或接收操作。在设计并发程序时,应确保每个goroutine都有明确的退出条件。

### 3.3.2 利用sync.Pool优化对象池

在进行大量内存操作的并发计算时,频繁的内存分配和回收会导致性能下降。利用Go语言中的`sync.Pool`可以有效地复用临时对象,减少内存分配的开销。

`sync.Pool`为对象提供了一个可重用的集合池,可以存储一组临时的对象。当程序需要一个对象时,它首先尝试从池中获取一个可用的对象,如果没有可用对象,则通过调用`New`函数来创建一个新的对象。

```go

var pool = sync.Pool{

New: func() interface{} {

return &MyStruct{} // MyStruct是一个复杂对象

},

}

func expensiveOperation() *MyStruct {

obj :=

```

0

0