MapReduce数据转换核心:Map方法的魔法与关键技巧

发布时间: 2024-10-31 04:34:31 阅读量: 49 订阅数: 21

掌握 MapReduce 核心:ReduceTask 数据处理全解析

# 1. MapReduce数据转换概览

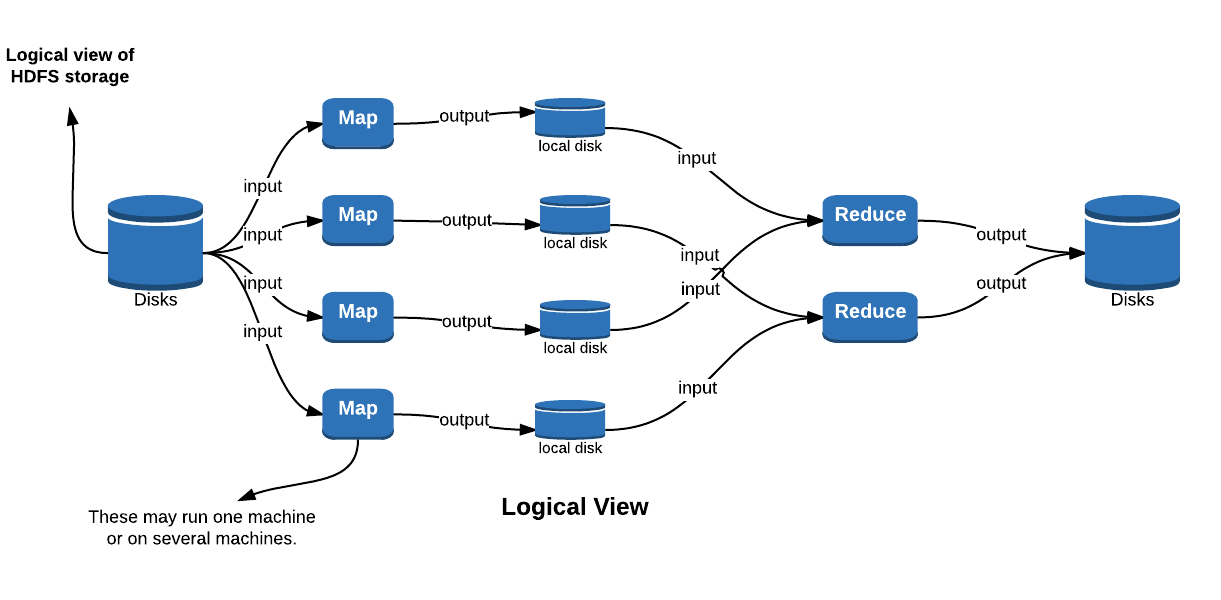

MapReduce是一种编程模型,适用于大规模数据集的并行运算。它通过将运算分为两个阶段:Map和Reduce来简化大数据问题的解决。本章节将为读者提供MapReduce数据转换过程的概览,介绍其基础概念、优势及其在大数据处理中的重要作用。

## 1.1 MapReduce模型简介

MapReduce模型由Google提出,主要分为两个阶段:Map和Reduce。在Map阶段,系统将输入数据集分割成一系列独立的数据块,并将这些数据块分发到不同的处理节点上。每个节点上运行Map函数,对数据进行处理并输出键值对。然后,在Reduce阶段,这些键值对被汇总,并由Reduce函数处理,生成最终结果。

## 1.2 MapReduce的优势

MapReduce模型的优势在于它的可扩展性和容错能力。因为Map和Reduce阶段可以独立并行运行,所以该模型可以很容易地扩展到数百甚至数千个节点。此外,MapReduce框架能够自动处理任务失败的情况,它会重新调度失败的任务到其他节点上执行,保证了数据处理的稳定性和可靠性。

## 1.3 MapReduce在大数据处理中的应用

在大数据处理领域,MapReduce框架被广泛应用于日志分析、数据挖掘、机器学习等场景。其通过简化并行处理流程,使得开发者可以更加专注于业务逻辑的实现,而不必担心底层的分布式计算细节。这使得MapReduce在处理PB级别的数据时,能够表现出强大的处理能力和高效性。

# 2. 深入理解Map方法的原理

### 2.1 MapReduce框架中的Map阶段

MapReduce是一个由Google开发的编程模型,用于处理和生成大数据集。Map阶段是这个模型中最为核心的步骤之一,负责处理输入数据并生成中间键值对。

#### 2.1.1 Map任务的生命周期

Map任务是MapReduce处理过程中最小的工作单位,它负责将输入数据集分割成多个片段,并为每个片段创建一个Map任务实例。每个Map任务的生命周期可以分为以下几个阶段:

- **初始化**:Map任务被创建时,首先进行初始化,此时会加载输入数据,并准备必要的资源。

- **读取**:初始化后,Map任务开始读取输入数据。读取的数据会被分割成一定大小的块,每个块作为一个输入分片(split)处理。

- **处理**:对每个输入分片,Map任务会执行用户定义的Map函数,将输入分片转换成一系列的中间键值对(key-value pairs)。

- **写入**:处理完成后,Map任务会将中间键值对排序并写入到磁盘上。排序通常是为了优化后续的Reduce阶段。

- **清理**:输出写入磁盘后,Map任务会进行清理工作,包括释放资源和记录状态。

#### 2.1.2 输入数据的划分和分发

MapReduce框架采用数据局部性原则来提高处理效率,将输入数据划分为多个数据分片,并将这些分片分发到不同的Map任务中去执行。数据分片的策略对性能有重要影响。

- **分片策略**:常见的分片策略是按照数据的存储位置(如HDFS的块)来划分,保证每个Map任务在本地或靠近本地的节点上读取输入数据,减少网络传输的开销。

- **分发机制**:框架根据可用的Map槽来动态分配任务。例如,在Hadoop中,NameNode会分配任务给DataNode,DataNode在本地执行相应的Map任务。

### 2.2 Map方法的内部工作机制

Map方法的内部工作机制是理解和优化MapReduce性能的关键。深入理解其工作机制有助于我们更好地设计Map函数以适应不同的应用场景。

#### 2.2.1 键值对的生成与处理流程

键值对的生成是Map方法的基础。输入数据被处理为键值对是为后续的排序和合并操作做准备。

- **数据读取**:首先,Map任务读取原始输入数据,通常是文本文件或其他格式化数据源。

- **分割**:数据会被分割成多个输入记录,每个记录通常对应一个键值对。

- **处理**:Map函数对每个记录进行处理,生成中间键值对。处理过程中,键值对的键用于将数据分组,以便在Reduce阶段进行汇总。

- **输出**:中间键值对被输出到磁盘之前,通常会经过一个可选的Combiner函数进行局部规约,以减少数据传输量。

#### 2.2.2 Map函数的执行环境

Map函数在执行时拥有一定的执行环境,了解这些环境可以更好地优化Map任务。

- **用户定义代码**:Map函数是用户根据业务逻辑自定义的代码部分,框架负责提供输入输出接口。

- **环境参数**:Map任务可以在其执行环境中获取一些系统参数,例如Map输入的数据大小、执行的主机名等。

- **执行限制**:Map函数的执行可能会受到内存和CPU资源的限制。如果超出限制,任务可能会失败。

### 2.3 Map输出的组织与优化

Map输出的组织和优化对于整个MapReduce作业的效率至关重要,良好的组织结构可以显著提高Reduce阶段的处理速度。

#### 2.3.1 Map输出的排序与合并

排序是Map输出的关键步骤,它有助于在后续的Reduce阶段更快地执行。

- **排序**:Map输出首先会根据键进行局部排序,局部排序可以减少网络传输的数据量。

- **合并**:如果Map任务有多个,其输出结果会进行合并。合并过程中还会进行二次排序,以便为Reduce阶段提供有序的数据。

- **Shuffle**:排序和合并过程统称为Shuffle过程,是MapReduce性能优化的关键点。

#### 2.3.2 Map输出对Reduce阶段的影响

Map输出的质量直接影响到Reduce阶段的处理效率和最终结果的准确性。

- **数据倾斜**:若Map输出在某些键上数据量过大,会导致Reduce阶段数据倾斜,影响整体处理速度。

- **负载均衡**:合理地控制Map输出的数据量和分布,可以提高Reduce任务的负载均衡。

- **性能调优**:在Map输出的环节,通过合理配置分区策略、内存使用和Shuffle行为,可以显著提升整个作业的性能。

在下一章节中,我们将深入探讨Map方法的关键技巧与实践,包括数据清洗、聚合操作以及性能调优等。通过实际案例的分析,我们将展示如何在实际应用中有效地应用这些技巧,以提升数据处理的效率和质量。

# 3. Map方法的关键技巧与实践

Map方法在MapReduce框架中占据着至关重要的地位。它不仅处理着原始数据的初步分析,而且也是优化整个数据处理流程的关键。第三章将深入探讨Map方法实践中的关键技巧,包括数据清洗与预处理、Map端聚合与局部规约,以及性能调优。这些技巧对于提高MapReduce作业的效率和可靠性至关重要。

## 3.1 数据清洗与预处理

数据清洗与预处理是数据处理流程的起点,关系到后续分析的质量。Map方法提供了初步的数据清洗功能,确保数据在进入Reduce阶段前达到高质量标准。

### 3.1.1 数据格式化与标准化

数据在收集后往往包含不一致、不完整或格式混乱等问题。格式化和标准化是Map方法中重要的数据清洗步骤。

**代码实践示例:**

```python

import re

def clean_and_normalize(line):

# 移除非字母数字字符

line = re.sub(r'\W+', '', line)

# 标准化空格

line = line.replace('\t', ' ').replace('\n', ' ').strip()

# 转换为小写

return line.lower()

# 假设这是从输入文件中读取的一行文本

input_line = "Example Input Line with White spaces\tand Special#Characters!!"

normalized_line = clean_andnormalize(input_line)

print(normalized_line)

```

**逻辑分析和参数说明:**

上述代码使用了正则表达式来去除文本中的非单词字符,将制表符、换行符替换为单个

0

0