拉取数据智慧:优化MapReduce中的数据传输效率

发布时间: 2024-10-31 04:57:49 阅读量: 32 订阅数: 40

基于Java定时拉取股票数据的股票市场研究设计源码

# 1. MapReduce概述与数据传输重要性

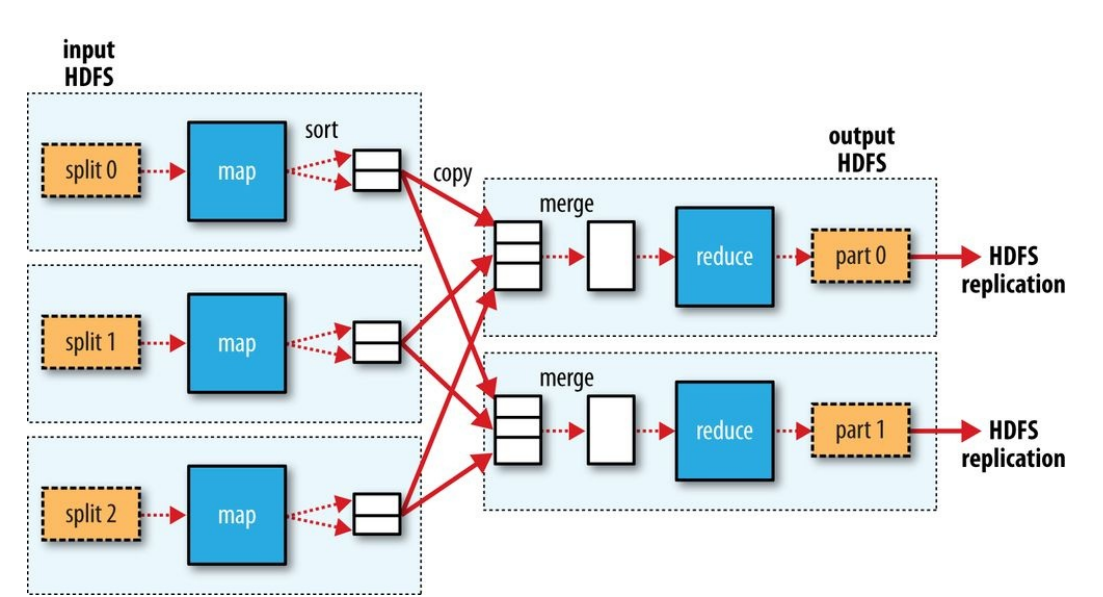

MapReduce作为一种分布式计算框架,被广泛应用于大规模数据集的处理与分析中。在当今数据驱动的时代,MapReduce通过将任务分解为Map和Reduce两个阶段,允许开发者以简化的编程模型来执行复杂的计算任务。数据传输作为MapReduce操作的关键组成部分,其效率直接影响整体处理速度和系统的扩展能力。本文将探讨MapReduce框架的基础原理,并着重分析数据传输的重要性,为后续章节深入研究数据传输理论和效率优化实践奠定基础。

在MapReduce的执行过程中,从数据读取、处理到结果输出的每一个环节都涉及到数据的传输。数据传输效率的高低不仅决定了数据处理的速度,还与集群的资源利用率和作业的完成质量紧密相关。因此,理解数据传输的重要性并掌握优化技巧,对于提升MapReduce作业的性能至关重要。在后续章节中,我们将详细探讨数据传输的理论基础,包括工作原理、理论模型和影响因素,以及如何通过实践技巧来优化数据传输效率,最终对MapReduce在现代数据处理中的应用进行深入分析和展望。

# 2. MapReduce数据传输理论基础

### 2.1 MapReduce工作原理

#### 2.1.1 Map阶段详解

MapReduce模型中,Map阶段是处理输入数据的第一步。在Map阶段,Map任务读取输入数据,将其解析成键值对(key-value pair),然后对这些键值对进行用户定义的Map函数处理。Map函数对每个键值对执行相同的操作,最终生成一系列中间键值对。

```java

// Java伪代码示例

map(String key, String value):

// key: document name

// value: document contents

for each word w in value:

EmitIntermediate(w, "1");

```

在上述伪代码中,每个单词都会被映射成键值对形式,其中键是单词,值是出现次数(这里简化的表示为"1")。Map任务需要在内存中处理数据,当达到一定的阈值或数据完全处理后,这些中间键值对会被写入到本地磁盘。

Map阶段的输出是排序后的中间键值对,这为后续的Shuffle和Reduce阶段做准备。排序是按照键的字典顺序进行的,目的是确保相同键的所有值都聚集在一起,方便后续的合并操作。

#### 2.1.2 Reduce阶段详解

Reduce阶段的任务是对Map阶段输出的中间键值对进行合并。在Reduce阶段,所有的中间键值对根据键聚集到一起后,系统会自动调用用户定义的Reduce函数。

```java

// Java伪代码示例

reduce(String key, Iterator values):

// key: a word

// values: a list of counts

result = 0;

for each v in values:

result += ParseInt(v);

Emit(key, IntToString(result));

```

在这个伪代码中,Reduce函数对所有具有相同键的值进行累加计算,最终输出新的键值对,键仍然是单词,但值是单词出现的总次数。Reduce函数的执行会触发一系列操作,包括Shuffle和Sort,确保所有具有相同键的中间结果被传递到同一个Reduce任务。

### 2.2 数据传输的理论模型

#### 2.2.1 数据分区与Shuffle机制

在MapReduce框架中,Shuffle机制是指在Map阶段和Reduce阶段之间发生的复杂数据传输过程。Shuffle过程确保了所有相关的中间数据被传递给对应的Reduce任务,以便进行合并操作。这个过程可以分为三个主要步骤:

1. **数据分区**:Map任务完成处理后,会根据Reduce任务的数量,将中间键值对数据分区。每个分区对应一个Reduce任务。这一步骤确保了数据将被发送到正确的目的地。

2. **排序**:每个分区内的中间键值对会根据键进行排序。这样,具有相同键的值将聚集在一起,方便后续的合并。

3. **数据传输**:排序后的数据通过网络传输到对应的Reduce任务。这个传输过程可能会跨越多个网络节点,增加延迟,影响性能。

Shuffle过程是MapReduce计算模型中的一个关键步骤,其性能对整体计算效率有着直接的影响。

#### 2.2.2 数据传输过程中的瓶颈分析

数据传输过程中的瓶颈是MapReduce性能优化中的一个重要考量因素。瓶颈可能出现在以下几个方面:

1. **网络带宽**:如果网络带宽有限,大量的数据传输可能导致网络拥塞,增加延迟,降低吞吐量。

2. **磁盘I/O**:在Map和Reduce任务中,中间数据的磁盘读写操作可能会成为瓶颈。频繁的磁盘操作会增加I/O开销,影响性能。

3. **CPU处理能力**:在Map和Reduce任务的处理过程中,如果CPU处理速度不够快,那么数据的处理速度也会受限。

4. **内存管理**:MapReduce任务中可能会使用大量的内存,如果内存管理不当,可能会造成内存泄漏、频繁的垃圾回收等问题,影响性能。

针对这些潜在的瓶颈,MapReduce开发者可以采取多种优化措施,如优化网络通信协议、使用高效的磁盘I/O操作、平衡CPU负载和内存分配等。

### 2.3 数据传输效率的影响因素

#### 2.3.1 网络带宽与延迟

网络带宽和延迟是影响MapReduce数据传输效率的关键因素。网络带宽决定了在单位时间内可以传输多少数据,而网络延迟则影响了请求和响应之间的时间间隔。

网络带宽不足时,数据传输可能成为瓶颈,特别是在处理大规模数据集时。通过网络优化策略,如数据压缩、合理的网络拓扑设计等,可以减少对带宽的需求。

网络延迟对于实时或近实时处理尤为重要。低延迟的网络设计可以加快数据传输速度,提高处理效率。例如,可以采用更快的网络硬件或者优化网络路由算法。

#### 2.3.2 节点处理能力与资源分配

节点处理能力和资源分配也是影响数据传输效率的重要因素。在MapReduce模型中,节点的处理能力决定了数据处理的速度,资源分配包括CPU、内存和磁盘等资源的分配。

如果节点的处理能力不足,即使网络和存储资源充足,数据处理的速度也会受到限制。因此,合理地分配资源对于提高数据传输效率至关重要。例如,通过动态资源调度策略,根据工作负载和任务需求来动态调整资源分配。

资源的合理分配还包括任务调度策略,确保任务在最佳的资源上执行。这可能需要复杂的调度算法,如基于优先级的任务调度,或者使用负载均衡策略来防止某些节点过载,而其他节点空闲。

[下接第三章]

# 3. 提升MapReduce数据传输效率的实践技巧

MapReduce框架是处理大规模数据集的核心,其效率在很大程度上取决于数据传输的效率。随着数据量的不断增长,如何优化数据传输成为提高MapReduce性能的关键。本章

0

0