揭秘机器学习中的概率分布奥秘:高斯混合模型(GMM)入门指南

发布时间: 2024-08-19 21:26:12 阅读量: 56 订阅数: 25

高斯混合模型GMM和AdaBoost

# 1. 机器学习中的概率分布简介

概率分布是机器学习中描述随机变量行为的基础概念。它提供了随机变量取值的可能性分布,对于理解和建模数据至关重要。

### 1.1 概率密度函数和分布函数

概率密度函数 (PDF) 描述了随机变量取特定值的概率。它是一个非负函数,其积分在整个实数域上为 1。分布函数 (CDF) 是 PDF 的积分,它给出随机变量小于或等于特定值的概率。

### 1.2 多元正态分布

多元正态分布是一种常见的概率分布,用于建模具有多个维度的随机变量。它由均值向量和协方差矩阵参数化,描述了变量之间的相关性。多元正态分布在机器学习中广泛用于数据建模和分类。

# 2. 高斯混合模型(GMM)的理论基础

### 2.1 概率论基础

#### 2.1.1 概率密度函数和分布函数

**概率密度函数(PDF)**描述了随机变量在特定值或值范围内的概率分布。对于连续随机变量,PDF 为非负函数,其积分在整个实数范围内为 1。

**分布函数(CDF)**给出了随机变量小于或等于给定值的概率。它是 PDF 的积分,并且在无穷大处为 1。

#### 2.1.2 多元正态分布

多元正态分布是高斯混合模型的基础。它描述了具有多个维度的随机变量的联合分布。其 PDF 为:

```

f(x) = (2π)^(-d/2) |Σ|^(-1/2) exp(-1/2 (x - μ)^T Σ^(-1) (x - μ))

```

其中:

- `x` 是 d 维随机变量

- `μ` 是均值向量

- `Σ` 是协方差矩阵

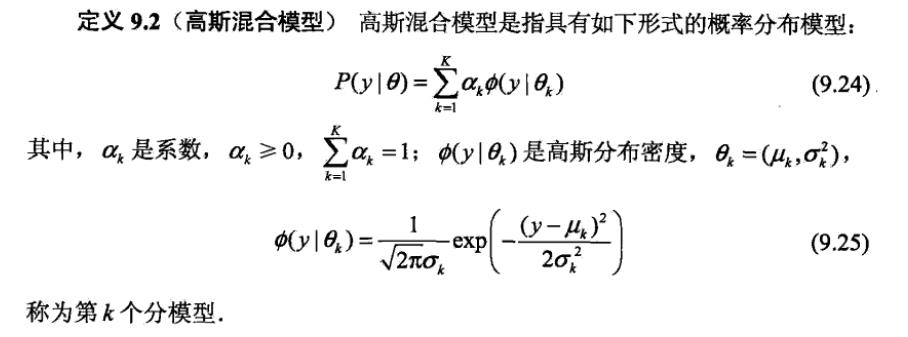

### 2.2 高斯混合模型的数学原理

#### 2.2.1 GMM 的定义和参数

高斯混合模型(GMM)是一种概率模型,它假设数据是由多个正态分布的混合生成的。GMM 的参数包括:

- **混合系数 π**:每个正态分布的权重,表示其在混合中的概率。

- **均值向量 μ**:每个正态分布的中心。

- **协方差矩阵 Σ**:每个正态分布的方差和协方差。

#### 2.2.2 GMM 的概率密度函数

GMM 的概率密度函数 (PDF) 为:

```

f(x) = ∑_{k=1}^K π_k f_k(x)

```

其中:

- `x` 是 d 维随机变量

- `K` 是正态分布的数量

- `π_k` 是第 k 个正态分布的混合系数

- `f_k(x)` 是第 k 个正态分布的 PDF

**代码块:**

```python

import numpy as np

from scipy.stats import multivariate_normal

# 定义 GMM 参数

K = 3 # 正态分布数量

pi = np.array([0.3, 0.4, 0.3]) # 混合系数

mu = np.array([[0, 0], [1, 1], [2, 2]]) # 均值向量

Sigma = np.array([[[1, 0], [0, 1]], [[1, 0], [0, 1]], [[1, 0], [0, 1]]]) # 协方差矩阵

# 计算 GMM PDF

x = np.array([0.5, 0.5])

pdf = 0

for k in range(K):

pdf += pi[k] * multivariate_normal.pdf(x, mean=mu[k], cov=Sigma[k])

print(pdf)

```

**逻辑分析:**

该代码片段使用 `multivariate_normal` 函数计算 GMM 的 PDF。它首先定义 GMM 的参数,包括混合系数、均值向量和协方差矩阵。然后,它遍历每个正态分布,计算每个分布的 PDF 并将其乘以混合系数。最后,它将所有分布的 PDF 相加以获得 GMM 的 PDF。

# 3. 高斯混合模型的实践应用

### 3.1 GMM的参数估计

#### 3.1.1 最大似然估计法

最大似然估计法(MLE)是一种估计模型参数的方法,其目标是找到一组参数,使模型对观测数据的似然函数最大化。对于GMM,似然函数为:

```python

L(θ) = ∏_{i=1}^{N} ∑_{k=1}^{K} p(x_i | θ_k)

```

其中:

* θ是GMM的参数,包括均值、协方差和混合系数

* x_i是第i个观测数据

* θ_k是第k个分量模型的参数

* p(x_i | θ_k)是第i个观测数据属于第k个分量模型的概率

通过求解似然函数的极大值,可以得到GMM的参数估计值。

#### 3.1.2 期望最大化(EM)算法

EM算法是一种迭代算法,用于估计具有隐变量的模型的参数。对于GMM,隐变量是观测数据属于哪个分量模型。EM算法的步骤如下:

1. **E步:**计算观测数据属于每个分量模型的后验概率:

```python

p(z_i = k | x_i, θ) = p(x_i | θ_k) / ∑_{j=1}^{K} p(x_i | θ_j)

```

2. **M步:**更新GMM的参数:

```python

θ_k = argmax_θ_k ∑_{i=1}^{N} p(z_i = k | x_i, θ) log p(x_i | θ_k)

```

3. **重复步骤1和2,直到参数收敛。**

### 3.2 GMM的聚类和分类

#### 3.2.1 聚类算法

聚类是一种无监督学习技术,其目标是将数据点分组到不同的簇中。GMM可以用于聚类,方法是将每个分量模型视为一个簇。聚类算法的步骤如下:

1. **初始化GMM的参数。**

2. **使用EM算法估计GMM的参数。**

3. **将每个数据点分配到具有最高后验概率的分量模型。**

#### 3.2.2 分类算法

分类是一种监督学习技术,其目标是将数据点分类到不同的类别中。GMM可以用于分类,方法是将每个分量模型视为一个类别。分类算法的步骤如下:

1. **使用带标签的数据训练GMM。**

2. **对于新的数据点,计算其属于每个分量模型的后验概率。**

3. **将数据点分类到具有最高后验概率的分量模型。**

# 4. 高斯混合模型的进阶应用

高斯混合模型(GMM)在计算机视觉和自然语言处理等领域有着广泛的应用。在这些领域,GMM可以有效地解决聚类、分类和建模等问题。

### 4.1 GMM在计算机视觉中的应用

#### 4.1.1 图像分割

GMM在图像分割中扮演着重要的角色。图像分割的目标是将图像划分为具有不同特征的区域。GMM通过将每个像素点建模为一个GMM,可以有效地识别出图像中的不同区域。

**代码块:**

```python

import numpy as np

import cv2

# 加载图像

image = cv2.imread('image.jpg')

# 将图像转换为浮点型

image = image.astype(np.float32)

# 将图像转换为Lab颜色空间

image = cv2.cvtColor(image, cv2.COLOR_BGR2Lab)

# 创建GMM模型

gmm = cv2.createGaussianMixture(nmixtures=5)

# 训练GMM模型

gmm.train(image, cv2.TermCriteria_EPS | cv2.TermCriteria_MAX_ITER, 10, 1e-6)

# 获取GMM模型的聚类标签

labels = gmm.predict(image)

# 可视化聚类结果

segmented_image = np.zeros_like(image)

for i in range(gmm.nclusters):

segmented_image[labels == i] = (0, 255, 0)

cv2.imshow('Segmented Image', segmented_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

**逻辑分析:**

* `cv2.createGaussianMixture(nmixtures=5)`:创建了一个具有5个高斯分布的GMM模型。

* `gmm.train(image, cv2.TermCriteria_EPS | cv2.TermCriteria_MAX_ITER, 10, 1e-6)`:使用EM算法训练GMM模型,最大迭代次数为10,终止条件为变化量小于1e-6。

* `gmm.predict(image)`:使用训练好的GMM模型对图像中的每个像素点进行聚类,并返回聚类标签。

* `segmented_image = np.zeros_like(image)`:创建一个与原始图像大小相同的零矩阵,用于存储聚类结果。

* `for i in range(gmm.nclusters)`:遍历GMM模型中的所有高斯分布。

* `segmented_image[labels == i] = (0, 255, 0)`:将属于第i个高斯分布的像素点标记为绿色。

#### 4.1.2 目标检测

GMM还可以用于目标检测。目标检测的目标是识别图像中特定对象的边界框。GMM通过将目标区域建模为一个GMM,可以有效地识别出目标对象。

**代码块:**

```python

import numpy as np

import cv2

# 加载图像

image = cv2.imread('image.jpg')

# 将图像转换为浮点型

image = image.astype(np.float32)

# 将图像转换为HSV颜色空间

image = cv2.cvtColor(image, cv2.COLOR_BGR2HSV)

# 创建GMM模型

gmm = cv2.createGaussianMixture(nmixtures=5)

# 训练GMM模型

gmm.train(image, cv2.TermCriteria_EPS | cv2.TermCriteria_MAX_ITER, 10, 1e-6)

# 获取GMM模型的聚类标签

labels = gmm.predict(image)

# 查找目标区域

target_label = 3 # 假设目标区域属于第3个高斯分布

target_mask = np.where(labels == target_label, 1, 0)

# 膨胀目标区域

kernel = np.ones((5, 5), np.uint8)

target_mask = cv2.dilate(target_mask, kernel)

# 查找目标区域的边界框

contours, _ = cv2.findContours(target_mask, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

x, y, w, h = cv2.boundingRect(contours[0])

# 绘制目标区域的边界框

cv2.rectangle(image, (x, y), (x + w, y + h), (0, 255, 0), 2)

cv2.imshow('Detected Object', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

**逻辑分析:**

* `cv2.createGaussianMixture(nmixtures=5)`:创建了一个具有5个高斯分布的GMM模型。

* `gmm.train(image, cv2.TermCriteria_EPS | cv2.TermCriteria_MAX_ITER, 10, 1e-6)`:使用EM算法训练GMM模型,最大迭代次数为10,终止条件为变化量小于1e-6。

* `gmm.predict(image)`:使用训练好的GMM模型对图像中的每个像素点进行聚类,并返回聚类标签。

* `target_label = 3`:假设目标区域属于第3个高斯分布。

* `target_mask = np.where(labels == target_label, 1, 0)`:创建一个掩码,其中目标区域的像素点为1,其他像素点为0。

* `target_mask = cv2.dilate(target_mask, kernel)`:膨胀目标区域,以增加其大小。

* `contours, _ = cv2.findContours(target_mask, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)`:查找目标区域的轮廓。

* `x, y, w, h = cv2.boundingRect(contours[0])`:获取目标区域的边界框坐标。

* `cv2.rectangle(image, (x, y), (x + w, y + h), (0, 255, 0), 2)`:在图像上绘制目标区域的边界框。

### 4.2 GMM在自然语言处理中的应用

#### 4.2.1 文本聚类

GMM在文本聚类中扮演着重要的角色。文本聚类的目标是将文本文档划分为具有相似内容的组。GMM通过将每个文档建模为一个GMM,可以有效地识别出文本文档中的不同主题。

**代码块:**

```python

import numpy as np

import sklearn.feature_extraction.text as text

from sklearn.cluster import GaussianMixture

# 加载文本文档

documents = ['document1.txt', 'document2.txt', 'document3.txt', 'document4.txt', 'document5.txt']

# 提取文本特征

vectorizer = text.TfidfVectorizer()

X = vectorizer.fit_transform(documents)

# 创建GMM模型

gmm = GaussianMixture(n_components=3)

# 训练GMM模型

gmm.fit(X)

# 获取GMM模型的聚类标签

labels = gmm.predict(X)

# 打印聚类结果

for i in range(gmm.n_components):

print(f'Cluster {i}:')

for j in range(len(documents)):

if labels[j] == i:

print(f'\t{documents[j]}')

```

**逻辑分析:**

* `vectorizer = text.TfidfVectorizer()`:创建了一个TF-IDF向量化器,用于提取文本文档的特征。

* `X = vectorizer.fit_transform(documents)`:使用TF-IDF向量化器提取文本文档的特征,并将其转换为一个NumPy数组。

* `gmm = GaussianMixture(n_components=3)`:创建了一个具有3个高斯分布的GMM模型。

* `gmm.fit(X)`:使用EM算法训练GMM模型。

* `labels = gmm.predict(X)`:使用训练好的GMM模型对文本文档进行聚类,并返回聚类标签。

* `for i in range(gmm.n_components)`:遍历GMM模型中的所有高斯分布。

* `for j in range(len(documents))`:遍历所有文本文档。

* `if labels[j] == i`:如果文本文档j属于第i个高斯分布,则打印其名称。

#### 4.2.2 主题模型

GMM还可以用于主题模型。主题模型的目标是发现文本文档中潜在的主题。GMM通过将每个主题建模为一个GMM,可以有效地识别出文本文档中的不同主题。

**代码块:**

```python

import numpy as np

import sklearn.feature_extraction.text as text

from sklearn.decomposition import LatentDirichletAllocation

# 加载文本文档

documents = ['document1.txt', 'document2.txt', 'document3.txt', 'document

# 5.1 GMM的局限性

### 5.1.1 对噪声敏感

GMM对噪声非常敏感,这意味着即使是很小的噪声也会对模型的性能产生重大影响。这是因为GMM假设数据服从高斯分布,而噪声通常是非高斯分布的。因此,当数据中存在噪声时,GMM可能会难以准确建模数据分布。

### 5.1.2 容易陷入局部最优

GMM的另一个局限性是它容易陷入局部最优。这意味着在参数估计过程中,模型可能会收敛到局部最优值而不是全局最优值。这可能会导致模型性能不佳。

## 5.2 GMM的扩展

为了克服GMM的局限性,已经提出了多种扩展。这些扩展包括:

### 5.2.1 隐马尔可夫模型(HMM)

HMM是一种概率模型,它可以对时序数据进行建模。HMM可以扩展GMM,使其能够对具有时序依赖性的数据进行建模。这使得GMM能够处理诸如语音识别和自然语言处理等任务。

### 5.2.2 混合密度网络(MDN)

MDN是一种概率模型,它可以对任意分布的数据进行建模。MDN可以扩展GMM,使其能够对非高斯分布的数据进行建模。这使得GMM能够处理诸如图像分割和目标检测等任务。

# 6. 高斯混合模型的代码实现和案例分析

### 6.1 Python中GMM的实现

#### 6.1.1 scikit-learn库的使用

scikit-learn库提供了用于机器学习的各种算法和工具,其中包括高斯混合模型(GMM)。我们可以使用以下代码来实现GMM:

```python

import numpy as np

from sklearn.mixture import GaussianMixture

# 生成数据

data = np.random.randn(1000, 2)

# 拟合GMM模型

model = GaussianMixture(n_components=2)

model.fit(data)

# 预测数据所属的簇

labels = model.predict(data)

```

#### 6.1.2 案例分析:图像分割

GMM可以用于图像分割,通过将图像中的像素点聚类到不同的簇中,从而分离出不同的对象。以下代码展示了如何使用GMM进行图像分割:

```python

import numpy as np

from PIL import Image

from sklearn.mixture import GaussianMixture

# 加载图像

image = Image.open('image.jpg')

data = np.array(image)

# 拟合GMM模型

model = GaussianMixture(n_components=3)

model.fit(data.reshape(-1, 3))

# 预测像素点所属的簇

labels = model.predict(data.reshape(-1, 3))

# 重塑标签并转换为图像

labels = labels.reshape(image.size[1], image.size[0])

segmented_image = Image.fromarray(labels.astype(np.uint8))

# 显示分割后的图像

segmented_image.show()

```

0

0