GMM的变体探索:扩展和改进模型,满足不同应用需求

发布时间: 2024-08-19 21:46:11 阅读量: 15 订阅数: 16

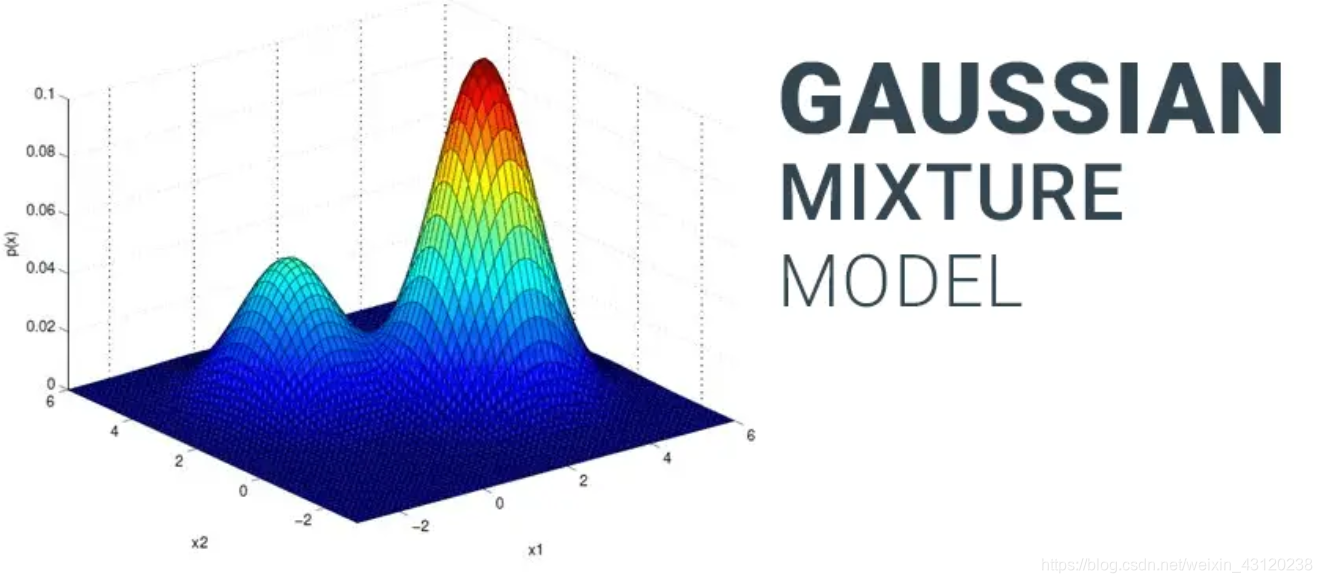

# 1. GMM简介**

高斯混合模型(GMM)是一种概率模型,它假设数据是由多个高斯分布的混合生成的。每个高斯分布代表一个数据簇,GMM可以对数据进行聚类和建模。

GMM由混合系数和高斯分布的参数组成。混合系数表示每个高斯分布在混合中的权重,高斯分布的参数包括均值和协方差矩阵,分别描述了簇的中心位置和形状。

GMM的优点在于它可以对复杂的数据分布进行建模,并通过最大似然估计(MLE)算法进行训练,以找到最佳的模型参数。它广泛应用于计算机视觉、自然语言处理等领域,用于数据聚类、分类和生成。

# 2. GMM变体

### 2.1 基于参数化分布的变体

**2.1.1 混合正态分布**

混合正态分布 (GMM) 是 GMM 最基本的变体,它假设数据由多个正态分布的混合组成。每个正态分布对应于数据中的一个簇。

**模型结构:**

```python

import numpy as np

from sklearn.mixture import GaussianMixture

# 数据

data = np.random.randn(100, 2)

# 模型

model = GaussianMixture(n_components=3)

model.fit(data)

```

**参数:**

* `n_components`:混合成分的数量。

* `covariance_type`:协方差矩阵的类型,可以是完全协方差、对角协方差或球形协方差。

**逻辑分析:**

* `fit()` 方法使用期望最大化 (EM) 算法拟合模型。

* EM 算法迭代更新模型参数,直到收敛。

* 收敛后,模型可以用于预测数据点属于每个簇的概率。

### 2.1.2 混合学生t分布

混合学生t分布 (GStM) 是 GMM 的一种扩展,它假设数据由多个学生t分布的混合组成。学生t分布比正态分布更厚尾,这意味着它对异常值更鲁棒。

**模型结构:**

```python

import numpy as np

from sklearn.mixture import StudentTMixture

# 数据

data = np.random.standard_t(df=5, size=(100, 2))

# 模型

model = StudentTMixture(n_components=3)

model.fit(data)

```

**参数:**

* `n_components`:混合成分的数量。

* `df`:学生t分布的自由度。

**逻辑分析:**

* GStM 的拟合过程与 GMM 类似,使用 EM 算法。

* 自由度参数控制分布的尾部厚度。

* 较低的自由度会导致更厚的尾部,对异常值更鲁棒。

### 2.2 基于非参数化分布的变体

**2.2.1 混合高斯过程**

混合高斯过程 (HGP) 是 GMM 的一种非参数化变体,它假设数据由多个高斯过程的混合组成。高斯过程是一种无限维概率分布,可以对任意输入生成连续函数。

**模型结构:**

```python

import numpy as np

from sklearn.gaussian_process import GaussianProcessRegressor

# 数据

X = np.random.rand(100, 1)

y = np.sin(X) + np.random.randn(100, 1)

# 模型

model = GaussianProcessRegressor()

model.fit(X, y)

```

**参数:**

* `kernel`:高斯过程的核函数,它定义了函数的平滑度。

**逻辑分析:**

* HGP 使用高斯过程回归器来拟合模型。

* 高斯过程回归器通过最大化后验概率来学习函数。

* 拟合后,模型可以预测任意输入的函数值。

**2.2.2 混合Dirichlet过程**

混合Dirichlet过程 (HDP) 是 GMM 的另一种非参数化变体,它假设数据由多个 Diric

0

0