SimCLR机器人视觉新潜力:赋予机器人“视觉”

发布时间: 2024-08-19 18:59:57 阅读量: 16 订阅数: 20

# 1. SimCLR简介

SimCLR(表示对比学习的简单框架)是一种自监督学习方法,用于学习图像的表示。它通过对比正样本(同一图像的不同增强版本)和负样本(不同图像的增强版本)来训练神经网络。通过最小化正样本和负样本之间的对比损失,SimCLR能够学习图像中表示语义信息的特征。

SimCLR的简单性和有效性使其成为自监督学习领域的关键方法。它不需要标记数据,并且可以在各种图像任务中实现最先进的性能,包括图像分类、目标检测和图像分割。

# 2. SimCLR的理论基础

### 2.1 对比学习的基本原理

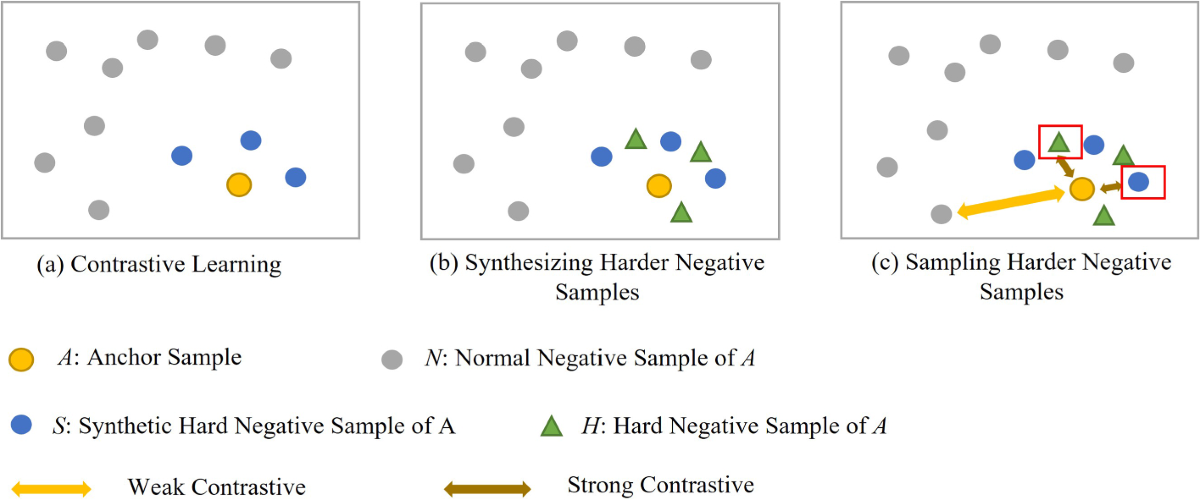

对比学习是一种自监督学习方法,它通过对比正样本和负样本之间的相似性来学习特征表示。在对比学习中,正样本是指同一数据样本的不同增强版本,而负样本是指来自不同数据样本的增强版本。

对比学习的目标是学习一个特征提取器,该特征提取器可以将正样本映射到相似的特征表示,而将负样本映射到不同的特征表示。这可以通过最小化正样本之间的对比损失和最大化负样本之间的对比损失来实现。

### 2.2 SimCLR的对比损失函数

SimCLR使用了一种称为InfoNCE损失的对比损失函数。InfoNCE损失函数定义如下:

```python

L(q, k) = -log(exp(sim(q, k) / τ) / ∑_j exp(sim(q, k_j) / τ))

```

其中:

* q和k是正样本的特征表示

* k_j是负样本的特征表示

* τ是一个温度超参数

InfoNCE损失函数通过最大化正样本之间的相似性(sim(q, k))和最小化负样本之间的相似性(sim(q, k_j))来工作。温度超参数τ控制损失函数的形状,较低的τ值导致更尖锐的损失函数,而较高的τ值导致更平滑的损失函数。

### 2.3 SimCLR的网络架构

SimCLR的网络架构是一个两阶段框架,包括一个编码器和一个投影头。编码器是一个卷积神经网络,它将输入图像转换为一个特征向量。投影头是一个全连接网络,它将特征向量投影到一个较低维度的空间中。

SimCLR使用两种不同的增强方法来生成正样本和负样本:

* **随机裁剪和翻转:**此增强方法通过随机裁剪和翻转图像来生成正样本。

* **颜色抖动:**此增强方法通过随机改变图像的亮度、对比度和饱和度来生成负样本。

通过使用这两种增强方法,SimCLR可以生成大量正样本和负样本,用于对比学习。

# 3.1 SimCLR在图像分类任务中的应用

SimCLR在图像分类任务中取得了显著的成功,其主要应用场景包括:

- **无监督预训练:**SimCLR可以作为图像分类模型的无监督预训练方法,通过学习图像之间的相似性,提取图像的通用特征,从而提升分类模型的性能。

- **数据增强:**SimCLR可以生成与原始图像相似的增强图像,这些增强图像可以作为训练数据,丰富数据集,提高分类模型的泛化能力。

- **特征提取:**SimCLR提取的特征可以作为图像分类任务的特征表示,这些特征可以用于训练分类器或进行图像检索等任务。

#### 代码示例:

```python

import torch

import torchvision.models as m

```

0

0