R语言数据包并行计算:GPU加速与高性能计算的秘密武器

发布时间: 2024-11-03 13:44:50 阅读量: 50 订阅数: 24

# 1. R语言数据包并行计算简介

## 1.1 并行计算在R语言中的应用背景

R语言作为一种统计计算和图形表示的编程语言,在数据分析领域拥有强大的影响力。随着数据集的爆炸性增长,数据处理的效率成为了研究人员面临的重要挑战。并行计算的引入,为R语言提供了处理大规模数据集的能力,提高了计算效率,缩短了数据分析的周转时间。

## 1.2 R语言并行计算的基本原理

R语言的并行计算通常涉及将任务拆分成多个子任务,然后在多个处理核心上同时执行这些子任务,最后将结果汇总。这通常通过两种方式实现:多核CPU的并行处理和利用GPU加速。本章将着重介绍如何利用R语言的数据包进行基础的并行计算,为后续章节中更高级的GPU加速技术打下基础。

# 2. GPU加速技术基础

在信息技术飞速发展的今天,GPU加速技术在数据处理和分析中的作用愈发重要。GPU加速,或称为图形处理器加速,利用图形处理单元(GPU)的并行处理能力来提高计算速度。这种技术尤其适用于计算密集型任务,如科学计算、机器学习和图像处理等。本章节将详细介绍GPU加速的基础知识,为读者打下坚实的理论基础,为后续章节中R语言与GPU集成的实战应用做准备。

## 2.1 GPU计算概述

### 2.1.1 GPU的历史与发展

GPU,图形处理单元,最初是为了解决计算机图形显示问题而设计的。随着技术的进步,GPU已经从简单的2D显示加速器发展为可执行复杂图形计算和通用并行计算的强大处理器。其发展历程大致可以分为三个阶段:

1. 初期阶段(1990s):GPU最初被称为VGA(视频图形阵列),主要用于显示硬件加速。此时的GPU以固定功能管线(Fixed Function Pipeline)为主,执行较为简单的图形操作。

2. 中期阶段(2000s初):随着3D图形的普及,GPU开始支持可编程着色器,即顶点着色器和像素着色器,这些可编程单元使得GPU能够在渲染过程中执行更复杂的计算。

3. 现代阶段(2000s中后期至今):GPU开始转向通用计算,不仅能够处理图形数据,还能够处理并行计算任务。NVIDIA推出CUDA编程模型,而AMD和其它厂商也推出了类似的技术,如OpenCL。此阶段GPU的计算能力显著提升,且能为包括科学计算在内的多领域提供强大的计算支持。

### 2.1.2 GPU在并行计算中的优势

GPU之所以在并行计算中大放异彩,主要得益于其硬件架构和设计原则:

1. 高度并行化:GPU内含有成百上千个核心,能够同时处理成千上万的线程。这种并行处理能力使得GPU能够快速处理大规模数据集。

2. 高带宽:GPU拥有高速的内存访问能力,这使得数据传输速度非常快,减少了计算单元等待数据的时间。

3. 高效能比:GPU的计算单元相比CPU来说更为简单,但通过数量上的优势,能够以较低的成本实现高效的计算性能。

4. 适合特定类型问题:对于那些可以分解为许多小型、独立任务的问题,GPU尤其擅长。例如,在图形渲染、物理模拟、以及某些类型的科学计算中,GPU加速的性能通常远超传统的CPU。

## 2.2 GPU硬件架构解析

### 2.2.1 GPU核心组成与功能

GPU的核心组成复杂且高度优化以实现并行计算。现代GPU核心可以分为以下几个主要部分:

1. 流处理器(Stream Processors):是GPU中负责执行计算任务的核心单元。它们通常被组织成多个SIMD(单指令多数据)单元,能够以高度并行的方式执行相同的指令。

2. 寄存器文件(Register File):存储着流处理器执行计算时所需要的数据,确保计算任务能快速读取和写入数据。

3. 高速缓存(Cache):用于缓存频繁访问的数据,以减少访问主内存的次数和提高性能。

4. 全局内存(Global Memory):可供所有流处理器访问的内存区域,用于存储大量的数据和程序代码。

### 2.2.2 GPU内存模型与访问模式

GPU内存模型对性能有决定性影响。一个典型的GPU内存模型包含以下部分:

1. 全局内存(Global Memory):是GPU内存架构中最大的内存空间,可以被GPU上的所有线程访问,但访问延迟相对较高。

2. 共享内存(Shared Memory):是一种低延迟的内存,位于每个Streaming Multiprocessor(SM)内,供SM内的所有线程共享使用。它用于存储中间计算结果,以减少对全局内存的访问。

3. 常量内存(Constant Memory)和纹理内存(Texture Memory):常用于存储那些在执行过程中不改变的数据,例如查找表或只读数据集。纹理内存通常用于处理图像数据。

GPU的访问模式包括:

1. 全局内存访问:需要通过全局内存地址直接访问。

2. 共享内存访问:是通过线程内部索引来访问共享内存。

3. 寄存器访问:是最快速的访问方式,因为它不涉及任何延迟。

理解和掌握GPU内存模型对于优化GPU程序性能至关重要,尤其是在内存访问模式的选择和内存访问的优化策略方面。

## 2.3 GPU编程模型

### 2.3.1 CUDA和OpenCL概述

CUDA和OpenCL是目前广泛使用的两种GPU编程模型:

1. CUDA(Compute Unified Device Architecture):由NVIDIA推出,是一种针对NVIDIA GPU的并行计算平台和编程模型。CUDA允许开发者直接利用NVIDIA GPU的强大计算能力进行高性能计算。

2. OpenCL(Open Computing Language):是一个开放标准的编程接口,适用于多样的处理器,包括GPU、CPU、DSPs和FPGAs。它支持跨平台开发,由Khronos Group维护。

两者都提供了丰富的API,使开发者能够编写能够在GPU上执行的程序,并利用其并行处理的能力。

### 2.3.2 GPU编程范式和并行算法设计

GPU编程范式的核心在于将复杂的问题分解为可以并行处理的小任务,然后在GPU上执行。并行算法的设计需要注意以下几点:

1. 数据划分:将数据集均匀地划分成多个子集,并将这些子集分配给GPU上的不同线程处理。

2. 任务并行:设计独立的任务,让不同的线程同时执行不同的任务。任务并行侧重于将不同功能的工作分配到不同的线程。

3. 数据并行:侧重于将相同的操作并行应用到数据的不同部分。数据并行非常适合图像处理、矩阵运算等计算密集型任务。

4. 并行算法优化:对数据的访问模式、内存分配和线程同步等进行优化,以减少延迟和提高效率。

理解和掌握这些GPU编程模型及并行算法设计的基本概念,是高效利用GPU加速技术的前提。在接下来的章节中,我们将逐步深入了解如何在R语言中实现和应用GPU加速技术。

# 3. R语言中GPU加速的实现

### 3.1 R语言与GPU集成工具

#### 3.1.1 GPU加速R语言包介绍

随着计算需求的日益增长,R语言也开始集成更多的GPU加速功能,以提升数据处理和分析的速度。R语言中一些重要的GPU加速包包括但不限于`gputools`、`RGPU`和`gpuR`。这些包使得R用户能够利用GPU的强大计算能力,尤其适合处理需要大量并行计算的任务,如大规模矩阵运算、统计模拟和深度学习模型训练。

`gputools`包提供了一系列可以直接在GPU上执行的函数,比如矩阵运算和图像处理。而`gpuR`包则利用了CUDA和OpenCL技术,允许R语言直接与GPU硬件进行交互。另外,`RGPU`提供了类似的GPU计算接口,但它主要针对特定的统计计算和图形生成任务。

要使用这些包,用户需要确保自己的系统安装了支持的GPU硬件以及相应的驱动程序。对于初学者来说,安装这些包的过程可能稍显复杂,需要一些对系统和驱动配置的基础知识。

#### 3.1.2 安装与配置GPU加速环境

在安装和配置GPU加速环境时,首先需要验证系统是否支持GPU加速,并确保安装了正确的显卡驱动。这里以`gpuR`包为例,介绍基本的安装和配置步骤:

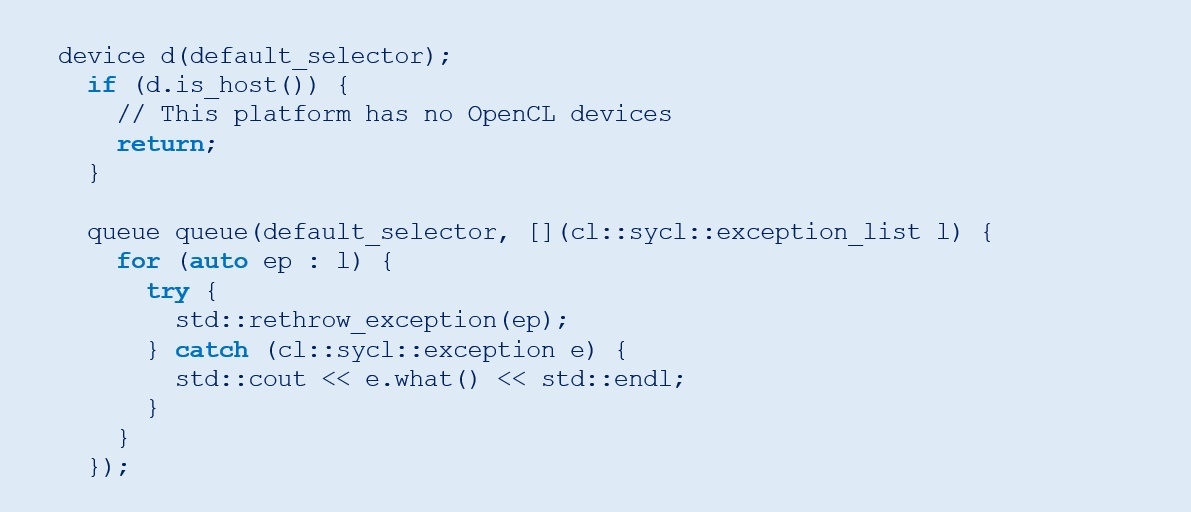

1. **安装CUDA或OpenCL的开发环境**:根据自己的GPU类型和需求,安装对应的CUDA Toolkit或OpenCL SDK。如使用NVIDIA GPU,则通常安装CUDA Toolkit。

2. **安装Rcpp和RcppCUDA**:这两个R包

0

0