【深入篇】:高级Python开发者必备!MySQLdb库深度应用与性能调优

发布时间: 2024-10-05 00:32:31 阅读量: 31 订阅数: 37

# 1. MySQLdb库概述与基础使用

## MySQLdb库简介

MySQLdb库是Python编程语言的一个数据库接口,专门用于与MySQL数据库进行交互。它提供了一系列方便的API来执行SQL语句、处理结果集和处理数据库事务。作为Python DB-API 2.0的一个实现,MySQLdb库在Python社区中广泛使用,特别是在数据密集型的Web应用和数据处理任务中。

## 安装MySQLdb

安装MySQLdb库之前,需要确保你的系统中已经安装了MySQL数据库,并且安装了相应的MySQL C API开发文件。在大多数情况下,你可以通过Python的包管理工具pip来安装MySQLdb:

```bash

pip install mysqlclient

```

## 基础使用

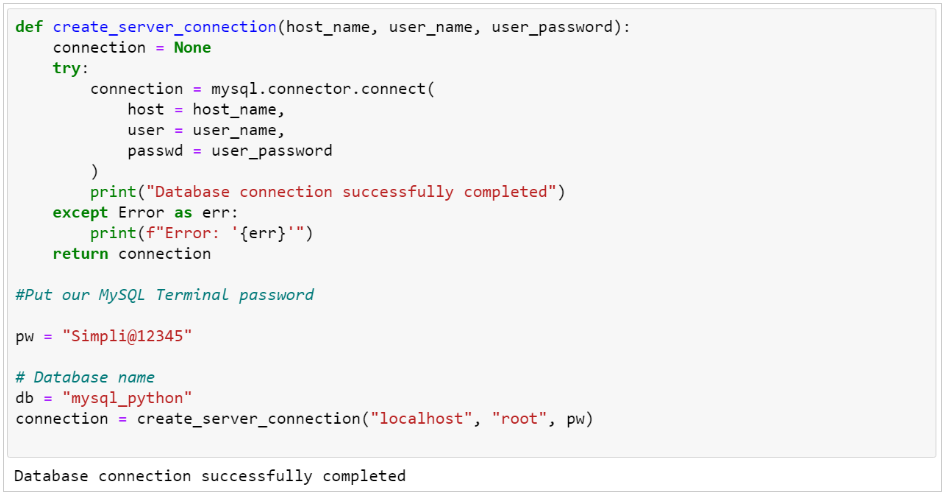

### 连接数据库

连接MySQL数据库是使用MySQLdb库进行操作的第一步。可以通过`connect`方法实现,需要提供数据库的主机名、用户名、密码和数据库名作为参数。

```python

import MySQLdb

conn = MySQLdb.connect(

host='localhost',

user='user',

passwd='password',

db='database_name'

)

```

### 执行SQL语句

连接数据库后,可以使用游标(Cursor)对象来执行SQL语句。通过`cursor()`方法获得一个游标对象,然后使用该对象的`execute()`方法执行SQL命令。

```python

cursor = conn.cursor()

cursor.execute("SELECT * FROM table_name")

```

### 获取查询结果

执行查询操作(如SELECT)后,可以使用游标的`fetchone()`或`fetchall()`方法来获取查询结果。

```python

result = cursor.fetchone() # 获取单条记录

results = cursor.fetchall() # 获取所有记录列表

```

### 关闭连接

完成数据库操作后,应当关闭游标和连接,以释放相关资源。

```python

cursor.close()

conn.close()

```

以上就是MySQLdb库的基础使用方法。从连接数据库、执行SQL命令、获取查询结果到最后关闭连接,每个步骤都显得十分关键。随着内容的深入,我们将探究更多高级特性和优化技巧,以帮助开发者更高效地使用MySQLdb库。

# 2. MySQLdb库的高级特性和优化

## 2.1 MySQLdb库的高级查询特性

### 2.1.1 复杂查询的实现

复杂查询是数据库管理中不可或缺的一环,而MySQLdb库提供的高级查询特性可以有效地处理复杂的数据库交互。要执行复杂查询,首先需要对SQL语法有深入的理解。例如,当我们需要从多个表中提取数据时,可以利用`JOIN`语句来实现表与表之间的关联查询。

以下是一个使用`JOIN`操作的Python代码示例,它展示如何实现两个表之间的内连接查询:

```python

import MySQLdb

# 连接数据库

db = MySQLdb.connect(host="localhost", user="user", passwd="password", db="mydb")

cursor = db.cursor()

# 编写复杂查询

sql = """

SELECT orders.order_id, customers.customer_name, orders.order_date

FROM orders

INNER JOIN customers ON orders.customer_id = customers.customer_id

try:

cursor.execute(sql)

results = cursor.fetchall()

for row in results:

print(row)

finally:

cursor.close()

db.close()

```

在此代码中,`INNER JOIN`用于连接`orders`表和`customers`表,并根据`customer_id`字段匹配相关记录。查询结果返回了订单ID、客户名称和订单日期等信息。

### 2.1.2 事务处理和锁定机制

事务处理确保了数据库操作的原子性,完整性,一致性,和隔离性。在Python中使用MySQLdb执行事务操作,可以通过`commit()`方法来提交事务,使用`rollback()`方法来回滚未完成的事务。

下面是一个事务处理的示例代码:

```python

import MySQLdb

# 连接数据库

db = MySQLdb.connect(host="localhost", user="user", passwd="password", db="mydb")

cursor = db.cursor()

try:

db.autocommit(False) # 关闭自动提交

cursor.execute("UPDATE accounts SET balance = balance - 10 WHERE account_id = 1")

cursor.execute("UPDATE accounts SET balance = balance + 10 WHERE account_id = 2")

# 假设以下操作失败,触发回滚

# raise Exception("Failed to process")

***mit() # 所有操作成功,提交事务

except Exception as e:

print(f"An error occurred: {e}")

db.rollback() # 出现异常,回滚事务

finally:

cursor.close()

db.close()

```

在此代码中,两个账户分别进行了转账操作,只有当所有相关操作成功时,事务才会被提交。如果在操作过程中遇到异常,整个事务将被回滚,保证数据的一致性。

## 2.2 MySQLdb库的性能优化技巧

### 2.2.1 SQL语句的优化

SQL语句的编写对数据库性能影响巨大。编写高效的SQL语句需要避免不必要的表扫描、减少连接次数、合理使用索引以及正确地使用聚合函数。比如,应该尽量使用`LIMIT`来限制查询结果集的大小,尤其是在分页查询中。

下面是一个性能优化的示例,其中使用了`LIMIT`和`ORDER BY`来高效地获取排序后的结果集:

```python

import MySQLdb

# 连接数据库

db = MySQLdb.connect(host="localhost", user="user", passwd="password", db="mydb")

cursor = db.cursor()

sql = """

SELECT * FROM products

ORDER BY price DESC

LIMIT 10

cursor.execute(sql)

results = cursor.fetchall()

for row in results:

print(row)

cursor.close()

db.close()

```

在这个示例中,`LIMIT 10`命令限制了返回的结果为价格最高的前10个产品,这在分页时非常有用,并且可以显著提高性能。

## 2.2.2 数据库的索引策略

索引是数据库优化中非常重要的一个方面。索引能够提升查询的速度,但同时也会增加写入和更新操作的成本。在使用MySQLdb时,选择合适的列创建索引至关重要。

下面是一个关于如何创建索引的代码示例:

```python

import MySQLdb

# 连接数据库

db = MySQLdb.connect(host="localhost", user="user", passwd="password", db="mydb")

cursor = db.cursor()

sql = "CREATE INDEX idx_product_name ON products(name)"

cursor.execute(sql)

cursor.close()

db.close()

```

在这个例子中,我们为`products`表中的`name`列创建了一个名为`idx_product_name`的索引。这样做能够加速基于产品名称的搜索查询,但同时要注意,对这个表的插入和更新操作会受到影响。

## 2.2.3 分页查询和缓存机制

分页查询是一种常见的需求,特别是在处理大量数据时。为了提升性能,通常会采用缓存机制来减少数据库的负载。使用MySQLdb,可以结合数据库内置的查询缓存,或者使用如Redis这样的外部缓存系统。

下面是一个分页查询的例子,该查询避免了全表扫描,仅获取目标页的数据:

```python

import MySQLdb

# 连接数据库

db = MySQLdb.connect(host="localhost", user="user", passwd="password", db="mydb")

cursor = db.cursor()

page_size = 20

current_page = 2

offset = (current_page - 1) * page_size

sql = """

SELECT * FROM products

ORDER BY id

LIMIT %s OFFSET %s

cursor.execute(sql, (page_size, offset))

results = cursor.fetchall()

for row in results:

print(row)

cursor.close()

db.close()

```

在这个查询中,通过`LIMIT`和`OFFSET`子句,我们能够快速定位到需要的记录范围,而不是获取整个表的记录,然后再进行Python层面的分页。这样不仅提高了效率,还减少了内存的使用。

## 2.3 MySQLdb库的高级事务特性

### 2.3.1 事务的隔离级别

事务隔离级别定义了事务在并发环境下,能够看到哪些数据以及对数据的可串行化程度。MySQLdb库支持不同的事务隔离级别,例如`READ UNCOMMITTED`、`READ COMMITTED`、`REPEATABLE READ`和`SERIALIZABLE`。选择合适的隔离级别可以防止脏读、不可重复读和幻读等问题。

下面是一个设置事务隔离级别的示例:

```python

import MySQLdb

# 连接数据库

db = MySQLdb.connect(host="localhost", user="user", passwd="password", db="mydb")

cursor = db.cursor()

# 设置事务隔离级别为可重复读

db.set_locking_strategy('DB2')

cursor.execute("SET SESSION TRANSACTION ISOLATION LEVEL REPEATABLE READ")

try:

db.autocommit(False)

# ...执行一些事务操作

***mit()

except Exception as e:

db.rollback()

finally:

cursor.close()

db.close()

```

在这个例子中,通过`SET SESSION TRANSACTION ISOLATION LEVEL REPEATABLE READ`命令,我们将当前会话的事务隔离级别设置为`REPEATABLE READ`,以避免不可重复读的问题。

### 2.3.2 锁定模式及其影响

在数据库事务中,锁定模式决定了事务对数据的操作方式。MySQLdb库支持多种锁定策略,包括行级锁定和表级锁定。选择合适的锁定模式对于优化并发性能是非常重要的。

下面是一个设置锁定策略的代码示例:

```python

import MySQLdb

# 连接数据库

db = MySQLdb.connect(host="localhost", user="user", passwd="password", db="mydb")

cursor = db.cursor()

# 设置锁定策略为DB2风格

db.set_locking_strategy('DB2')

try:

db.autocommit(False)

# ...执行一些事务操作

***mit()

except Exception as e:

db.rollback()

finally:

cursor.close()

db.close()

```

在这个例子中,`db.set_locking_strategy('DB2')`设置MySQLdb库的锁定策略,以便更好地处理并发事务。对于读写操作的混合场景,表级锁定可能会导致高并发下的性能瓶颈,而行级锁定通常能提供更好的并发处理能力。

### 2.3.3 死锁的预防与处理

死锁是并发环境下不可避免的问题之一。当两个或多个事务相互等待对方释放资源时,就会发生死锁。在使用MySQLdb进行数据库操作时,预防和处理死锁是提高系统稳定性和性能的关键。

预防死锁的常用策略包括:

- 确保事务以一致的顺序访问资源。

- 尽量缩短事务的持续时间。

- 为涉及多个表操作的事务使用适当的锁定策略。

下面是一个使用Python代码进行死锁检测的示例:

```python

import MySQLdb

# 连接数据库

db = MySQLdb.connect(host="localhost", user="user", passwd="password", db="mydb")

cursor = db.cursor()

try:

db.autocommit(False)

# 事务1开始

cursor.execute("SELECT * FROM table1 WHERE id = 1 FOR UPDATE")

# 模拟长时间操作

# ...

# 事务2开始

cursor.execute("SELECT * FROM table2 WHERE id = 1 FOR UPDATE")

# 模拟长时间操作

# ...

# 模拟死锁

# 事务1和事务2都在等待对方释放锁定的资源

# ...

***mit()

except Exception as e:

print(f"Error: {e}")

# 死锁发生时,可以尝试回滚来释放资源

db.rollback()

finally:

cursor.close()

db.close()

```

在这个例子中,两个事务几乎同时获取了`table1`和`table2`的锁定资源,并且都在等待对方释放资源,从而造成了死锁。在实际应用中,数据库管理系统通常会自动检测死锁并回滚其中一个事务以释放资源。开发者应编写适当的错误处理代码来响应可能发生的死锁,保证系统的稳定运行。

通过本章节的介绍,读者应该对MySQLdb库的高级特性及其优化方法有了更为深入的理解,这将有助于在实际工作中更加高效地管理数据库,并编写性能更优的代码。

# 3. MySQLdb库的并发控制和扩展

在高流量的Web应用和大型在线系统中,数据库的并发控制和扩展是确保系统稳定运行的关键因素。本章将深入探讨MySQLdb库在并发控制、高并发场景下的应用以及分布式数据库环境中的应用。

## 3.1 多线程与数据库连接池的应用

在多线程环境中,数据库连接管理变得尤为重要。这里我们将探讨连接池的原理、优势以及如何实现线程安全的数据库操作。

### 3.1.1 连接池的原理和优势

连接池是一种管理数据库连接的技术,它在应用程序和数据库之间建立了一个缓存池。连接池提供一组数据库连接,应用程序从连接池获取数据库连接并执行操作,操作完成后,将连接返回到连接池中供后续使用。

使用连接池的优势主要体现在以下几点:

1. **减少连接创建时间**:在高并发下,频繁地建立和销毁数据库连接会导致显著的性能开销。连接池中的连接可以被重用,避免了频繁的连接创建和销毁。

2. **提高系统稳定性**:连接池可以限制同时连接到数据库的最大数量,防止因超出数据库最大连接数而造成的服务崩溃。

3. **提供资源复用**:连接池管理连接的生命周期,包括维护和管理连接状态,让开发人员从这些繁琐的任务中解脱出来。

接下来是连接池的一个简单使用示例:

```python

import mysql.connector

from mysql.connector import pooling

# 配置连接池

config = {

'user': 'root',

'password': 'password',

'host': 'localhost',

'database': 'testdb',

'pool_name': 'mypool',

'pool_size': 5,

'pool_reset_session': True

}

# 创建连接池对象

pool = pooling.MySQLConnectionPool(**config)

# 从连接池获取连接

cnx = pool.get_connection()

cursor = cnx.cursor()

# 执行数据库操作

cursor.execute("SELECT * FROM table_name")

# 处理结果

rows = cursor.fetchall()

# 关闭游标和连接

cursor.close()

cnx.close()

```

在上述代码中,我们首先定义了连接池的配置,然后使用这些配置来创建一个`MySQLConnectionPool`对象。通过调用`get_connection()`方法,我们从池中获取一个数据库连接。使用完毕后,应当关闭游标和连接以释放资源。

### 3.1.2 线程安全的数据库操作

在多线程应用中,多个线程可能会同时访问同一个数据库资源,这可能会导致数据竞争和不一致性。为了保证线程安全,可以采取以下措施:

1. **事务控制**:使用事务将一系列操作包装起来,确保它们要么全部成功要么全部失败。在Python中,可以使用MySQLdb库提供的事务支持来管理事务。

2. **锁机制**:合理利用数据库的锁机制来控制资源访问。例如,可以使用行级锁或者表级锁来避免并发写入时的冲突。

3. **连接池的线程隔离**:确保每个线程使用单独的数据库连接,或者连接池中的连接在被分配给线程时能够被正确地管理。

在Python中,操作数据库时通常需要确保操作的原子性,以避免并发访问导致的问题。可以通过数据库事务来保证:

```python

cnx = pool.get_connection()

cnx.start_transaction()

try:

cursor = cnx.cursor()

cursor.execute("UPDATE table_name SET column_name = 'new_value' WHERE id = 1")

# 更多的更新操作...

***mit() # 只有在所有操作都成功的情况下,提交事务

except Exception as e:

cnx.rollback() # 如果有任何操作失败,回滚事务

finally:

cursor.close()

cnx.close()

```

在上述代码中,我们开始了一个事务,然后执行了多条更新操作。只有当所有操作成功时,我们提交事务;如果遇到任何错误,我们将回滚事务以保证数据的一致性。最后,我们确保游标和连接都被关闭。

## 3.2 高并发场景下的MySQLdb应用

随着用户数量的增加和请求量的提升,应用往往会遇到高并发场景。本节将讨论并发控制策略、批量操作优化以及异步数据库操作实践。

### 3.2.1 并发控制与数据库性能

当多个用户或操作同时访问数据库时,可能会引发性能瓶颈。为了有效地控制并发并保持数据库性能,可以采取如下措施:

1. **数据库连接管理**:通过连接池管理数据库连接数量,避免过多连接导致数据库过载。

2. **查询优化**:审查并优化数据库查询语句,提高查询效率,例如,通过合理使用索引来加快数据检索速度。

3. **应用层限制**:在应用层设置并发请求的限制,防止同一时间有太多请求涌入数据库。

### 3.2.2 批量操作与性能优化

在处理大量数据时,批量操作可以显著提升性能。与单条语句相比,批量操作可以在单个数据库操作中完成更多的工作,从而减少网络往返次数,降低事务开销。

```python

# 批量插入示例

insert_values = [

(1, 'value1'),

(2, 'value2'),

(3, 'value3'),

# 更多的插入数据...

]

# 使用executemany执行批量插入

cursor.executemany("INSERT INTO table_name (id, column_name) VALUES (%s, %s)", insert_values)

***mit()

```

在上面的代码示例中,我们通过`executemany`方法执行批量插入操作。这种方式比多次执行单条插入语句更加高效。

### 3.2.3 异步数据库操作实践

为了进一步提高数据库操作的性能,尤其是在IO密集型应用中,可以采用异步编程模式。异步操作允许应用程序在等待数据库响应时继续执行其他任务。

以下是使用Python的`asyncio`库和`aiomysql`进行异步数据库操作的示例:

```python

import asyncio

import aiomysql

async def fetch_data():

# 创建数据库连接

pool = await aiomysql.create_pool(

host='***.*.*.*',

port=3306,

user='root',

password='password',

db='testdb',

charset='utf8mb4',

autocommit=True

)

async with pool.acquire() as conn:

async with conn.cursor() as cursor:

await cursor.execute("SELECT * FROM table_name")

result = await cursor.fetchall()

print(result)

loop = asyncio.get_event_loop()

loop.run_until_complete(fetch_data())

```

在此代码段中,我们使用`aiomysql`创建了一个异步连接池,并执行了数据库查询操作。由于使用了异步IO,所以在执行数据库操作时,程序不会阻塞。

## 3.3 分布式数据库与MySQLdb

在分布式环境下,数据库面临新的挑战,比如数据一致性、同步和容错等问题。本节将介绍分布式数据库的基础概念、MySQLdb在分布式环境中的应用以及数据一致性与同步机制。

### 3.3.1 分布式数据库基础

分布式数据库系统是为了存储大量数据而设计的,它允许数据跨多个物理位置分布存储。与传统集中式数据库相比,分布式数据库的几个关键优势包括:

1. **水平扩展性**:可以通过增加更多的服务器来提高数据库的存储和处理能力。

2. **高可用性**:即使某些节点发生故障,系统仍可继续运行。

3. **故障容忍性**:分布式数据库通常设计为容错,能够在单个或多个节点失败的情况下继续提供服务。

### 3.3.2 MySQLdb在分布式环境中的应用

在分布式环境中使用MySQLdb时,需要注意以下几点:

1. **读写分离**:在分布式数据库架构中,通常将读操作和写操作分离到不同的节点,以提高性能和扩展性。

2. **分片**:通过将数据分布在不同的数据库实例中来平衡负载和提高可扩展性。

3. **连接管理**:在多数据库节点环境中,需要确保连接池能够有效地管理这些连接。

### 3.3.3 数据一致性与同步机制

在分布式数据库系统中,维护数据一致性是一项挑战。常见的解决方法包括:

1. **两阶段提交(2PC)**:在执行更新操作时,所有参与的节点要么全部提交,要么全部回滚,以保证一致性。

2. **一致性哈希**:用于分布式存储中,平衡负载并减少数据迁移。

3. **异步复制**:通过异步复制数据来提高系统可用性和容错能力,但会引入一定的延迟。

在MySQLdb中,可以通过配置和使用复制来实现分布式环境中的数据同步。MySQL支持主从复制,可以配置从服务器来复制主服务器上的数据变化。

至此,我们已经探讨了MySQLdb库在并发控制和扩展方面的应用,包括多线程和连接池的应用、高并发场景下的策略以及在分布式环境中的应用。在下一章中,我们将深入探讨Python与MySQLdb的高级整合技巧,包括异步框架的整合、Web应用中的深度整合以及大数据量处理等话题。

# 4. Python与MySQLdb的高级整合技巧

### 4.1 Python异步框架与MySQLdb整合

#### 4.1.1 异步编程基础

随着Python版本的迭代更新,异步编程逐渐成为了支持高并发场景的一种有效编程范式。异步编程与传统的同步编程相比,最核心的区别在于其非阻塞的特性,可以在等待I/O操作完成时释放线程,从而让CPU去做其他任务,以达到提升程序性能的目的。

在Python 3.5及以上版本中,引入了async和await两个关键字,让异步编程更加简洁明了。在编写异步函数时,使用`async def`定义函数,并使用`await`关键字调用异步函数。下面是一个简单的异步编程示例:

```python

import asyncio

async def main():

await async_function()

return "done"

async def async_function():

print('this will print immediately')

await asyncio.sleep(1) # 模拟耗时操作

print('this will print after a 1 second delay')

loop = asyncio.get_event_loop()

loop.run_until_complete(main())

```

上述代码中,`async_function`模拟了一个耗时操作,主线程可以继续执行其他任务而不是阻塞等待这个操作完成。

#### 4.1.2 异步框架与数据库交互模式

要将MySQLdb库整合到异步框架中,需要使用支持异步的数据库驱动。MySQL官方提供的`mysql-connector-python`库不支持异步操作,因此需要依赖第三方异步驱动,如`aiomysql`。

使用`aiomysql`实现异步数据库交互的基本模式如下:

```python

import asyncio

import aiomysql

async def create_connection():

# 创建连接池

pool = await aiomysql.create_pool(host='***.*.*.*', port=3306,

user='user', password='password',

db='mydb', loop=loop)

async with pool.acquire() as conn:

async with conn.cursor() as cur:

await cur.execute("SELECT * FROM table_name")

result = await cur.fetchall()

print(result)

pool.close()

await pool.wait_closed()

loop = asyncio.get_event_loop()

loop.run_until_complete(create_connection())

```

在此模式中,使用`async with`来管理数据库连接的生命周期,`cur.execute`和`cur.fetchall`在异步模式下被调用,这允许在执行数据库操作时,程序能够处理其他异步任务。

### 4.2 MySQLdb在Web应用中的深度整合

#### 4.2.1 ORM框架与MySQLdb

对象关系映射(ORM)框架如SQLAlchemy为Python应用提供了一种使用数据库的方式,而无需编写原始SQL语句。它将Python的类和对象转换为数据库的表和记录。

SQLAlchemy通过核心(Core)和ORM两个层级支持与MySQLdb的整合。以下是使用SQLAlchemy Core层操作MySQLdb的基本示例:

```python

from sqlalchemy import create_engine, MetaData, Table, Column, Integer, String, select

engine = create_engine('mysql+pymysql://user:password@localhost/dbname')

metadata = MetaData(bind=engine)

users = Table('users', metadata,

Column('id', Integer, primary_key=True),

Column('name', String(50)),

Column('fullname', String(50)),

Column('password', String(50))

)

metadata.create_all()

conn = engine.connect()

s = select([users]).where(users.c.name.like('%ed%'))

result = conn.execute(s)

for row in result:

print(row)

```

在ORM层级中,可以更简单地使用`declarative_base`来定义模型类,以及操作对象来替代原始的SQL语句。

#### 4.2.2 Web框架的数据库连接池配置

数据库连接池是一种管理数据库连接的机制,可以有效减少资源消耗并提高应用性能。在Web框架如Flask或Django中,可以借助扩展或框架自身的功能来配置连接池。

以Flask为例,可以使用Flask-SQLAlchemy扩展来设置数据库连接池:

```python

from flask import Flask

from flask_sqlalchemy import SQLAlchemy

app = Flask(__name__)

app.config['SQLALCHEMY_DATABASE_URI'] = 'mysql+pymysql://user:password@localhost/dbname'

app.config['SQLALCHEMY_POOL_SIZE'] = 10

app.config['SQLALCHEMY_MAX_OVERFLOW'] = 20

app.config['SQLALCHEMY_POOL_RECYCLE'] = 2800

db = SQLAlchemy(app)

class User(db.Model):

id = db.Column(db.Integer, primary_key=True)

name = db.Column(db.String(80), unique=True)

# 其余的Flask路由和视图函数

```

在该配置中,`SQLALCHEMY_POOL_SIZE`定义了连接池的大小,`SQLALCHEMY_MAX_OVERFLOW`定义了额外的连接数,而`SQLALCHEMY_POOL_RECYCLE`用于指定连接的最大生命周期,以防连接因长时间使用而变得不可靠。

### 4.3 大数据量处理与MySQLdb

#### 4.3.1 大数据量导入导出策略

处理大数据量时,直接使用数据库的insert语句通常不是最佳选择,因为这会导致内存耗尽和执行时间过长。常见的策略是使用文件来辅助数据的导入导出,如使用CSV文件。

例如,使用Python将CSV数据导入MySQL数据库:

```python

import csv

import pymysql

conn = pymysql.connect('localhost', user='user', password='password', db='dbname')

with open('data.csv', 'r') as csv***

***

***

***

***"INSERT INTO table_name VALUES(%s, %s)", row)

***mit()

cursor.close()

conn.close()

```

在数据导出时,可以使用`SELECT ... INTO OUTFILE`语句将数据集导出到指定文件。

#### 4.3.2 分布式计算与数据处理

大数据量的处理还可以依赖于分布式计算框架,如Apache Spark。虽然Spark本身不是Python原生支持的,但是通过PySpark可以实现其与Python的整合。在整合MySQLdb时,可以使用Spark的JDBC连接器与MySQL数据库进行交互。

对于数据处理,可以先将数据从MySQL导出到HDFS或者其他支持的数据源,然后在Spark中进行并行处理。

以上就是第四章的内容,详细讨论了如何将Python高级特性与MySQLdb进行整合,特别是在异步编程、Web应用整合、大数据量处理等方面。下一章将深入探讨MySQLdb库的故障诊断与性能监控。

# 5. MySQLdb库的故障诊断与性能监控

## 5.1 MySQLdb连接故障的诊断

### 5.1.1 常见连接问题及其原因分析

在使用MySQLdb库时,开发者可能会遇到连接问题,这些故障的原因多种多样。了解这些常见问题及其原因对于快速定位和解决问题至关重要。以下是一些典型的连接故障及其原因:

- **网络问题**:网络不稳定或中断导致MySQL服务器不可达。

- **权限问题**:用户密码错误或权限不足无法建立连接。

- **配置错误**:数据库地址、端口、用户名、密码等配置信息不正确。

- **服务器问题**:MySQL服务未启动或资源不足无法接受新的连接。

- **库版本不兼容**:MySQLdb库版本与MySQL服务器版本不兼容。

### 5.1.2 连接故障的排查方法

排查连接故障需要一定的诊断逻辑和工具的辅助。下面列出了一些排查步骤和建议:

1. **检查网络**:确保客户端和服务器之间网络连通,并且端口(MySQL默认端口是3306)是开放的。

2. **验证MySQL服务**:确认MySQL服务已启动,并且监听在正确的端口。

3. **查看MySQL日志**:通过查看MySQL的错误日志,可以发现服务器层面的问题。

4. **使用诊断工具**:利用MySQLdb的`cursor.connection`属性可以进行简单的状态检查。

5. **检查权限**:确认数据库账户具有正确的权限,并且账号密码无误。

示例代码用于检查MySQLdb连接状态:

```python

import MySQLdb

try:

db = MySQLdb.connect(host='***.*.*.*', user='root', passwd='password', db='testdb')

cursor = db.cursor()

print("连接成功")

except MySQLdb.Error as e:

print("连接失败:", e)

finally:

if db:

db.close()

```

## 5.2 MySQLdb性能监控工具与应用

### 5.2.1 内置的性能监控工具

MySQLdb本身提供了部分性能监控的功能。通过内置的方法可以查询当前的连接数,以及最近的查询时间等。

```python

import MySQLdb

db = MySQLdb.connect(host='***.*.*.*', user='root', passwd='password', db='testdb')

cursor = db.cursor()

# 查询当前数据库的性能参数

cursor.execute("SHOW STATUS")

for stat in cursor.fetchall():

print(stat)

# 查询当前连接数

cursor.execute("SHOW PROCESSLIST")

print(cursor.fetchall())

# 关闭连接

cursor.close()

db.close()

```

### 5.2.2 第三方监控工具的集成

对于更深入的性能监控,MySQLdb可以与其他第三方监控工具集成。像Percona Monitoring and Management(PMM)或MyWebSQL等工具,可以提供更加详细的性能指标。

集成步骤通常包括:

1. 安装并配置监控工具。

2. 将MySQLdb配置为监控工具的数据源。

3. 设置性能阈值和报警。

4. 定期查看报告和日志进行分析。

## 5.3 MySQLdb调优案例分析

### 5.3.1 实际案例的调优过程

以下是一个MySQLdb调优的实际案例。某系统在执行复杂查询时响应时间较长,通过以下步骤进行调优:

1. **查询优化**:使用`EXPLAIN`命令检查慢查询的执行计划。

2. **索引优化**:根据执行计划结果,添加缺失的索引以加快查询速度。

3. **代码优化**:检查并优化应用程序中的SQL语句,避免不必要的数据加载。

4. **服务器调优**:调整MySQL服务器的参数,如`innodb_buffer_pool_size`,以更好地使用系统资源。

### 5.3.2 调优效果与经验总结

在实施了上述调优措施后,系统的响应时间得到显著提升。具体效果如下:

- **响应时间减少**:查询响应时间从平均5秒降低到1秒内。

- **资源消耗降低**:服务器的CPU和内存占用率均有所下降。

- **吞吐量提升**:系统能够处理更多的并发请求。

调优过程中的经验总结:

- 定期进行慢查询日志分析,及时发现潜在问题。

- 性能调优应结合具体业务场景,针对性地进行调整。

- 监控系统的性能指标,及时响应性能波动。

通过此案例分析,可以看到,性能监控和调优是一个持续的过程,需要不断监控、分析和优化才能保障系统的稳定性与高效性。

0

0