【最佳实践篇】:大型项目数据库交互最佳实践!MySQLdb库深度剖析

发布时间: 2024-10-05 00:49:04 阅读量: 33 订阅数: 30

Python从入门到项目实践--看店宝

# 1. 大型项目数据库交互概览

随着信息技术的飞速发展,大型项目数据库交互已成为业务成功的关键因素之一。本章节旨在为读者提供大型项目中数据库交互的整体视图,为深入探讨数据库技术的实际应用和优化打下坚实的基础。

## 1.1 数据库交互的重要性

在现代IT项目中,数据库不仅是数据存储的核心,也是数据交互的枢纽。一个高效、稳定的数据库系统能够确保数据的快速读写,支持业务的快速发展。

## 1.2 数据库交互面临的挑战

大型项目通常涉及海量数据,这给数据库带来了巨大的压力,包括但不限于数据一致性、系统性能、并发处理等。理解和解决这些问题,是实现高效数据库交互的前提。

## 1.3 数据库交互的技术趋势

随着云计算、大数据、人工智能等技术的普及,数据库交互技术也在不断创新。本章将概述这些技术趋势,为下一章深入分析数据库交互技术核心功能打下基础。

# 2. MySQLdb库核心功能解析

## 2.1 数据库连接管理

### 2.1.1 连接数据库的基本流程

在使用MySQLdb库进行数据库交互之前,首先需要建立与MySQL数据库的连接。建立连接是一个基础且关键的步骤,它涉及到一系列的配置和验证过程,确保应用程序能够与数据库进行有效通信。

连接数据库的基本流程大致可以分为以下几个步骤:

1. **导入MySQLdb模块**

在Python脚本中,需要首先导入MySQLdb模块,以便使用其提供的数据库交互功能。

```python

import MySQLdb

```

2. **建立连接**

使用`connect()`函数来建立与MySQL数据库的连接。该函数接受多个参数,如主机地址(host)、用户名(user)、密码(passwd)和数据库名(db)等。

```python

db = MySQLdb.connect(host='localhost', user='username', passwd='password', db='dbname')

```

3. **创建游标对象**

连接建立之后,可以创建一个游标对象,游标对象用于在数据库中执行SQL命令和获取结果。

```python

cursor = db.cursor()

```

4. **执行SQL命令**

使用游标对象执行SQL命令。可以使用`execute()`方法来执行单个SQL命令,或使用`executemany()`方法执行多个SQL命令。

```python

cursor.execute("SELECT * FROM table_name")

```

5. **处理查询结果**

如果执行的是查询(SELECT)命令,则需要使用游标对象的`fetchone()`或`fetchall()`方法来获取查询结果。

```python

rows = cursor.fetchall()

```

6. **提交事务**

对于涉及到数据修改的SQL命令(INSERT、UPDATE、DELETE),需要调用连接对象的`commit()`方法来提交事务,以确保数据变更被持久化到数据库中。

```***

***mit()

```

7. **关闭连接**

完成数据库操作后,需要关闭游标对象和数据库连接,以释放系统资源。

```python

cursor.close()

db.close()

```

在连接数据库时,还应该考虑异常处理机制。通过try-except语句块来捕获并处理可能出现的数据库连接异常,如网络问题、认证失败、资源不足等。

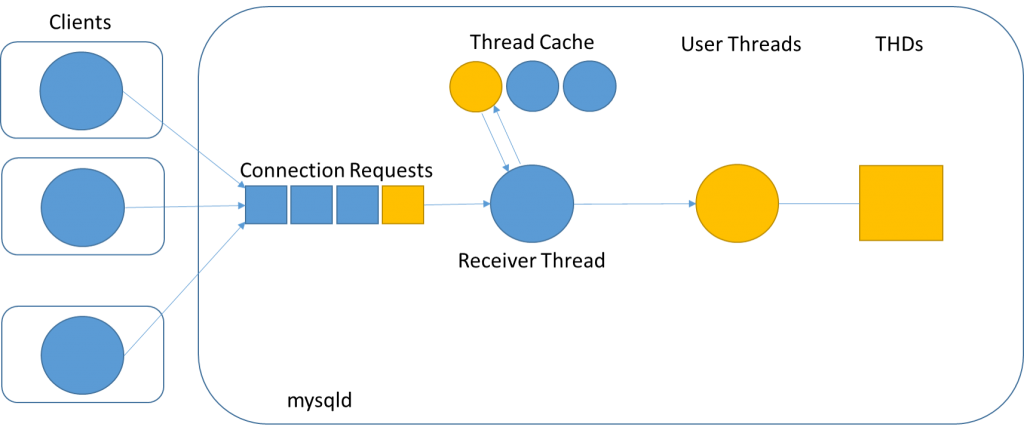

### 2.1.2 连接池的概念及其实现

随着应用程序的规模增长,频繁地创建和关闭数据库连接可能会导致性能瓶颈。为了解决这一问题,数据库连接池的概念应运而生。连接池是一种技术,通过缓存一定数量的数据库连接,以减少数据库连接的创建和销毁带来的开销。

在MySQLdb中实现连接池,可以通过以下几种方式:

1. **使用第三方库**

如`pymysql-connection-pool`等库提供连接池的实现。这些库通常提供一个封装好的连接池类,使得开发者可以很容易地管理连接池。

2. **自定义连接池管理器**

可以通过Python标准库中的线程安全队列`queue.Queue`来实现一个简单的连接池。在连接池中预先创建一定数量的连接,并在请求时从连接池中取出,使用完毕后再放回。

3. **使用框架内置连接池**

如果使用Django等高级框架,则通常框架已经内置了连接池功能。只需按照框架的文档配置好数据库连接即可。

使用连接池的优点包括:

- **提升性能**:重用现有连接,减少了创建和关闭连接的时间。

- **资源管理**:有效控制数据库连接数量,避免资源过度消耗。

- **高并发处理**:更好地处理高并发场景下的数据库交互。

## 2.2 数据查询与操作

### 2.2.1 SQL语句的执行机制

SQL语句是操作关系型数据库最常用的手段,对于数据库管理员和开发者来说,掌握SQL语句的执行机制是进行数据库交互的基础。

SQL语句的执行大致可以分为以下几个阶段:

1. **解析阶段**

当SQL语句被发送至数据库服务器时,首先会进行语法解析,确保SQL语句符合数据库的语法规则。

2. **预处理阶段**

预处理是指数据库对SQL语句进行优化,并准备执行计划。在这一阶段,数据库可能对SQL语句进行重写,以提高执行效率。

3. **执行计划生成**

根据数据字典、索引信息以及其他统计信息,数据库生成一个执行计划。这个执行计划定义了访问数据库的步骤和方法。

4. **执行阶段**

数据库根据执行计划对数据进行查找、修改、删除或插入等操作。

5. **结果返回**

执行完成后,数据库返回执行结果。对于SELECT语句,结果通常是查询到的数据行;对于INSERT、UPDATE或DELETE语句,则通常是影响的行数。

在Python中使用MySQLdb库执行SQL语句时,主要通过游标对象的`execute()`方法。例如:

```python

cursor.execute("SELECT * FROM table WHERE column = %s", (value,))

```

需要注意的是,虽然SQL语句提供了强大的数据库操作能力,但不合理的SQL语句也会给数据库带来性能问题。例如,复杂的查询可能会导致长时间的锁定和资源消耗。因此,在实际开发中,应尽量优化SQL语句,并对可能产生的性能瓶颈有所预见。

### 2.2.2 高效的数据检索技术

在数据库操作中,数据检索是一项基本且频繁的操作。为了提高检索效率,数据库设计者和开发者往往会采取一些高效的数据检索技术,以达到快速响应用户请求的目的。

高效数据检索技术主要包括:

1. **索引优化**

索引是提高数据库检索效率的关键技术。通过创建合适的索引,可以显著提高查询速度。例如,对于经常作为查询条件的列,可以创建B树索引。

2. **查询优化**

高效的查询语句可以减少数据库的计算量。开发者应尽量使用精确查询、避免不必要的计算和转换,减少使用通配符,以及合理使用子查询。

3. **分区与分表**

当数据量非常大时,可以通过分区或分表将数据分散存储到不同的物理位置,这样可以有效提高查询速度,同时也可以提高系统的维护性能。

4. **缓存技术**

对于频繁访问且不经常变化的数据,可以利用缓存技术(如Redis、Memcached等)将其存储在内存中,这样可以大大减少数据库的查询压力。

5. **读写分离**

在架构上实施读写分离,可以将数据的读取和写入操作分散到不同的数据库服务器,从而减轻主数据库的压力,并提高系统的可用性和扩展性。

在使用MySQLdb进行数据检索时,可以结合以上技术手段,例如:

```python

# 假设已经创建了名为table的表和id列的索引

cursor.execute("SELECT * FROM table WHERE id = %s", (id,))

```

在此例中,假设id列上有索引,使用精确匹配的查询可以实现快速检索。同时,开发者还需要根据实际情况对SQL语句进行调优,以达到最佳的检索效率。

## 2.3 事务处理

### 2.3.1 事务的基本概念与属性

在数据库中,事务是一组操作的集合,这些操作要么全部成功,要么全部不发生,以此来保证数据的一致性和可靠性。事务的概念是数据库管理系统(DBMS)中保证数据正确性和完整性的核心。

事务的基本属性通常被称为ACID,即原子性(Atomicity)、一致性(Consistency)、隔离性(Isolation)和持久性(Durability)。

1. **原子性**

原子性是指事务中的所有操作要么全部执行,要么全部不执行。这保证了事务作为一个整体来应用,即使事务中的一部分操作失败,也不会导致数据的不一致性。

2. **一致性**

一致性保证了事务将数据库从一个一致的状态转移到另一个一致的状态。在事务开始之前和结束之后,数据的一致性没有被破坏。

3. **隔离性**

隔离性是指事务的执行不受其他事务的干扰。隔离级别定义了事务之间相互隔离的程度,常见的隔离级别有读未提交、读已提交、可重复读和串行化。

4. **持久性**

持久性意味着一旦事务被提交,其所做的修改就会永久保存在数据库中。即使发生系统崩溃或其他故障,事务的结果也不会丢失。

在MySQLdb中,事务处理主要依靠数据库连接对象的`begin()`、`commit()`和`rollback()`方法来实现。下面是一个使用MySQLdb进行事务处理的例子:

```python

db = MySQLdb.connect(host='localhost', user='username', passwd='password', db='dbname')

try:

db.begin() # 开始事务

cursor = db.cursor()

cursor.execute("UPDATE table SET column = value WHERE id = %s", (id,))

***mit() # 提交事务

except Exception as e:

db.rollback() # 如果发生异常,则回滚事务

raise e

final

```

0

0