揭秘MATLAB智能算法在信号处理中的应用:掌握信号处理算法的奥秘

发布时间: 2024-06-16 13:45:14 阅读量: 77 订阅数: 37

MATLAB在信号处理中的应用

# 1. MATLAB智能算法简介**

MATLAB作为一种强大的数值计算平台,在智能算法领域也发挥着重要作用。智能算法,又称人工智能算法,是一类能够模拟人类智能行为的算法,具有学习、推理和决策的能力。

MATLAB提供了丰富的智能算法工具箱,涵盖机器学习、深度学习、神经网络等领域。这些工具箱提供了预先构建的函数和算法,使得用户可以轻松地开发和部署智能算法模型。

MATLAB智能算法的优势在于其易用性、可扩展性和高性能。用户可以快速地原型化和测试算法,并通过并行计算和GPU加速来提高算法效率。

# 2. MATLAB信号处理算法理论基础**

## 2.1 信号处理基础知识

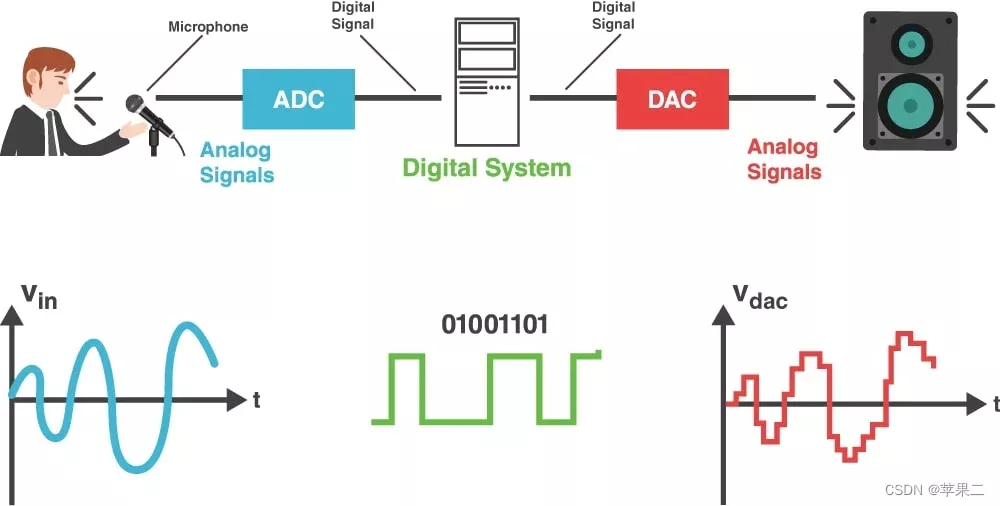

信号处理涉及对信号(信息载体)进行分析、处理和修改,以提取有价值的信息或改善信号质量。信号可以是连续的(模拟信号)或离散的(数字信号),并且可以存在于时域、频域或其他域中。

**时域信号:**表示信号随时间的变化,如语音信号、心电图等。

**频域信号:**表示信号中不同频率分量的幅度和相位,如频谱图、傅里叶变换等。

## 2.2 信号处理算法分类

信号处理算法根据其操作域和处理方式分为时域算法和频域算法。

### 2.2.1 时域算法

时域算法直接在信号的时间序列上进行操作,无需将其转换为频域。时域算法包括:

- **滤波:**去除或增强信号中的特定频率分量。

- **采样:**将连续信号转换为离散信号。

- **量化:**将信号幅度离散化为有限个值。

### 2.2.2 频域算法

频域算法将信号转换为频域,在频域上进行处理,然后再转换回时域。频域算法包括:

- **傅里叶变换:**将信号分解为不同频率分量的正弦波和余弦波。

- **小波变换:**将信号分解为不同频率和时间尺度的波形。

- **谱分析:**分析信号中不同频率分量的功率或幅度。

## 2.3 智能算法在信号处理中的应用

智能算法,如机器学习和深度学习,在信号处理中发挥着越来越重要的作用。这些算法可以从数据中学习模式和关系,从而实现复杂的信号处理任务,如:

- **噪声消除:**识别和去除信号中的噪声。

- **特征提取:**从信号中提取有价值的信息。

- **分类识别:**将信号分类为不同的类别。

# 3. MATLAB智能算法实践应用

### 3.1 噪声消除

噪声是信号处理中常见的问题,它会影响信号的质量和分析结果。MATLAB提供了丰富的智能算法,可以有效地消除噪声。

#### 3.1.1 时域噪声消除算法

时域噪声消除算法直接在信号的时间域上进行处理。常用的算法包括:

- **移动平均滤波器:**通过对信号进行平均来平滑噪声。

- **中值滤波器:**使用信号窗口中值来替换当前值,可以有效去除尖峰噪声。

- **维纳滤波器:**一种最优线性滤波器,通过最小化信号和噪声之间的均方误差来估计噪声。

**代码块:**

```

% 原始信号

signal = [1, 2, 3, 4, 5, 6, 7, 8, 9, 10];

% 加入噪声

noise = randn(size(signal));

noisy_signal = signal + noise;

% 移动平均滤波

window_size = 3;

filtered_signal =

```

0

0