MATLAB智能算法与深度学习融合应用:探索深度学习算法的奥秘

发布时间: 2024-06-16 13:41:01 阅读量: 77 订阅数: 37

# 1. 深度学习算法概述

深度学习是一种机器学习技术,它使用多层神经网络来学习数据中的复杂模式。与传统机器学习方法不同,深度学习算法不需要手动特征工程,而是从数据中自动学习特征。

深度学习算法通常由以下步骤组成:

- **数据预处理:**将数据转换为神经网络可以理解的格式。

- **模型训练:**使用训练数据训练神经网络,更新其权重和偏差以最小化损失函数。

- **模型评估:**使用验证数据评估训练后的模型的性能,并根据需要进行微调。

- **模型部署:**将训练后的模型部署到生产环境中,用于预测或分类新数据。

# 2. MATLAB中的深度学习工具箱

MATLAB为深度学习提供了全面的工具箱,使研究人员和从业者能够轻松创建、训练和部署深度学习模型。该工具箱包括用于创建各种深度学习网络、评估和优化模型以及与其他算法集成的高级功能。

### 2.1 深度学习网络的创建和训练

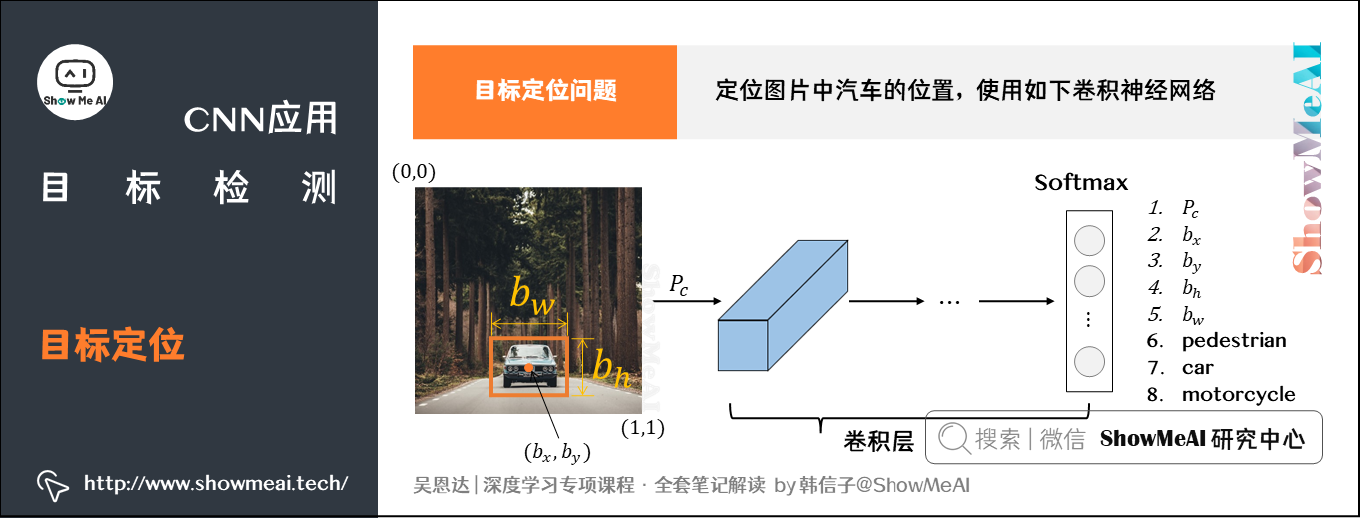

#### 2.1.1 卷积神经网络(CNN)

卷积神经网络(CNN)是一种强大的深度学习模型,用于处理图像和视频数据。MATLAB中的Deep Learning Toolbox提供了创建和训练CNN的全面功能。

```

% 创建一个简单的CNN

layers = [

imageInputLayer([28 28 1])

convolution2dLayer(3, 16, 'Stride', 2)

reluLayer

maxPooling2dLayer(2, 'Stride', 2)

convolution2dLayer(3, 32, 'Stride', 1)

reluLayer

maxPooling2dLayer(2, 'Stride', 2)

fullyConnectedLayer(10)

softmaxLayer

];

% 定义训练选项

options = trainingOptions('sgdm', ...

'InitialLearnRate', 0.01, ...

'MaxEpochs', 10);

% 训练CNN

net = trainNetwork(data, labels, layers, options);

```

**代码逻辑分析:**

* `imageInputLayer` 创建一个输入层,指定图像的尺寸和通道数。

* `convolution2dLayer` 创建一个卷积层,指定卷积核的大小和步长。

* `reluLayer` 添加一个ReLU激活函数。

* `maxPooling2dLayer` 创建一个最大池化层,指定池化窗口的大小和步长。

* `fullyConnectedLayer` 创建一个全连接层,指定输出神经元的数量。

* `softmaxLayer` 添加一个softmax层,用于分类任务。

* `trainingOptions` 定义训练选项,包括学习率和训练轮数。

* `trainNetwork` 使用训练数据和标签训练CNN。

#### 2.1.2 循环神经网络(RNN)

循环神经网络(RNN)是一种深度学习模型,用于处理序列数据,例如文本和时间序列。MATLAB中的Deep Learning Toolbox提供了创建和训练RNN的强大功能。

```

% 创建一个简单的RNN

layers = [

sequenceInputLayer(10)

lstmLayer(100)

fullyConnectedLayer(5)

softmaxLayer

];

% 定义训练选项

options = trainingOptions('adam', ...

'InitialLearnRate', 0.001, ...

'MaxEpochs', 10);

% 训练RNN

net = trainNetwork(data, labels, layers, options);

```

**代码逻辑分析:**

* `sequenceInputLayer` 创建一个序列输入层,指定序列的长度。

* `lstmLayer` 创建一个LSTM层,指定LSTM单元的数量。

* `fullyConnectedLayer` 创建一个全连接层,指定输出神经元的数量。

* `softmaxLayer` 添加一个softmax层,用于分类任务。

* `trainingOptions` 定义训练选项,包括学习率和训练轮数。

* `trainNetwork` 使用训练数据和标签训练RNN。

#### 2.1.3 Transformer神经网络

Transformer神经网络是一种强大的深度学习模型,用于处理序列数据,例如文本和代码。MATLAB中的Deep Learning Toolbox提供了创建和训练Transformer神经网络的先进功能。

```

% 创建一个简单的Transformer

layers = [

transformerLayer(100, 8)

fullyConnectedLayer(5)

softmaxLayer

];

% 定义训练选项

options = trainingOptions('adam', ...

'InitialLearnRate', 0.001, ...

'MaxEpochs', 10);

% 训练Transformer

net = trainNetwork(data, labels, layers, options);

```

**代码逻辑分析:**

* `transformerLayer` 创建一个Transformer层,指定自注意力头的数量和隐藏单元的数量。

* `fullyConnectedLayer` 创建一个全连接层,指定输出神经元的数量。

* `softmaxLayer` 添加一个softmax层,用于分类任务。

* `trainingOptions` 定义训练选项,包括学习率和训练轮数。

* `trainNetwork` 使用训练数据和标签训练Transformer。

# 3. 智能算法与深度学习融合应用

### 3.1 智能算法的基本原理

智能算法,又称启发式算法,是一种受生物进化、社会行为或物理现象启发的算法,用于解决复杂优化问题。它们通常具有以下特点:

- **随机性:** 智能算法使用随机搜索机制,探索问题的解空间,避免陷入局部最优。

- **迭代性:** 智能算法通过不断迭代,逐步改进解决方案,直至达到预定的目标或满足终止条件。

- **适应性:** 智能算法能够根据问题的特征和反馈信息调整其搜索策略,提高求解效率。

常见的智能算法包括:

#### 3.1.1 遗传算法

遗传算法(GA)是一种受生物进化原理启发的算法。它通过以下步骤进行:

1. **初始化:** 随机生成一组候选解(染色体)。

2. **选择:** 根据适应度(目标函数值)选择最优的染色体。

3. **交叉:** 将两个或多个染色体部分交换,产生新的染色体。

4. **变异:** 以一定概率随机改变染色体中某些基因的值。

5. **重复步骤 2-4:** 重复上述步骤,直至达到终止条件。

#### 3.1.2 粒子群优化算法

粒子群优化算法(PSO)是一种受鸟群或鱼群集体行为启发的算法。它通过以下步骤进行:

1. **初始化:** 随机生成一组粒子(候选解)。

2. **评估:** 计算每个粒子的适应度。

3. **更新速度和位置:** 根据个体最优解(pBest)和群体最优解(gBest)更新每个粒子的速度和位置。

4. **重复步骤 2-3:** 重复上述步骤,直至达到终止条件。

#### 3.1.3 蚁群算法

蚁群算法(ACO)是一种受蚂蚁觅食行为启发的算法。它通过以下步骤进行:

1. **初始化:** 在问题空间中随机放置一组蚂蚁(代理)。

2. **移动:** 蚂蚁根据信息素浓度和启发式信息选择移动路径。

3. **释放信息素:** 蚂蚁在移动过程中释放信息素,增强路径的吸引力。

4. **蒸发信息素:** 信息素会随着时间推移而蒸发,鼓励探索新的路径。

0

0