揭秘模糊C均值聚类算法:数据挖掘中的秘密武器

发布时间: 2024-08-21 23:51:43 阅读量: 30 订阅数: 37

前端面试攻略(前端面试题、react、vue、webpack、git等工具使用方法)

# 1. 模糊C均值聚类算法简介**

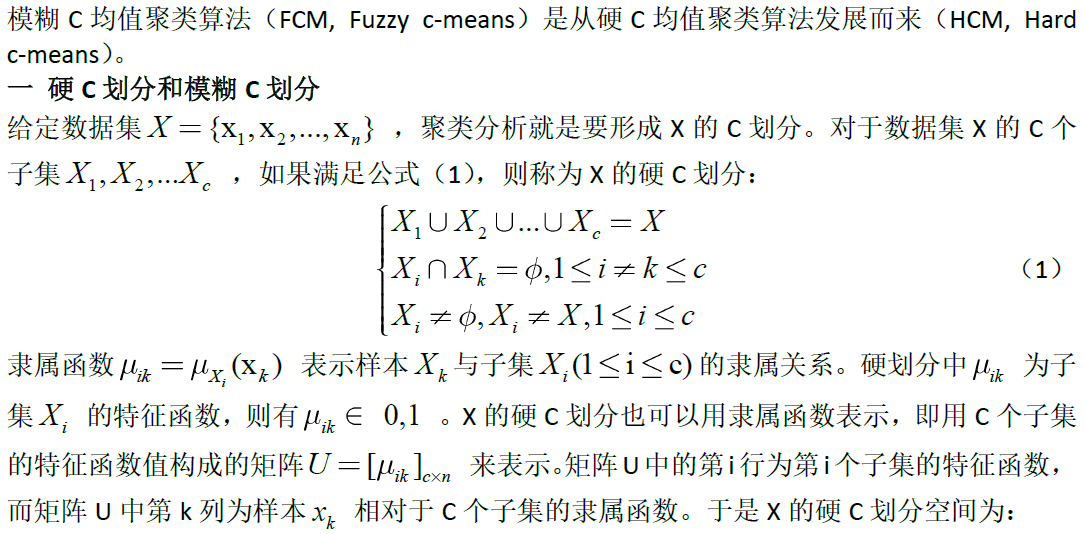

模糊C均值聚类算法是一种流行的无监督机器学习算法,用于将数据点分组到不同的簇中。与传统的硬聚类算法不同,模糊C均值聚类允许数据点同时属于多个簇,这使其非常适合处理具有重叠或模糊特征的数据。

该算法基于模糊逻辑的思想,模糊逻辑是一种处理不确定性和模糊性的数学工具。在模糊C均值聚类中,每个数据点被分配一个隶属度值,表示其属于每个簇的程度。这些隶属度值之和为1,表明数据点可以同时属于多个簇。

# 2. 模糊C均值聚类算法的理论基础**

## 2.1 模糊逻辑与模糊集合

### 2.1.1 模糊逻辑的基本概念

传统逻辑基于二值性,即事物要么属于某个集合,要么不属于。模糊逻辑则认为事物可以部分属于某个集合,并引入“隶属度”的概念来描述这种部分归属关系。隶属度是一个[0, 1]之间的实数,表示事物属于某个集合的程度。

### 2.1.2 模糊集合的定义和运算

模糊集合是模糊逻辑中的基本概念,它表示一组具有模糊边界的对象。模糊集合的定义如下:

```

A = {(x, μ_A(x)) | x ∈ X}

```

其中:

* A 是模糊集合

* X 是基本集合

* μ_A(x) 是 x 对模糊集合 A 的隶属度

模糊集合的运算包括并集、交集和补集,其运算规则如下:

```

(A ∪ B)(x) = max(μ_A(x), μ_B(x))

(A ∩ B)(x) = min(μ_A(x), μ_B(x))

¬A(x) = 1 - μ_A(x)

```

## 2.2 C均值聚类算法

### 2.2.1 基本原理和目标函数

模糊C均值聚类算法(FCM)是一种基于模糊逻辑的聚类算法。其基本原理是将数据点分配到多个聚类中,使得每个数据点对每个聚类的隶属度最大化。

FCM 的目标函数如下:

```

J(U, V) = ∑<sub>i=1</sub><sup>n</sup>∑<sub>j=1</sub><sup>c</sup> (μ<sub>ij</sub>)<sup>m</sup> ||x<sub>i</sub> - v<sub>j</sub>||<sup>2</sup>

```

其中:

* U 是隶属度矩阵,元素 μ<sub>ij</sub> 表示数据点 x<sub>i</sub> 对聚类中心 v<sub>j</sub> 的隶属度

* V 是聚类中心矩阵,元素 v<sub>j</sub> 表示聚类中心 j 的坐标

* n 是数据点的数量

* c 是聚类中心的数量

* m 是模糊指数,通常取值为 2

### 2.2.2 算法流程和步骤

FCM 算法的流程如下:

1. **初始化:**随机初始化隶属度矩阵 U 和聚类中心矩阵 V。

2. **更新隶属度:**根据目标函数计算每个数据点对每个聚类中心的隶属度:

```

μ<sub>ij</sub> = (∑<sub>k=1</sub><sup>c</sup> ((||x<sub>i</sub> - v<sub>j</sub>||<sup>2</sup> / ||x<sub>i</sub> - v<sub>k</sub>||<sup>2</sup>)<sup>1/(m-1)</sup>))<sup>-1</sup>

```

3. **更新聚类中心:**根据隶属度矩阵计算每个聚类中心的坐标:

```

v<sub>j</sub> = (∑<sub>i=1</sub><sup>n</sup> (μ<sub>ij</sub>)<sup>m</sup> x<sub>i</sub>) / ∑<sub>i=1</sub><sup>n</sup> (μ<sub>ij</sub>)<sup>m</sup>

```

4. **重复步骤 2 和 3:**重复步骤 2 和 3,直到隶属度矩阵和聚类中心矩阵不再发生明显变化。

# 3.1 算法实现和参数选择

#### 3.1.1 算法实现的流程和代码

模糊C均值聚类算法的实现流程如下:

1. 初始化:随机初始化聚类中心和隶属度矩阵。

2. 迭代更新:

- 计算每个数据点到每个聚类中心的距离。

- 根据距离和隶属度矩阵,更新聚类中心和隶属度矩阵。

3. 终止条件:当聚类中心或隶属度矩阵不再发生明显变化时,算法终止。

```python

import numpy as np

def fcm(data, k, m, max_iter=100, tol=1e-4):

"""

模糊C均值聚类算法

参数:

data: 数据集

k: 聚类中心数量

m: 模糊指数

max_iter: 最大迭代次数

tol: 终止条件阈值

返回:

聚类中心

隶属度矩阵

"""

# 初始化

n, d = data.shape

centers = data[np.random.choice(n, k, replace=False)]

U = np.random.rand(n, k)

U = U / np.sum(U, axis=1)[:, np.newaxis]

# 迭代更新

for _ in range(max_iter):

# 计算距离

D = np.zeros((n, k))

for i in range(n):

for j in range(k):

D[i, j] = np.linalg.norm(data[i] - centers[j])

# 更新隶属度矩阵

U = (D ** (2 / (m - 1))) / (np.sum(D ** (2 / (m - 1)), axis=1))[:, np.newaxis]

# 更新聚类中心

for j in range(k):

centers[j] = np.sum(U ** m * data, axis=0) / np.sum(U ** m, axis=0)

# 终止条件

if np.max(np.abs(U - U_prev)) < tol:

break

U_prev = U

return centers, U

```

#### 3.1.2 参数选择的影响和优化策略

模糊C均值聚类算法的关键参数是聚类中心数量 `k` 和模糊指数 `m`。

**聚类中心数量 `k` 的影响:**

* `k` 太小:聚类结果过于粗糙,无法有效区分数据。

* `k` 太大:聚类结果过于细致,可能产生过度拟合。

**模糊指数 `m` 的影响:**

* `m` 越小:聚类结果越清晰,但对噪声数据敏感。

* `m` 越大:聚类结果越模糊,但对噪声数据鲁棒性更好。

**参数优化策略:**

* **网格搜索:**在给定的范围内尝试不同的参数组合,选择性能最好的组合。

* **交叉验证:**将数据集划分为训练集和测试集,在训练集上优化参数,在测试集上评估性能。

* **启发式算法:**使用遗传算法或粒子群优化算法等启发式算法优化参数。

# 4. 模糊C均值聚类算法的进阶应用

### 4.1 高维数据的降维与预处理

#### 4.1.1 降维技术简介

高维数据包含大量特征,这会给聚类算法带来计算和存储方面的挑战。降维技术可以将高维数据投影到低维空间,从而减少数据维度并简化聚类过程。常见的降维技术包括:

- **主成分分析 (PCA)**:PCA通过线性变换将数据投影到方差最大的方向上,从而保留数据中的主要信息。

- **奇异值分解 (SVD)**:SVD将数据分解为奇异值、左奇异向量和右奇异向量的乘积,可以用于降维和特征提取。

- **t分布随机邻域嵌入 (t-SNE)**:t-SNE是一种非线性降维技术,可以将高维数据映射到低维空间,同时保留数据之间的局部关系。

#### 4.1.2 预处理方法和策略

数据预处理是聚类算法的重要步骤,可以提高聚类结果的准确性和效率。常见的预处理方法包括:

- **数据标准化**:将数据中的每个特征缩放或归一化到统一的范围,以消除不同特征之间的量纲差异。

- **缺失值处理**:处理缺失值的方法有多种,包括删除缺失值、用平均值或中位数填充缺失值,或使用插值技术估计缺失值。

- **异常值处理**:异常值可能会影响聚类结果,因此需要识别和处理异常值。常见的异常值处理方法包括删除异常值、用平均值或中位数替换异常值,或使用稳健的聚类算法。

### 4.2 异形数据的处理与优化

#### 4.2.1 异形数据的特征和影响

异形数据是指具有不同形状、大小或密度的簇。处理异形数据时,模糊C均值聚类算法可能会遇到以下挑战:

- **簇重叠**:异形数据中的簇可能重叠或交织,这会给聚类算法带来困难。

- **噪声和异常值**:异形数据中可能包含大量噪声和异常值,这些数据会影响聚类结果的准确性。

- **簇大小差异**:异形数据中的簇大小可能差异很大,这会给聚类算法带来计算方面的挑战。

#### 4.2.2 优化算法以处理异形数据

为了处理异形数据,模糊C均值聚类算法可以进行以下优化:

- **使用加权距离度量**:加权距离度量可以根据数据点的密度或重要性赋予不同的权重,从而提高聚类结果的准确性。

- **引入惩罚项**:惩罚项可以惩罚簇重叠或簇大小差异,从而引导聚类算法找到更合理的聚类结果。

- **使用稳健的聚类算法**:稳健的聚类算法对噪声和异常值具有鲁棒性,可以提高异形数据聚类的准确性。

**代码块:**

```python

import numpy as np

from sklearn.cluster import FuzzyCMeans

# 创建一个异形数据集

data = np.array([[1, 2], [3, 4], [5, 6], [7, 8], [9, 10], [11, 12], [13, 14], [15, 16], [17, 18], [19, 20]])

# 使用模糊C均值聚类算法对异形数据集进行聚类

model = FuzzyCMeans(n_clusters=3)

model.fit(data)

# 获取聚类结果

labels = model.labels_

# 可视化聚类结果

import matplotlib.pyplot as plt

plt.scatter(data[:, 0], data[:, 1], c=labels)

plt.show()

```

**代码逻辑解读:**

- `data`变量创建了一个异形数据集,其中包含具有不同形状和大小的簇。

- `model`变量使用模糊C均值聚类算法对异形数据集进行聚类,其中`n_clusters`参数指定了要生成的簇的数量。

- `labels`变量存储了聚类结果,其中每个数据点被分配到一个簇中。

- `plt.scatter()`函数可视化了聚类结果,其中数据点根据其簇标签着色。

**参数说明:**

- `n_clusters`:指定要生成的簇的数量。

- `max_iter`:指定算法的最大迭代次数。

- `m`:指定模糊指数,用于控制簇成员资格的模糊程度。

- `init`:指定簇中心的初始化方法,可以是随机初始化或其他方法。

# 5. 模糊C均值聚类算法在数据挖掘中的应用案例**

**5.1 客户细分与市场分析**

**5.1.1 客户细分需求和挑战**

客户细分是市场营销中的一项重要任务,它可以帮助企业识别目标受众、制定针对性的营销策略。然而,客户细分面临着许多挑战,例如:

- **数据维度高:**客户数据通常包含大量维度,如年龄、性别、消费习惯等。

- **数据分布复杂:**客户数据往往分布复杂,存在重叠和模糊的边界。

- **数据动态变化:**客户行为和偏好会随着时间而变化,导致细分结果需要定期更新。

**5.1.2 模糊C均值聚类在客户细分中的应用**

模糊C均值聚类算法可以有效地解决客户细分中的挑战。它通过将客户划分为多个模糊簇来识别客户群,每个簇代表一类具有相似特征的客户。

**具体应用步骤如下:**

1. **数据预处理:**对客户数据进行预处理,包括数据清洗、归一化和降维。

2. **参数设置:**设置聚类簇数和模糊指数等参数。

3. **聚类算法:**使用模糊C均值聚类算法将客户数据划分为多个模糊簇。

4. **聚类结果分析:**分析聚类结果,识别不同簇的特征和客户画像。

5. **细分策略制定:**根据聚类结果,制定针对不同客户群的营销策略。

**5.2 文本聚类与主题分析**

**5.2.1 文本聚类的难点和解决方法**

文本聚类是将文本文档划分为具有相似主题的组。然而,文本聚类面临着以下难点:

- **文本数据高维:**文本数据通常包含大量单词,导致数据维度很高。

- **文本数据稀疏:**文本数据往往很稀疏,即大多数单词在文档中出现频率很低。

- **文本语义复杂:**文本语义复杂,需要考虑单词之间的语义关系。

**5.2.2 模糊C均值聚类在文本聚类中的应用**

模糊C均值聚类算法可以有效地解决文本聚类中的难点。它通过将文档划分为多个模糊簇来识别主题,每个簇代表一个主题。

**具体应用步骤如下:**

1. **文本预处理:**对文本数据进行预处理,包括分词、去停用词和词干化。

2. **特征提取:**使用TF-IDF或其他特征提取方法提取文本特征。

3. **聚类算法:**使用模糊C均值聚类算法将文本文档划分为多个模糊簇。

4. **聚类结果分析:**分析聚类结果,识别不同簇的主题和代表性文档。

5. **主题分析:**根据聚类结果,进行主题分析,提取文本中的关键主题和趋势。

0

0