【深入剖析】:如何彻底解决MapReduce中的数据倾斜问题并优化性能

发布时间: 2024-11-01 07:06:23 阅读量: 84 订阅数: 33

# 1. MapReduce数据倾斜问题概述

MapReduce作为大数据处理的重要框架,其数据倾斜问题严重制约了作业性能和资源利用效率。在处理大规模数据集时,某些键值可能产生远高于平均值的数据量,导致特定的Map或Reduce任务执行时间显著增长,从而引起整个作业的性能瓶颈。

数据倾斜通常表现在数据处理不均匀,部分节点负载过重,而其他节点则相对空闲。它不仅仅是个别的性能问题,也可能影响到整个分布式系统的稳定性。在企业级应用中,数据倾斜问题的解决是优化MapReduce作业、提高大数据处理效率的关键环节。

针对数据倾斜问题,本文将从理论基础、诊断分析、解决方案及性能优化等多个维度,为读者提供一系列的应对策略和实践案例。通过对MapReduce的数据倾斜问题进行系统性的分析和深入探讨,我们可以更好地优化大数据处理流程,提高处理速度和系统稳定性。

# 2. 理论基础与数据倾斜成因

## 2.1 MapReduce工作原理简述

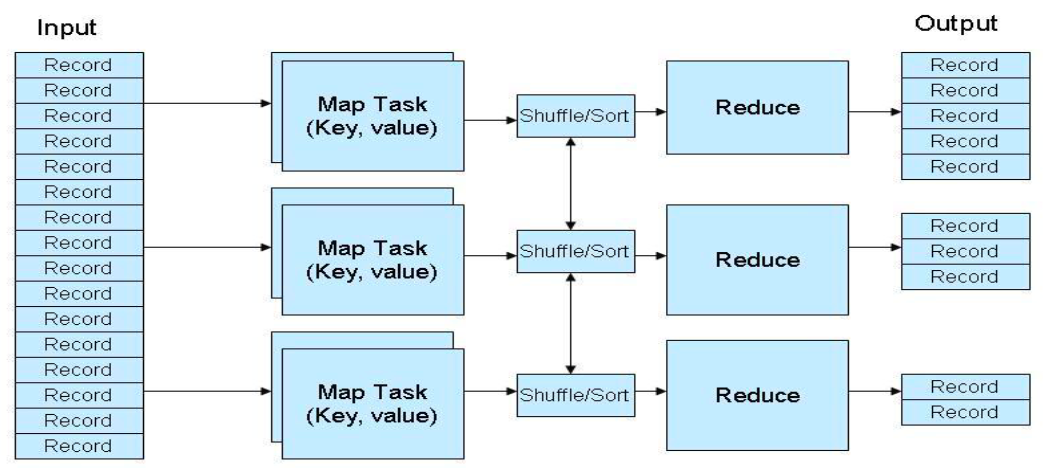

### 2.1.1 MapReduce编程模型

MapReduce模型是Hadoop处理大数据的核心编程模型,它基于分而治之的思想,将大规模的数据集切分成若干小数据集,通过用户自定义的Map函数和Reduce函数并行处理,最后将处理结果汇总。Map函数处理的是原始数据,输出中间键值对(key-value pairs);Reduce函数则对相同键的所有值进行处理,输出最终结果。

MapReduce模型通过这种模式可以有效地进行数据的分布式计算,其优势在于能够处理PB级别的数据,但同时也存在一些缺陷,比如对于某些特定的计算任务可能不够高效,尤其是在数据倾斜问题存在的情况下。

### 2.1.2 Map和Reduce阶段的作用

Map阶段的目的是将输入的文件切分成独立的数据块(split),并为每个数据块运行Map任务,处理后的数据会根据key值分区,并发送到对应的Reduce任务。这一阶段的关键在于Map任务的并行化,这使得可以同时处理大量的数据。

Reduce阶段则是在Map阶段输出的基础上,对数据进行汇总。这一阶段会根据key值对Map阶段输出的数据进行排序和分组,然后对每组数据执行Reduce函数,最终生成输出文件。Reduce阶段的效率直接影响整体作业的性能。

## 2.2 数据倾斜的定义与类型

### 2.2.1 键值分布不均引起的数据倾斜

数据倾斜是指在MapReduce处理过程中,由于数据分布不均匀导致某些Map任务或Reduce任务处理的数据量远远超过其它任务,从而引发性能瓶颈。最常见的数据倾斜发生在Map阶段,特别是在键值(key)分布极不均匀的情况下。

例如,在一个日志分析任务中,如果大部分日志记录都对应同一个键值(比如日期),那么与该键值相关联的Map任务将处理不成比例的大量数据,而其它键值的任务则很快完成,造成系统资源浪费和作业延迟。

### 2.2.2 输入数据分布不均引起的数据倾斜

除了键值分布不均以外,输入数据本身分布不均匀也会导致数据倾斜。这种情况通常出现在对具有自然偏斜的源数据进行处理的场景中。例如,在处理网络流量日志时,某些IP地址可能产生了绝大多数的数据量,而大多数IP地址的日志量则很小。

这种不均匀的数据分布会导致MapReduce作业中的某些任务处理的数据量远大于其它任务,从而引起性能问题。即便是在Map阶段设置了合理的分区器和预处理逻辑,也难以完全避免这类数据倾斜问题。

## 2.3 数据倾斜的影响分析

### 2.3.1 对Map和Reduce阶段的影响

数据倾斜会使得Map或Reduce阶段的某些任务需要处理比平均多得多的数据,从而大大增加这些任务的处理时间和资源消耗。在Map阶段,倾斜的键值可能导致部分Map任务异常缓慢,阻碍整个作业的进展。

在Reduce阶段,倾斜的键值会导致部分Reduce任务积压大量数据,影响最终的输出效率。这不仅延长了作业的总体执行时间,还可能导致Map和Reduce节点之间的数据传输瓶颈。

### 2.3.2 对作业性能的影响

数据倾斜会直接降低MapReduce作业的性能和可伸缩性。由于任务处理时间和资源消耗不均衡,资源利用效率低下,整体作业的执行时间将增加。在极端情况下,倾斜严重的任务可能因为资源耗尽而失败,导致作业需要重新执行,增加了作业失败的风险和资源成本。

另一方面,数据倾斜还会使得整个作业的执行时间受制于处理速度最慢的任务。即使大多数任务已经完成,作业也无法结束,因为系统需要等待所有任务完成。这进一步加剧了资源的浪费和作业的延迟。

接下来的章节将会深入探讨数据倾斜的诊断与分析,以及解决数据倾斜问题的策略与实践,帮助读者更有效地应对这一挑战。

# 3. 数据倾斜问题的诊断与分析

数据倾斜是MapReduce作业中常遇到的一个问题,表现为数据在Map或者Reduce阶段分布不均,导致部分任务处理的数据量远远大于其他任务。这种情况会严重影响作业的执行效率和集群资源的利用率。在深入了解数据倾斜问题后,准确诊断和分析数据倾斜现象是寻找解决方案的第一步。

## 3.1 数据倾斜的诊断方法

在处理数据倾斜问题之前,需要掌握几种有效的诊断方法,以准确找出数据倾斜发生的原因和位置。

### 3.1.1 使用日志分析和计数器

MapReduce作业的执行日志和计数器是诊断数据倾斜的第一手资料。通过分析作业日志,可以发现哪些任务运行时间异常,哪些任务占用的资源远高于其他任务。计数器则能反映每个任务处理的数据量,帮助我们了解数据倾斜的程度。

以下是一个简化的MapReduce作业示例:

```java

public class MyMapReduce {

public static class MyMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 处理输入的行,提取单词

// ...

word.set(word);

context.write(word, one);

}

}

public static void main(String[] args) throws Exception {

// 设置Job的配置,例如输入输出路径等

// ...

Job job = Job.getInstance(conf);

job.setJarByClass(MyMapReduce.class);

job.setMapperClass(MyMapper.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

// 提交作业并等待执行完成

// ...

}

}

```

假设在作业执行过程中,我们通过日志发现某些特定的键(word)导致了严重的数据倾斜。通过查看计数器,我们可以确认这些键的数量和分布情况,这将帮助我们进行下一步的分析。

### 3.1.2 借助MapReduce监控工具

除了日志和计数器,市场上存在多种MapReduce监控工具,这些工具可以提供实时的作业执行情况监控。例如,Ambari, Ganglia或Cloudera Manager等工具可以提供图形化的资源使用情况和作业进度,对于发现数据倾斜有直观的帮助。

在实际工作中,我们可能会使用如下的命令行指令来启动MapReduce作业的监控:

```bash

yarn application -list

yarn application -status <APPLICATION_ID>

```

使用这些监控工具,我们能够可视化地看到每个Map和Reduce任务的进度和资源消耗情况。如果发现有任务进度远落后于其他任务,或者资源消耗异常,这可能是数据倾斜的征兆。

## 3.2 数据倾斜的分析技巧

在诊断出数据倾斜后,我们需要进一步分析其背后的原因,从而找到合适的解决策略。

### 3.2.1 通过作业历史了解倾斜模式

MapReduce作业的历史记录可以提供关于数据倾斜模式的线索。历史记录中包含了每次作业的详细执行信息,通过对比不同时间点的作业执行情况,可以发现是否存在周期性的数据倾斜问题。

例如,在Hadoop的作业历史服务器中,我们可以查询特定作业的详细信息,如每个任务的执行时间,失败情况等。

### 3.2.2 使用样本数据进行预分析

在处理大规模数据集之前,可以先使用小规模的样本数据进行预分析。通过样本数据的MapReduce处理,我们可以观察到键值分布情况,了解可能发生的倾斜模式。

一种有效的预分析方法是使用MapReduce的Combiner函数,它可以在Map阶段完成后就进行局部的键值合并,减少数据倾斜的发生。例如:

```java

public class MyCombiner extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

通过这个Combiner,我们可以在Map阶段减少输出数据量,有助于预防数据倾斜的发生。

本章节介绍了数据倾斜的诊断与分析方法,为解决数据倾斜问题奠定了基础。在下一章节中,我们将深入探讨各种解决数据倾斜的策略与实践。

# 4. 解决数据倾斜的策略与实践

### 4.1 重新设计键值分布

在分布式计算中,键值分布的均匀性直接影响到MapReduce作业的性能。当某个键值产生过多的记录,就会导致与之关联的Reduce任务处理时间远超其他任务,形成瓶颈。因此,重新设计键值分布是解决数据倾斜问题的首要策略之一。

#### 4.1.1 对键值进行预处理

在数据进入MapReduce之前,可以通过预处理手段来优化键值分布。例如,使用随机前缀或者添加随机数的方式对键值进行扰动,这样原本集中在同一个键值上的数据就可以分散到不同的键值中去。这种方法适用于键值数据倾斜比较严重的情况。

```java

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

public class KeyPreprocessingMapper extends Mapper<LongWritable, Text, Text, Text> {

private static final String SALT = "salt";

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

String[] fields = value.toString().split("\t");

String originalKey = fields[0];

String saltedKey = originalKey + SALT;

context.write(new Text(saltedKey), value);

}

}

```

上述代码示例中,通过给原始键值添加一个固定的前缀(例如“salt”),从而改变键值的分布情况。实际应用中,`SALT`可以是一个根据某种规则生成的随机字符串。

#### 4.1.2 使用组合键和哈希技术

另一个方法是使用组合键。这通常是在键值本身无法有效避免倾斜,或者重新生成键值代价太高的情况下采用的策略。通过将原始键值与一些其他信息(如IP地址、时间戳等)组合,可以生成新的键值,从而改变数据分布。

```java

public class CompositeKeyMapper extends Mapper<LongWritable, Text, Text, Text> {

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

String[] fields = value.toString().split("\t");

String originalKey = fields[0];

String compositeKey = originalKey + "_" + fields[1]; // 假设第二个字段是可组合信息

context.write(new Text(compositeKey), value);

}

}

```

在此代码中,我们将原始键值和相邻字段组合,形成新的键值。这种组合键的生成要确保它能够均匀地分布到各个Reduce任务中去。

### 4.2 优化MapReduce作业配置

除了从数据层面解决数据倾斜外,合理配置MapReduce作业也是提高性能的关键。通过调整Reducer任务的数量和分配给Map和Reduce任务的内存和CPU资源,可以在一定程度上优化数据倾斜问题。

#### 4.2.1 配置合理的Reduce任务数

在Hadoop中,Reduce任务的数量默认由参数 `mapreduce.job.reduces` 控制,但这个数量并不总是最优的。通常建议将这个值设置为集群总的核心数乘以1.5到2的因子,或者根据历史作业的性能数据来调整。

```shell

hadoop jar your-mapreduce-job.jar -D mapreduce.job.reduces=30

```

通过指定参数来调整Reduce任务的数量。需要注意的是,增加Reduce任务数可以减轻每个任务的负载,但过多的任务数也会引入额外的管理开销。

#### 4.2.2 调整Map和Reduce任务的内存和CPU资源

Map和Reduce任务的资源分配直接影响其性能。在资源有限的集群中,合理分配内存和CPU资源,特别是在MapReduce作业出现倾斜时,可以有效提高任务的执行效率。

```shell

hadoop jar your-mapreduce-job.jar -D mapreduce.map.memory.mb=1536 -D mapreduce.reduce.memory.mb=3072

```

通过上述命令调整Map和Reduce任务的内存分配。通常需要根据作业的实际情况和测试结果来调整这些值,确保任务有足够的资源应对倾斜的处理。

### 4.3 应用案例分析

通过对实际案例的分析,我们可以更直观地了解解决数据倾斜的策略是如何被应用和优化的。

#### 4.3.1 处理常见数据倾斜问题的实际案例

假设有一个电商交易数据集,其中包含大量的重复订单号,导致订单号为“12345”的Map任务处理的数据量远远大于其他任务。通过日志分析,我们发现数据倾斜主要由订单号字段的重复值引起。

#### 4.3.2 优化前后的性能对比分析

在引入键值预处理和调整了Reduce任务数之后,我们对比了优化前后的作业执行时间。

| 作业阶段 | 优化前执行时间 | 优化后执行时间 |

|--------|--------------|--------------|

| Map | 15分钟 | 10分钟 |

| Reduce | 30分钟 | 15分钟 |

优化后,Map任务和Reduce任务的执行时间都有了明显的下降,整体作业执行时间从45分钟降低到了25分钟,性能提升显著。

通过上述的案例,我们可以看到,解决数据倾斜不仅需要调整策略,还需要根据实际情况进行细致的配置和调整。而通过具体案例的分析,我们更能够理解这些策略和调整在实际操作中的应用效果。

# 5. 深入优化MapReduce性能

## 5.1 提高Map阶段性能

### 5.1.1 优化Map函数的数据处理逻辑

在MapReduce框架中,Map阶段负责处理输入数据并生成中间键值对。如果Map阶段处理逻辑不够高效,会导致处理速度缓慢,进而影响整个作业的执行时间。优化Map函数的数据处理逻辑是提高Map阶段性能的关键。

#### 代码块示例:

```java

public class MyMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

@Override

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

String[] words = value.toString().split("\\s+"); // 将行文本分割成单词

for(String str : words) {

word.set(str);

context.write(word, one); // 输出单词计数

}

}

}

```

在上述代码中,我们使用Java作为编程语言。为了避免对不必要的文本进行处理,`map`函数应该尽量简洁。例如,在处理文本数据时,应避免使用复杂的正则表达式进行分割,这可能会消耗大量CPU资源。简单的空格分隔符足以处理大部分文本分割任务。

在代码逻辑上,应尽量避免重复的字符串操作,如在循环内部重新创建字符串对象。确保对象的重用,并使用合适的集合和数据结构来优化性能。此外,还可以通过选择合适的序列化框架来减少数据传输时的开销。

### 5.1.2 对输入数据进行局部预处理

预处理阶段是数据处理作业中经常被忽视的一个环节。在数据输入到MapReduce作业之前,进行适当的预处理,可以减轻Map阶段的压力,提高数据处理的效率。

#### 表格展示数据预处理的好处:

| 预处理的好处 | 描述 |

| ------------ | ---- |

| 数据清洗 | 删除无用数据,纠正错误记录 |

| 数据转换 | 格式化数据,使之适合于MapReduce的输入格式 |

| 数据过滤 | 移除不相关或低价值的数据,保留有效数据 |

| 数据聚合 | 合并数据记录,减少Map任务数量 |

| 数据分区 | 提前确定数据范围,有利于后续的负载均衡 |

进行数据预处理时,可以使用ETL工具或脚本语言如Python和Shell来进行。预处理操作包括但不限于清洗数据,去除重复项,转换数据格式,调整数据范围以优化性能。例如,如果数据中存在大量重复记录,可以在存储之前进行去重操作,减少Map任务处理的重复计算量。

## 5.2 提高Reduce阶段性能

### 5.2.1 Reduce端数据的合并和优化

Reduce阶段主要负责对来自所有Map任务的中间数据进行合并处理。性能瓶颈通常出现在数据合并阶段,特别是当Map任务产生大量相同键值的中间数据时。针对这一情况,可以采用一些策略提高Reduce端的性能。

#### mermaid格式流程图展示Reduce端数据合并过程:

```mermaid

flowchart LR

subgraph Map阶段

direction TB

A[输入数据] --> B[Map函数处理]

B --> C[中间键值对]

end

subgraph Shuffle阶段

direction LR

C --> D[根据Key分配]

D --> E[排序与合并]

end

subgraph Reduce阶段

direction TB

E --> F[Reduce函数处理]

F --> G[输出结果]

end

```

在上述流程图中,Shuffle阶段负责将Map输出的中间键值对分配给相应的Reduce任务,以及对这些键值对进行排序与合并。

优化Reduce端数据合并的一个常见方法是使用Combiner函数。Combiner函数可以在Map输出结果到Shuffle之前,对这些结果进行本地合并,减少需要传输到Reduce任务的数据量。Combiner函数必须是可交换的和可结合的,这样可以保证数据合并的正确性。

### 5.2.2 使用Combiner函数减少数据传输

如前所述,Combiner函数可以减少数据传输和网络I/O开销。它在Map和Reduce阶段之间起到"局部归纳"的作用,尤其是在进行词频统计、求和等类型操作时。

#### 代码块展示Combiner的使用:

```java

public class MyCombiner extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for(IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

在实际应用中,可以通过设置作业配置来启用Combiner:

```java

job.setCombinerClass(MyCombiner.class);

```

## 5.3 性能优化的高级技巧

### 5.3.1 采用自定义分区器改善负载均衡

分区器负责在Map任务完成后,将中间数据分配给相应的Reduce任务。如果分区不合理,可能会导致负载不均衡,从而影响作业性能。

#### 自定义分区器的代码示例:

```java

public class MyPartitioner extends Partitioner<Text, IntWritable> {

@Override

public int getPartition(Text key, IntWritable value, int numPartitions) {

String word = key.toString();

if (word.startsWith("a") || word.startsWith("b")) {

return 0;

} else if (word.startsWith("c") || word.startsWith("d")) {

return 1;

} else {

return numPartitions - 1;

}

}

}

```

自定义分区器允许开发者根据业务逻辑自定义数据的分配策略,以优化负载均衡。例如,如果知道某些键值会特别多,可以将这些键值映射到特定的Reduce任务上,避免出现某些Reduce任务处理过载的情况。

### 5.3.2 利用缓存文件提升数据访问速度

在某些情况下,MapReduce作业可能需要处理一些小的静态数据文件,比如查找表或索引。利用Hadoop的分布式缓存机制可以将这些文件缓存到各个任务执行的节点上,从而加快数据访问速度。

#### 配置分布式缓存的代码示例:

```java

Configuration conf = getConf();

Job job = Job.getInstance(conf, "My MapReduce Job");

URL[] cacheFiles = {new URL("hdfs://namenode/path/to/cache/file1.txt")};

FileSystem fs = FileSystem.get(conf);

for(URL *** {

Path path = new Path(file.getPath());

if(fs.exists(path)) {

DistributedCache.addCacheFile(file.toURI(), job.getConfiguration());

}

}

```

通过分布式缓存机制,作业中的每个任务都能快速访问这些文件,而不需要进行远程调用或网络传输,从而加快数据处理速度。

总结来说,优化MapReduce性能是一个系统性的工程,需要从业务逻辑、数据处理逻辑、网络通信和硬件资源配置等多个维度综合考虑。对于有经验的IT从业者来说,深入理解并运用上述优化技巧,可以显著提升MapReduce作业的执行效率和性能。

# 6. MapReduce的未来展望与挑战

MapReduce自诞生以来,一直是大数据处理领域的重要技术之一。随着数据量的不断增长和技术的快速发展,MapReduce也面临着新的挑战和机遇。本章将从MapReduce在大数据环境下的未来展望、持续的性能优化方向以及向新一代数据处理框架的演进等方面进行详细探讨。

## 6.1 大数据环境下的MapReduce

### 6.1.1 与现代大数据技术的融合

在当前的大数据环境下,MapReduce需要与Hadoop生态系统中的其他技术如Hive、Pig、Spark等更好地融合。MapReduce的核心是分布式的并行处理,这一点在Hadoop的其他组件中也有所体现。例如,Spark通过弹性分布式数据集(RDD)简化了编程模型,同时提供了内存计算能力,极大地提高了数据处理速度。

### 6.1.2 面临的新挑战和机遇

随着物联网、云计算和人工智能等技术的兴起,MapReduce在处理实时性要求更高、数据种类更多、计算模型更复杂的大数据任务时,面临着新的挑战。然而,这些挑战同时也为MapReduce带来了新的应用场景和机遇。MapReduce需要进一步优化以适应快速数据流处理的需求,并且在机器学习、图计算等领域展现其能力。

## 6.2 持续的性能优化方向

### 6.2.1 自动化调优工具的发展

性能优化是一个复杂且耗时的过程。自动化调优工具的发展可以帮助开发者和管理员优化MapReduce作业。这些工具可以基于历史数据和机器学习算法自动选择最优的配置参数和作业调度策略,从而提高资源利用率和作业执行效率。

### 6.2.2 机器学习在性能优化中的应用

机器学习技术在性能优化中的应用也在逐步展开。通过使用机器学习算法分析历史作业性能,可以预测并优化未来作业的执行。例如,机器学习模型可以预测哪些Map任务会产生数据倾斜,并在作业开始前进行干预,从而减少倾斜发生的可能性。

## 6.3 从MapReduce到新一代数据处理框架

### 6.3.1 新框架对数据倾斜的处理

新一代的数据处理框架,如Apache Flink和Apache Beam,提供了更先进的数据处理能力。这些框架在设计上就考虑了数据倾斜问题,并提供了相应的机制来避免或减轻数据倾斜的影响。比如,Flink通过时间窗口和事件时间处理机制有效地处理了数据倾斜问题。

### 6.3.2 实际业务中的框架迁移经验分享

在实际业务中,从MapReduce迁移到新的数据处理框架是一个复杂的过程。迁移时需要考虑数据格式、计算逻辑和性能等多个方面。本部分将分享一些成功的迁移案例和经验教训,帮助读者理解迁移的挑战和可能的解决方案。

随着大数据处理技术的不断进步,MapReduce也在不断地演化,以适应新的需求。本章节对MapReduce未来的发展方向进行了展望,指出了性能优化和框架迁移的潜在方向,为MapReduce的长远发展提供了思路。

0

0