数据预处理中的特征工程:创建更有意义和可预测的特征

发布时间: 2024-07-20 16:06:14 阅读量: 59 订阅数: 41

# 1. 数据预处理概述**

数据预处理是机器学习流程中至关重要的一步,它涉及到将原始数据转换为模型可以理解和处理的形式。其主要目的是提高模型的性能,减少过拟合,并确保结果的可靠性。

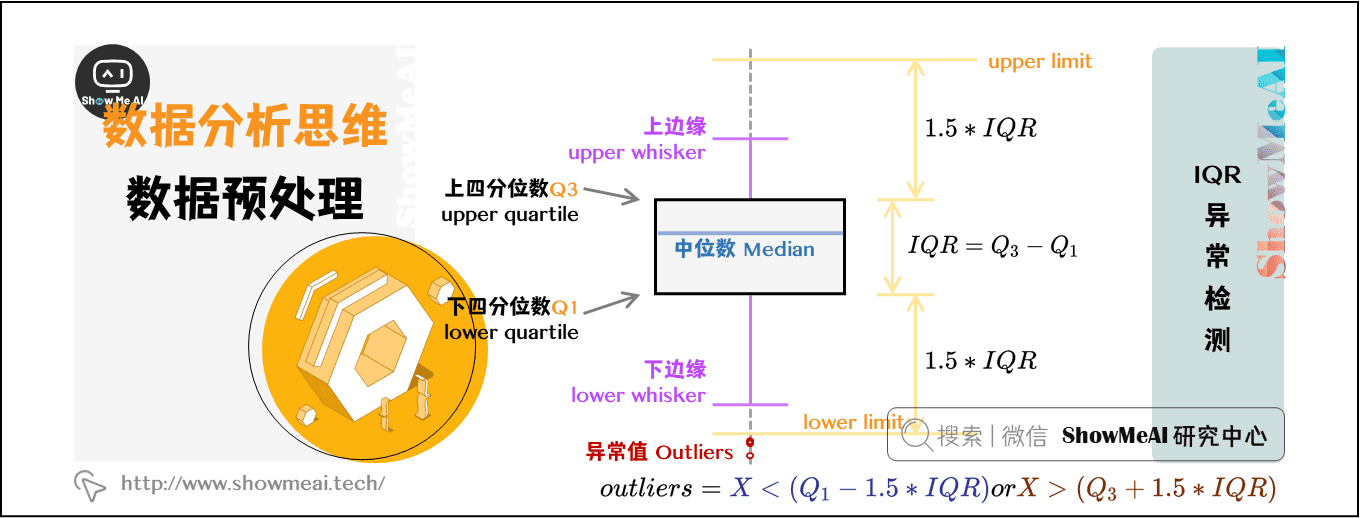

数据预处理包括一系列技术,如数据清理、数据转换和特征工程。数据清理涉及处理缺失值、异常值和不一致性。数据转换涉及将数据转换为更适合建模的形式,例如将分类变量转换为哑变量。特征工程是一个更高级的过程,涉及创建新特征或修改现有特征以提高模型的性能。

通过数据预处理,我们可以确保数据质量高,模型可以有效地学习数据中的模式和关系。

# 2. 特征工程理论

### 2.1 特征的重要性

#### 2.1.1 特征对模型性能的影响

特征是机器学习模型输入的数据,其质量直接影响模型的性能。高质量的特征可以提高模型的准确性、泛化能力和鲁棒性。

- **准确性:**特征与目标变量相关性越高,模型预测越准确。

- **泛化能力:**特征能够捕获数据中的一般规律,使模型在新的数据上也能表现良好。

- **鲁棒性:**特征对噪声和异常值不敏感,使模型能够处理现实世界中的不确定性。

#### 2.1.2 特征选择的原则

特征选择是选择对模型性能贡献最大的特征的过程。原则包括:

- **相关性:**特征与目标变量高度相关。

- **冗余性:**特征之间不应高度相关,避免重复信息。

- **信息量:**特征包含的信息量大,能够区分不同的数据点。

- **稳定性:**特征在不同的数据集或子集中保持稳定。

### 2.2 特征工程的常见技术

特征工程是一系列技术,用于创建和转换原始数据,以提高模型性能。常见技术包括:

#### 2.2.1 数值特征的处理

- **归一化:**将数值特征缩放到特定范围内,消除量纲差异。

- **标准化:**将数值特征转换为均值为 0、标准差为 1 的正态分布,提高模型稳定性。

- **对数变换:**处理偏态分布的数值特征,使分布更接近正态分布。

#### 2.2.2 分类特征的处理

- **独热编码:**将分类特征转换为二进制变量,每个类别对应一个变量。

- **标签编码:**将分类特征转换为整数,但可能引入排序信息。

- **二值化:**将分类特征转换为二进制变量,表示是否存在特定类别。

#### 2.2.3 特征转换和降维

- **特征转换:**将原始特征转换为新的特征,以增强模型性能。例如,创建交互特征、多项式特征。

- **特征降维:**减少特征数量,同时保留重要信息。例如,主成分分析 (PCA)、线性判别分析 (LDA)。

# 3. 特征工程实践

### 3.1 特征选择

特征选择是特征工程中至关重要的一步,它可以帮助我们从原始特征集中选择出最具信息量和预测力的特征,从而提高模型的性能。特征选择的方法主要分为三类:

#### 3.1.1 过滤法

过滤法是一种基于特征的统计属性来选择特征的方法。常用的过滤法包括:

- **相关性分析:**计算特征与目标变量之间的相关系数,选择相关性较高的特征。

- **方差分析:**计算特征的方差,选择方差较大的特征,因为方差较大的特征包含更多信息。

- **信息增益:**计算每个特征对目标变量的信息增益,选择信息增益较大的特征。

#### 3.1.2 包裹法

包裹法是一种基于模型性能来选择特征的方法。它将特征选择过程与模型训练过程结合起来,通过迭代的方式选择出最优的特征子集。常用的包裹法包括:

- **递归特征消除 (RFE):**从原始

0

0