立体视觉里程计仿真框架深度剖析:构建高效仿真流程

发布时间: 2024-11-13 20:31:29 阅读量: 33 订阅数: 25

视觉里程计+基于深度学习的图像匹配算法研究+视觉SLAM

# 1. 立体视觉里程计仿真基础

在现代机器人导航和自主车辆系统中,立体视觉里程计(Stereo Visual Odometry)作为一项关键技术,通过分析一系列图像来估计相机的运动。本章将介绍立体视觉里程计仿真基础,包括仿真环境的基本概念、立体视觉里程计的应用背景以及仿真在研究和开发中的重要性。

立体视觉里程计仿真允许在受控的虚拟环境中测试算法,而不需要物理实体。这种仿真方法不仅降低了成本,还加速了开发周期,因为可以快速迭代和评估不同算法的性能。

## 1.1 仿真环境的基本概念

仿真环境是一种用于模拟现实世界情况的工具,它可以在没有风险的情况下复现、测试和分析复杂系统的行为。在立体视觉里程计研究中,仿真环境提供了一个安全、可控的平台,通过模拟相机运动和环境变化,来验证算法的准确性和鲁棒性。

## 1.2 立体视觉里程计的应用背景

立体视觉里程计的算法在自动驾驶车辆、机器人导航、移动测绘设备等领域有广泛的应用。它通过分析两个或多个摄像头捕获的图像序列来估计运动和环境结构。通过精确的相机校准和高效的图像处理技术,可以达到实时或接近实时的性能。

## 1.3 仿真在研究和开发中的重要性

仿真技术在研究和开发过程中扮演着至关重要的角色。它使研究者和开发者能够在不具备实际硬件的条件下验证算法和系统性能。这不仅节约了开发成本,而且允许在极端或危险的条件下测试算法,从而提高了系统的可靠性和安全性。

# 2. 仿真框架的关键理论分析

## 2.1 立体视觉里程计的数学基础

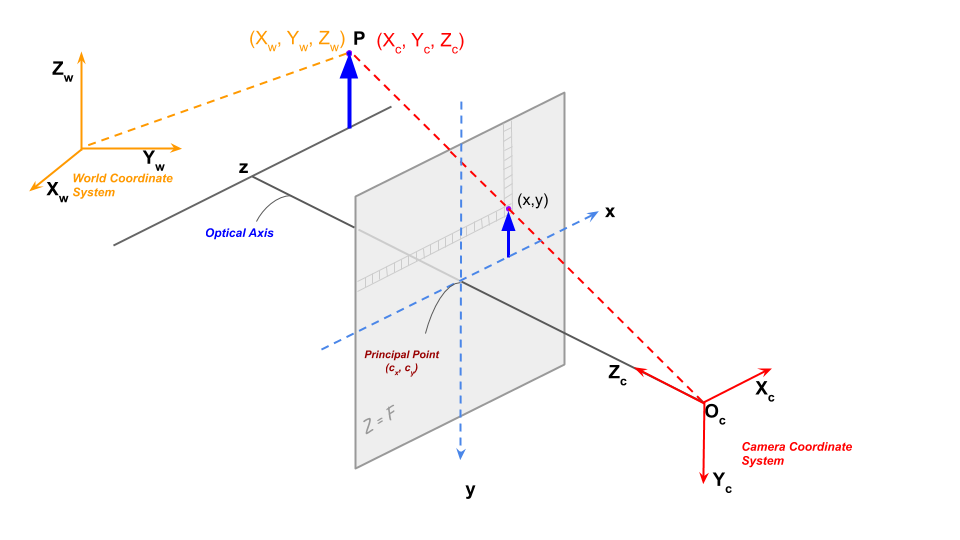

### 2.1.1 相机成像原理

相机成像原理是立体视觉里程计仿真框架中的核心部分,它涉及了光的直线传播和成像的过程。在一个简单的相机模型中,假设世界坐标系中的一个点通过透镜投影到成像平面上,产生了一个二维图像点。这个过程可以用针孔模型来描述,其中包含了以下关键概念:

- **外部参数**:描述了相机与世界坐标系之间的位置与朝向关系,主要由旋转矩阵和平移向量组成。

- **内部参数**:涵盖了相机自身的特性,如焦距、主点位置、镜头畸变等。

- **投影模型**:通常使用线性变换来模拟,但在考虑镜头畸变的情况下,需要引入非线性变换。

在数学上,世界坐标系中的一点到图像坐标系中的一点的映射关系可以表示为:

\[

s\begin{bmatrix} u \\ v \\ 1 \end{bmatrix} = \begin{bmatrix} f_x & 0 & c_x \\ 0 & f_y & c_y \\ 0 & 0 & 1 \end{bmatrix} \begin{bmatrix} r_{11} & r_{12} & r_{13} & t_x \\ r_{21} & r_{22} & r_{23} & t_y \\ r_{31} & r_{32} & r_{33} & t_z \end{bmatrix} \begin{bmatrix} X_w \\ Y_w \\ Z_w \\ 1 \end{bmatrix}

\]

这里,\(s\)是尺度因子,\(f_x\)和\(f_y\)是焦距,\((c_x, c_y)\)是主点坐标,\(R\)是旋转矩阵,\(t\)是平移向量。

### 2.1.2 特征提取与匹配算法

特征提取与匹配是立体视觉里程计中最关键的步骤之一。特征匹配的好坏直接关系到三维空间重建的质量和准确性。特征提取旨在从图像中找到具有代表性的点或者区域,这些点需要具有可重复性,即在不同图像之间能够被唯一识别。

#### 特征提取算法

常见的特征提取算法包括SIFT、SURF、ORB等。这些算法各有优劣,以SIFT为例,其具有尺度不变性和旋转不变性,能够在多尺度空间中检测关键点并生成描述子,使得这些关键点可以在不同图像中进行匹配。

#### 特征匹配算法

特征匹配算法主要分为基于描述子的匹配和基于几何约束的匹配。基于描述子的匹配例如使用FLANN匹配器或者暴力匹配器(Brute Force Matcher)来比较特征描述子间的相似度。基于几何约束的匹配则是在匹配的基础上加入了额外的约束条件,比如对极几何约束,来过滤掉错误的匹配。

#### 匹配质量的评估

对于匹配结果,通常需要使用一些方法来评估匹配的正确性。例如,可以计算匹配点之间的距离,剔除距离异常的点。也可以使用RANSAC算法来找到最佳的内、外参数估计,以排除错误的匹配。

### 2.1.3 特征匹配优化方法

特征匹配在实际操作中往往面临各种噪声和遮挡的问题,因此必须通过各种优化手段来提升匹配的准确率。以下是一些常见的优化方法:

- **最小二乘法优化**:当有大量匹配点时,最小二乘法可以用来进一步优化这些匹配点的相机位置和姿态估计。

- **RANSAC算法**:这是一种鲁棒的估计方法,能够在有大量外点的情况下,找到满足数据的最优解。

- **局部优化**:例如光束平差法(Bundle Adjustment),它是相机标定和三维重建中的一种全局优化方法,通过迭代计算来改进所有特征点的三维坐标和相机参数。

### 2.1.4 代码分析:特征提取与匹配

以下是一个使用OpenCV进行特征提取与匹配的Python代码示例:

```python

import cv2

import numpy as np

# 读取图片

img1 = cv2.imread('image1.jpg', 0) # 查询图像

img2 = cv2.imread('image2.jpg', 0) # 训练图像

# 初始化ORB检测器

orb = cv2.ORB_create()

# 找到关键点和描述符

kp1, des1 = orb.detectAndCompute(img1, None)

kp2, des2 = orb.detectAndCompute(img2, None)

# 创建匹配器

bf = cv2.BFMatcher(cv2.NORM_HAMMING, crossCheck=True)

# 进行匹配

matches = bf.match(des1, des2)

# 根据距离排序

matches = sorted(matches, key=lambda x: x.distance)

# 绘制前10个匹配项

img3 = cv2.drawMatches(img1, kp1, img2, kp2, matches[:10], None, flags=2)

# 显示匹配结果

cv2.imshow('Matches', img3)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

在上述代码中,我们首先使用ORB检测器检测关键点并计算它们的描述子,然后使用BFMatcher进行匹配。匹配结果通过距离进行排序,选取最佳匹配。最后,使用`drawMatches`函数将匹配结果显示在输出图像上。

### 2.1.5 表格:不同特征提取算法的比较

| 特征提取算法 | 优点 | 缺点 |

| ------------ | ---- | ---- |

| SIFT | 尺度不变性、旋转不变性、光照不变性 | 计算复杂度高、专利限制 |

| SURF | 快速、尺度不变性、旋转不变性 | 计算复杂度较高、专利限制 |

| ORB | 计算速度快、抗旋转、抗缩放 | 算法的鲁棒性相对较差 |

### 2.1.6 mermaid流程图:特征匹配流程

```mermaid

graph LR

A[开始] --> B[读取图像]

B --> C[使用ORB检测关键点与描述子]

C --> D[创建BFMatcher对象]

D --> E[进行特征匹配]

E --> F[排序匹配结果]

F --> G[绘制最佳匹配项]

G --> H[显示匹配结果]

H --> I[结束]

```

以上流程图展示了特征匹配的基本步骤,从读取图像开始,到结束匹配并显示结果的整个过程。

## 2.2 仿真环境的构建

### 2.2.1 选择合适的仿真软件

仿真环境的构建是开发立体视觉里程计仿真框架的基础。合适的仿真软件应该具备以下特点:

- **模型导入能力**:能够导入或者直接生成相机、物体、环境等模型。

- **物理引擎**:拥有精确的物理引擎,模拟真实世界的物理现象,如光线传播、碰撞检测等。

- **编程接口**:提供API以支持编写复杂的交互逻辑和仿真流程。

- **可视化效果**:提供高质量的渲染效果,以便准确观察仿真结果。

市场上常见的仿真软件包括Gazebo、Blender和Unity3D等。其中,Gazebo由于其强大的机器人仿真能力及开源特性而广受欢迎。Blender提供了强大的建模和渲染功能,适合创建高质量的三维场景。Unity3D则因其用户友好性、扩展性和多平台支持等优点,在游戏开发和交互式仿真领域得到广泛应用。

### 2.2.2 环境参数的设置与调整

设置和调整环境参数是构建仿真环境时的一个重要步骤,这通常包括:

- **相机参数**:包括焦距、光圈大小、传感器尺寸等。

- **环境参数**:如光照条件、物体的颜色与纹理、环境的布局等。

- **仿真控制参数**:例如,时间步长、仿真的持续时间等。

在设置这些参数时,应确保它们能够尽可能地模拟真实世界的条件,以便生成的仿真数据可以用于真实场景中的立体视觉里程计验证。

### 2.2.3 代码块:环境参数设置的伪代码

```python

# 环境参数设置的伪代码示例

def set_simulation_parameters():

# 设置相机参数

camera_params = {

'focal_length': (700, 700), # 焦距

'principal_point': (320, 240), # 主点坐标

'sensor_size': (36.0, 24.0), # 传感器尺寸

}

# 设置环境参数

environment_params = {

'ambient_light': 0.5, # 环境光强度

'texture_map': 'path/to/texture.jpg', # 纹理贴图路径

}

# 设置仿真控制参数

control_params = {

'time_step': 0.01, # 时间步长

'simulation_duration': 60, # 仿真的持续时间

}

# 应用设置的参数

apply_parameters(camera_params, environment_params, control_params)

print("仿真参数已设置完成")

# 调用参数设置函数

set_simulation_parameters()

```

在上述代码中,我们定义了一个函数`set_simulation_parameters`,用于设置相机参数、环境参数和仿真控制参数。通过调用这个函数,我们完成了整个仿真环境的参数设置。

## 2.3 立体视觉里程计的数据流

### 2.3.1 数据采集流程

立体视觉里

0

0