贝叶斯优化商业化实践:行业案例与应用策略分析

发布时间: 2024-11-23 22:00:25 阅读量: 24 订阅数: 31

数据挖掘与数据分析应用案例 数据挖掘算法实践 基于Python的数据挖掘在电商客户关系管理中的应用.doc

# 1. 贝叶斯优化的理论基础

贝叶斯优化是一种基于概率模型的全局优化算法,它在机器学习、工业工程等领域得到了广泛应用。理解贝叶斯优化的理论基础需要首先掌握概率论与优化理论的基本概念。

## 1.1 目标函数与优化问题

目标函数是优化问题的核心,它表示为一个数学模型,其中输入变量和输出值之间的关系被量化。在贝叶斯优化中,目标函数往往是未知且复杂的,且求解过程可能伴随着计算成本。因此,贝叶斯优化的宗旨是在尽可能少地评估目标函数的前提下,寻找到全局最优解或者一个接近最优的解。

## 1.2 概率模型的选择与应用

贝叶斯优化的核心在于构建一个概率模型来近似目标函数,并用它来预测潜在的最佳点。高斯过程(Gaussian Process, GP)是最常见的选择,因为它能够很好地量化预测的不确定性。利用概率模型,贝叶斯优化算法可以平衡探索(exploration)和利用(exploitation)之间的关系,有效地指导搜索过程以找到最优解。

# 2. ```

# 第二章:贝叶斯优化算法详解

## 2.1 贝叶斯优化原理

### 2.1.1 目标函数与优化问题

贝叶斯优化是一种基于概率模型的全局优化策略,尤其适用于目标函数难以精确求解或者求解成本极高的情况。在实际应用中,目标函数通常是指需要优化的系统性能,如机器学习模型的准确率、工程设计中的效率指标或者商业决策中的预期回报。优化问题则是指在一定条件下,找到目标函数的最大值或者最小值。

一个标准的优化问题可以形式化地表示为寻找一个输入向量 \( x \) 使得目标函数 \( f(x) \) 最大化或最小化,同时满足一定的约束条件 \( g_i(x) \leq 0 \)。即:

\[ \underset{x \in D}{\text{argmax/min}} f(x) \]

其中 \( D \) 是定义域,它可能包含连续的范围或者离散的集合。

目标函数 \( f(x) \) 通常具有以下特点:

- 计算成本高:可能涉及复杂的模拟或者大数据集的处理。

- 不可导或噪声:在实际应用中,目标函数可能无法通过梯度下降法优化,或者含有噪声干扰。

- 非凸性:真实世界中的目标函数往往存在多个局部最优点,使得传统优化方法难以找到全局最优解。

### 2.1.2 概率模型的选择与应用

在贝叶斯优化中,一个关键的概念是代理模型(surrogate model),它用来近似目标函数。常用的代理模型包括高斯过程(Gaussian Processes, GP)、随机森林(Random Forests)和神经网络等。其中,高斯过程因其在不确定性量化和预测分布的灵活性而成为最常用的代理模型。

高斯过程是一种无参数的概率分布模型,其任意有限个点上的联合分布都是多变量高斯分布。通过高斯过程可以得到目标函数的均值和方差估计,并基于这些信息来进行下一步的采样决策。代理模型的选择依赖于问题的特性和可用的数据量。

应用高斯过程进行目标函数代理建模的基本步骤如下:

1. 初始化:选择合适的先验分布,并设置超参数(如长度尺度、噪声水平等)。

2. 更新:根据新采样的点,更新高斯过程的均值和协方差函数。

3. 采样:利用获取的模型预测和不确定性信息,选择下一个采样点。

4. 重复:通过迭代过程,逐步精化目标函数的近似,并找到最优解。

高斯过程模型的重要特点在于其能够提供预测的不确定性估计。这允许贝叶斯优化算法在探索(exploration)与利用(exploitation)之间做出平衡,即在不确定性高的区域进行探索,在预测值高的区域进行利用。

## 2.2 贝叶斯优化流程

### 2.2.1 采样策略和先验选择

贝叶斯优化的核心流程包括初始采样、代理模型建立、采样策略选择和目标函数更新四个主要步骤。在初始采样阶段,通常使用随机采样或拉丁超立方采样等方法获取一定数量的初始数据点。

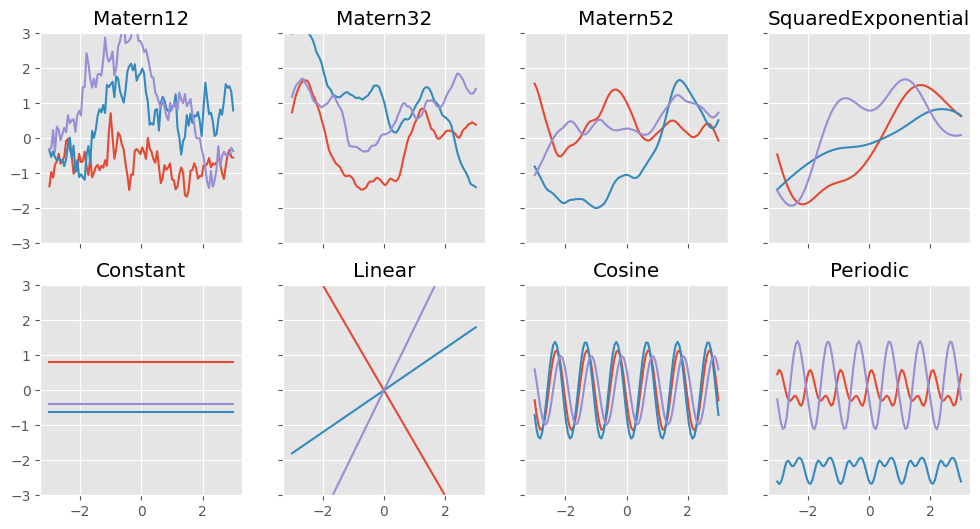

先验选择涉及到代理模型的初始化,对高斯过程而言,通常需要设定先验分布的参数,例如均值函数、协方差函数及其超参数。先验的选择会影响算法的收敛速度和最终找到的最优解。在实际应用中,常见的协方差函数有平方指数(Squared Exponential)、Matérn 和有理二次(Rational Quadratic)等。

### 2.2.2 后验更新和决策过程

在获得初始数据后,需要使用这些数据来更新代理模型的后验分布。高斯过程模型的后验更新涉及到均值函数和协方差矩阵的重新计算。更新完成后,模型的均值和方差可以用来量化目标函数的预期值和不确定性。

决策过程是根据更新后的代理模型来选择下一个采样点。贝叶斯优化中的典型策略是期望改进(Expected Improvement, EI)准则。该准则计算在考虑不确定性的情况下,当前点相比于已知最优值的改进期望。采样点选择的目的是最大化这一期望改进值。

在选择采样点后,需要评估目标函数的实际值,并将其添加到数据集中用于进一步的模型更新。如此迭代进行,直到满足停止条件(例如迭代次数、时间限制或改进阈值)。

## 2.3 贝叶斯优化算法的变种

### 2.3.1 引入自定义损失函数的优化方法

标准的贝叶斯优化方法往往假设目标函数的优化目标是单一的,即追求最大值或最小值。但在实际应用中,可能需要考虑多目标优化,或者优化目标具有复杂的约束条件。自定义损失函数的优化方法允许用户根据具体问题定义损失函数,从而调整贝叶斯优化的行为。

例如,可以设计一个损失函数来平衡模型的准确性和复杂度,或者考虑多个相互冲突的性能指标。通过自定义损失函数,贝叶斯优化可以被应用到更广泛的问题中,如强化学习、参数空间搜索等。

### 2.3.2 针对特定问题的优化算法改进

针对特定的问题和应用场景,贝叶斯优化算法也可以进行改进。例如,在工程设计中,可能需要考虑物理约束和制造成本。优化算法可以被设计来处理这些额外的约束条件,并在采样过程中避免不可行的解。

此外,对于具有特定结构的目标函数,例如在具有明显模式或周期性的数据中,可以对高斯过程进行改进,比如引入周期性核函数来提升模型的表达能力。

改进的算法通常需要结合实际应用背景和数据特性,设计合适的代理模型、采样策略和损失函数。通过这种方法,可以提高贝叶斯优化算法的效率和解的质量。

```

# 3. 贝叶斯优化的行业案例分析

## 3.1 机器学习与数据科学

贝叶斯优化在机器学习和数据科学领域中的应用可以极大地增强模型性能和数据处理的效率。以下深入探讨了贝叶斯优化在超参数调优和模型选择验证方面的案例。

### 3.1.1 超参数调优案例

机器学习模型的性能在很大程度上依赖于超参数的选择。传统网格搜索或随机搜索方法在面对高维参数空间时效率低下,而贝叶斯优化则可以更智能地探索这种空间。

以深度学习为例,假设有超参数包括学习率(learning rate)、批量大小(batch size)、卷积核数量(kernel number)等。使用贝叶斯优化进行超参数调优时,我们会构建一个代理模型(如高斯过程),并基于此模型推荐接下来的参数组合进行评估。这个过程是迭代进行的,模型会学习哪些参数组合效果好,并且哪些不好,从而指导后续

0

0