R语言pam数据包:数据清洗与整合的必学技巧

发布时间: 2024-11-03 07:18:13 阅读量: 34 订阅数: 30

# 1. R语言pam数据包概述

在数据分析领域,R语言凭借其强大的统计分析和图形表示能力,成为数据科学领域不可或缺的工具之一。而`pam`数据包则是R语言中一个专注于数据预处理的工具,它简化了数据清洗、整合和准备工作的复杂性。本章将为读者提供`pam`数据包的基本概念,并概述其在数据分析工作流中的作用。

首先,`pam`数据包是一个集成了多个函数的工具包,旨在辅助数据分析师进行数据预处理的各个环节。它支持多种数据类型,包括但不限于表格数据、时间序列数据、以及包含缺失值的数据集。

## 1.1 为什么选择pam数据包

在处理数据之前,分析师需要确保数据的准确性和一致性,`pam`数据包提供了一系列实用函数,帮助用户进行:

- 缺失值处理:通过内置函数识别并处理数据中的缺失值。

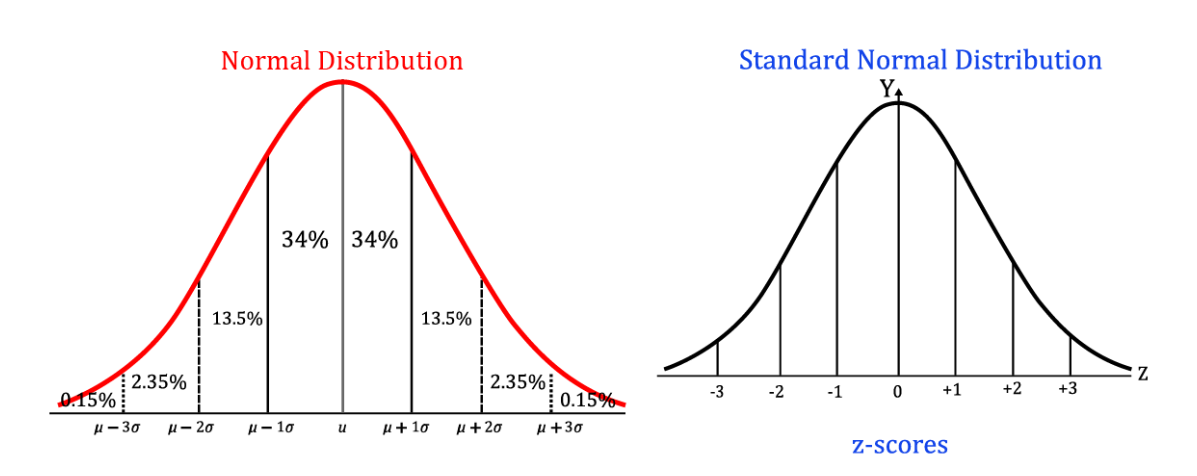

- 数据转换:支持数据的标准化、归一化,以及编码转换等。

- 数据探索:快速进行描述性统计分析,探索数据的基本特征。

这些功能虽然在R的基础包中部分已经提供,但`pam`数据包通过更简洁的语法和更集中的功能集合,使得数据预处理工作更加高效。

## 1.2 如何开始使用pam数据包

为了开始使用`pam`数据包,首先需要通过R的包管理器`install.packages()`函数安装它。一旦安装完成,加载数据包仅需一行代码:

```R

library(pam)

```

加载之后,用户可以直接调用`pam`提供的各种函数开始对数据集进行操作。下面是一个简单的示例,展示如何使用`pam`包中的`missing_values_summary`函数来获取数据集中的缺失值概览:

```R

# 假设有一个名为data的数据框

missing_values_summary(data)

```

随着本章的深入,我们将更加详细地了解`pam`包如何与其他R工具和方法协同工作,以及如何在实际的数据分析工作中发挥其作用。

# 2. 数据清洗的理论与实践

### 2.1 数据清洗的基本概念

数据清洗是数据预处理的重要步骤,旨在通过识别和纠正数据集中的错误和不一致性,提高数据的质量,确保分析结果的准确性和可靠性。数据清洗包含一系列操作,包括但不限于处理缺失数据、删除重复数据、纠正错误、统一数据格式等。

#### 2.1.1 数据清洗的重要性

在数据分析和挖掘中,数据清洗可以被认为是基础而关键的环节。未经清洗的数据可能导致模型偏差、误导性结论或者在数据集成时产生问题。数据清洗的目的在于提升数据的准确性和可用性,为后续的数据分析和决策支持提供坚实的基石。

#### 2.1.2 常见的数据清洗步骤

数据清洗通常涉及以下几个步骤:

1. **识别并处理缺失值**:缺失数据可能是由于数据记录错误、遗漏、采集过程中断等原因造成的,需要采用适当的方法处理,如删除、填补等。

2. **纠正格式不一致**:数据格式的不一致会影响到数据的比较和分析,需要统一日期格式、数字格式等。

3. **删除重复记录**:重复数据可能导致分析结果的偏差,需要通过检测和删除重复记录来修正。

4. **修正错误数据**:通过逻辑检查、范围检查等方法识别出异常值或错误,并进行修正或删除。

5. **规范化和标准化数据**:对数据进行规范化处理,如对类别数据进行编码,对数值数据进行标准化或归一化。

6. **数据转换**:根据需要转换数据格式,例如从宽格式转为长格式,或反之。

### 2.2 pam数据包在数据清洗中的应用

#### 2.2.1 利用pam包处理缺失值

pam数据包提供了处理缺失值的功能,使得用户可以通过各种方法对缺失值进行有效处理。一个基本的使用场景是通过均值填充缺失值。

```R

# 加载pam包

library(pam)

# 假设数据框df中有一些缺失值

df <- data.frame(

a = c(1, NA, 3, 4),

b = c(NA, 2, 3, NA),

c = c(5, 6, NA, 8)

)

# 使用均值填充缺失值

df_filled <- fill_na(df, mean)

# 查看结果

print(df_filled)

```

以上代码使用了`fill_na`函数来填充数据框中的缺失值。`mean`参数表明我们选择用列的平均值来替换缺失值。这个函数实际上是对数据框中每一列分别计算均值,然后用这些均值替换相应的缺失值。

#### 2.2.2 探索性数据分析在pam中的实践

在数据清洗阶段,经常需要进行探索性数据分析(EDA),以了解数据的分布情况、异常值、数据相关性等。pam包中的相关函数可以帮助进行初步的数据探索。

```R

# 以df数据框为例,展示一些基础的EDA方法

summary(df_filled) # 提供了数值型变量的统计摘要

cor(df_filled) # 计算变量间的相关系数

```

通过`summary`函数我们得到了数据框中每个变量的最小值、第一四分位数、中位数、均值、第三四分位数以及最大值,这对于评估数据的分布情况十分有用。而`cor`函数则帮助我们了解各个变量之间的线性相关程度。

### 2.3 数据清洗案例分析

#### 2.3.1 实际数据集的清洗流程

在实际应用中,数据清洗流程可能会涉及多个步骤,以确保数据质量。假设我们有一个包含多个变量的脏数据集,例如包含日期、交易金额、客户信息等。我们将首先对缺失值进行处理,然后进行数据类型转换和格式统一。

#### 2.3.2 数据清洗前后对比分析

清洗之后的数据应该更加规范和一致,这有助于后续的数据分析。我们可以通过比较清洗前后的数据摘要,使用可视化工具,比如直方图和箱线图来查看数据分布的变化,从而评估清洗效果。

在此,我们展示了一个简单的清洗前后对比的代码逻辑。

```R

# 假设有一个未清洗的数据框df_raw和清洗后的数据框df_clean

# 查看未清洗数据的统计摘要

summary(df_raw)

# 查看清洗后数据的统计摘要

summary(df_clean)

# 使用可视化比较数据分布变化

par(mfrow=c(1, 2)) # 创建一个1行2列的图形区域

hist(df_raw$amount, main="交易金额分布(清洗前)")

hist(df_clean$amount, main="交易金额分布(清洗后)")

# 比较可视化后,分析数据清洗对分布的影响

```

在上述代码中,我们首先对未清洗的数据框`df_raw`和清洗后的数据框`df_clean`进行了统计摘要的对比,然后使用`hist`函数绘制了交易金额的分布直方图,通过对比直方图能够直观地看出数据清洗对数据分布的影响。

# 3. 数据整合的理论与实践

## 3.1 数据整合的基本方法

### 3.1.1 数据集的合并与连接

在处理数据时,合并和连接数据集是日常任务。R语言中的pam包为这些操作提供了强大的支持。合并数据集通常指的是将两个或多个数据集按照一定的规则整合成一个新的数据集。连接则更侧重于根据数据集中的共同变量将数据行配对。

在pam包中,`merge()` 函数是实现数据集合并的关键函数。它可以按照一个或多个键值进行连接,而且支持多种合并方式,如内连接(inner join)、左连接(left join)、右连接(right join)以及全连接(full join)。

以下是一个简单的合并数据集的示例代码:

```r

# 载入pam包

library(pam)

# 准备两个数据框

df1 <- data.frame(ID = c(1, 2, 3),

Name = c("Alice", "Bob", "Charlie"),

Age = c(24, 27, 22))

df2 <- data.frame(ID = c(2, 3, 4),

Address = c("123 Main St", "456 Elm St", "789 Oak St"),

Phone = c("555-1234", "555-5678", "555-8765"))

# 使用merge()函数进行内连接

df3 <- merge(df1, df2, by = "ID")

print(df3)

```

### 3.1.2 数据重采样与时间序列整合

在时间序列分析和金融数据分析中,数据重采样(resampling)

0

0