卷积神经网络中卷积层的原理及作用解析

发布时间: 2024-05-02 19:15:44 阅读量: 114 订阅数: 42

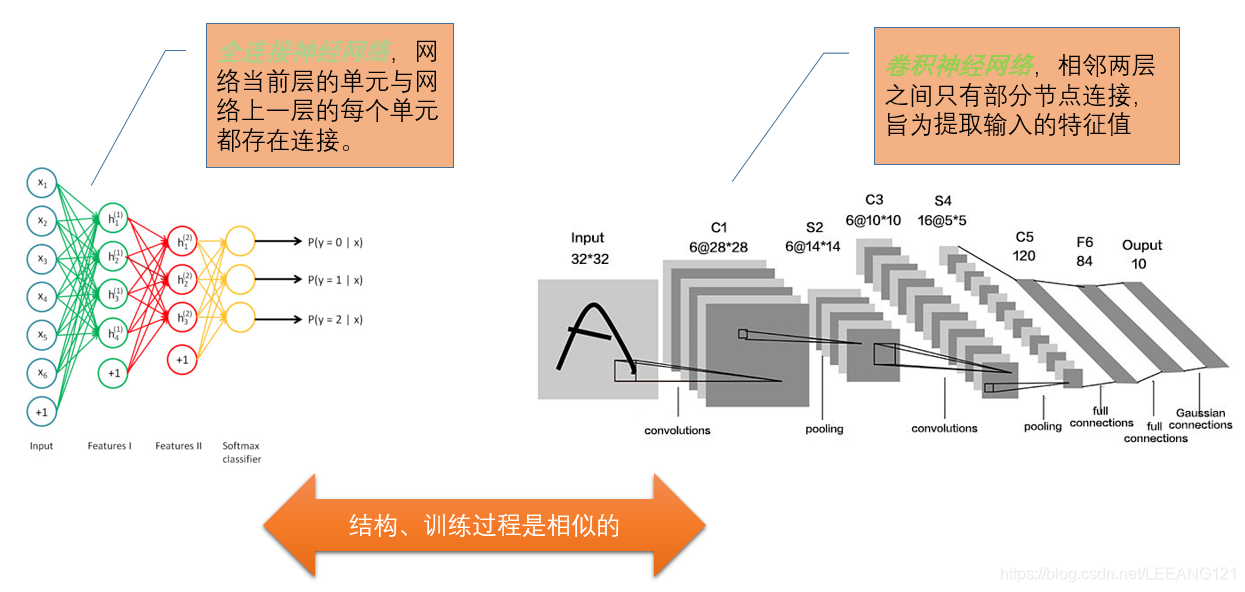

卷积神经网络的工作原理

# 1. 卷积层原理**

卷积层是卷积神经网络中最重要的组成部分,负责提取图像特征。卷积运算的本质是将一个卷积核在输入图像上滑动,并计算卷积核与图像对应区域元素的乘积和。

### 2.1 卷积运算

卷积运算的数学表达式如下:

```

(I * K)[i, j] = ΣΣ I[m, n] * K[i - m, j - n]

```

其中:

* `I` 是输入图像

* `K` 是卷积核

* `*` 表示卷积运算

* `[i, j]` 表示卷积运算后的输出图像中元素的位置

* `[m, n]` 表示卷积核中元素的位置

# 2. 卷积层原理

### 2.1 卷积运算

卷积运算是一种数学运算,用于将两个函数(或信号)结合起来产生第三个函数。在卷积神经网络中,卷积运算用于提取图像中的特征。

**卷积运算的数学定义:**

```

(f * g)(t) = ∫f(τ)g(t - τ)dτ

```

其中:

* f(t) 和 g(t) 是两个函数

* (f * g)(t) 是卷积运算的结果

* τ 是积分变量

**卷积运算的直观解释:**

卷积运算可以被想象成一个滑动窗口,在输入图像上滑动。在每个位置,窗口中的像素值与卷积核(一个权重矩阵)中的相应像素值相乘,然后求和。结果是输出特征图中的一个像素值。

### 2.2 卷积核

卷积核是一个权重矩阵,用于提取图像中的特定特征。卷积核的大小通常为 3x3 或 5x5。

**卷积核的参数:**

* **大小:**卷积核的大小决定了它提取特征的范围。

* **权重:**卷积核中的权重值决定了它对输入图像中不同像素值的影响。

**卷积核的类型:**

* **边缘检测卷积核:**用于检测图像中的边缘和轮廓。

* **平滑卷积核:**用于平滑图像并去除噪声。

* **锐化卷积核:**用于锐化图像并增强细节。

### 2.3 特征图

卷积运算的结果是一个特征图,其中每个像素值代表输入图像中特定特征的强度。

**特征图的属性:**

* **大小:**特征图的大小由输入图像的大小、卷积核的大小和步长决定。

* **通道数:**特征图的通道数由卷积核的数量决定。

* **特征:**特征图中的每个像素值代表输入图像中特定特征的强度,例如边缘、纹理或颜色。

**代码示例:**

```python

import numpy as np

# 输入图像

input_image = np.array([[1, 2, 3],

[4, 5, 6],

[7, 8, 9]])

# 卷积核

kernel = np.array([[0, 1, 0],

[1, 1, 1],

[0, 1, 0]])

# 卷积运算

output_feature_map = np.convolve(input_image, kernel, mode='valid')

# 打印输出特征图

print(output_feature_map)

```

**代码逻辑分析:**

* `np.convolve()` 函数执行卷积运算。

* `mode='valid'` 参数指定使用有效卷积,即只计算卷积核完全覆盖输入图像的部分。

* 输出特征图的大小为 (1, 1),因为卷积核的大小为 3x3,步长为 1,并且使用有效卷积。

# 3. 卷积层作用

### 3.1 特征提取

卷积层的一个主要作用是提取输入数据中的特征。卷积核在输入数据上滑动时,会对局部区域进行加权求和,从而产生一个特征图。每个特征图对应于输入数据中的一种特定特征,例如边缘、纹理或形状。

通过堆叠多个卷积层,可以提取越来越高级的特征。例如,第一层卷积层可能提取边缘和纹理等低级特征,而后续层则提取更复杂的特征,例如面部特征或物体形状。

### 3.2 特征映射

卷积运算产生的特征图称为特征映射。每个特征映射表示输入数据中特定特征的空间分布。特征映射中的每个像素

0

0