【R语言数据处理基础】:掌握tidyr包核心功能的详细教程

发布时间: 2024-11-03 05:12:03 阅读量: 37 订阅数: 42

# 1. R语言数据处理概述

随着数据分析需求的日益增长,R语言已经成为了数据科学领域内不可或缺的工具之一。在诸多数据处理任务中,R语言提供了灵活且功能强大的函数和包来应对各种场景。在这一章节中,我们将对R语言在数据处理方面的能力和相关概念进行概述。

## 1.1 R语言在数据处理中的优势

R语言是一个开源的统计分析软件,它支持各种类型的数据操作,包括数据清洗、探索性数据分析、统计建模和可视化等。与其他语言相比,R语言最大的优势在于其丰富的统计包和活跃的社区支持,这使得R语言在学术研究和工业界中得到广泛的应用。

## 1.2 R语言数据处理的核心概念

在R语言中,数据通常以数据框(data frame)的形式存在。数据框是一种表格数据结构,其中每一列可以是不同类型的数据,这种结构非常适合处理具有多种属性的观测数据集。通过各种包,如tidyverse、data.table等,可以高效地对数据进行读取、清洗、转换、汇总和可视化。

## 1.3 R语言数据处理的典型工作流程

R语言处理数据一般遵循以下流程:数据导入(加载外部数据到R环境中)、数据清洗(去除不一致、缺失、错误的数据)、数据转换(将数据转换为适合分析的格式)、数据分析(执行描述性统计、推断性统计或模型构建)和数据可视化(通过图表展示数据特征)。在后续的章节中,我们将具体介绍各个步骤的详细操作和技巧。

# 2. tidyr包的安装与基础操作

### 2.1 安装tidyr包的几种方法

#### 2.1.1 通过CRAN安装

在R语言中,安装任何包都可以通过基础函数`install.packages()`来完成。tidyr包也不例外,可以通过以下命令安装:

```r

install.packages("tidyr")

```

这个命令会从CRAN(Comprehensive R Archive Network)上下载并安装tidyr包。CRAN是R语言的主干包仓库,保证了包的稳定性和可靠性。安装完成后,你可以使用`library()`函数来加载该包:

```r

library(tidyr)

```

#### 2.1.2 从GitHub安装开发版

软件开发中,从版本控制平台GitHub直接安装包可以让用户使用最新的开发版本,可能包含尚未正式发布的新特性和bug修复。要安装tidyr的开发版本,需要先安装devtools包,然后使用其`install_github()`函数:

```r

install.packages("devtools")

devtools::install_github("tidyverse/tidyr")

```

通过这种方式安装的包可能包含不稳定或未经测试的代码,因此需要谨慎使用。

### 2.2 数据框架的创建和导入

#### 2.2.1 创建数据框架

创建数据框架可以使用tidyr包中的`data_frame()`函数,或者利用基础R的`data.frame()`函数。下面展示如何使用tidyr包创建数据框架:

```r

library(tidyr)

my_data <- data_frame(

name = c("Alice", "Bob", "Charlie"),

age = c(24, 30, 22),

salary = c(3000, 3500, 4000)

)

```

#### 2.2.2 从文件导入数据

从文件导入数据通常是数据处理的第一步。常用的文件格式包括CSV、Excel、JSON等。在R中,`read_csv()`函数可以读取CSV文件,如下所示:

```r

library(readr)

my_data <- read_csv("path/to/your/file.csv")

```

如果要处理Excel文件,可以使用`read_excel()`函数,它属于readxl包:

```r

library(readxl)

my_data <- read_excel("path/to/your/file.xlsx")

```

#### 2.2.3 使用数据库连接

有时需要将数据库中的数据导入到R中进行分析。使用`DBI`和`dbplyr`包可以实现这一点。例如,连接一个SQLite数据库可以这样做:

```r

library(DBI)

library(dbplyr)

conn <- dbConnect(RSQLite::SQLite(), "path/to/your/database.db")

my_data <- tbl(conn, "your_table_name")

```

### 2.3 数据的初步探索

#### 2.3.1 数据集的查看和摘要

查看数据集的结构和内容,可以使用`str()`、`head()`、`tail()`和`summary()`函数:

```r

str(my_data) # 查看数据结构

head(my_data) # 显示数据集的前六行

tail(my_data) # 显示数据集的最后六行

summary(my_data) # 数据集的统计摘要

```

#### 2.3.2 基本的数据统计分析

使用`summary()`函数不仅可以查看数据集的摘要,还能进行一些基础的统计分析。例如,它可以计算数值型变量的均值、中位数等统计量。

对于更复杂的数据分析,可以使用`dplyr`包来处理,例如按组计算均值:

```r

library(dplyr)

my_data %>%

group_by(name) %>%

summarise(mean_salary = mean(salary))

```

在本节中,我们学习了如何安装和导入tidyr包、创建和导入数据,以及对数据进行初步探索。这些基础操作是任何数据分析项目不可或缺的部分,为后续的数据处理和分析打下了坚实的基础。

# 3. 数据清洗技巧

数据清洗是数据预处理阶段的关键步骤,是确保后续数据分析准确性的前提。本章节将详细介绍缺失值处理、数据重构和转换、数据的分组和汇总等技巧。

## 3.1 缺失值的处理

### 3.1.1 探索缺失值

在R语言中,缺失值通常用`NA`来表示。探索缺失值是数据清洗的第一步,通过了解数据中的缺失值情况,可以有效地决定后续的处理策略。使用`summary()`函数可以快速查看数据集中的缺失值情况。

```R

# 示例数据框df的创建

df <- data.frame(

A = c(1, 2, NA, 4, 5),

B = c(NA, 2, 3, 4, NA),

C = c(1, 2, 3, 4, 5)

)

# 探索数据框df中的缺失值情况

summary(df)

```

执行上述代码块后,将得到每一列中非缺失值和缺失值的数量,从而帮助我们了解数据的完整性。

### 3.1.2 缺失值的填充策略

在确认了数据集中的缺失值分布之后,下一步就是决定如何处理这些缺失值。常见的方法包括删除含有缺失值的行或列、用特定值填充(如列的平均值、中位数或众数)、或者使用插值方法。

```R

# 删除含有缺失值的行

df_complete_rows <- na.omit(df)

# 用特定值填充,例如用列的平均值填充

df_filled <- df

for (i in 1:ncol(df)) {

df_filled[ , i][is.na(df_filled[ , i])] <- mean(df_filled[ , i], na.rm = TRUE)

}

# 使用插值方法,这里以线性插值为例

library(zoo)

df_interpolated <- na.approx(df_filled)

```

在上述代码中,`na.omit()`函数直接删除了含有缺失值的行,而`for`循环则用于逐列计算并填充平均值。对于更复杂的插值方法,我们使用了`zoo`包中的`na.approx()`函数进行线性插值。

## 3.2 数据重构和转换

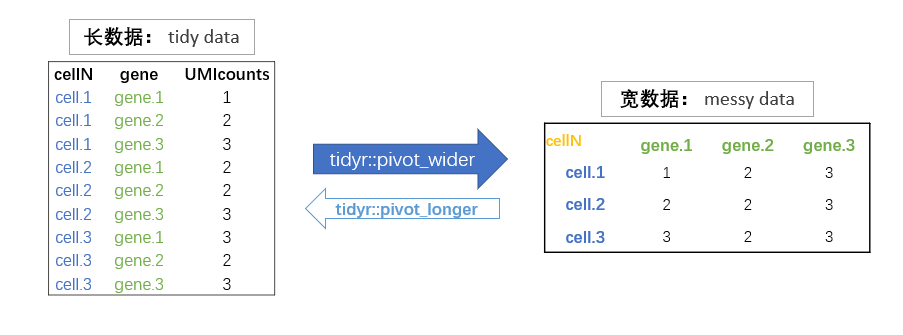

数据重构和转换是将数据从一种形式转换成另一种形式的过程,常见的转换任务包括使用`gather()`和`spread()`函数将数据从宽格式转换成长格式,或者反之。

### 3.2.1 数据的转换函数

`tidyr`包中的`gather()`和`spread()`函数是处理宽格式和长格式转换的重要工具。

```R

# 使用gather()函数将宽格式数据转换为长格式

df_long <- gather(df, key = "Variable", value = "Value", -C)

# 使用spread()函数将长格式数据转换为宽格式

df_wide <- spread(df_long, key = "Variable", value = "Value")

```

### 3.2.2 长格式与宽格式的转换

在数据转换过程中,通常需要根据分析的需求来决定数据集的格式。长格式通常便于进行时间序列分析和模型拟合,而宽格式则适合进行跨列的比较分析。

```R

# 示例:将df转换为长格式

df_long <- df %>%

gather(key = "Variable", value = "Value", -C)

# 示例:将df_long转换回宽格式

df_wide <- df_long %>%

spread(key = "Variable", value = "Value")

```

在这个例子中,`%>%`是管道操作符,它用于将前一个函数的输出作为下一个函数的输入。`gather()`和`spread()`函数的`key`参数用于指定新数据框中的列名变量,而`value`参数指定了包含数据值的列。

## 3.3 数据的分组和汇总

在数据处理中,经常需要对数据按照某些特征进行分组,并对每个组进行汇总计算。`tidyr`和`dplyr`包提供了许多方便的函数来进行分组和汇总。

### 3.3.1 基于分组的计算

在R中,`group_by()`函数可以用于创建分组,而`summarize()`函数可以用于计算每个分组的汇总统计。

```R

# 对df按变量C进行分组,并计算每个组的平均值

grouped_df <- df %>%

group_by(C) %>%

summarize(mean_A = mean(A, na.rm = TRUE),

mean_B = mean(B, na.rm = TRUE))

```

### 3.3.2 数据的汇总和报告

汇总数据时,可以使用一系列的汇总函数,如`mean()`, `sum()`, `median()`, `n()`, 和`n_distinct()`等,来计算每个分组的统计信息。`summarize()`函数可以将这些统计信息整合成一个新的数据框。

```R

# 使用summarize()函数对每个分组进行多项汇总

summarized_df <- df %>%

group_by(C) %>%

summarize(

Average_A = mean(A, na.rm = TRUE),

Sum_B = sum(B, na.rm = TRUE),

Median_C = median(C, na.rm = TRUE),

Count = n(),

Unique_Count = n_distinct(C)

)

```

在这个例子中,对每个组计算了变量A的平均值、变量B的总和、变量C的中位数、组内记录的数量以及C

0

0