【R语言缺失数据处理】:掌握tidyr包的完整教程

发布时间: 2024-11-03 04:47:32 阅读量: 65 订阅数: 39

# 1. R语言与数据处理概述

## 1.1 R语言简介

R语言是一种用于统计分析、图形表示和报告的编程语言。其最大的优势在于其强大的数据处理能力与开源社区。R语言拥有大量的包,可以轻松实现复杂的统计分析和数据可视化。

## 1.2 数据处理的重要性

在数据分析中,数据的准备和清洗通常占据了大部分时间。一个清晰、准确的数据集是进行分析和建模的前提。数据处理不仅包括数据清洗,还涉及数据转换、整合、重构等多个步骤。

## 1.3 R语言与数据处理

R语言为数据处理提供了多样的工具和函数。从读取数据到数据清洗,再到缺失值处理和数据转换,R语言的tidyr、dplyr等包极大地简化了这些步骤。接下来,我们将深入学习R语言如何应对这些挑战。

# 2. 理解缺失数据

## 2.1 缺失数据的类型与影响

### 2.1.1 完全随机缺失(MCAR)、随机缺失(MAR)和非随机缺失(NMAR)

在处理数据集时,一个常见的问题是数据缺失。这些缺失的数据可以分为几种类型,分别是完全随机缺失(MCAR),随机缺失(MAR),和非随机缺失(NMAR)。理解它们之间的区别对于选择恰当的数据处理策略至关重要。

- **完全随机缺失(MCAR)**:数据中缺失值的出现与观测值或者未观测值无关。换句话说,缺失与数据本身或者其他变量无关。MCAR是最理想的状态,因为它允许我们简单地删除缺失数据而不会引起偏差。在真实世界中,这种情况较少见。

- **随机缺失(MAR)**:数据中的缺失与观测值本身无关,但与未观测到的数据有关。例如,在医疗研究中,如果病情严重的病人更可能拒绝回答某些问题,那么这些问题的答案的缺失是与病情这一未观测变量相关的。

- **非随机缺失(NMAR)**:数据的缺失依赖于未观测值本身。换言之,数据缺失本身就是一个研究变量的函数。NMAR是最为棘手的情况,因为缺失值包含有用信息,而无法直接观察到。如果处理不当,可能会导致严重的偏差。

识别这些不同类型缺失的重要性在于,它们影响到接下来的统计分析和模型构建的正确性。例如,在采用简单的删除法处理缺失数据时,若缺失是MCAR,删除后数据的分析结果仍然可能是无偏的。但对于MAR和NMAR,就需要采用更加复杂的处理方法。

### 2.1.2 缺失数据对分析的影响

缺失数据的存在会对数据分析产生多方面的影响:

- **减少统计功效**:缺失数据意味着一部分信息的丢失,这将降低分析的统计功效。

- **引入偏差**:如果缺失数据不是MCAR,那么可能会使得分析结果出现系统性偏差。

- **影响模型的估计精度**:缺失值可能会使得模型参数估计不准确。

- **影响预测准确性**:在应用机器学习算法进行预测时,缺失数据会影响模型的预测准确性。

因此,正确处理缺失数据是数据分析中的一个关键步骤。选择合适的方法来处理缺失数据能够显著提高分析结果的可靠性和有效性。

## 2.2 缺失数据的识别和检查

### 2.2.1 使用R语言基础函数识别缺失值

R语言提供了多种函数来帮助我们识别数据集中的缺失值。最基本的是`is.na()`函数,它可以检测数据集中的NA值,并返回一个与原数据集同维度的逻辑矩阵。另一个常用函数是`complete.cases()`,它返回一个逻辑向量,其中TRUE表示该行数据没有缺失值。

```R

# 示例数据集

data <- data.frame(

age = c(20, 21, NA, 23),

height = c(170, NA, 172, 165),

weight = c(65, 70, 75, NA)

)

# 使用is.na()检测缺失值

missing_values <- is.na(data)

print(missing_values)

# 使用complete.cases()检查完整案例

complete_cases <- complete.cases(data)

print(complete_cases)

```

在上述代码中,我们首先创建了一个包含缺失值的数据框`data`。然后使用`is.na(data)`检测每个元素是否为NA,该函数返回一个逻辑矩阵。`complete.cases(data)`则返回一个逻辑向量,指示每行数据是否完整。

### 2.2.2 高级方法与可视化工具

除了使用基础函数外,还可以采用高级的统计方法和可视化工具来进行缺失数据的识别与检查。例如,使用`VIM`包中的`aggr()`函数可以生成一个缺失数据的矩阵图,它显示了不同变量缺失数据的比例和模式。

```R

# 安装并加载VIM包

# install.packages("VIM")

library(VIM)

# 创建缺失数据的矩阵图

aggr_plot <- aggr(data, prop = F, numbers = T)

print(aggr_plot)

```

在上面的代码块中,我们首先加载了`VIM`包,并使用`aggr()`函数生成了一个显示数据集`data`中缺失数据模式的图形。这个图形有助于我们直观地理解缺失数据在不同变量间的分布情况。通过这种方式,我们可以更加系统地识别缺失数据,并根据缺失模式选择合适的处理策略。

### 2.2.3 进一步阅读与资源

- [R语言处理缺失数据的案例与实践](***

* [VIM包的文档](***

* [介绍R语言中的多重插补方法](***

通过以上方法与工具的应用,我们可以更深入地理解缺失数据,并为后续的处理做好准备。下一节将介绍如何使用`tidyr`包处理缺失数据,进一步深入探索R语言在数据整理中的强大功能。

# 3. tidyr包基础与数据整理

## 3.1 安装和加载tidyr包

### 3.1.1 为什么选择tidyr

在处理数据的诸多R包中,选择tidyr主要因为其提供的函数都是为了提高数据整洁度(tidiness)而设计的。tidyr包能够将数据转换成更易于分析的格式。其设计灵感来源于Hadley Wickham的论文《Tidy Data》,该论文详细阐述了整洁数据的概念和原则。数据的整洁化使得后续的数据处理、分析和可视化操作更为高效和直观。在R语言的tidyverse生态系统中,tidyr扮演着至关重要的角色。

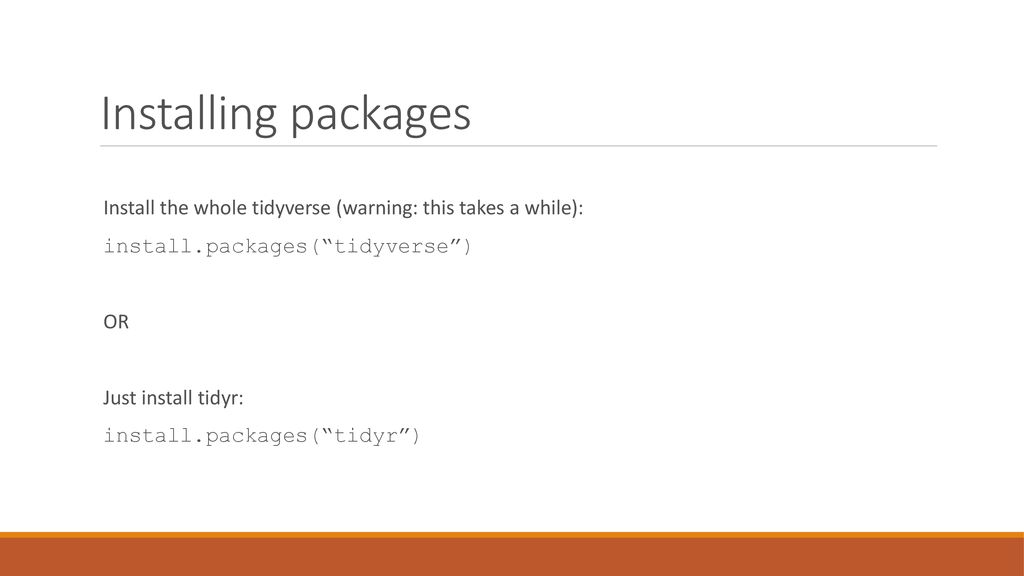

### 3.1.2 安装和加载tidyr

为了安装和加载tidyr包,首先确保你的R环境是最新的。然后使用以下代码安装并加载tidyr包:

```R

# 安装tidyr包

install.packages("tidyr")

# 加载tidyr包

library(tidyr)

```

安装后,我们就可以使用tidyr中提供的各种功能来整理和清洗数据集了。

## 3.2 数据集的整洁化

### 3.2.1 整洁数据的原则

整洁数据遵循三个主要的原则:

1. 每一列是一个变量。

2. 每一行是一个观测。

3. 每一个表存储一个数据集。

保持数据的整洁性可以大大简化数据分析流程,确保后续步骤中数据能以一致的方式进行处理。tidyr包就是基于这些原则来提供相关函数,帮助用户整理和转换数据,以便更好地适应分析和可视化的需求。

### 3.2.2 使用gather和spread函数进行数据转换

在数据整理过程中,我们经常需要将数据从宽格式转换为长格式(使用gather函数),或者从长格式转换为宽格式(使用spread函数)。以下是一个简单的例子来说明这两种转换:

```R

# 安装并加载所需的包

library(tidyr)

# 生成模拟数据

data("mtcars")

wide_data <- mtcars[1:5, c("mpg", "cyl", "disp")]

long_data <- gather(wide_data, key = "variable", value = "value", mpg, cyl, disp)

# 查看转换后的数据

print(long_data)

```

在这个例子中,我们首先创建了一个宽格式的数据框`wide_data`,使用了`gather`函数将其转换为长格式的`long_data`。`gather`函数中的`key`参数为新数据框中的变量名列,`value`参数为对应的数据值列。

## 3.3 使用tidyr进行数据清洗

### 3.3.1 移除行和列

在数据整理过程中,有时需要移除那些不再需要的行和列。使用`drop_na`函数可以去除包含缺失值的行,而使用`select`函数可以根据列名选择性地保留或排除某些列:

```R

# 从mtcars数据框中移除含有NA的行

cleaned_mtcars <- drop_na(mtcars)

# 选择mtcars数据框中的前五列

selected_mtcars <- select(mtcars, 1:5)

# 查看处理后的数据框

print(cleaned_mtcars)

print(selected_mtcars)

```

在这个例子中,`drop_na`函数帮助我们清理了数据框中的缺失值,而`select`函数则使得我们可以灵活地处理列的保留与排除。

### 3.3.2 重命名列和创建新列

在数据分析和报告过程中,为了更好地解释变量或满足特定的格式要求,我们需要重命名列或创建新列。使用`rename`函数可以轻松实现列的重命名:

```R

# 重命名mtcars数据框中的列

mtcars <- rename(mtcars, MilesPerGallon = mpg, Cylinders = cyl)

# 查看重命名后的数据框

```

0

0