【Java大数据应用案例】:Hadoop生态中的Java实践解析

发布时间: 2024-09-22 07:38:19 阅读量: 491 订阅数: 78

# 1. 大数据与Java的结合

## 1.1 大数据概述与Java的结合点

大数据代表了处理和分析大量数据的先进技术与实践,它通过存储、管理、处理数据集来揭示模式、趋势和关联,尤其是涉及人类行为和互动的数据。Java作为一种广泛使用的编程语言,其在大数据领域的重要性主要得益于其跨平台的特性、成熟的生态系统和社区支持。Java不仅在构建企业级应用方面占据一席之地,更是在大数据技术栈中扮演了重要角色。

## 1.2 Java在大数据中的应用场景

在大数据技术的范畴内,Java通常被应用于编写数据处理逻辑、数据分析、以及创建数据密集型的应用程序。例如,在Hadoop生态系统中,Java用于编写MapReduce作业、与HDFS交互以及编写YARN应用程序。Java在大数据中的应用场景还包括但不限于以下几种:

- 开发和维护数据处理流程;

- 编写数据聚合和转换服务;

- 实现数据仓库和数据湖的逻辑。

Java的泛型、多线程以及高效的运行时性能使得它成为处理大数据的理想选择。随着大数据技术的不断成熟,Java也在不断地与大数据技术结合,推动着企业信息系统的发展与创新。

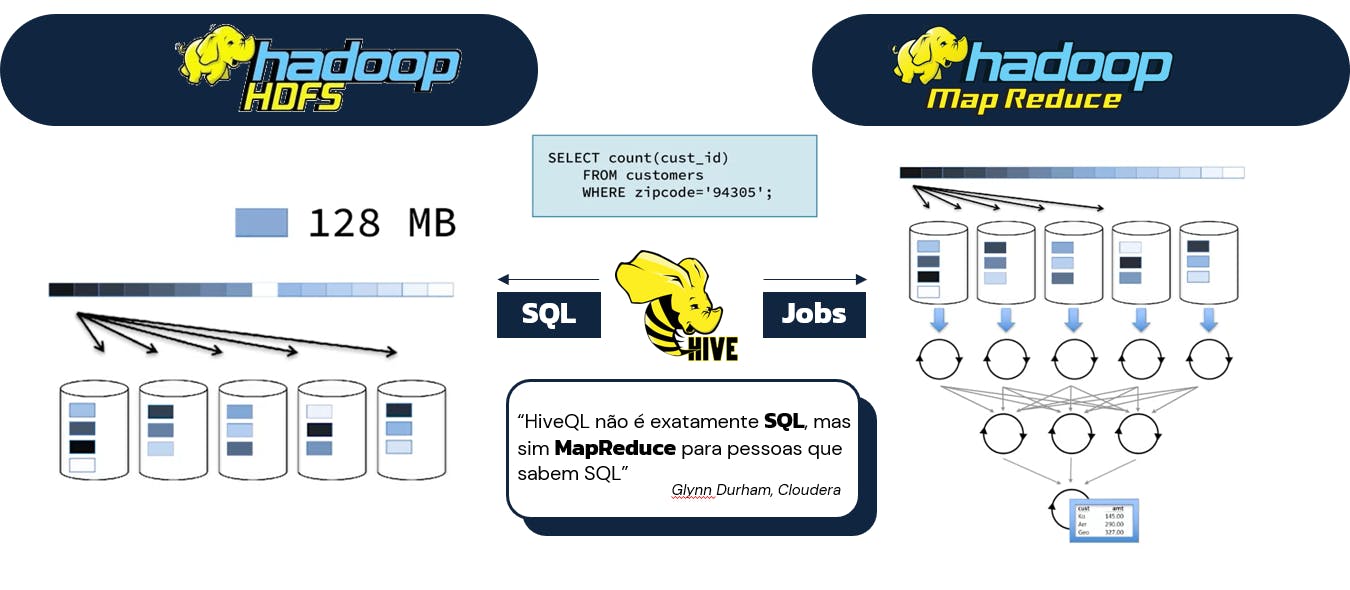

# 2. Hadoop核心组件的Java实现

### 2.1 HDFS文件系统的Java接口

#### 2.1.1 HDFS的基本概念和架构

HDFS(Hadoop Distributed File System)是Hadoop项目的核心组件之一,它是一个高度容错的系统,适合在廉价硬件上运行。HDFS可以提供高吞吐量的数据访问,非常适合大规模数据集的应用。HDFS的设计哲学是存储大量数据而不是访问速度,因此它倾向于在读写速度上进行平衡,而不是优化单次读写的速度。

HDFS采用主从(Master/Slave)架构,主要由NameNode和DataNode构成:

- **NameNode**:管理文件系统的命名空间,维护文件系统树及整个目录树,跟踪文件系统的元数据,如文件和目录信息。每个HDFS集群只有一个NameNode。

- **DataNode**:存储实际的数据,即HDFS文件系统中的数据块。DataNode通常是一个节点一个,负责处理文件系统客户端的读写请求。

### 2.1.2 使用Java操作HDFS文件

在Java中操作HDFS文件可以通过Hadoop的Java库来实现。下面是使用Java进行HDFS文件操作的基本步骤:

1. **配置Hadoop环境**:确保你的Java项目包含了Hadoop的依赖,并且已经设置了HADOOP_HOME环境变量。

2. **获取FileSystem实例**:

```java

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(URI.create("hdfs://namenode:8020"), conf);

```

3. **创建文件并写入数据**:

```java

FSDataOutputStream out = fs.create(new Path("/path/to/hdfs/file"));

out.writeUTF("Hello HDFS!");

out.close();

```

4. **读取文件内容**:

```java

FSDataInputStream in = fs.open(new Path("/path/to/hdfs/file"));

System.out.println(in.readUTF());

in.close();

```

5. **关闭FileSystem资源**:

```java

fs.close();

```

在实际操作中,你可能需要根据文件大小、访问频率等因素进行高级操作,比如设置副本因子、获取文件状态等。

### 2.2 MapReduce编程模型的Java应用

#### 2.2.1 MapReduce的工作原理

MapReduce是一种编程模型,用于处理和生成大数据集。它的思想是将任务拆分为Map(映射)和Reduce(归约)两个阶段,其中Map阶段处理输入数据,生成中间键值对,Reduce阶段则对中间键值对进行合并操作。

一个典型的MapReduce作业包括以下几个步骤:

1. **输入数据**:数据被分割成固定大小的块,然后分配到不同的Map任务中。

2. **Map阶段**:对输入数据进行处理,输出键值对。

3. **Shuffle过程**:系统自动将所有Map输出的中间键值对根据键进行排序和分组,分发给对应的Reduce任务。

4. **Reduce阶段**:对Shuffle过来的键值对集合进行合并操作,输出最终结果。

5. **输出结果**:将Reduce阶段的输出写入文件系统。

#### 2.2.2 Java中的MapReduce编程实践

下面是一个简单的Java MapReduce程序,它实现的是统计输入文件中各个单词出现的次数:

1. **定义Mapper类**:

```java

public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

```

2. **定义Reducer类**:

```java

public static class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

3. **驱动程序**:

```java

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

```

在这个例子中,我们定义了两个类:TokenizerMapper用于将输入文本分割成单词,并将每个单词映射为键值对;IntSumReducer用于将具有相同键的所有值进行归约操作,即将它们相加,得到每个单词的总数。

### 2.3 YARN资源管理的Java集成

#### 2.3.1 YARN架构解析

YARN(Yet Another Resource Negotiator)是Hadoop 2.x版本引入的资源管理层。YARN的核心思想是将资源管理和作业调度/监控分离开来。YARN主要包括三种角色:

- **ResourceManager(RM)**:负责整个系统的资源管理和调度。

- **NodeManager(NM)**:负责每个节点的资源管理和任务执行。

- **ApplicationMaster(AM)**:负责单个应用程序的生命周期管理。

YARN工作流程如下:

1. 客户端提交应用程序,ResourceManager分配一个Container,并在对应的NodeManager上启动ApplicationMaster。

2. ApplicationMaster向ResourceManager注册并请求运行任务所需的资源。

3. ResourceManager返回资源的地址,由ApplicationMaster启动相应的任务。

4. NodeManager监控任务运行状态,ResourceManager监控NodeManager的资源使用情况。

#### 2.3.2 Java与YARN的交互方式

在Java程序中,可以通过YARN的API来提交和监控作业。以下是一个简单的Java代码片段,用于提交作业并监控作业状态:

1. **配置YARN客户端**:

```java

Configuration conf = new Configuration();

YarnConfiguration yarnConf = new YarnConfiguration(conf);

String queue = "default"; // 队列名

float priority = 0.1f; // 任务优先级

```

2. **创建YARN客户端并提交作业**:

```java

YarnClient yarnClient = YarnClient.createYarnClient();

yarnClient.init(yarnConf);

yarnClient.start();

ApplicationId appId = submitApplication(yarnClient, queue, priority);

```

3. **监控作业状态**:

```java

ApplicationReport appReport = yarnClient.getApplicationReport(appId);

Status appStatus = appReport.getYarnApplicationState();

while(appStatus != YarnApplicationState.FINISHED &&

appStatus != YarnApplicationState.KILLED &&

appStatus != YarnApplicationState.FAILED) {

Thread.sleep(100);

appReport = yarnClient.getApplicationReport(appId);

appStatus = appReport.getYarnApplicationState();

}

```

在上述代码中,我们首先创建了YARN客户端并初始化配置,然后通过`submitApplication`方法提交应用程序到YARN集群,并在随后的循环中监控应用程序状态直到完成。

以上是Hadoop核心组件在Java中的基本实现,下一章节将详细探讨Hadoop生态系统的其他Java工具的使用。

# 3. Hadoop生态系统的Java工具使用

## 3.1 Hive数据仓库的Java客户端使用

### 3.1.1 Hive的基本原理和操作

Apache Hive 是一个建立在 Hadoop 之上的数据仓库工具,它提供了一系列的工具,能够对存储在 HDFS 中的大规模数据集进行查询和分析。Hive 定义了一个类 SQL 语言叫做 HiveQL,它允许熟悉 SQL 的用户能够轻松地查询数据。HiveQL 语句最终会被转换为 MapReduce、Tez 或 Spark 作业来执行。

使用 Hive 时,用户可以定义表结构,它们会映射到 HDFS 上的数据文件。Hive 使得对数据进行聚合、排序、连接等操作变得简单高效。它通过所谓的 Metastore 来存储表的定义信息和数据的元数据。Hive 还有各种优化器,可以对执行计划进行优化,例如选择不同的执行策略

0

0